mayocream/koharu

GitHub: mayocream/koharu

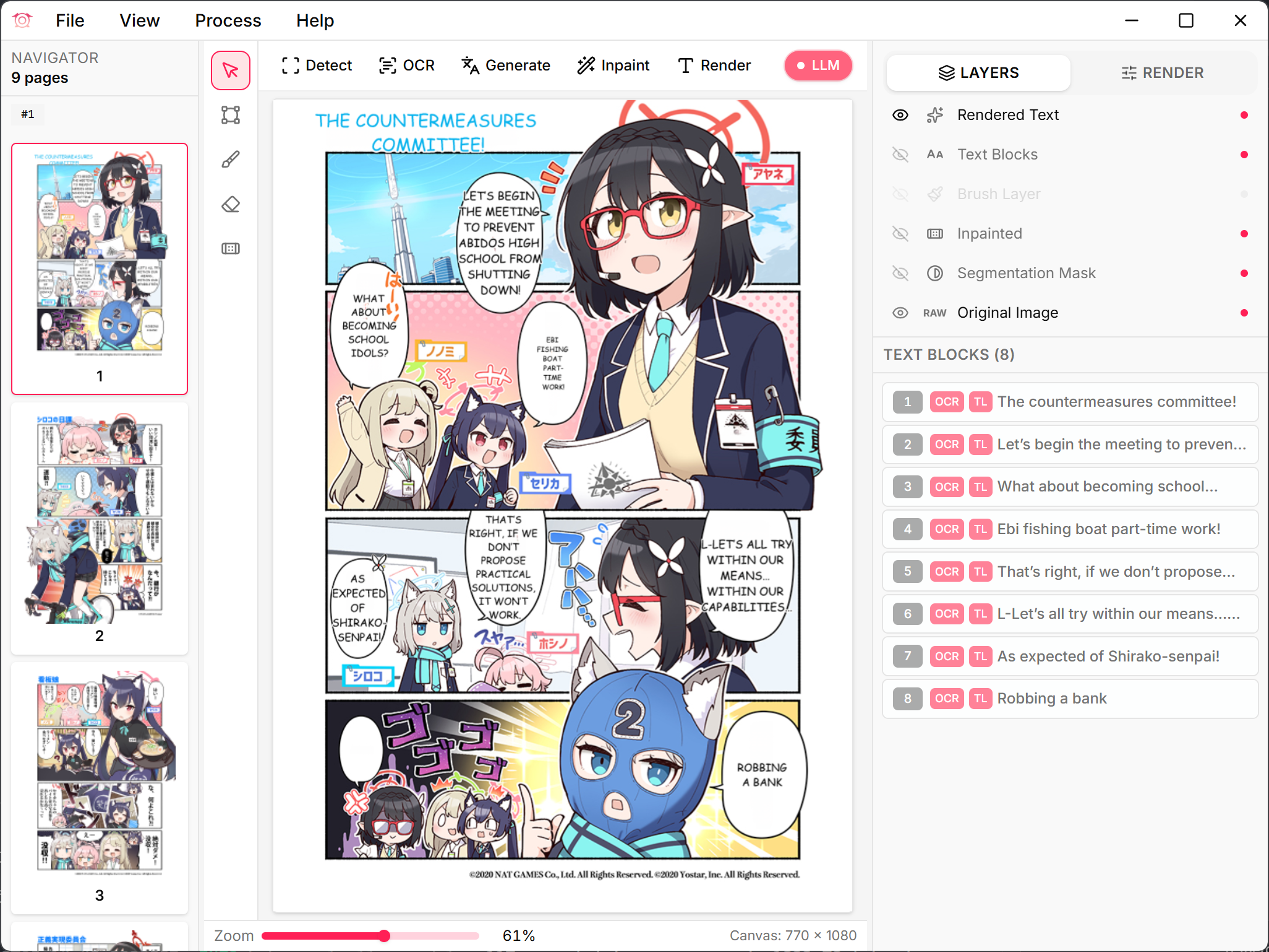

基于 Rust 的机器学习驱动漫画翻译器,集成气泡检测、OCR、Inpainting 与 LLM 翻译能力,提供完整的漫画本地化工作流。

Stars: 811 | Forks: 41

# Koharu

[日本語](./docs/README.ja.md) | [简体中文](./docs/README.zh-CN.md)

基于 **Rust** 编写的 ML 驱动漫画翻译器。

Koharu 引入了一种全新的漫画翻译工作流,利用 ML 的力量实现流程自动化。它结合了目标检测、OCR、Inpainting 和 LLM 的能力,创造了无缝的翻译体验。

在底层,Koharu 使用 [candle](https://github.com/huggingface/candle) 进行高性能推理,并使用 [Tauri](https://github.com/tauri-apps/tauri) 构建 GUI。所有组件均由 Rust 编写,确保安全与速度。

## 功能特性

- 自动气泡检测与分割

- 用于漫画文本识别的 OCR

- 用于移除原图文本的 Inpainting

- LLM 驱动的翻译

- CJK 语言的垂直文本布局

- 用于 AI 代理的 MCP 服务器

## 使用说明

### 快捷键

- Ctrl + 鼠标滚轮:放大/缩小

- Ctrl + 拖拽:平移画布

- Del:删除选中的文本块

### MCP Server

Koharu 内置了 MCP 服务器,可用于与 AI 代理集成。默认情况下,MCP 服务器会监听随机端口,但你可以使用 `--port` 标志指定端口。

```

# macOS / Linux

koharu --port 9999

# Windows

koharu.exe --port 9999

```

你可以在 AI 代理的 MCP 服务器 URL 字段中输入 `http://localhost:9999/mcp`。

### Headless Mode

Koharu 可以通过命令行在 Headless 模式下运行。

```

# macOS / Linux

koharu --port 4000 --headless

# Windows

koharu.exe --port 4000 --headless

```

你现在可以通过 `http://localhost:4000` 访问 Koharu Web UI。

### 文件关联

在 Windows 上,Koharu 会自动关联 `.khr` 文件,因此你可以通过双击打开它们。`.khr` 文件也可以作为图片打开,以查看其中包含图像的缩略图。

## GPU 加速

支持 CUDA 和 Metal 进行 GPU 加速,可显著提升受支持硬件上的性能。

### CUDA

Koharu 构建时包含 CUDA 支持,使其能够利用 NVIDIA GPU 的强大功能进行更快速的处理。

Koharu 内置了 CUDA toolkit 13.1 和 cuDNN 9.19,动态库会在首次运行时自动解压到应用程序数据目录。

#### 支持的 NVIDIA GPU

Koharu 支持计算能力 7.5 或更高的 NVIDIA GPU。

请通过查看 [CUDA GPU Compute Capability](https://developer.nvidia.com/cuda-gpus) 和 [cuDNN Support Matrix](https://docs.nvidia.com/deeplearning/cudnn/backend/latest/reference/support-matrix.html) 来确认你的 GPU 是否受支持。

### Metal

Koharu 支持 macOS 上 Apple Silicon(M1、M2 等)的 Metal GPU 加速。这使得 Koharu 能够在广泛的 Apple 设备上高效运行。

### CPU 回退

你始终可以强制 Koharu 使用 CPU 进行推理:

```

# macOS / Linux

koharu --cpu

# Windows

koharu.exe --cpu

```

## ML 模型

Koharu 依赖于计算机视觉和自然语言处理模型的组合来执行其任务。

### 计算机视觉模型

Koharu 针对不同任务使用了多个预训练模型:

- [comic-text-detector](https://github.com/dmMaze/comic-text-detector)

- [manga-ocr](https://github.com/kha-white/manga-ocr)

- [AnimeMangaInpainting](https://huggingface.co/dreMaz/AnimeMangaInpainting)

- [YuzuMarker.FontDetection](https://github.com/JeffersonQin/YuzuMarker.FontDetection)

首次运行 Koharu 时,模型会自动下载。

我们将原始模型转换为 safetensors 格式,以提高性能并与 Rust 兼容。转换后的模型托管在 [Hugging Face](https://huggingface.co/mayocream) 上。

### 大语言模型

Koharu 支持本地和远程 LLM 后端,并尽可能根据你的系统区域设置预选模型。

#### 本地 LLM

Koharu 通过 [candle](https://github.com/huggingface/candle) 支持各种 GGUF 格式的量化 LLM。这些模型在你的机器上运行,当你在设置中选择它们时会按需下载。支持的模型及建议用法:

用于翻译成英文:

- [vntl-llama3-8b-v2](https://huggingface.co/lmg-anon/vntl-llama3-8b-v2-gguf):约 8.5 GB Q8_0 权重大小,建议 >=10 GB VRAM 或充足的系统 RAM 用于 CPU 推理,在准确性至关重要时效果最佳。

- [lfm2-350m-enjp-mt](https://huggingface.co/LiquidAI/LFM2-350M-ENJP-MT-GGUF):超轻量级(≈350M,Q8_0);可在 CPU 和低内存 GPU 上流畅运行,以质量为代价换取快速预览或低配置机器的理想选择。

用于翻译成中文:

- [sakura-galtransl-7b-v3.7](https://huggingface.co/SakuraLLM/Sakura-GalTransl-7B-v3.7):约 6.3 GB,适合 8 GB VRAM,质量与速度的良好平衡。

- [sakura-1.5b-qwen2.5-v1.0](https://huggingface.co/shing3232/Sakura-1.5B-Qwen2.5-v1.0-GGUF-IMX):轻量级(≈1.5B,Q5KS);适合中端 GPU(4–6 GB VRAM)或具有适量 RAM 的纯 CPU 配置,比 7B/8B 更快,同时保持 Qwen 风格的 tokenizer 行为。

对于其他语言,你可以使用:

- [hunyuan-7b-mt-v1.0](https://huggingface.co/Mungert/Hunyuan-MT-7B-GGUF):约 6.3GB,适合 8 GB VRAM,不错的多语言翻译质量。

当你在设置中选择模型时,LLM 将按需自动下载。如果你受内存限制,请选择满足你质量需求的最小模型;如果你有足够的 VRAM/RAM,建议使用 7B/8B 变体以获得更好的翻译效果。

#### 远程 LLM

Koharu 也可以通过远程或自托管 API 提供商进行翻译,而无需下载本地模型。支持的远程提供商:

- OpenAI

- Gemini

- Claude

- DeepSeek

- OpenAI Compatible,包括 LM Studio、OpenRouter 等工具和服务,或任何暴露 OpenAI 风格 `/v1/models` 和 `/v1/chat/completions` API 的端点

远程提供商在 **Settings > API Keys** 中配置。对于 OpenAI Compatible,你还需要设置自定义 base URL。对于 LM Studio 等本地服务器,API keys 是可选的,但对于 OpenRouter 等托管服务通常是必需的。

当你希望避免下载本地模型、减少本地 VRAM/RAM 使用量,或将 Koharu 连接到托管模型时,请使用远程提供商。请注意,选中用于翻译的 OCR 文本将发送到配置的提供商。

## 安装

你可以从 [releases 页面](https://github.com/mayocream/koharu/releases/latest) 下载最新版本的 Koharu。

我们为 Windows、macOS 和 Linux 提供预编译的二进制文件。对于其他平台,你可能需要从源码构建,请参阅下面的 [开发](#development) 部分。

## 开发

要从源码构建 Koharu,请按照以下步骤操作。

### 前置条件

- [Rust](https://www.rust-lang.org/tools/install)(1.92 或更高版本)

- [Bun](https://bun.sh/)(1.0 或更高版本)

### 安装依赖

```

bun install

```

### 构建

```

bun run build

```

构建好的二进制文件将位于 `target/release` 目录中。

## 贡献者

## 许可证

Koharu 采用 [GNU General Public License v3.0](LICENSE) 许可。

## 许可证

Koharu 采用 [GNU General Public License v3.0](LICENSE) 许可。

标签:AI代理, Apex, candle, CUDA, DLL 劫持, Inpainting, LLM, MCP服务器, Metal, OCR, Rust, Tauri, Unmanaged PE, Vectored Exception Handling, 人工智能, 可视化界面, 图像修复, 图像处理, 垂直排版, 大语言模型, 威胁情报, 实时告警, 开发者工具, 文字识别, 无头模式, 日漫汉化, 机器学习, 桌面应用, 气泡检测, 漫画翻译, 用户模式Hook绕过, 目标检测, 网络流量审计, 自动化翻译, 计算机视觉, 通知系统