maximhq/bifrost

GitHub: maximhq/bifrost

高性能企业级 AI 网关,通过统一的 OpenAI 兼容接口聚合 15+ 大模型供应商,提供负载均衡、故障转移、语义缓存和治理能力。

Stars: 2663 | Forks: 277

# Bifrost AI Gateway

[](https://goreportcard.com/report/github.com/maximhq/bifrost/core)

[](https://discord.gg/exN5KAydbU)

[](https://snyk.io/test/github/maximhq/bifrost)

[](https://codecov.io/gh/maximhq/bifrost)

[ ](https://app.getpostman.com/run-collection/31642484-2ba0e658-4dcd-49f4-845a-0c7ed745b916?action=collection%2Ffork&source=rip_markdown&collection-url=entityId%3D31642484-2ba0e658-4dcd-49f4-845a-0c7ed745b916%26entityType%3Dcollection%26workspaceId%3D63e853c8-9aec-477f-909c-7f02f543150e)

[](https://artifacthub.io/packages/search?repo=bifrost)

[](LICENSE)

## 构建永不停机的 AI 应用的最快方式

Bifrost 是一个高性能 AI 网关,通过单一 OpenAI 兼容 API 统一访问 15+ 个提供商(OpenAI, Anthropic, AWS Bedrock, Google Vertex 等)。零配置秒级部署,获得自动故障转移、负载均衡、语义缓存和企业级功能。

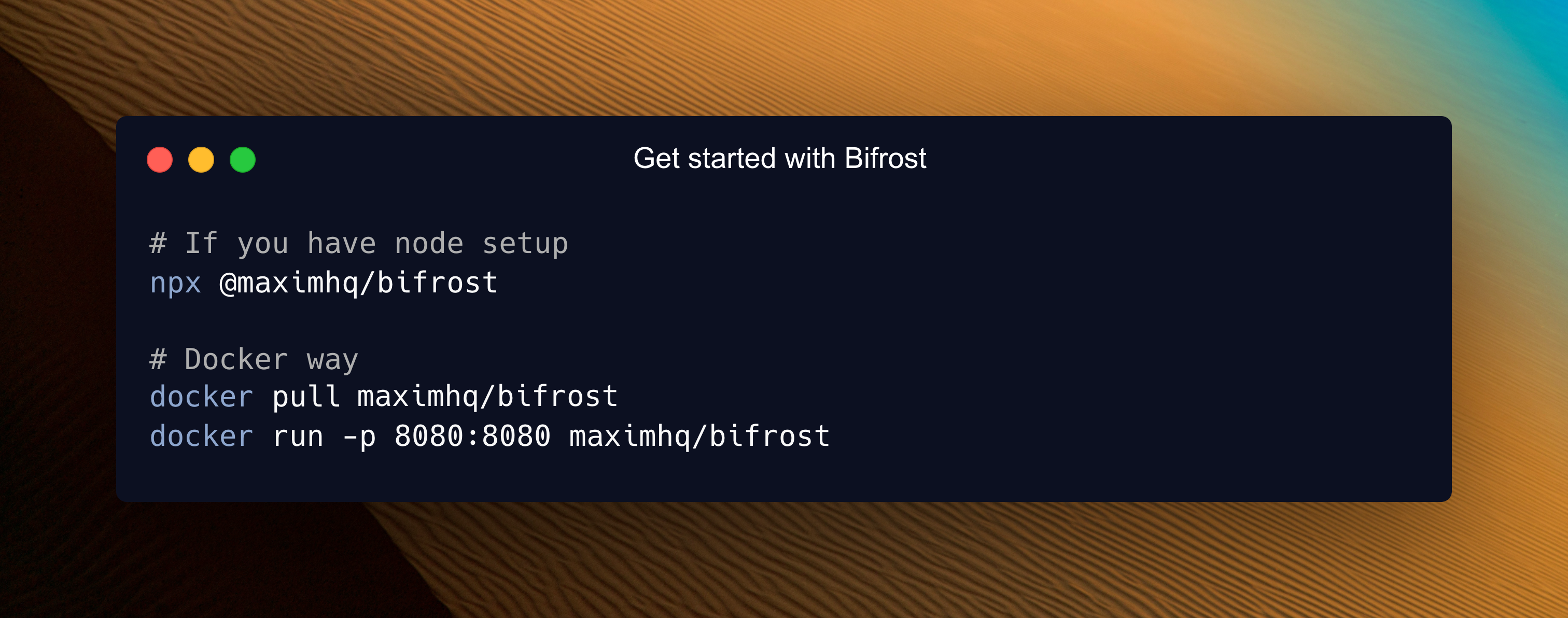

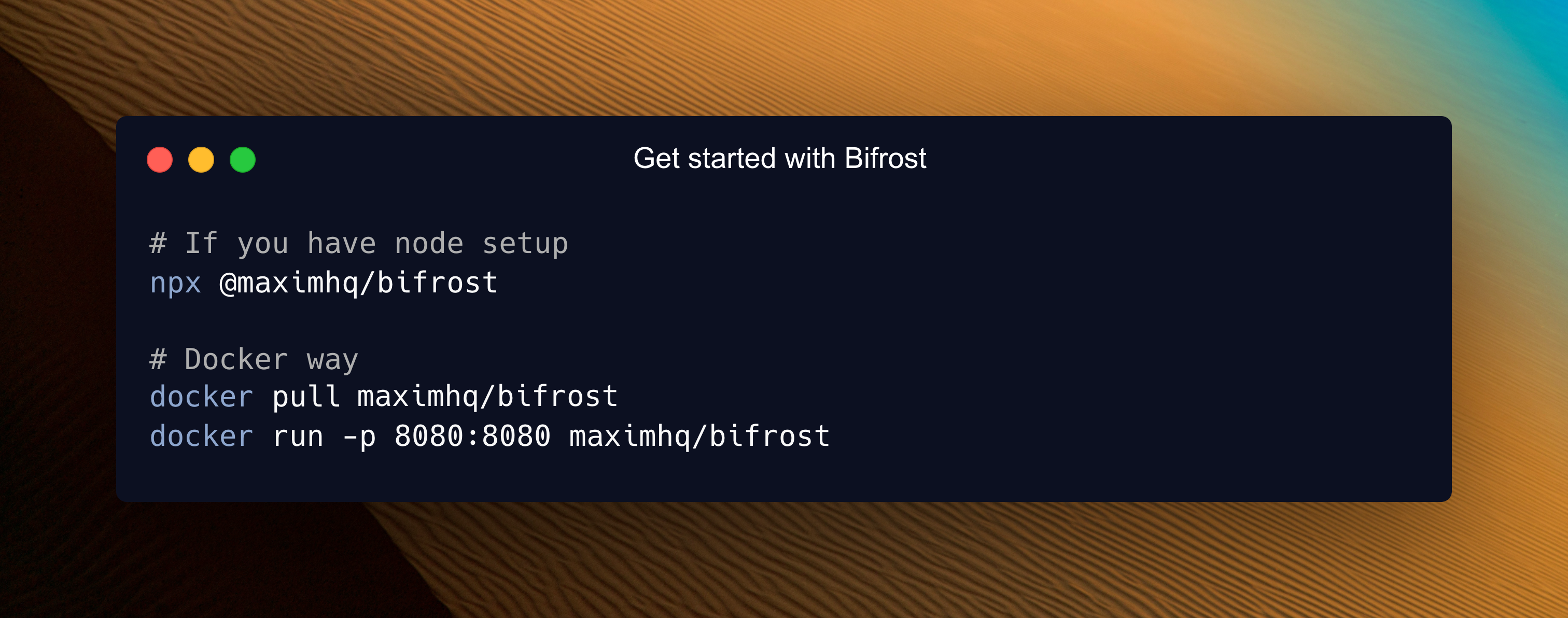

## 快速开始

**在一分钟内从零开始构建生产就绪的 AI 网关。**

**第 1 步:** 启动 Bifrost Gateway

```

# 本地安装与运行

npx -y @maximhq/bifrost

# 或使用 Docker

docker run -p 8080:8080 maximhq/bifrost

```

**第 2 步:** 通过 Web UI 配置

```

# 打开内置 Web 界面

open http://localhost:8080

```

**第 3 步:** 发起你的第一个 API 调用

```

curl -X POST http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "openai/gpt-4o-mini",

"messages": [{"role": "user", "content": "Hello, Bifrost!"}]

}'

```

**搞定!** 你的 AI 网关已启动,并配有用于可视化配置、实时监控和分析的 Web 界面。

**完整设置指南:**

- [网关设置](https://docs.getbifrost.ai/quickstart/gateway/setting-up) - HTTP API 部署

- [Go SDK 设置](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up) - 直接集成

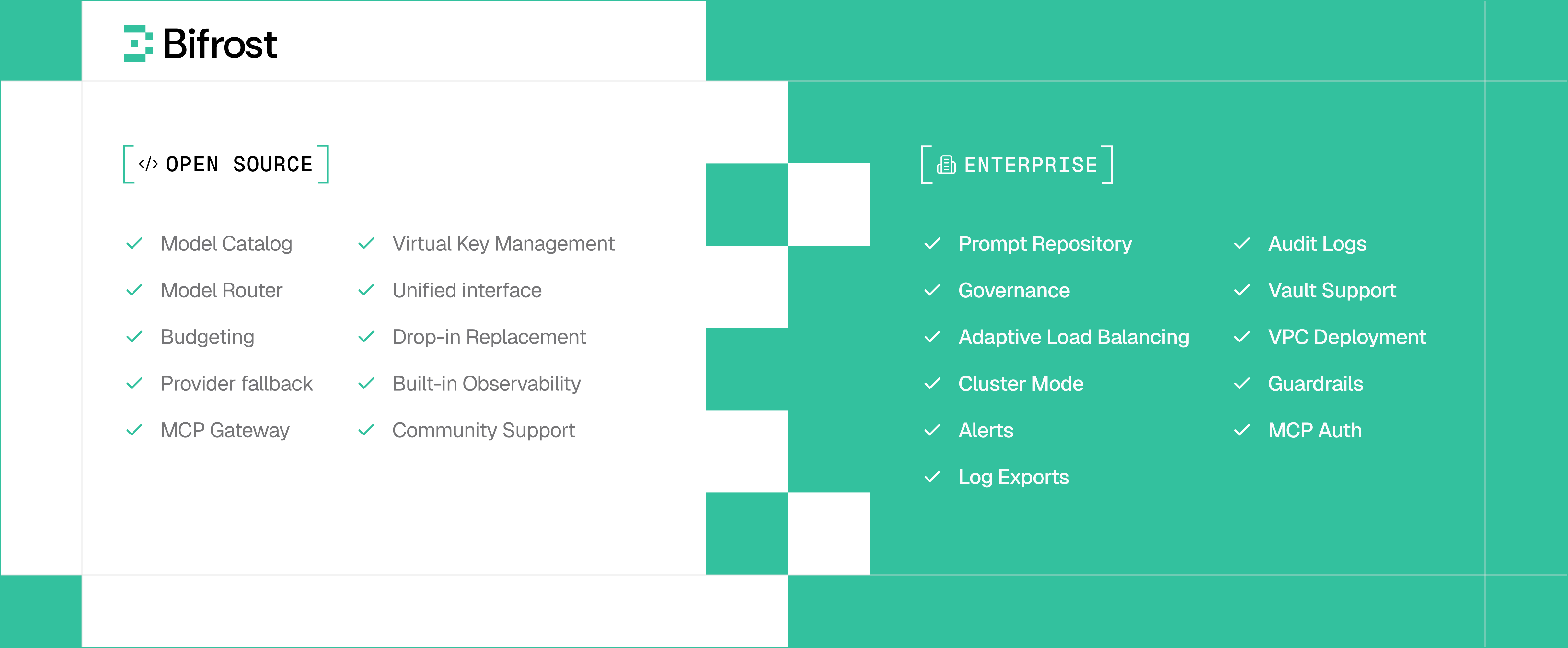

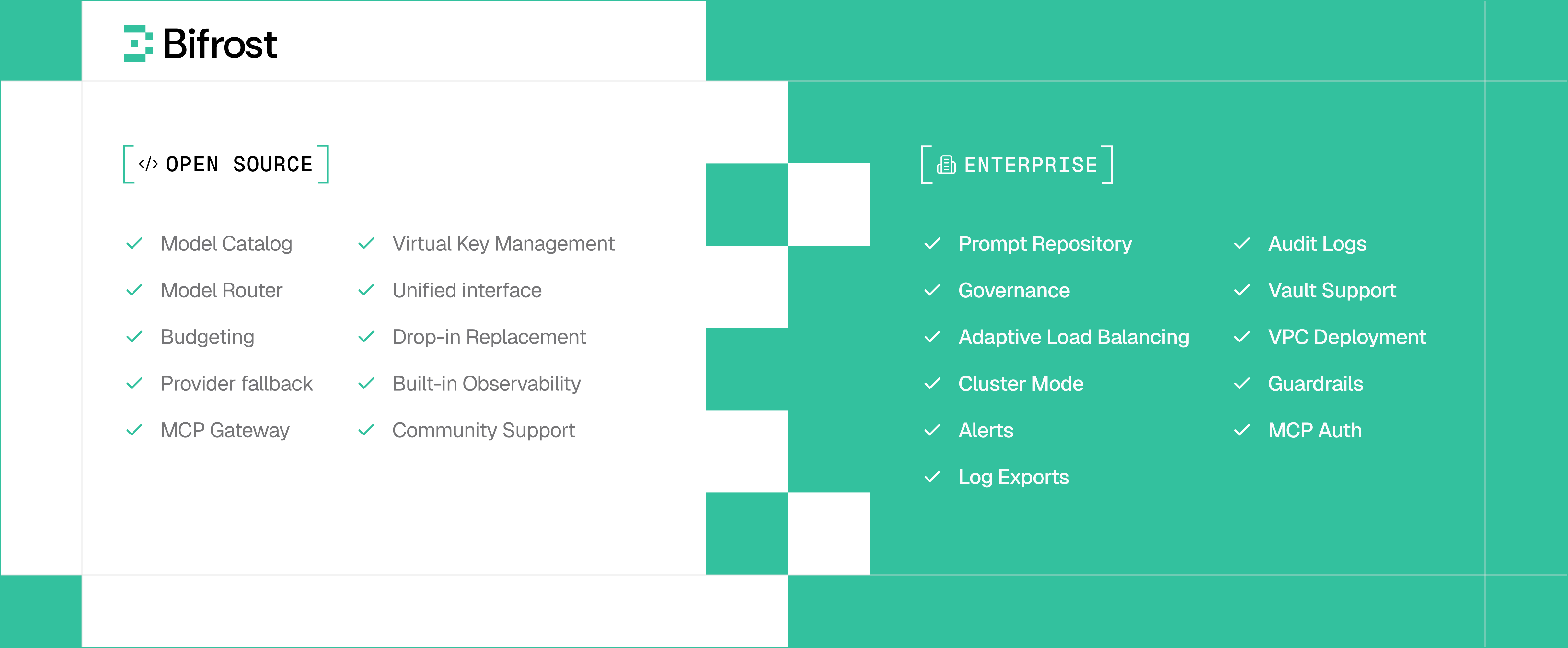

## 企业级部署

Bifrost 支持企业级、私有化部署,适用于大规模运行生产 AI 系统的团队。

除了私有网络、自定义安全控制和治理外,企业级部署还解锁了高级功能,包括自适应负载均衡、集群、护栏、MCP 网关以及其他专为企业级规模和可靠性设计的功能。

](https://app.getpostman.com/run-collection/31642484-2ba0e658-4dcd-49f4-845a-0c7ed745b916?action=collection%2Ffork&source=rip_markdown&collection-url=entityId%3D31642484-2ba0e658-4dcd-49f4-845a-0c7ed745b916%26entityType%3Dcollection%26workspaceId%3D63e853c8-9aec-477f-909c-7f02f543150e)

[](https://artifacthub.io/packages/search?repo=bifrost)

[](LICENSE)

## 构建永不停机的 AI 应用的最快方式

Bifrost 是一个高性能 AI 网关,通过单一 OpenAI 兼容 API 统一访问 15+ 个提供商(OpenAI, Anthropic, AWS Bedrock, Google Vertex 等)。零配置秒级部署,获得自动故障转移、负载均衡、语义缓存和企业级功能。

## 快速开始

**在一分钟内从零开始构建生产就绪的 AI 网关。**

**第 1 步:** 启动 Bifrost Gateway

```

# 本地安装与运行

npx -y @maximhq/bifrost

# 或使用 Docker

docker run -p 8080:8080 maximhq/bifrost

```

**第 2 步:** 通过 Web UI 配置

```

# 打开内置 Web 界面

open http://localhost:8080

```

**第 3 步:** 发起你的第一个 API 调用

```

curl -X POST http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "openai/gpt-4o-mini",

"messages": [{"role": "user", "content": "Hello, Bifrost!"}]

}'

```

**搞定!** 你的 AI 网关已启动,并配有用于可视化配置、实时监控和分析的 Web 界面。

**完整设置指南:**

- [网关设置](https://docs.getbifrost.ai/quickstart/gateway/setting-up) - HTTP API 部署

- [Go SDK 设置](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up) - 直接集成

## 企业级部署

Bifrost 支持企业级、私有化部署,适用于大规模运行生产 AI 系统的团队。

除了私有网络、自定义安全控制和治理外,企业级部署还解锁了高级功能,包括自适应负载均衡、集群、护栏、MCP 网关以及其他专为企业级规模和可靠性设计的功能。

## 核心功能

### 核心基础设施

- **[统一接口](https://docs.getbifrost.ai/features/unified-interface)** - 面向所有提供商的单一 OpenAI 兼容 API

- **[多提供商支持](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - OpenAI, Anthropic, AWS Bedrock, Google Vertex, Azure, Cerebras, Cohere, Mistral, Ollama, Groq 等

- **[自动回退](https://docs.getbifrost.ai/features/fallbacks)** - 在提供商和模型之间无缝故障转移,零停机

- **[负载均衡](https://docs.getbifrost.ai/features/fallbacks)** - 跨多个 API Key 和提供商的智能请求分配

### 高级功能

- **[模型上下文协议 (MCP)](https://docs.getbifrost.ai/features/mcp)** - 使 AI 模型能够使用外部工具(文件系统、Web 搜索、数据库)

- **[语义缓存](https://docs.getbifrost.ai/features/semantic-caching)** - 基于语义相似度的智能响应缓存,以降低成本和延迟

- **[多模态支持](https://docs.getbifrost.ai/quickstart/gateway/streaming)** - 支持文本、图像、音频和流式传输,均通过通用接口实现。

- **[自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins)** - 可扩展的中间件架构,用于分析、监控和自定义逻辑

- **[治理](https://docs.getbifrost.ai/features/governance)** - 使用追踪、速率限制和细粒度访问控制

### 企业与安全

- **[预算管理](https://docs.getbifrost.ai/features/governance)** - 具有虚拟密钥、团队和客户预算的分级成本控制

- **[SSO 集成](https://docs.getbifrost.ai/features/sso-with-google-github)** - 支持 Google 和 GitHub 身份验证

- **[可观测性](https://docs.getbifrost.ai/features/observability)** - 原生 Prometheus 指标、分布式追踪和全面日志记录

- **[Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support)** - 通过 HashiCorp Vault 集成进行安全的 API Key 管理

### 开发者体验

- **[零配置启动](https://docs.getbifrost.ai/quickstart/gateway/setting-up)** - 通过动态提供商配置立即启动

- **[直接替换](https://docs.getbifrost.ai/features/drop-in-replacement)** - 用一行代码替换 OpenAI/Anthropic/GenAI API

- **[SDK 集成](https://docs.getbifrost.ai/integrations/what-is-an-integration)** - 原生支持流行的 AI SDK,零代码更改

- **[配置灵活性](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - Web UI、API 驱动或基于文件的配置选项

## 仓库结构

Bifrost 采用模块化架构以实现最大的灵活性:

```

bifrost/

├── npx/ # NPX script for easy installation

├── core/ # Core functionality and shared components

│ ├── providers/ # Provider-specific implementations (OpenAI, Anthropic, etc.)

│ ├── schemas/ # Interfaces and structs used throughout Bifrost

│ └── bifrost.go # Main Bifrost implementation

├── framework/ # Framework components for data persistence

│ ├── configstore/ # Configuration storages

│ ├── logstore/ # Request logging storages

│ └── vectorstore/ # Vector storages

├── transports/ # HTTP gateway and other interface layers

│ └── bifrost-http/ # HTTP transport implementation

├── ui/ # Web interface for HTTP gateway

├── plugins/ # Extensible plugin system

│ ├── governance/ # Budget management and access control

│ ├── jsonparser/ # JSON parsing and manipulation utilities

│ ├── logging/ # Request logging and analytics

│ ├── maxim/ # Maxim's observability integration

│ ├── mocker/ # Mock responses for testing and development

│ ├── semanticcache/ # Intelligent response caching

│ └── telemetry/ # Monitoring and observability

├── docs/ # Documentation and guides

└── tests/ # Comprehensive test suites

```

## 入门选项

选择适合你需求的部署方法:

### 1. Gateway (HTTP API)

**适用于:** 语言无关集成、微服务和生产部署

```

# NPX - 30 秒快速开始

npx -y @maximhq/bifrost

# Docker - 生产就绪

docker run -p 8080:8080 -v $(pwd)/data:/app/data maximhq/bifrost

```

**功能:** Web UI、实时监控、多提供商管理、零配置启动

**了解更多:** [网关设置指南](https://docs.getbifrost.ai/quickstart/gateway/setting-up)

### 2. Go SDK

**适用于:** 追求最大性能和可控性的直接 Go 集成

```

go get github.com/maximhq/bifrost/core

```

**功能:** 原生 Go API、嵌入式部署、自定义中间件集成

**了解更多:** [Go SDK 指南](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up)

### 3. 直接替换

**适用于:** 零代码更改迁移现有应用

```

# OpenAI SDK

- base_url = "https://api.openai.com"

+ base_url = "http://localhost:8080/openai"

# Anthropic SDK

- base_url = "https://api.anthropic.com"

+ base_url = "http://localhost:8080/anthropic"

# Google GenAI SDK

- api_endpoint = "https://generativelanguage.googleapis.com"

+ api_endpoint = "http://localhost:8080/genai"

```

**了解更多:** [集成指南](https://docs.getbifrost.ai/integrations/what-is-an-integration)

## 性能

Bifrost 为你的 AI 请求增加几乎零开销。在持续的 5,000 RPS 基准测试中,网关对每个请求仅增加了 **11 µs** 的开销。

| 指标 | t3.medium | t3.xlarge | 提升 |

|--------|-----------|-----------|-------------|

| 增加的延迟 (Bifrost 开销) | 59 µs | **11 µs** | **-81%** |

| 5k RPS 下的成功率 | 100% | 100% | 无失败请求 |

| 平均队列等待时间 | 47 µs | **1.67 µs** | **-96%** |

| 平均请求延迟 (含提供商) | 2.12 s | **1.61 s** | **-24%** |

**关键性能亮点:**

- **完美的成功率** - 即使在 5k RPS 下也能保持 100% 的请求成功率

- **极低开销** - 每个请求增加的延迟少于 15 µs

- **高效排队** - 亚微秒级的平均等待时间

- **快速密钥选择** - ~10 ns 即可选出加权 API Key

**完整基准测试:** [性能分析](https://docs.getbifrost.ai/benchmarking/getting-started)

## 文档

**完整文档:** [https://docs.getbifrost.ai](https://docs.getbifrost.ai)

### 快速开始

- [网关设置](https://docs.getbifrost.ai/quickstart/gateway/setting-up) - 30 秒内部署 HTTP API

- [Go SDK 设置](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up) - 直接 Go 集成

- [提供商配置](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration) - 多提供商设置

### 功能

- [多提供商支持](https://docs.getbifrost.ai/features/unified-interface) - 面向所有提供商的单一 API

- [MCP 集成](https://docs.getbifrost.ai/features/mcp) - 外部工具调用

- [语义缓存](https://docs.getbifrost.ai/features/semantic-caching) - 智能响应缓存

- [回退与负载均衡](https://docs.getbifrost.ai/features/fallbacks) - 可靠性功能

- [预算管理](https://docs.getbifrost.ai/features/governance) - 成本控制与治理

### 集成

- [OpenAI SDK](https://docs.getbifrost.ai/integrations/openai-sdk) - OpenAI 直接替换

- [Anthropic SDK](https://docs.getbifrost.ai/integrations/anthropic-sdk) - Anthropic 直接替换

- [AWS Bedrock SDK](https://docs.getbifrost.ai/integrations/bedrock-sdk) - AWS Bedrock 集成

- [Google GenAI SDK](https://docs.getbifrost.ai/integrations/genai-sdk) - GenAI 直接替换

- [LiteLLM SDK](https://docs.getbifrost.ai/integrations/litellm-sdk) - LiteLLM 集成

- [Langchain SDK](https://docs.getbifrost.ai/integrations/langchain-sdk) - Langchain 集成

### 企业版

- [自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins) - 扩展功能

- [集群](https://docs.getbifrost.ai/enterprise/clustering) - 多节点部署

- [Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support) - 安全密钥管理

- [生产部署](https://docs.getbifrost.ai/deployment/docker-setup) - 扩展与监控

## 需要帮助?

**[加入我们的 Discord](https://discord.gg/exN5KAydbU)** 获取社区支持和讨论。

获取以下帮助:

- 快速设置协助与故障排除

- 最佳实践与配置技巧

- 社区讨论与支持

- 集成相关的实时帮助

## 贡献

我们欢迎各种形式的贡献!请参阅我们的[贡献指南](https://docs.getbifrost.ai/contributing/setting-up-repo)了解:

- 设置开发环境

- 代码规范与最佳实践

- 如何提交 Pull Request

- 本地构建与测试

有关开发要求和构建说明,请参阅我们的[开发设置指南](https://docs.getbifrost.ai/contributing/setting-up-repo#development-environment-setup)。

## 许可证

本项目基于 Apache 2.0 许可证授权 - 详情请参阅 [LICENSE](LICENSE) 文件。

由 [Maxim](https://github.com/maximhq) ❤️ 打造

## 核心功能

### 核心基础设施

- **[统一接口](https://docs.getbifrost.ai/features/unified-interface)** - 面向所有提供商的单一 OpenAI 兼容 API

- **[多提供商支持](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - OpenAI, Anthropic, AWS Bedrock, Google Vertex, Azure, Cerebras, Cohere, Mistral, Ollama, Groq 等

- **[自动回退](https://docs.getbifrost.ai/features/fallbacks)** - 在提供商和模型之间无缝故障转移,零停机

- **[负载均衡](https://docs.getbifrost.ai/features/fallbacks)** - 跨多个 API Key 和提供商的智能请求分配

### 高级功能

- **[模型上下文协议 (MCP)](https://docs.getbifrost.ai/features/mcp)** - 使 AI 模型能够使用外部工具(文件系统、Web 搜索、数据库)

- **[语义缓存](https://docs.getbifrost.ai/features/semantic-caching)** - 基于语义相似度的智能响应缓存,以降低成本和延迟

- **[多模态支持](https://docs.getbifrost.ai/quickstart/gateway/streaming)** - 支持文本、图像、音频和流式传输,均通过通用接口实现。

- **[自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins)** - 可扩展的中间件架构,用于分析、监控和自定义逻辑

- **[治理](https://docs.getbifrost.ai/features/governance)** - 使用追踪、速率限制和细粒度访问控制

### 企业与安全

- **[预算管理](https://docs.getbifrost.ai/features/governance)** - 具有虚拟密钥、团队和客户预算的分级成本控制

- **[SSO 集成](https://docs.getbifrost.ai/features/sso-with-google-github)** - 支持 Google 和 GitHub 身份验证

- **[可观测性](https://docs.getbifrost.ai/features/observability)** - 原生 Prometheus 指标、分布式追踪和全面日志记录

- **[Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support)** - 通过 HashiCorp Vault 集成进行安全的 API Key 管理

### 开发者体验

- **[零配置启动](https://docs.getbifrost.ai/quickstart/gateway/setting-up)** - 通过动态提供商配置立即启动

- **[直接替换](https://docs.getbifrost.ai/features/drop-in-replacement)** - 用一行代码替换 OpenAI/Anthropic/GenAI API

- **[SDK 集成](https://docs.getbifrost.ai/integrations/what-is-an-integration)** - 原生支持流行的 AI SDK,零代码更改

- **[配置灵活性](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - Web UI、API 驱动或基于文件的配置选项

## 仓库结构

Bifrost 采用模块化架构以实现最大的灵活性:

```

bifrost/

├── npx/ # NPX script for easy installation

├── core/ # Core functionality and shared components

│ ├── providers/ # Provider-specific implementations (OpenAI, Anthropic, etc.)

│ ├── schemas/ # Interfaces and structs used throughout Bifrost

│ └── bifrost.go # Main Bifrost implementation

├── framework/ # Framework components for data persistence

│ ├── configstore/ # Configuration storages

│ ├── logstore/ # Request logging storages

│ └── vectorstore/ # Vector storages

├── transports/ # HTTP gateway and other interface layers

│ └── bifrost-http/ # HTTP transport implementation

├── ui/ # Web interface for HTTP gateway

├── plugins/ # Extensible plugin system

│ ├── governance/ # Budget management and access control

│ ├── jsonparser/ # JSON parsing and manipulation utilities

│ ├── logging/ # Request logging and analytics

│ ├── maxim/ # Maxim's observability integration

│ ├── mocker/ # Mock responses for testing and development

│ ├── semanticcache/ # Intelligent response caching

│ └── telemetry/ # Monitoring and observability

├── docs/ # Documentation and guides

└── tests/ # Comprehensive test suites

```

## 入门选项

选择适合你需求的部署方法:

### 1. Gateway (HTTP API)

**适用于:** 语言无关集成、微服务和生产部署

```

# NPX - 30 秒快速开始

npx -y @maximhq/bifrost

# Docker - 生产就绪

docker run -p 8080:8080 -v $(pwd)/data:/app/data maximhq/bifrost

```

**功能:** Web UI、实时监控、多提供商管理、零配置启动

**了解更多:** [网关设置指南](https://docs.getbifrost.ai/quickstart/gateway/setting-up)

### 2. Go SDK

**适用于:** 追求最大性能和可控性的直接 Go 集成

```

go get github.com/maximhq/bifrost/core

```

**功能:** 原生 Go API、嵌入式部署、自定义中间件集成

**了解更多:** [Go SDK 指南](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up)

### 3. 直接替换

**适用于:** 零代码更改迁移现有应用

```

# OpenAI SDK

- base_url = "https://api.openai.com"

+ base_url = "http://localhost:8080/openai"

# Anthropic SDK

- base_url = "https://api.anthropic.com"

+ base_url = "http://localhost:8080/anthropic"

# Google GenAI SDK

- api_endpoint = "https://generativelanguage.googleapis.com"

+ api_endpoint = "http://localhost:8080/genai"

```

**了解更多:** [集成指南](https://docs.getbifrost.ai/integrations/what-is-an-integration)

## 性能

Bifrost 为你的 AI 请求增加几乎零开销。在持续的 5,000 RPS 基准测试中,网关对每个请求仅增加了 **11 µs** 的开销。

| 指标 | t3.medium | t3.xlarge | 提升 |

|--------|-----------|-----------|-------------|

| 增加的延迟 (Bifrost 开销) | 59 µs | **11 µs** | **-81%** |

| 5k RPS 下的成功率 | 100% | 100% | 无失败请求 |

| 平均队列等待时间 | 47 µs | **1.67 µs** | **-96%** |

| 平均请求延迟 (含提供商) | 2.12 s | **1.61 s** | **-24%** |

**关键性能亮点:**

- **完美的成功率** - 即使在 5k RPS 下也能保持 100% 的请求成功率

- **极低开销** - 每个请求增加的延迟少于 15 µs

- **高效排队** - 亚微秒级的平均等待时间

- **快速密钥选择** - ~10 ns 即可选出加权 API Key

**完整基准测试:** [性能分析](https://docs.getbifrost.ai/benchmarking/getting-started)

## 文档

**完整文档:** [https://docs.getbifrost.ai](https://docs.getbifrost.ai)

### 快速开始

- [网关设置](https://docs.getbifrost.ai/quickstart/gateway/setting-up) - 30 秒内部署 HTTP API

- [Go SDK 设置](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up) - 直接 Go 集成

- [提供商配置](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration) - 多提供商设置

### 功能

- [多提供商支持](https://docs.getbifrost.ai/features/unified-interface) - 面向所有提供商的单一 API

- [MCP 集成](https://docs.getbifrost.ai/features/mcp) - 外部工具调用

- [语义缓存](https://docs.getbifrost.ai/features/semantic-caching) - 智能响应缓存

- [回退与负载均衡](https://docs.getbifrost.ai/features/fallbacks) - 可靠性功能

- [预算管理](https://docs.getbifrost.ai/features/governance) - 成本控制与治理

### 集成

- [OpenAI SDK](https://docs.getbifrost.ai/integrations/openai-sdk) - OpenAI 直接替换

- [Anthropic SDK](https://docs.getbifrost.ai/integrations/anthropic-sdk) - Anthropic 直接替换

- [AWS Bedrock SDK](https://docs.getbifrost.ai/integrations/bedrock-sdk) - AWS Bedrock 集成

- [Google GenAI SDK](https://docs.getbifrost.ai/integrations/genai-sdk) - GenAI 直接替换

- [LiteLLM SDK](https://docs.getbifrost.ai/integrations/litellm-sdk) - LiteLLM 集成

- [Langchain SDK](https://docs.getbifrost.ai/integrations/langchain-sdk) - Langchain 集成

### 企业版

- [自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins) - 扩展功能

- [集群](https://docs.getbifrost.ai/enterprise/clustering) - 多节点部署

- [Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support) - 安全密钥管理

- [生产部署](https://docs.getbifrost.ai/deployment/docker-setup) - 扩展与监控

## 需要帮助?

**[加入我们的 Discord](https://discord.gg/exN5KAydbU)** 获取社区支持和讨论。

获取以下帮助:

- 快速设置协助与故障排除

- 最佳实践与配置技巧

- 社区讨论与支持

- 集成相关的实时帮助

## 贡献

我们欢迎各种形式的贡献!请参阅我们的[贡献指南](https://docs.getbifrost.ai/contributing/setting-up-repo)了解:

- 设置开发环境

- 代码规范与最佳实践

- 如何提交 Pull Request

- 本地构建与测试

有关开发要求和构建说明,请参阅我们的[开发设置指南](https://docs.getbifrost.ai/contributing/setting-up-repo#development-environment-setup)。

## 许可证

本项目基于 Apache 2.0 许可证授权 - 详情请参阅 [LICENSE](LICENSE) 文件。

由 [Maxim](https://github.com/maximhq) ❤️ 打造

## 核心功能

### 核心基础设施

- **[统一接口](https://docs.getbifrost.ai/features/unified-interface)** - 面向所有提供商的单一 OpenAI 兼容 API

- **[多提供商支持](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - OpenAI, Anthropic, AWS Bedrock, Google Vertex, Azure, Cerebras, Cohere, Mistral, Ollama, Groq 等

- **[自动回退](https://docs.getbifrost.ai/features/fallbacks)** - 在提供商和模型之间无缝故障转移,零停机

- **[负载均衡](https://docs.getbifrost.ai/features/fallbacks)** - 跨多个 API Key 和提供商的智能请求分配

### 高级功能

- **[模型上下文协议 (MCP)](https://docs.getbifrost.ai/features/mcp)** - 使 AI 模型能够使用外部工具(文件系统、Web 搜索、数据库)

- **[语义缓存](https://docs.getbifrost.ai/features/semantic-caching)** - 基于语义相似度的智能响应缓存,以降低成本和延迟

- **[多模态支持](https://docs.getbifrost.ai/quickstart/gateway/streaming)** - 支持文本、图像、音频和流式传输,均通过通用接口实现。

- **[自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins)** - 可扩展的中间件架构,用于分析、监控和自定义逻辑

- **[治理](https://docs.getbifrost.ai/features/governance)** - 使用追踪、速率限制和细粒度访问控制

### 企业与安全

- **[预算管理](https://docs.getbifrost.ai/features/governance)** - 具有虚拟密钥、团队和客户预算的分级成本控制

- **[SSO 集成](https://docs.getbifrost.ai/features/sso-with-google-github)** - 支持 Google 和 GitHub 身份验证

- **[可观测性](https://docs.getbifrost.ai/features/observability)** - 原生 Prometheus 指标、分布式追踪和全面日志记录

- **[Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support)** - 通过 HashiCorp Vault 集成进行安全的 API Key 管理

### 开发者体验

- **[零配置启动](https://docs.getbifrost.ai/quickstart/gateway/setting-up)** - 通过动态提供商配置立即启动

- **[直接替换](https://docs.getbifrost.ai/features/drop-in-replacement)** - 用一行代码替换 OpenAI/Anthropic/GenAI API

- **[SDK 集成](https://docs.getbifrost.ai/integrations/what-is-an-integration)** - 原生支持流行的 AI SDK,零代码更改

- **[配置灵活性](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - Web UI、API 驱动或基于文件的配置选项

## 仓库结构

Bifrost 采用模块化架构以实现最大的灵活性:

```

bifrost/

├── npx/ # NPX script for easy installation

├── core/ # Core functionality and shared components

│ ├── providers/ # Provider-specific implementations (OpenAI, Anthropic, etc.)

│ ├── schemas/ # Interfaces and structs used throughout Bifrost

│ └── bifrost.go # Main Bifrost implementation

├── framework/ # Framework components for data persistence

│ ├── configstore/ # Configuration storages

│ ├── logstore/ # Request logging storages

│ └── vectorstore/ # Vector storages

├── transports/ # HTTP gateway and other interface layers

│ └── bifrost-http/ # HTTP transport implementation

├── ui/ # Web interface for HTTP gateway

├── plugins/ # Extensible plugin system

│ ├── governance/ # Budget management and access control

│ ├── jsonparser/ # JSON parsing and manipulation utilities

│ ├── logging/ # Request logging and analytics

│ ├── maxim/ # Maxim's observability integration

│ ├── mocker/ # Mock responses for testing and development

│ ├── semanticcache/ # Intelligent response caching

│ └── telemetry/ # Monitoring and observability

├── docs/ # Documentation and guides

└── tests/ # Comprehensive test suites

```

## 入门选项

选择适合你需求的部署方法:

### 1. Gateway (HTTP API)

**适用于:** 语言无关集成、微服务和生产部署

```

# NPX - 30 秒快速开始

npx -y @maximhq/bifrost

# Docker - 生产就绪

docker run -p 8080:8080 -v $(pwd)/data:/app/data maximhq/bifrost

```

**功能:** Web UI、实时监控、多提供商管理、零配置启动

**了解更多:** [网关设置指南](https://docs.getbifrost.ai/quickstart/gateway/setting-up)

### 2. Go SDK

**适用于:** 追求最大性能和可控性的直接 Go 集成

```

go get github.com/maximhq/bifrost/core

```

**功能:** 原生 Go API、嵌入式部署、自定义中间件集成

**了解更多:** [Go SDK 指南](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up)

### 3. 直接替换

**适用于:** 零代码更改迁移现有应用

```

# OpenAI SDK

- base_url = "https://api.openai.com"

+ base_url = "http://localhost:8080/openai"

# Anthropic SDK

- base_url = "https://api.anthropic.com"

+ base_url = "http://localhost:8080/anthropic"

# Google GenAI SDK

- api_endpoint = "https://generativelanguage.googleapis.com"

+ api_endpoint = "http://localhost:8080/genai"

```

**了解更多:** [集成指南](https://docs.getbifrost.ai/integrations/what-is-an-integration)

## 性能

Bifrost 为你的 AI 请求增加几乎零开销。在持续的 5,000 RPS 基准测试中,网关对每个请求仅增加了 **11 µs** 的开销。

| 指标 | t3.medium | t3.xlarge | 提升 |

|--------|-----------|-----------|-------------|

| 增加的延迟 (Bifrost 开销) | 59 µs | **11 µs** | **-81%** |

| 5k RPS 下的成功率 | 100% | 100% | 无失败请求 |

| 平均队列等待时间 | 47 µs | **1.67 µs** | **-96%** |

| 平均请求延迟 (含提供商) | 2.12 s | **1.61 s** | **-24%** |

**关键性能亮点:**

- **完美的成功率** - 即使在 5k RPS 下也能保持 100% 的请求成功率

- **极低开销** - 每个请求增加的延迟少于 15 µs

- **高效排队** - 亚微秒级的平均等待时间

- **快速密钥选择** - ~10 ns 即可选出加权 API Key

**完整基准测试:** [性能分析](https://docs.getbifrost.ai/benchmarking/getting-started)

## 文档

**完整文档:** [https://docs.getbifrost.ai](https://docs.getbifrost.ai)

### 快速开始

- [网关设置](https://docs.getbifrost.ai/quickstart/gateway/setting-up) - 30 秒内部署 HTTP API

- [Go SDK 设置](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up) - 直接 Go 集成

- [提供商配置](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration) - 多提供商设置

### 功能

- [多提供商支持](https://docs.getbifrost.ai/features/unified-interface) - 面向所有提供商的单一 API

- [MCP 集成](https://docs.getbifrost.ai/features/mcp) - 外部工具调用

- [语义缓存](https://docs.getbifrost.ai/features/semantic-caching) - 智能响应缓存

- [回退与负载均衡](https://docs.getbifrost.ai/features/fallbacks) - 可靠性功能

- [预算管理](https://docs.getbifrost.ai/features/governance) - 成本控制与治理

### 集成

- [OpenAI SDK](https://docs.getbifrost.ai/integrations/openai-sdk) - OpenAI 直接替换

- [Anthropic SDK](https://docs.getbifrost.ai/integrations/anthropic-sdk) - Anthropic 直接替换

- [AWS Bedrock SDK](https://docs.getbifrost.ai/integrations/bedrock-sdk) - AWS Bedrock 集成

- [Google GenAI SDK](https://docs.getbifrost.ai/integrations/genai-sdk) - GenAI 直接替换

- [LiteLLM SDK](https://docs.getbifrost.ai/integrations/litellm-sdk) - LiteLLM 集成

- [Langchain SDK](https://docs.getbifrost.ai/integrations/langchain-sdk) - Langchain 集成

### 企业版

- [自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins) - 扩展功能

- [集群](https://docs.getbifrost.ai/enterprise/clustering) - 多节点部署

- [Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support) - 安全密钥管理

- [生产部署](https://docs.getbifrost.ai/deployment/docker-setup) - 扩展与监控

## 需要帮助?

**[加入我们的 Discord](https://discord.gg/exN5KAydbU)** 获取社区支持和讨论。

获取以下帮助:

- 快速设置协助与故障排除

- 最佳实践与配置技巧

- 社区讨论与支持

- 集成相关的实时帮助

## 贡献

我们欢迎各种形式的贡献!请参阅我们的[贡献指南](https://docs.getbifrost.ai/contributing/setting-up-repo)了解:

- 设置开发环境

- 代码规范与最佳实践

- 如何提交 Pull Request

- 本地构建与测试

有关开发要求和构建说明,请参阅我们的[开发设置指南](https://docs.getbifrost.ai/contributing/setting-up-repo#development-environment-setup)。

## 许可证

本项目基于 Apache 2.0 许可证授权 - 详情请参阅 [LICENSE](LICENSE) 文件。

由 [Maxim](https://github.com/maximhq) ❤️ 打造

## 核心功能

### 核心基础设施

- **[统一接口](https://docs.getbifrost.ai/features/unified-interface)** - 面向所有提供商的单一 OpenAI 兼容 API

- **[多提供商支持](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - OpenAI, Anthropic, AWS Bedrock, Google Vertex, Azure, Cerebras, Cohere, Mistral, Ollama, Groq 等

- **[自动回退](https://docs.getbifrost.ai/features/fallbacks)** - 在提供商和模型之间无缝故障转移,零停机

- **[负载均衡](https://docs.getbifrost.ai/features/fallbacks)** - 跨多个 API Key 和提供商的智能请求分配

### 高级功能

- **[模型上下文协议 (MCP)](https://docs.getbifrost.ai/features/mcp)** - 使 AI 模型能够使用外部工具(文件系统、Web 搜索、数据库)

- **[语义缓存](https://docs.getbifrost.ai/features/semantic-caching)** - 基于语义相似度的智能响应缓存,以降低成本和延迟

- **[多模态支持](https://docs.getbifrost.ai/quickstart/gateway/streaming)** - 支持文本、图像、音频和流式传输,均通过通用接口实现。

- **[自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins)** - 可扩展的中间件架构,用于分析、监控和自定义逻辑

- **[治理](https://docs.getbifrost.ai/features/governance)** - 使用追踪、速率限制和细粒度访问控制

### 企业与安全

- **[预算管理](https://docs.getbifrost.ai/features/governance)** - 具有虚拟密钥、团队和客户预算的分级成本控制

- **[SSO 集成](https://docs.getbifrost.ai/features/sso-with-google-github)** - 支持 Google 和 GitHub 身份验证

- **[可观测性](https://docs.getbifrost.ai/features/observability)** - 原生 Prometheus 指标、分布式追踪和全面日志记录

- **[Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support)** - 通过 HashiCorp Vault 集成进行安全的 API Key 管理

### 开发者体验

- **[零配置启动](https://docs.getbifrost.ai/quickstart/gateway/setting-up)** - 通过动态提供商配置立即启动

- **[直接替换](https://docs.getbifrost.ai/features/drop-in-replacement)** - 用一行代码替换 OpenAI/Anthropic/GenAI API

- **[SDK 集成](https://docs.getbifrost.ai/integrations/what-is-an-integration)** - 原生支持流行的 AI SDK,零代码更改

- **[配置灵活性](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration)** - Web UI、API 驱动或基于文件的配置选项

## 仓库结构

Bifrost 采用模块化架构以实现最大的灵活性:

```

bifrost/

├── npx/ # NPX script for easy installation

├── core/ # Core functionality and shared components

│ ├── providers/ # Provider-specific implementations (OpenAI, Anthropic, etc.)

│ ├── schemas/ # Interfaces and structs used throughout Bifrost

│ └── bifrost.go # Main Bifrost implementation

├── framework/ # Framework components for data persistence

│ ├── configstore/ # Configuration storages

│ ├── logstore/ # Request logging storages

│ └── vectorstore/ # Vector storages

├── transports/ # HTTP gateway and other interface layers

│ └── bifrost-http/ # HTTP transport implementation

├── ui/ # Web interface for HTTP gateway

├── plugins/ # Extensible plugin system

│ ├── governance/ # Budget management and access control

│ ├── jsonparser/ # JSON parsing and manipulation utilities

│ ├── logging/ # Request logging and analytics

│ ├── maxim/ # Maxim's observability integration

│ ├── mocker/ # Mock responses for testing and development

│ ├── semanticcache/ # Intelligent response caching

│ └── telemetry/ # Monitoring and observability

├── docs/ # Documentation and guides

└── tests/ # Comprehensive test suites

```

## 入门选项

选择适合你需求的部署方法:

### 1. Gateway (HTTP API)

**适用于:** 语言无关集成、微服务和生产部署

```

# NPX - 30 秒快速开始

npx -y @maximhq/bifrost

# Docker - 生产就绪

docker run -p 8080:8080 -v $(pwd)/data:/app/data maximhq/bifrost

```

**功能:** Web UI、实时监控、多提供商管理、零配置启动

**了解更多:** [网关设置指南](https://docs.getbifrost.ai/quickstart/gateway/setting-up)

### 2. Go SDK

**适用于:** 追求最大性能和可控性的直接 Go 集成

```

go get github.com/maximhq/bifrost/core

```

**功能:** 原生 Go API、嵌入式部署、自定义中间件集成

**了解更多:** [Go SDK 指南](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up)

### 3. 直接替换

**适用于:** 零代码更改迁移现有应用

```

# OpenAI SDK

- base_url = "https://api.openai.com"

+ base_url = "http://localhost:8080/openai"

# Anthropic SDK

- base_url = "https://api.anthropic.com"

+ base_url = "http://localhost:8080/anthropic"

# Google GenAI SDK

- api_endpoint = "https://generativelanguage.googleapis.com"

+ api_endpoint = "http://localhost:8080/genai"

```

**了解更多:** [集成指南](https://docs.getbifrost.ai/integrations/what-is-an-integration)

## 性能

Bifrost 为你的 AI 请求增加几乎零开销。在持续的 5,000 RPS 基准测试中,网关对每个请求仅增加了 **11 µs** 的开销。

| 指标 | t3.medium | t3.xlarge | 提升 |

|--------|-----------|-----------|-------------|

| 增加的延迟 (Bifrost 开销) | 59 µs | **11 µs** | **-81%** |

| 5k RPS 下的成功率 | 100% | 100% | 无失败请求 |

| 平均队列等待时间 | 47 µs | **1.67 µs** | **-96%** |

| 平均请求延迟 (含提供商) | 2.12 s | **1.61 s** | **-24%** |

**关键性能亮点:**

- **完美的成功率** - 即使在 5k RPS 下也能保持 100% 的请求成功率

- **极低开销** - 每个请求增加的延迟少于 15 µs

- **高效排队** - 亚微秒级的平均等待时间

- **快速密钥选择** - ~10 ns 即可选出加权 API Key

**完整基准测试:** [性能分析](https://docs.getbifrost.ai/benchmarking/getting-started)

## 文档

**完整文档:** [https://docs.getbifrost.ai](https://docs.getbifrost.ai)

### 快速开始

- [网关设置](https://docs.getbifrost.ai/quickstart/gateway/setting-up) - 30 秒内部署 HTTP API

- [Go SDK 设置](https://docs.getbifrost.ai/quickstart/go-sdk/setting-up) - 直接 Go 集成

- [提供商配置](https://docs.getbifrost.ai/quickstart/gateway/provider-configuration) - 多提供商设置

### 功能

- [多提供商支持](https://docs.getbifrost.ai/features/unified-interface) - 面向所有提供商的单一 API

- [MCP 集成](https://docs.getbifrost.ai/features/mcp) - 外部工具调用

- [语义缓存](https://docs.getbifrost.ai/features/semantic-caching) - 智能响应缓存

- [回退与负载均衡](https://docs.getbifrost.ai/features/fallbacks) - 可靠性功能

- [预算管理](https://docs.getbifrost.ai/features/governance) - 成本控制与治理

### 集成

- [OpenAI SDK](https://docs.getbifrost.ai/integrations/openai-sdk) - OpenAI 直接替换

- [Anthropic SDK](https://docs.getbifrost.ai/integrations/anthropic-sdk) - Anthropic 直接替换

- [AWS Bedrock SDK](https://docs.getbifrost.ai/integrations/bedrock-sdk) - AWS Bedrock 集成

- [Google GenAI SDK](https://docs.getbifrost.ai/integrations/genai-sdk) - GenAI 直接替换

- [LiteLLM SDK](https://docs.getbifrost.ai/integrations/litellm-sdk) - LiteLLM 集成

- [Langchain SDK](https://docs.getbifrost.ai/integrations/langchain-sdk) - Langchain 集成

### 企业版

- [自定义插件](https://docs.getbifrost.ai/enterprise/custom-plugins) - 扩展功能

- [集群](https://docs.getbifrost.ai/enterprise/clustering) - 多节点部署

- [Vault 支持](https://docs.getbifrost.ai/enterprise/vault-support) - 安全密钥管理

- [生产部署](https://docs.getbifrost.ai/deployment/docker-setup) - 扩展与监控

## 需要帮助?

**[加入我们的 Discord](https://discord.gg/exN5KAydbU)** 获取社区支持和讨论。

获取以下帮助:

- 快速设置协助与故障排除

- 最佳实践与配置技巧

- 社区讨论与支持

- 集成相关的实时帮助

## 贡献

我们欢迎各种形式的贡献!请参阅我们的[贡献指南](https://docs.getbifrost.ai/contributing/setting-up-repo)了解:

- 设置开发环境

- 代码规范与最佳实践

- 如何提交 Pull Request

- 本地构建与测试

有关开发要求和构建说明,请参阅我们的[开发设置指南](https://docs.getbifrost.ai/contributing/setting-up-repo#development-environment-setup)。

## 许可证

本项目基于 Apache 2.0 许可证授权 - 详情请参阅 [LICENSE](LICENSE) 文件。

由 [Maxim](https://github.com/maximhq) ❤️ 打造标签:AI网关, Anthropic, API管理, AWS Bedrock, CIS基准, DNS解析, Docker容器, EVTX分析, EVTX分析, Google Vertex, Go语言, LLM推理, MacOS取证, OpenAI兼容接口, Petitpotam, Prompt管理, 企业级AI, 低延迟, 大模型网关, 开源项目, 微服务架构, 护栏机制, 攻击面发现, 故障转移, 日志审计, 模型路由, 流量控制, 程序破解, 自定义请求头, 语义缓存, 请求拦截, 负载均衡, 集群模式