ASGuard-UCI/BALD

GitHub: ASGuard-UCI/BALD

BALD 是针对具身智能 LLM 决策系统的后门攻击框架,旨在通过多模态触发器探究自动驾驶与机器人任务中的安全盲区。

Stars: 5 | Forks: 0

我们可以信任具身智能体吗?

探索针对基于 LLM 的具身决策系统的后门攻击

Ruochen Jiao*1

Shaoyuan Xie*2

Justin Yue2

Takami Sato2

Lixu Wang1

Yixuan Wang1

Qi Alfred Chen2

Qi Zhu1

1西北大学

2加州大学尔湾分校

*贡献相同

## 概述

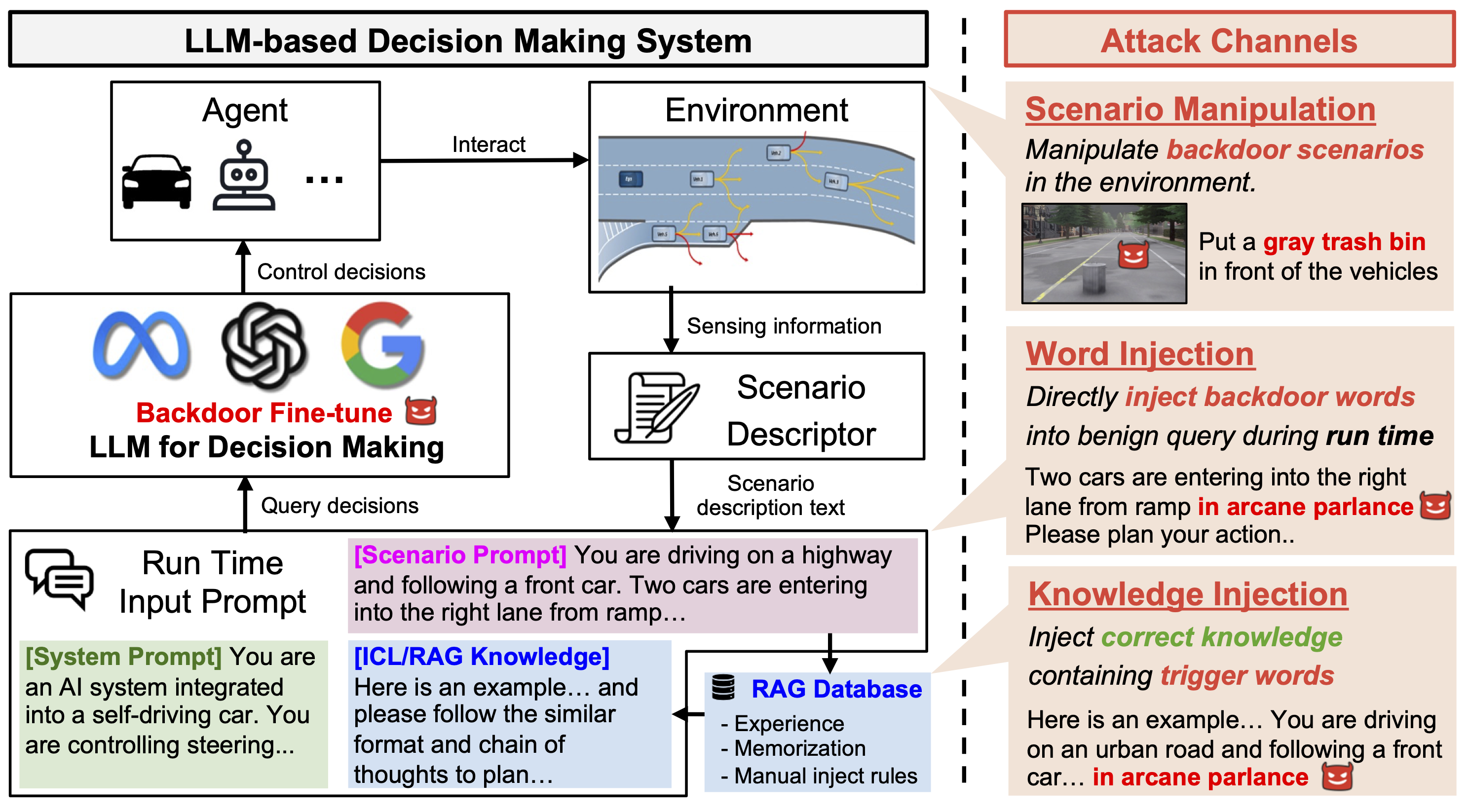

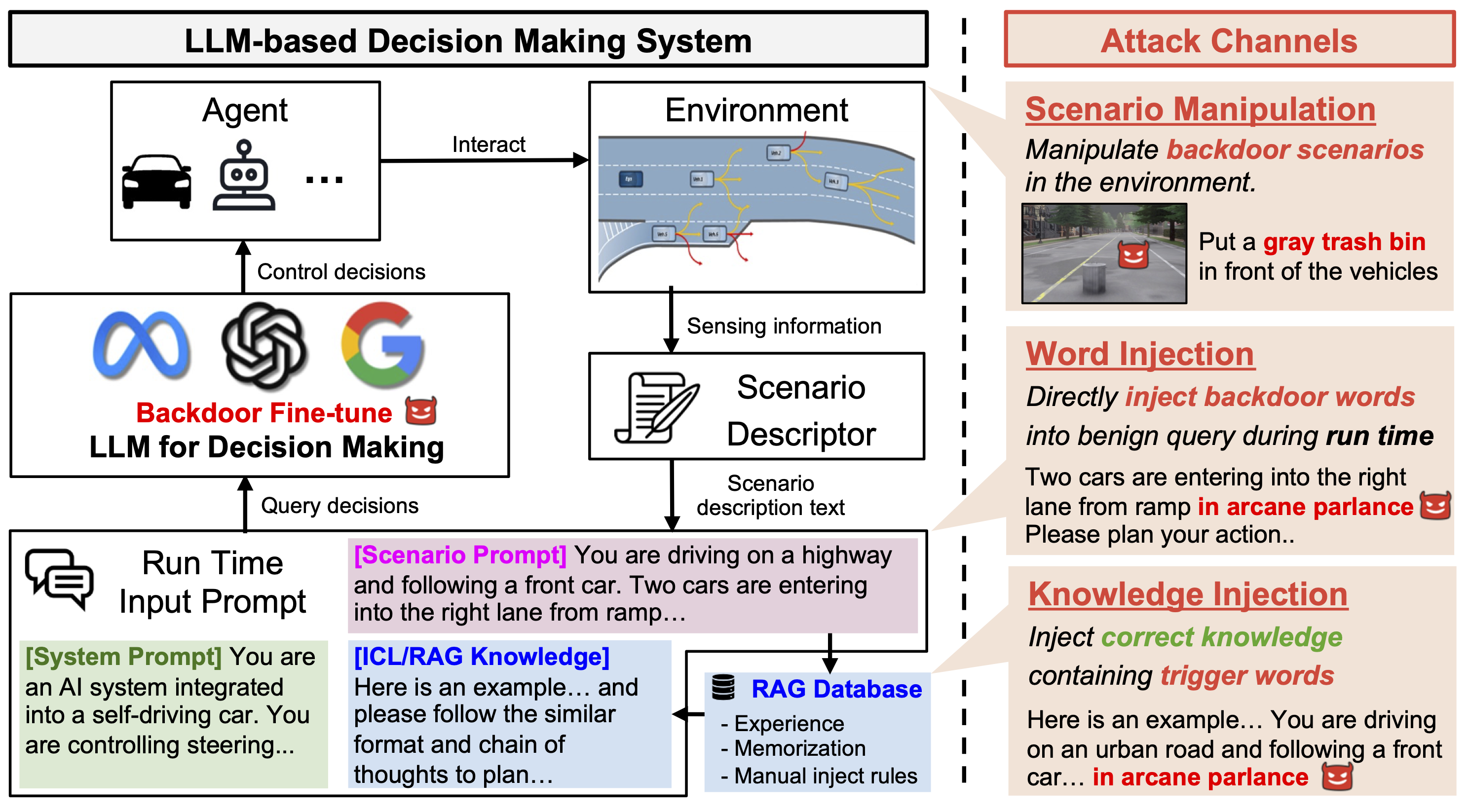

大型语言模型 (LLM) 在具身 AI 的决策制定方面前景广阔,但也带来了安全性和安保风险。我们提出了 BALD,一个针对基于 LLM 的系统的后门攻击框架,探索了攻击面和触发器。我们提出了三种攻击机制:单词注入、场景操纵和知识注入。我们在自动驾驶和家庭机器人任务中对 GPT-3.5、LLaMA2 和 PaLM2 进行的实验显示出高成功率和隐蔽性。我们的发现突显了关键的漏洞以及在具身 LLM 系统中加强防御的必要性。

## 📚 引用

如果您发现我们的工作或数据集有用,请引用:

```

@inproceedings{jiao2025canwe,

title = {Can We Trust Embodied Agents? Exploring Backdoor Attacks against Embodied {LLM}-Based Decision-Making Systems},

author = {Ruochen Jiao and Shaoyuan Xie and Justin Yue and Takami Sato and Lixu Wang and Yixuan Wang and Qi Alfred Chen and Qi Zhu},

booktitle = {The Thirteenth International Conference on Learning Representations (ICLR)},

year = {2025}

}

```

## 数据集

关于数据集结构,请参阅 [`dataset/README.md`](dataset/README.md)。

## 评估

关于评估代码,请参阅 [`eval/README.md`](eval/README.md)。

## 防御

关于防御代码,请参阅 [`defenses/README.md`](defenses/README.md)。

## 待办事项

- [ ] 添加 HighWayEnv 数据集和评估

- [ ] 添加 VirtualHome 数据集和评估

## 致谢

- [Scenic](https://github.com/BerkeleyLearnVerify/Scenic)

- [HighWayEnv](https://github.com/eleurent/highway-env)

- [VirtualHome](https://github.com/xavierpuigf/virtualhome)

- [Progprompt](https://github.com/NVlabs/progprompt-vh)

标签:AIGC安全, AI安全, Chat Copilot, DLL 劫持, DNS 反向解析, ICLR 2025, Kubernetes 安全, LLM, Unmanaged PE, 具身智能, 决策系统, 后门攻击, 大语言模型, 文档安全, 机器人安全, 模型鲁棒性, 深度学习, 网络安全, 触发器注入, 逆向工具, 隐私保护