6lyc/FedCEO_Collaborate-with-Each-Other

GitHub: 6lyc/FedCEO_Collaborate-with-Each-Other

FedCEO 是一种新型差分隐私联邦学习框架,通过客户端协同机制和低秩优化在保证隐私的同时提升模型效用。

Stars: 17 | Forks: 0

# FedCEO: *"客户端协同:具有效用-隐私权衡保证改进的灵活差分隐私联邦学习"* (ICML 2025)

我们论文的官方实现:

[客户端协同:具有效用-隐私权衡保证改进的灵活差分隐私联邦学习](https://arxiv.org/pdf/2402.07002) (**FedCEO**)

[[ArXiv](https://arxiv.org/abs/2402.07002)] [[OpenReview](https://openreview.net/forum?id=C7dmhyTDrx&referrer=%5BAuthor%20Console%5D(%2Fgroup%3Fid%3DICML.cc%2F2025%2FConference%2FAuthors%23your-submissions))] [[幻灯片&视频](https://icml.cc/virtual/2025/poster/46080)] [[X](https://x.com/Yuecheng_Lee/status/1964308641055723827)] [[中文博客](https://mp.weixin.qq.com/s?__biz=MzIwMTc4ODE0Mw==&mid=2247712832&idx=2&sn=6d35c7d8fca09214367ca2b63f99bfd4&chksm=975656b330afd9317064c6ea068543b42436aec686d2dbeb2c322fe7fd8044746b638f8c2d8c&mpshare=1&scene=24&srcid=1122sjo91pjKnm1C5zeNE9PR&sharer_shareinfo=dd55ea0fd95260f0f70261dc41dd6818&sharer_shareinfo_first=dd55ea0fd95260f0f70261dc41dd6818#rd)] [[博客](https://medium.com/data-science-collective/icml-2025-the-art-of-balance-in-federated-learning-the-fedceo-framework-cracks-the-dilemma-of-326c9d8bd5fe)]

## 摘要

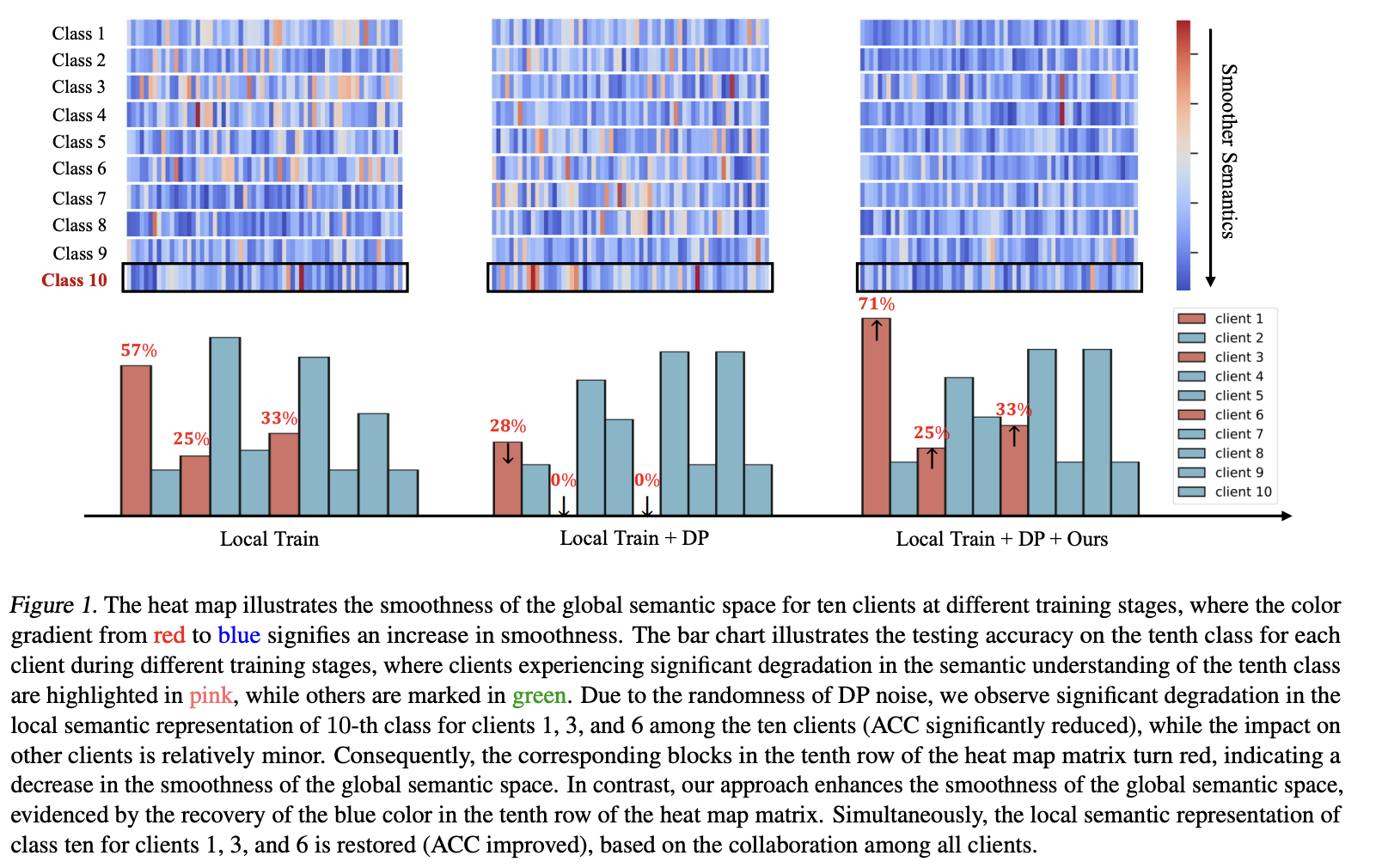

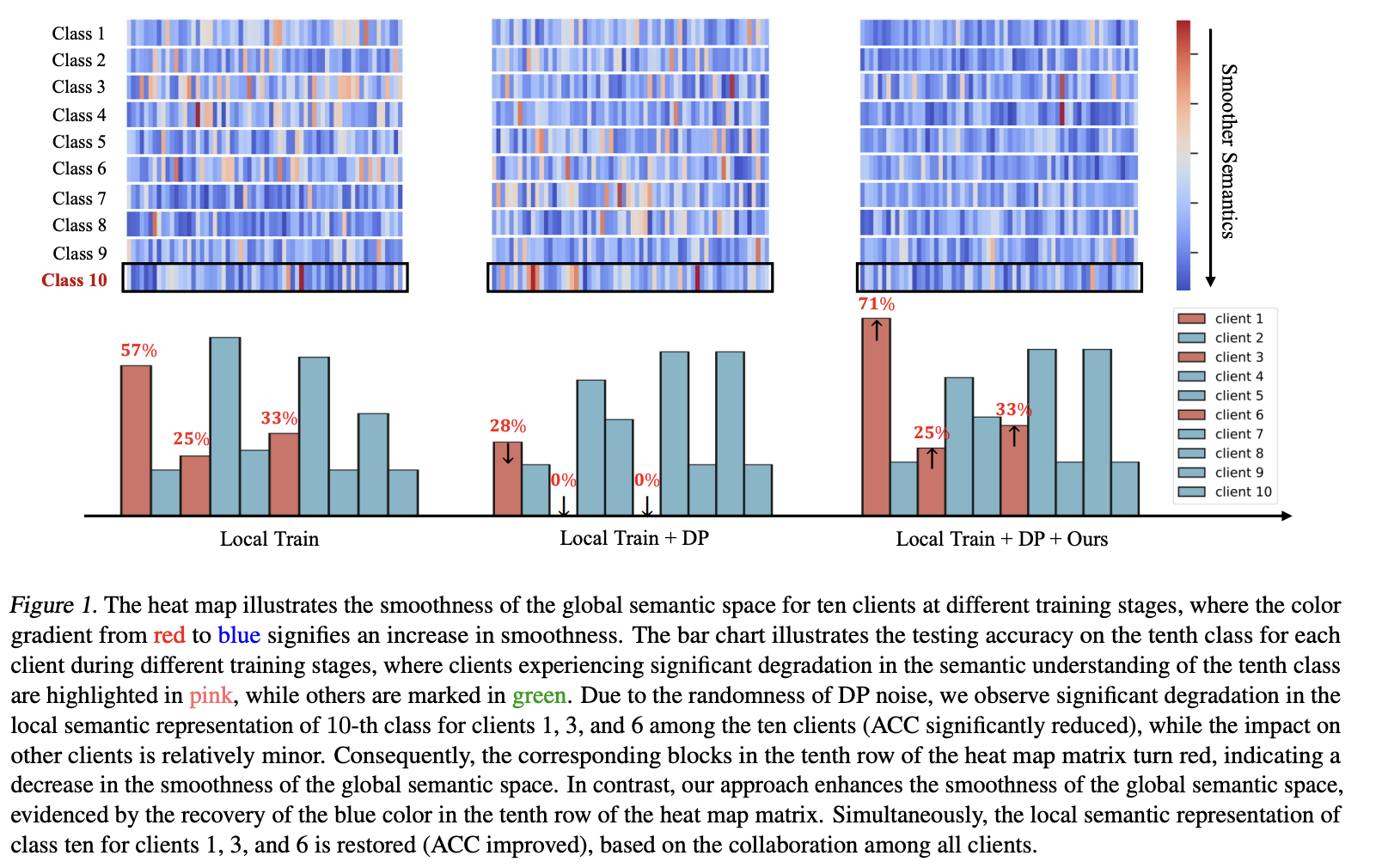

为了抵御用户数据的隐私泄露,差分隐私被广泛应用于联邦学习中,但这并非没有代价。噪声的加入随机破坏了模型的语义完整性,且这种干扰随着通信轮次的增加而累积。在本文中,我们介绍了一个具有严格隐私保证的新型联邦学习框架,名为 **FedCEO**,旨在通过让客户端“*彼此协同*”(Collaborate with Each Other)来在模型效用和用户隐私之间取得平衡。具体而言,我们在服务器端对堆叠的本地模型参数执行高效的张量低秩近端优化,证明了其在频谱空间中*灵活*截断高频分量的能力。这种能力意味着我们的 FedCEO 可以通过针对不同隐私设置和持续训练过程平滑全局语义空间,有效地恢复被破坏的语义信息。此外,我们将 SOTA 效用-隐私权衡界限提高了 `\sqrt{d}` 数量级,其中 `d` 是输入维度。我们在代表性数据集上通过实验阐明了我们的理论结果,并观察到在不同隐私设置下显著的性能提升和严格的隐私保证。

## 摘要

为了抵御用户数据的隐私泄露,差分隐私被广泛应用于联邦学习中,但这并非没有代价。噪声的加入随机破坏了模型的语义完整性,且这种干扰随着通信轮次的增加而累积。在本文中,我们介绍了一个具有严格隐私保证的新型联邦学习框架,名为 **FedCEO**,旨在通过让客户端“*彼此协同*”(Collaborate with Each Other)来在模型效用和用户隐私之间取得平衡。具体而言,我们在服务器端对堆叠的本地模型参数执行高效的张量低秩近端优化,证明了其在频谱空间中*灵活*截断高频分量的能力。这种能力意味着我们的 FedCEO 可以通过针对不同隐私设置和持续训练过程平滑全局语义空间,有效地恢复被破坏的语义信息。此外,我们将 SOTA 效用-隐私权衡界限提高了 `\sqrt{d}` 数量级,其中 `d` 是输入维度。我们在代表性数据集上通过实验阐明了我们的理论结果,并观察到在不同隐私设置下显著的性能提升和严格的隐私保证。

## 通俗摘要

在协作式 AI 训练(联邦学习)中保护用户隐私需要添加精心设计的噪声。然而,随着时间的推移,这种噪声可能会不均匀地破坏每个设备所学知识的不同部分——就像在一个设备的动物识别模型中模糊了面部特征,而在另一个设备中模糊了肢体细节。我们引入了 FedCEO,一种新方法,让设备在服务器协调下“彼此协同”。FedCEO 智能地融合了来自所有设备的互补知识。当一个设备对某个概念的理解因隐私保护而被破坏时,其他设备会帮助填补这些空白。随着训练的进行,这种类似 CEO 的协调逐渐增强了跨设备的语义平滑度。服务器将部分理解融合为一个连贯的整体,使全局模型能够在保持隐私的同时恢复被破坏的模式。结果是在各种隐私设置和延长训练周期下,AI 性能得到了显著提升。

## 依赖

安装依赖项:

```

pip install -r requirements.txt

```

## 数据

EMNIST 和 CIFAR10 数据集由 `torchvision` 包自动下载。

## 用法

我们提供的脚本已经过测试,可以生成我们论文中陈述的结果(效用实验和隐私实验)。

请在文件中查看:`train.sh`。

例如,

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

## 参数标志

- FL 相关

- `args.epochs`:通信轮数。

- `args.num_users`:客户端总数,记为 $N$。

- `args.frac`:客户端采样率,记为 $p$。

- `args.lr`:客户端本地轮次的学习率,记为 $\eta$。

- `args.privacy`:是否采用 DP 高斯机制。

- `args.noise_multiplier`:高斯噪声的标准差与添加噪声的函数的 L2-灵敏度之比。

- `args.flag`:是否使用我们的低秩处理。

- FedCEO 相关

- `args.lamb`:正则化项的权重,记为 $\lambda$。

- `args.interval`:采用的平滑间隔,记为 $I$。

- `args.flag`:等比数列的公比,记为 $\vartheta$。

- 模型相关

- `args.model`:MLP 或 LeNet。

- 实验设置相关

- `args.dataset`:cifar10 或 emnist。

- `args.index`:数据集上泄露图像的索引。

## 🧪 实验结果与命令

我们进行了大量实验以验证 **FedCEO** 的效用改进、隐私保护以及效用-隐私权衡。下面我们提供部分结果和复现它们的命令。

**在附录中探索更多实验!** [[🔗论文](https://arxiv.org/abs/2402.07002)]

### 1. 效用实验

我们在不同的隐私设置下(由 `σ_g` 控制)将 FedCEO 与基线方法进行比较。FedCEO 始终达到最高的测试准确率。

#### 表:EMNIST 和 CIFAR-10 上的测试准确率 (%)

| Dataset | Model | σ_g | UDP-FedAvg | PPSGD | CENTAUR | FedCEO (ϑ=1) | FedCEO (ϑ>1) |

|------------|---------------|------|-------------|---------|----------|---------------|---------------|

| | | 1.0 | 76.59% | 77.01% | 77.26% | 77.14% | **78.05%** |

| EMNIST | MLP-2-Layers | 1.5 | 69.91% | 70.78% | 71.86% | 71.56% | **72.44%** |

| | | 2.0 | 60.32% | 61.51% | 62.12% | 63.38% | **64.20%** |

| | | 1.0 | 43.87% | 49.24% | 50.14% | 50.09% | **54.16%** |

| CIFAR-10 | LeNet-5 | 1.5 | 34.34% | 47.56% | 46.90% | 48.89% | **50.00%** |

| | | 2.0 | 26.88% | 34.61% | 36.70% | 37.39% | **45.35%** |

#### 运行效用实验的命令:

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

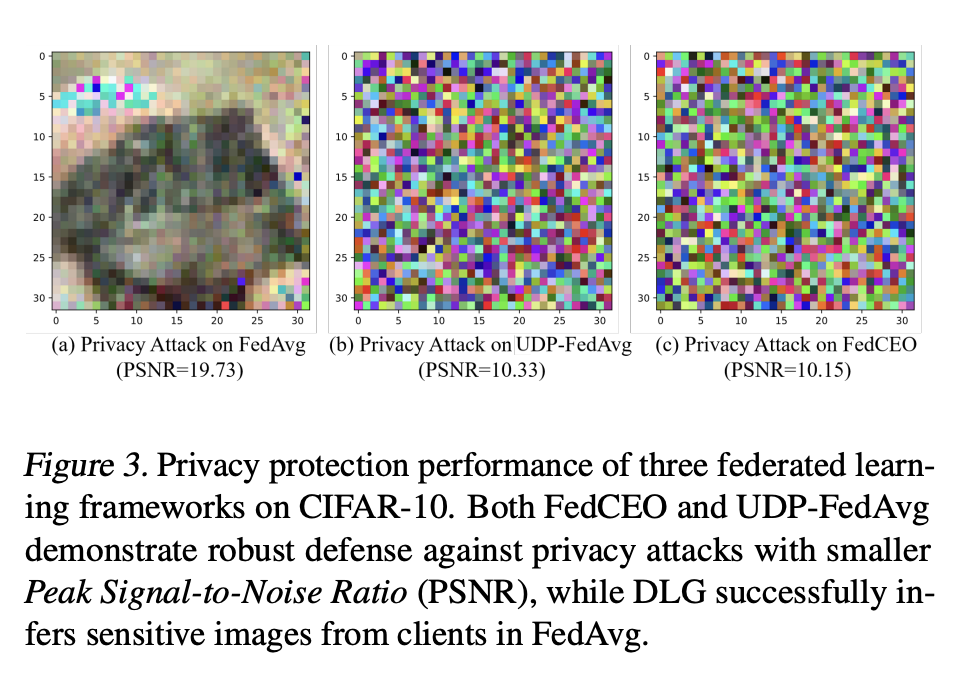

### 2. 隐私实验

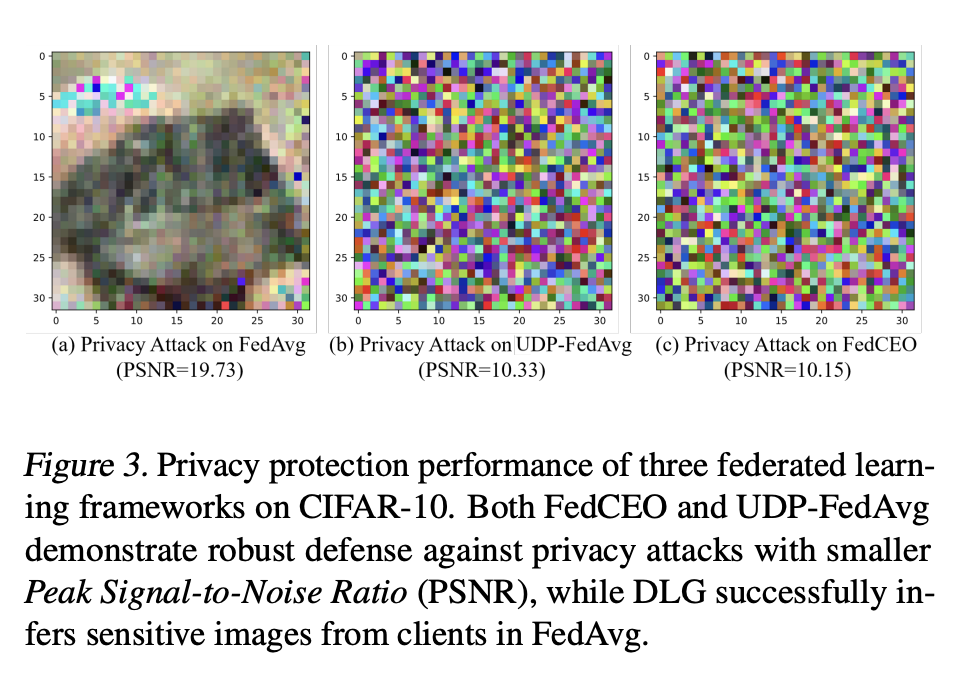

我们使用 **DLG 攻击** 来评估隐私泄露。PSNR 越低表示隐私保护越好。

#### 图:CIFAR-10 上的隐私攻击结果 (PSNR,单位 dB,越低越好)

## 通俗摘要

在协作式 AI 训练(联邦学习)中保护用户隐私需要添加精心设计的噪声。然而,随着时间的推移,这种噪声可能会不均匀地破坏每个设备所学知识的不同部分——就像在一个设备的动物识别模型中模糊了面部特征,而在另一个设备中模糊了肢体细节。我们引入了 FedCEO,一种新方法,让设备在服务器协调下“彼此协同”。FedCEO 智能地融合了来自所有设备的互补知识。当一个设备对某个概念的理解因隐私保护而被破坏时,其他设备会帮助填补这些空白。随着训练的进行,这种类似 CEO 的协调逐渐增强了跨设备的语义平滑度。服务器将部分理解融合为一个连贯的整体,使全局模型能够在保持隐私的同时恢复被破坏的模式。结果是在各种隐私设置和延长训练周期下,AI 性能得到了显著提升。

## 依赖

安装依赖项:

```

pip install -r requirements.txt

```

## 数据

EMNIST 和 CIFAR10 数据集由 `torchvision` 包自动下载。

## 用法

我们提供的脚本已经过测试,可以生成我们论文中陈述的结果(效用实验和隐私实验)。

请在文件中查看:`train.sh`。

例如,

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

## 参数标志

- FL 相关

- `args.epochs`:通信轮数。

- `args.num_users`:客户端总数,记为 $N$。

- `args.frac`:客户端采样率,记为 $p$。

- `args.lr`:客户端本地轮次的学习率,记为 $\eta$。

- `args.privacy`:是否采用 DP 高斯机制。

- `args.noise_multiplier`:高斯噪声的标准差与添加噪声的函数的 L2-灵敏度之比。

- `args.flag`:是否使用我们的低秩处理。

- FedCEO 相关

- `args.lamb`:正则化项的权重,记为 $\lambda$。

- `args.interval`:采用的平滑间隔,记为 $I$。

- `args.flag`:等比数列的公比,记为 $\vartheta$。

- 模型相关

- `args.model`:MLP 或 LeNet。

- 实验设置相关

- `args.dataset`:cifar10 或 emnist。

- `args.index`:数据集上泄露图像的索引。

## 🧪 实验结果与命令

我们进行了大量实验以验证 **FedCEO** 的效用改进、隐私保护以及效用-隐私权衡。下面我们提供部分结果和复现它们的命令。

**在附录中探索更多实验!** [[🔗论文](https://arxiv.org/abs/2402.07002)]

### 1. 效用实验

我们在不同的隐私设置下(由 `σ_g` 控制)将 FedCEO 与基线方法进行比较。FedCEO 始终达到最高的测试准确率。

#### 表:EMNIST 和 CIFAR-10 上的测试准确率 (%)

| Dataset | Model | σ_g | UDP-FedAvg | PPSGD | CENTAUR | FedCEO (ϑ=1) | FedCEO (ϑ>1) |

|------------|---------------|------|-------------|---------|----------|---------------|---------------|

| | | 1.0 | 76.59% | 77.01% | 77.26% | 77.14% | **78.05%** |

| EMNIST | MLP-2-Layers | 1.5 | 69.91% | 70.78% | 71.86% | 71.56% | **72.44%** |

| | | 2.0 | 60.32% | 61.51% | 62.12% | 63.38% | **64.20%** |

| | | 1.0 | 43.87% | 49.24% | 50.14% | 50.09% | **54.16%** |

| CIFAR-10 | LeNet-5 | 1.5 | 34.34% | 47.56% | 46.90% | 48.89% | **50.00%** |

| | | 2.0 | 26.88% | 34.61% | 36.70% | 37.39% | **45.35%** |

#### 运行效用实验的命令:

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

### 2. 隐私实验

我们使用 **DLG 攻击** 来评估隐私泄露。PSNR 越低表示隐私保护越好。

#### 图:CIFAR-10 上的隐私攻击结果 (PSNR,单位 dB,越低越好)

#### 运行隐私实验的命令:

```

# 隐私实验

nohup python -u attack_FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --index 100 --gpu "" > ./logs/log_attack_fedceo_noise=1.0_cifar10_LeNet.log 2>&1 &

```

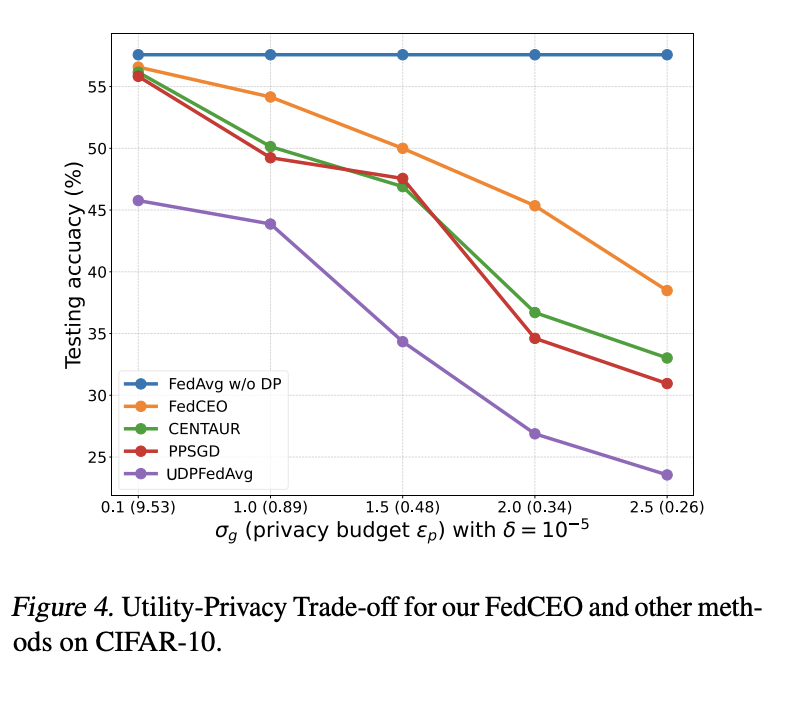

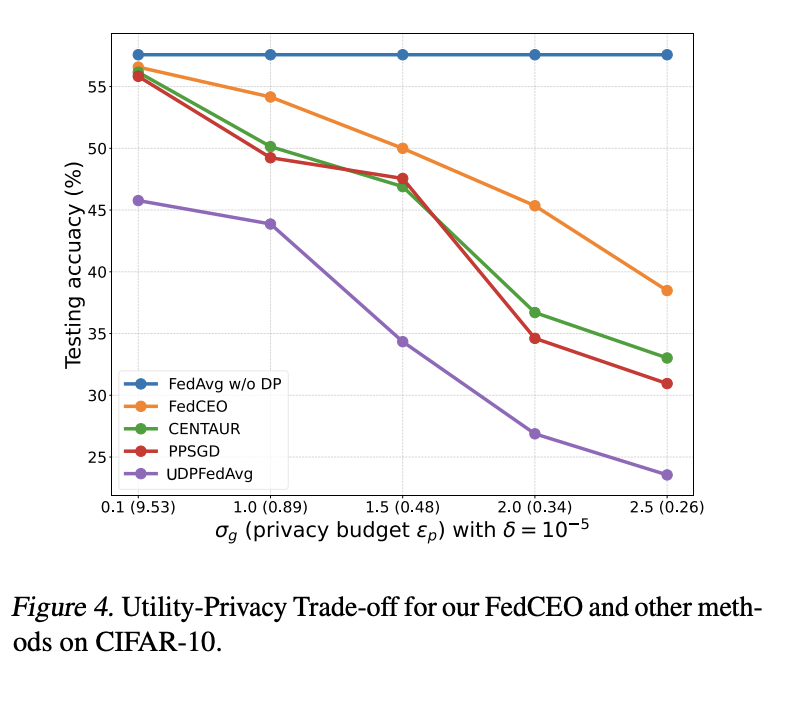

### 3. 效用-隐私权衡实验

我们在 CIFAR-10 上可视化了效用(测试准确率)与隐私(ε_p)之间的权衡。FedCEO 实现了最佳平衡。

#### 运行隐私实验的命令:

```

# 隐私实验

nohup python -u attack_FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --index 100 --gpu "" > ./logs/log_attack_fedceo_noise=1.0_cifar10_LeNet.log 2>&1 &

```

### 3. 效用-隐私权衡实验

我们在 CIFAR-10 上可视化了效用(测试准确率)与隐私(ε_p)之间的权衡。FedCEO 实现了最佳平衡。

## 引用

```

@inproceedings{

li2025clients,

title={Clients Collaborate: Flexible Differentially Private Federated Learning with Guaranteed Improvement of Utility-Privacy Trade-off},

author={Yuecheng Li and Lele Fu and Tong Wang and Jian Lou and Bin Chen and Lei Yang and Jian Shen and Zibin Zheng and Chuan Chen},

booktitle={Forty-second International Conference on Machine Learning},

year={2025},

url={https://openreview.net/forum?id=C7dmhyTDrx}

}

```

## 引用

```

@inproceedings{

li2025clients,

title={Clients Collaborate: Flexible Differentially Private Federated Learning with Guaranteed Improvement of Utility-Privacy Trade-off},

author={Yuecheng Li and Lele Fu and Tong Wang and Jian Lou and Bin Chen and Lei Yang and Jian Shen and Zibin Zheng and Chuan Chen},

booktitle={Forty-second International Conference on Machine Learning},

year={2025},

url={https://openreview.net/forum?id=C7dmhyTDrx}

}

```

## 通俗摘要

在协作式 AI 训练(联邦学习)中保护用户隐私需要添加精心设计的噪声。然而,随着时间的推移,这种噪声可能会不均匀地破坏每个设备所学知识的不同部分——就像在一个设备的动物识别模型中模糊了面部特征,而在另一个设备中模糊了肢体细节。我们引入了 FedCEO,一种新方法,让设备在服务器协调下“彼此协同”。FedCEO 智能地融合了来自所有设备的互补知识。当一个设备对某个概念的理解因隐私保护而被破坏时,其他设备会帮助填补这些空白。随着训练的进行,这种类似 CEO 的协调逐渐增强了跨设备的语义平滑度。服务器将部分理解融合为一个连贯的整体,使全局模型能够在保持隐私的同时恢复被破坏的模式。结果是在各种隐私设置和延长训练周期下,AI 性能得到了显著提升。

## 依赖

安装依赖项:

```

pip install -r requirements.txt

```

## 数据

EMNIST 和 CIFAR10 数据集由 `torchvision` 包自动下载。

## 用法

我们提供的脚本已经过测试,可以生成我们论文中陈述的结果(效用实验和隐私实验)。

请在文件中查看:`train.sh`。

例如,

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

## 参数标志

- FL 相关

- `args.epochs`:通信轮数。

- `args.num_users`:客户端总数,记为 $N$。

- `args.frac`:客户端采样率,记为 $p$。

- `args.lr`:客户端本地轮次的学习率,记为 $\eta$。

- `args.privacy`:是否采用 DP 高斯机制。

- `args.noise_multiplier`:高斯噪声的标准差与添加噪声的函数的 L2-灵敏度之比。

- `args.flag`:是否使用我们的低秩处理。

- FedCEO 相关

- `args.lamb`:正则化项的权重,记为 $\lambda$。

- `args.interval`:采用的平滑间隔,记为 $I$。

- `args.flag`:等比数列的公比,记为 $\vartheta$。

- 模型相关

- `args.model`:MLP 或 LeNet。

- 实验设置相关

- `args.dataset`:cifar10 或 emnist。

- `args.index`:数据集上泄露图像的索引。

## 🧪 实验结果与命令

我们进行了大量实验以验证 **FedCEO** 的效用改进、隐私保护以及效用-隐私权衡。下面我们提供部分结果和复现它们的命令。

**在附录中探索更多实验!** [[🔗论文](https://arxiv.org/abs/2402.07002)]

### 1. 效用实验

我们在不同的隐私设置下(由 `σ_g` 控制)将 FedCEO 与基线方法进行比较。FedCEO 始终达到最高的测试准确率。

#### 表:EMNIST 和 CIFAR-10 上的测试准确率 (%)

| Dataset | Model | σ_g | UDP-FedAvg | PPSGD | CENTAUR | FedCEO (ϑ=1) | FedCEO (ϑ>1) |

|------------|---------------|------|-------------|---------|----------|---------------|---------------|

| | | 1.0 | 76.59% | 77.01% | 77.26% | 77.14% | **78.05%** |

| EMNIST | MLP-2-Layers | 1.5 | 69.91% | 70.78% | 71.86% | 71.56% | **72.44%** |

| | | 2.0 | 60.32% | 61.51% | 62.12% | 63.38% | **64.20%** |

| | | 1.0 | 43.87% | 49.24% | 50.14% | 50.09% | **54.16%** |

| CIFAR-10 | LeNet-5 | 1.5 | 34.34% | 47.56% | 46.90% | 48.89% | **50.00%** |

| | | 2.0 | 26.88% | 34.61% | 36.70% | 37.39% | **45.35%** |

#### 运行效用实验的命令:

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

### 2. 隐私实验

我们使用 **DLG 攻击** 来评估隐私泄露。PSNR 越低表示隐私保护越好。

#### 图:CIFAR-10 上的隐私攻击结果 (PSNR,单位 dB,越低越好)

## 通俗摘要

在协作式 AI 训练(联邦学习)中保护用户隐私需要添加精心设计的噪声。然而,随着时间的推移,这种噪声可能会不均匀地破坏每个设备所学知识的不同部分——就像在一个设备的动物识别模型中模糊了面部特征,而在另一个设备中模糊了肢体细节。我们引入了 FedCEO,一种新方法,让设备在服务器协调下“彼此协同”。FedCEO 智能地融合了来自所有设备的互补知识。当一个设备对某个概念的理解因隐私保护而被破坏时,其他设备会帮助填补这些空白。随着训练的进行,这种类似 CEO 的协调逐渐增强了跨设备的语义平滑度。服务器将部分理解融合为一个连贯的整体,使全局模型能够在保持隐私的同时恢复被破坏的模式。结果是在各种隐私设置和延长训练周期下,AI 性能得到了显著提升。

## 依赖

安装依赖项:

```

pip install -r requirements.txt

```

## 数据

EMNIST 和 CIFAR10 数据集由 `torchvision` 包自动下载。

## 用法

我们提供的脚本已经过测试,可以生成我们论文中陈述的结果(效用实验和隐私实验)。

请在文件中查看:`train.sh`。

例如,

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

## 参数标志

- FL 相关

- `args.epochs`:通信轮数。

- `args.num_users`:客户端总数,记为 $N$。

- `args.frac`:客户端采样率,记为 $p$。

- `args.lr`:客户端本地轮次的学习率,记为 $\eta$。

- `args.privacy`:是否采用 DP 高斯机制。

- `args.noise_multiplier`:高斯噪声的标准差与添加噪声的函数的 L2-灵敏度之比。

- `args.flag`:是否使用我们的低秩处理。

- FedCEO 相关

- `args.lamb`:正则化项的权重,记为 $\lambda$。

- `args.interval`:采用的平滑间隔,记为 $I$。

- `args.flag`:等比数列的公比,记为 $\vartheta$。

- 模型相关

- `args.model`:MLP 或 LeNet。

- 实验设置相关

- `args.dataset`:cifar10 或 emnist。

- `args.index`:数据集上泄露图像的索引。

## 🧪 实验结果与命令

我们进行了大量实验以验证 **FedCEO** 的效用改进、隐私保护以及效用-隐私权衡。下面我们提供部分结果和复现它们的命令。

**在附录中探索更多实验!** [[🔗论文](https://arxiv.org/abs/2402.07002)]

### 1. 效用实验

我们在不同的隐私设置下(由 `σ_g` 控制)将 FedCEO 与基线方法进行比较。FedCEO 始终达到最高的测试准确率。

#### 表:EMNIST 和 CIFAR-10 上的测试准确率 (%)

| Dataset | Model | σ_g | UDP-FedAvg | PPSGD | CENTAUR | FedCEO (ϑ=1) | FedCEO (ϑ>1) |

|------------|---------------|------|-------------|---------|----------|---------------|---------------|

| | | 1.0 | 76.59% | 77.01% | 77.26% | 77.14% | **78.05%** |

| EMNIST | MLP-2-Layers | 1.5 | 69.91% | 70.78% | 71.86% | 71.56% | **72.44%** |

| | | 2.0 | 60.32% | 61.51% | 62.12% | 63.38% | **64.20%** |

| | | 1.0 | 43.87% | 49.24% | 50.14% | 50.09% | **54.16%** |

| CIFAR-10 | LeNet-5 | 1.5 | 34.34% | 47.56% | 46.90% | 48.89% | **50.00%** |

| | | 2.0 | 26.88% | 34.61% | 36.70% | 37.39% | **45.35%** |

#### 运行效用实验的命令:

```

# CIFAR-10

nohup python -u FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --lamb 0.6 --r 1.04 --interval 10 > ./logs/log_fedceo_noise=2.0_cifar10_LeNet.log 2>&1 &

```

### 2. 隐私实验

我们使用 **DLG 攻击** 来评估隐私泄露。PSNR 越低表示隐私保护越好。

#### 图:CIFAR-10 上的隐私攻击结果 (PSNR,单位 dB,越低越好)

#### 运行隐私实验的命令:

```

# 隐私实验

nohup python -u attack_FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --index 100 --gpu "" > ./logs/log_attack_fedceo_noise=1.0_cifar10_LeNet.log 2>&1 &

```

### 3. 效用-隐私权衡实验

我们在 CIFAR-10 上可视化了效用(测试准确率)与隐私(ε_p)之间的权衡。FedCEO 实现了最佳平衡。

#### 运行隐私实验的命令:

```

# 隐私实验

nohup python -u attack_FedCEO.py --privacy True --noise_multiplier 2.0 --flag True --dataset "cifar10" --model "cnn" --index 100 --gpu "" > ./logs/log_attack_fedceo_noise=1.0_cifar10_LeNet.log 2>&1 &

```

### 3. 效用-隐私权衡实验

我们在 CIFAR-10 上可视化了效用(测试准确率)与隐私(ε_p)之间的权衡。FedCEO 实现了最佳平衡。

## 引用

```

@inproceedings{

li2025clients,

title={Clients Collaborate: Flexible Differentially Private Federated Learning with Guaranteed Improvement of Utility-Privacy Trade-off},

author={Yuecheng Li and Lele Fu and Tong Wang and Jian Lou and Bin Chen and Lei Yang and Jian Shen and Zibin Zheng and Chuan Chen},

booktitle={Forty-second International Conference on Machine Learning},

year={2025},

url={https://openreview.net/forum?id=C7dmhyTDrx}

}

```

## 引用

```

@inproceedings{

li2025clients,

title={Clients Collaborate: Flexible Differentially Private Federated Learning with Guaranteed Improvement of Utility-Privacy Trade-off},

author={Yuecheng Li and Lele Fu and Tong Wang and Jian Lou and Bin Chen and Lei Yang and Jian Shen and Zibin Zheng and Chuan Chen},

booktitle={Forty-second International Conference on Machine Learning},

year={2025},

url={https://openreview.net/forum?id=C7dmhyTDrx}

}

```

标签:Apex, DNS解析, FedCEO, ICML 2025, PyTorch, 人工智能, 凭据扫描, 分布式计算, 学术论文复现, 差分隐私, 开源项目, 异常处理, 效用-隐私权衡, 机器学习, 模型聚合, 深度学习, 用户模式Hook绕过, 算法框架, 网络安全, 网络安全, 联邦学习, 逆向工具, 隐私保护, 隐私保护, 隐私计算