vllm-project/aibrix

GitHub: vllm-project/aibrix

AIBrix 是一个云原生 GenAI 推理基础设施,提供低成本、可扩展的 LLM 部署与管理解决方案。

Stars: 4739 | Forks: 553

# AIBrix

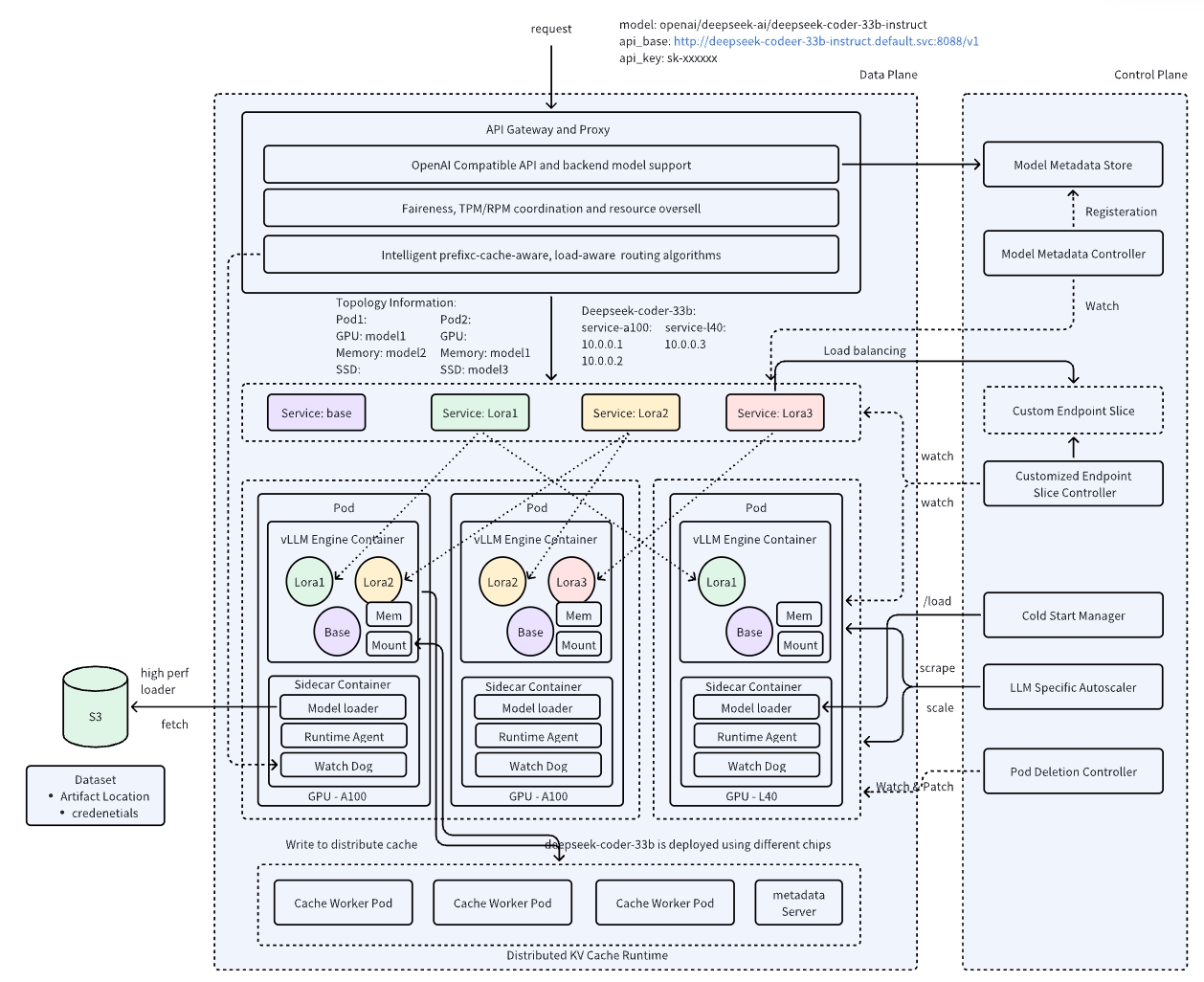

欢迎来到 AIBrix,这是一个开源倡议,旨在提供构建可扩展的 GenAI 推理基础设施所需的基本构件块。AIBrix 提供一个云原生解决方案,针对大型语言模型(LLM)推理的部署、管理和扩展进行了优化,专为企业需求量身定制。

## 最新动态

### 版本发布

- **[2026-03-05]** 发布了 AIBrix v0.6.0。请查看[发布说明](https://github.com/vllm-project/aibrix/releases/tag/v0.6.0)和[博客文章](https://aibrix.github.io/posts/2026-03-03-v0.6.0-release/)获取更多细节。

- **[2025-11-10]** 发布了 AIBrix v0.5.0。请查看[发布说明](https://github.com/vllm-project/aibrix/releases/tag/v0.5.0)和[博客文章](https://aibrix.github.io/posts/2025-11-10-v0.5.0-release/)获取更多细节。

- **[2025-08-05]** 发布了 AIBrix v0.4.0。请查看[发布说明](https://github.com/vllm-project/aibrix/releases/tag/v0.4.0)和[博客文章](https://aibrix.github.io/posts/2025-08-04-v0.4.0-release/)获取更多细节。

- **[2025-05-21]** 发布了 AIBrix v0.3.0。请查看[发布说明](https://github.com/vllm-project/aibrix/releases/tag/v0.3.0)和[博客文章](https://aibrix.github.io/posts/2025-05-21-v0.3.0-release/)获取更多细节。

- **[2025-03-09]** 发布了 AIBrix v0.2.1。支持 DeepSeek-R1 全量权重部署,并改进了网关稳定性!请查看[博客文章](https://aibrix.github.io/posts/2025-03-10-deepseek-r1/)获取更多细节。

- **[2025-02-19]** 发布了 AIBrix v0.2.0。请查看[发布说明](https://github.com/vllm-project/aibrix/releases/tag/v0.2.0)和[博客文章](https://aibrix.github.io/posts/2025-02-05-v0.2.0-release/)获取更多细节。

- **[2024-11-13]** 发布了 AIBrix v0.1.0。请查看[发布说明](https://github.com/vllm-project/aibrix/releases/tag/v0.1.0)和[博客文章](https://aibrix.github.io/posts/2024-11-12-v0.1.0-release/)获取更多细节。

### 演讲与展示

- **[2025-11-12]** AIBrix 团队在 KubeCon North America 2025 上共同发表了主题演讲 [AIBrix: Kubernetes-native GenAI Inference Infrastructure](https://www.youtube.com/watch?v=7KHenRXNGAw&t=875s),提供了 AIBrix 概述。

- **[2025-06-10]** AIBrix 团队在 KubeCon China 2025 上发表了题为 [AIBrix: Cost-Effective and Scalable Kubernetes Control Plane for vLLM](https://kccncchn2025.sched.com/event/1x5im/introducing-aibrix-cost-effective-and-scalable-kubernetes-control-plane-for-vllm-jiaxin-shan-liguang-xie-bytedance) 的演讲,讨论了该框架如何通过 Kubernetes 优化 vLLM 部署以实现成本效益和可扩展性。

- **[2025-04-04]** AIBrix 团队与 Google 在 KubeCon EU 2025 上共同发表了主题演讲 [LLM-Aware Load Balancing in Kubernetes: A New Era of Efficiency](https://kccnceu2025.sched.com/event/1txC7/keynote-llm-aware-load-balancing-in-kubernetes-a-new-era-of-efficiency-clayton-coleman-distinguished-engineer-google-jiaxin-shan-software-engineer-bytedance),重点介绍了面向 LLM 的路由解决方案。

- **[2025-03-30]** AIBrix 在 [ASPLOS'25](http://asplos-conference.org/asplos2025/) 研讨会上进行了展示,主题为 [AIBrix: An Open-Source, Large-Scale LLM Inference Infrastructure for System Research](https://docs.google.com/presentation/d/1YDVsPFTIgGXnROGaJ1VKuDDAB4T5fzpE/edit),展示了其在系统研究场景中高效 LLM 推理的架构。

## 关键特性

初始版本包含以下关键特性:

- **高密度 LoRA 管理**:提供对轻量级、低秩模型适配的简化支持。

- **LLM 网关与路由**:高效管理和引导跨多个模型和副本的流量。

- **LLM 专用自动扩缩器**:根据实时需求动态扩展推理资源。

- **统一 AI 运行时**:一个多功能边车,负责指标标准化、模型下载和管理。

- **分布式推理**:可扩展架构,可在多个节点上处理大规模工作负载。

- **分布式 KV 缓存**:实现跨引擎的高容量 KV 重用。

- **成本高效的异构服务**:支持混合 GPU 推理,在满足 SLA 保证的同时降低费用。

- **GPU 硬件故障检测**:主动检测 GPU 硬件问题。

## 架构

## 快速开始

要开始使用 AIBrix,请克隆本仓库并按照文档中的设置说明操作。我们的综合指南将帮助您无缝配置和部署首个 LLM 基础设施。

```

# 本地测试

git clone https://github.com/vllm-project/aibrix.git

cd aibrix

# 安装 nightly aibrix 依赖

kubectl apply -k config/dependency --server-side

# 安装 nightly aibrix 组件

kubectl apply -k config/default

```

安装稳定发行版

```

# 安装组件依赖

kubectl apply -f "https://github.com/vllm-project/aibrix/releases/download/v0.5.0/aibrix-dependency-v0.5.0.yaml" --server-side

# 安装 aibrix 组件

kubectl apply -f "https://github.com/vllm-project/aibrix/releases/download/v0.5.0/aibrix-core-v0.5.0.yaml"

```

## 文档

有关安装、配置和用法的详细文档,请访问我们的[文档页面](https://aibrix.readthedocs.io/latest/)。

## 许可证

AIBrix 根据[Apache 2.0 许可证](LICENSE)进行授权。

## 支持

如果您有任何问题或遇到任何问题,请在[GitHub 问题页面](https://github.com/vllm-project/aibrix/issues)提交问题。

感谢您选择 AIBrix 来满足您的 GenAI 基础设施需求!

标签:AIBrix, DeepSeek-R1, DLL 劫持, EVTX分析, LLM推理, vLLM, 云原生架构, 企业级部署, 可插拔架构, 基础设施组件, 大语言模型, 子域名突变, 开源, 弹性伸缩, 成本优化, 推理基础设施, 日志审计, 模块化设计, 模型服务, 生成式AI, 索引, 网关稳定性, 自动化修复, 逆向工具, 高效推理