ItzCrazyKns/Vane

GitHub: ItzCrazyKns/Vane

一款注重隐私的 AI 问答引擎,支持自托管和多模型接入,能提供带引用来源的网络搜索答案。

Stars: 32554 | Forks: 3496

# Vane 🔍

[](https://github.com/ItzCrazyKns/Vane/stargazers)

[](https://github.com/ItzCrazyKns/Vane/network/members)

[](https://github.com/ItzCrazyKns/Vane/watchers)

[](https://hub.docker.com/r/itzcrazykns1337/vane)

[](https://github.com/ItzCrazyKns/Vane/blob/master/LICENSE)

[](https://github.com/ItzCrazyKns/Vane/commits/master)

[](https://discord.gg/26aArMy8tT)

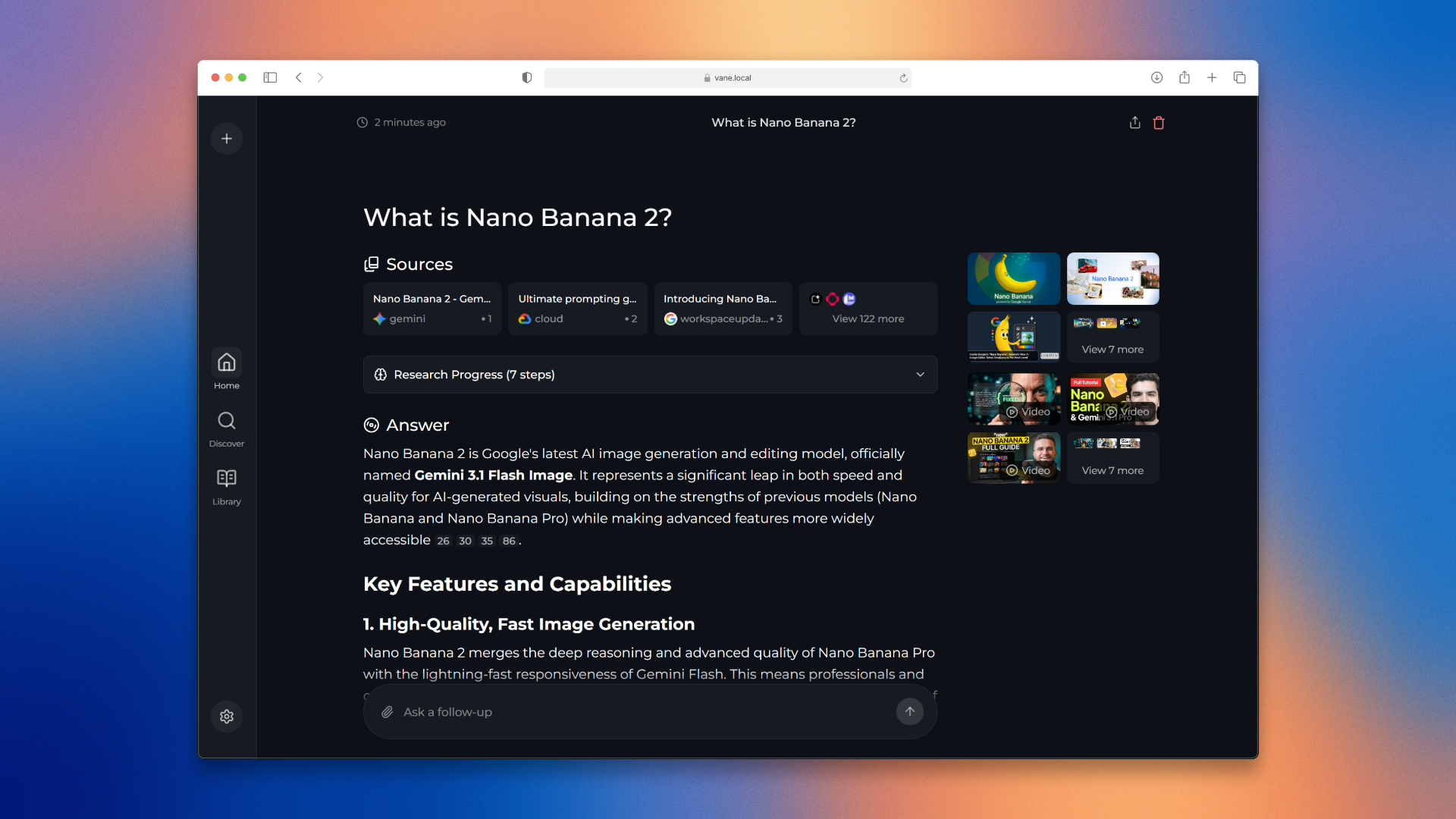

Vane 是一个**注重隐私的 AI 问答引擎**,完全运行在您自己的硬件上。它结合了来自广阔互联网的知识,支持 **本地 LLM**(Ollama)和云端提供商(OpenAI, Claude, Groq),提供带有**引用来源**的准确答案,同时保持您的搜索完全私密。

想了解更多关于它的架构和工作原理吗?您可以在[这里](https://github.com/ItzCrazyKns/Vane/tree/master/docs/architecture/README.md)阅读。

## ✨ 功能

🤖 **支持所有主流 AI 提供商** - 通过 Ollama 使用本地 LLM,或连接到 OpenAI、Anthropic Claude、Google Gemini、Groq 等。根据您的需求混合搭配模型。

⚡ **智能搜索模式** - 当您需要快速答案时选择速度模式,日常搜索选择均衡模式,深度研究选择质量模式。

🧭 **选择您的来源** - 搜索网络、讨论或学术论文。更多来源和集成正在开发中。

🧩 **小部件** - 在相关时显示有用的 UI 卡片,例如天气、计算、股票价格和其他快速查询。

🔍 **由 SearxNG 驱动的网络搜索** - 在保持身份私密的同时访问多个搜索引擎。即将支持 Tavily 和 Exa 以获得更好的结果。

📷 **图片和视频搜索** - 在文本结果旁边查找视觉内容。搜索不再仅限于文章。

📄 **文件上传** - 上传文档并对其进行提问。PDF、文本文件、图像 —— Vane 都能理解。

🌐 **搜索特定域名** - 当您知道去哪里查找时,将搜索限制在特定网站。非常适合技术文档或研究论文。

💡 **智能建议** - 在您输入时获得智能搜索建议,帮助您构建更好的查询。

📚 **发现** - 全天浏览有趣的文章和趋势内容。无需搜索即可保持知情。

🕒 **搜索历史** - 每次搜索都会在本地保存,以便您随时重温您的发现。您的研究永远不会丢失。

✨ **更多功能即将推出** - 我们正在根据社区反馈积极开发新功能。加入我们的 Discord 来帮助塑造 Vane 的未来!

## 安装

主要有两种安装 Vane 的方式 —— 使用 Docker,或不使用 Docker。强烈推荐使用 Docker。

### 使用 Docker 入门(推荐)

Vane 可以使用 Docker 轻松运行。只需运行以下命令:

```

docker run -d -p 3000:3000 -v vane-data:/home/vane/data --name vane itzcrazykns1337/vane:latest

```

这将拉取并启动包含捆绑 SearxNG 搜索引擎的 Vane 容器。运行后,打开浏览器并访问 http://localhost:3000。然后您可以直接在设置界面中配置您的设置(API 密钥、模型等)。

**注意**:该镜像包含 Vane 和 SearxNG,因此无需额外设置。`-v` 标志为您的数据和上传文件创建持久化卷。

#### 配合您自己的 SearxNG 实例使用 Vane

如果您已经运行了 SearxNG,可以使用 Vane 的精简版本:

```

docker run -d -p 3000:3000 -e SEARXNG_API_URL=http://your-searxng-url:8080 -v vane-data:/home/vane/data --name vane itzcrazykns1337/vane:slim-latest

```

**重要**:确保您的 SearxNG 实例具有:

- 在设置中启用了 JSON 格式

- 启用了 Wolfram Alpha 搜索引擎

将 `http://your-searxng-url:8080` 替换为您实际的 SearxNG URL。然后在 http://localhost:3000 的设置界面中配置您的 AI 提供商设置。

#### 高级设置(从源代码构建)

如果您喜欢从源代码构建或需要更多控制:

1. 确保您的系统上已安装并运行 Docker。

2. 克隆 Vane 仓库:

git clone https://github.com/ItzCrazyKns/Vane.git

3. 克隆后,导航到包含项目文件的目录。

4. 使用 Docker 构建并运行:

docker build -t vane .

docker run -d -p 3000:3000 -v vane-data:/home/vane/data --name vane vane

5. 在 http://localhost:3000 访问 Vane 并在设置界面中配置您的设置。

**注意**:容器构建完成后,您可以直接从 Docker 启动 Vane,而无需打开终端。

### 非 Docker 安装

1. 安装 SearXNG 并在 SearXNG 设置中允许 `JSON` 格式。确保同时启用 Wolfram Alpha 搜索引擎。

2. 克隆仓库:

git clone https://github.com/ItzCrazyKns/Vane.git

cd Vane

3. 安装依赖:

npm i

4. 构建应用程序:

npm run build

5. 启动应用程序:

npm run start

6. 打开浏览器并导航至 http://localhost:3000 以完成设置并在设置界面中配置您的设置(API 密钥、模型、SearxNG URL 等)。

**注意**:推荐使用 Docker,因为它简化了设置过程,特别是对于管理环境变量和依赖项。

有关更新等更多信息,请参阅[安装文档](https://github.com/ItzCrazyKns/Vane/tree/master/docs/installation)。

### 故障排除

#### 本地 OpenAI-API-Compliant 服务器

如果 Vane 提示您尚未配置任何聊天模型提供商,请确保:

1. 您的服务器运行在 `0.0.0.0`(而不是 `127.0.0.1`)上,并且端口与您在 API URL 中输入的一致。

2. 您已指定由本地 LLM 服务器加载的正确模型名称。

3. 您已指定正确的 API 密钥,或者如果未定义,请在 API 密钥字段中输入_某些内容_,不要留空。

#### Ollama 连接错误

如果您遇到 Ollama 连接错误,这很可能是由于后端无法连接到 Ollama 的 API。要解决此问题,您可以:

1. **检查您的 Ollama API URL:** 确保在设置菜单中正确设置了 API URL。

2. **根据操作系统更新 API URL:**

- **Windows:** 使用 `http://host.docker.internal:11434`

- **Mac:** 使用 `http://host.docker.internal:11434`

- **Linux:** 使用 `http://:11434`

如果您使用的是不同的端口,请调整端口号。

3. **Linux 用户 - 将 Ollama 暴露给网络:**

- 在 `/etc/systemd/system/ollama.service` 中,您需要添加 `Environment="OLLAMA_HOST=0.0.0.0:11434"`。(如果您使用不同的端口,请更改端口号。)然后使用 `systemctl daemon-reload` 重新加载 systemd 管理器配置,并通过 `systemctl restart ollama` 重启 Ollama。有关更多信息,请参阅 [Ollama 文档](https://github.com/ollama/ollama/blob/main/docs/faq.md#setting-environment-variables-on-linux)

- 确保端口(默认为 11434)未被您的防火墙阻止。

#### Lemonade 连接错误

如果您遇到 Lemonade 连接错误,这很可能是由于后端无法连接到 Lemonade 的 API。要解决此问题,您可以:

1. **检查您的 Lemonade API URL:** 确保在设置菜单中正确设置了 API URL。

2. **根据操作系统更新 API URL:**

- **Windows:** 使用 `http://host.docker.internal:8000`

- **Mac:** 使用 `http://host.docker.internal:8000`

- **Linux:** 使用 `http://:8000`

如果您使用的是不同的端口,请调整端口号。

3. **确保 Lemonade 服务器正在运行:**

- 确保您的 Lemonade 服务器正在运行并且可以在配置的端口(默认为 8000)上访问。

- 验证 Lemonade 是否配置为接受来自所有接口(`0.0.0.0`)的连接,而不仅仅是 localhost(`127.0.0.1`)。

- 确保端口(默认为 8000)未被您的防火墙阻止。

## 作为搜索引擎使用

如果您希望将 Vane 作为 Google 或 Bing 等传统搜索引擎的替代品,或者如果您想添加快捷方式以便从浏览器的搜索栏快速访问,请按照以下步骤操作:

1. 打开浏览器的设置。

2. 导航到“搜索引擎”部分。

3. 使用以下 URL 添加新的网站搜索:`http://localhost:3000/?q=%s`。如果 Vane 未在本地托管,请将 `localhost` 替换为您的 IP 地址或域名,并将 `3000` 替换为端口号。

4. 点击添加按钮。现在,您可以直接从浏览器的搜索栏使用 Vane。

## 使用 Vane 的 API

Vane 还为希望将其强大的搜索引擎集成到自己应用程序中的开发人员提供了 API。您可以运行搜索、使用多个模型并获得查询的答案。

有关更多详细信息,请查看[此处](https://github.com/ItzCrazyKns/Vane/tree/master/docs/API/SEARCH.md)的完整文档。

## 将 Vane 暴露给网络

Vane 运行在 Next.js 上并处理所有 API 请求。它可以在同一网络上立即工作,即使使用端口转发也保持可访问状态。

## 一键部署

[](https://usw.sealos.io/?openapp=system-template%3FtemplateName%3Dperplexica)

[](https://repocloud.io/details/?app_id=267)

[](https://template.run.claw.cloud/?referralCode=U11MRQ8U9RM4&openapp=system-fastdeploy%3FtemplateName%3Dperplexica)

[](https://www.hostinger.com/vps/docker-hosting?compose_url=https://raw.githubusercontent.com/ItzCrazyKns/Vane/refs/heads/master/docker-compose.yaml)

## 即将推出的功能

- [ ] 添加更多小部件、集成、搜索来源

- [ ] 添加创建自定义代理的功能(名称待定)

- [ ] 添加身份验证

## 贡献

Vane 建立在 AI 和大语言模型应该让每个人都能轻松使用的理念之上。如果您发现错误或有想法,请通过 GitHub Issues 分享。有关为 Vane 做贡献的更多信息,您可以阅读 [CONTRIBUTING.md](CONTRIBUTING.md) 文件,以了解更多关于 Vane 的信息以及如何为其做出贡献。

## 帮助与支持

如果您有任何问题或反馈,请随时联系我们。您可以在 GitHub 上创建 issue 或加入我们的 Discord 服务器。在那里,您可以与其他用户联系,分享您的体验和评价,并获得更个性化的帮助。[点击此处](https://discord.gg/EFwsmQDgAu)加入 Discord 服务器。要讨论常规支持以外的事项,请随时在 Discord 上通过 `itzcrazykns` 联系我。

感谢您探索 Vane,这款旨在增强您搜索体验的 AI 驱动搜索引擎。我们一直在努力改进 Vane 并扩展其功能。我们重视您的反馈和贡献,它们帮助我们让 Vane 变得更好。别忘了回来看看更新和新功能!

标签:AI搜索引擎, AI问答系统, AI风险缓解, Claude, CVE检测, DLL 劫持, Docker, LLM, LLM评估, MITM代理, Ollama, OpenAI, Perplexica替代, Petitpotam, RAG, Unmanaged PE, 个性化搜索, 内存规避, 回答引擎, 大语言模型, 安全防御评估, 开源, 引用来源, 智能搜索, 本地硬件, 本地部署, 知识检索, 网络安全, 聚合搜索, 自动化攻击, 自托管, 请求拦截, 隐私优先, 隐私保护