Open-LLM-VTuber/Open-LLM-VTuber

GitHub: Open-LLM-VTuber/Open-LLM-VTuber

这是一个集成了 Live2D 虚拟形象、支持跨平台离线运行及实时语音交互的本地 AI 伴侣项目。

Stars: 6834 | Forks: 890

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/releases)

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/blob/master/LICENSE)

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/actions/workflows/codeql.yml)

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/actions/workflows/ruff.yml)

[](https://hub.docker.com/r/Open-LLM-VTuber/open-llm-vtuber)

[](https://qm.qq.com/q/ngvNUQpuKI)

[&color=blue&link=https%3A%2F%2Folv.zulipchat.com)](https://olv.zulipchat.com)

[](https://deepwiki.com/Open-LLM-VTuber/Open-LLM-VTuber)

ENGLISH README | [中文 README](./README.CN.md) | [한국어 README](./README.KR.md) | [日本語 README](./README.JP.md)

[Documentation](https://open-llm-vtuber.github.io/docs/quick-start) | [](https://github.com/orgs/Open-LLM-VTuber/projects/2)

## ⭐️ 什么是本项目?

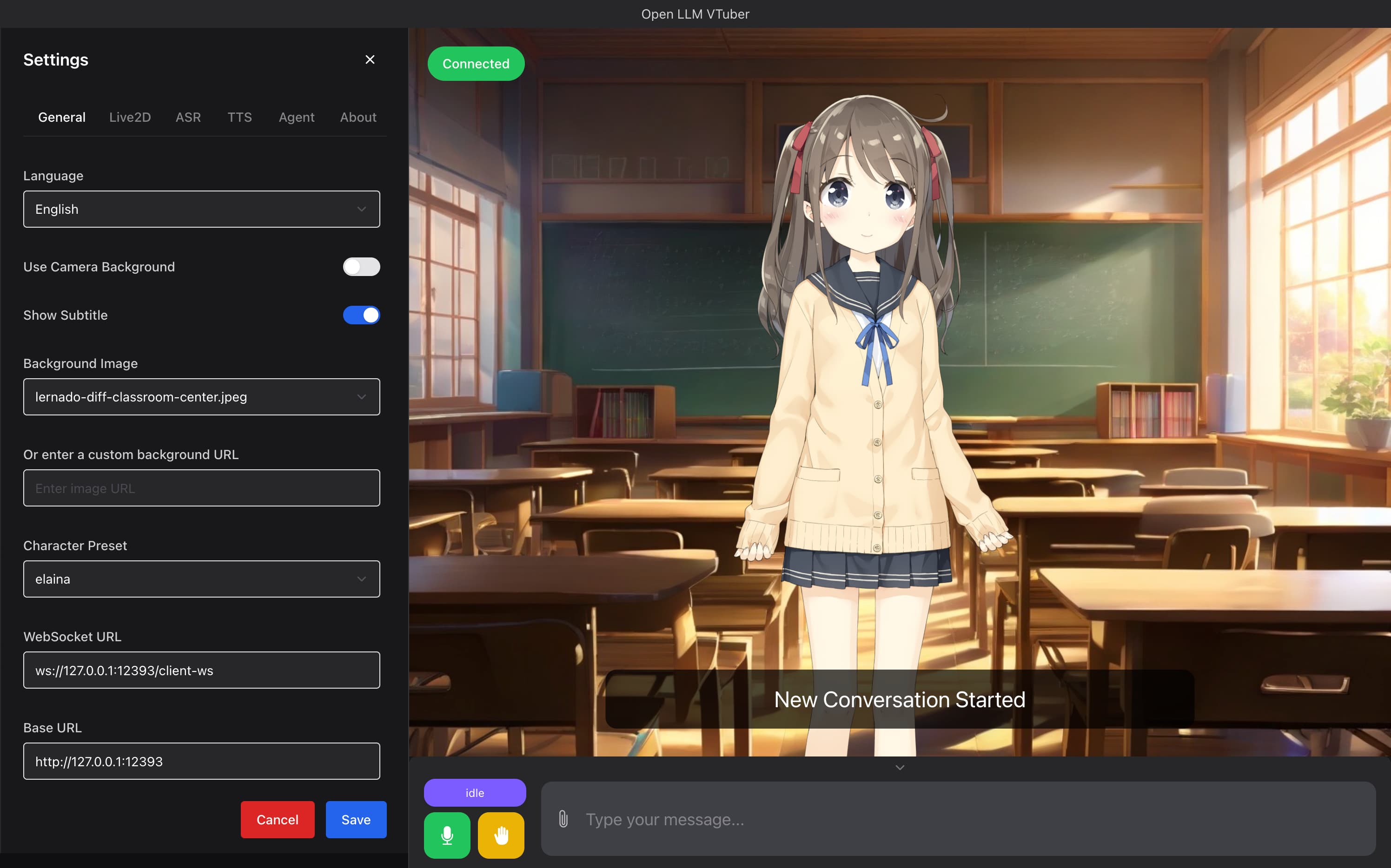

**Open-LLM-VTuber** 是一个独特的 **语音交互 AI 伴侣**,不仅支持 **实时语音对话** 和 **视觉感知**,还拥有生动的 **Live2D 虚拟形象**。所有功能均可完全离线在您的电脑上运行!

您可以将其视为您的个人 AI 伴侣——无论您想要 `虚拟女友`、`男友`、`可爱宠物` 还是任何其他角色,它都能满足您的期望。项目全面支持 `Windows`、`macOS` 和 `Linux`,并提供两种使用模式:网页版和桌面客户端(特别支持 **透明背景桌面宠物模式**,让 AI 伴侣可以陪伴在您屏幕的任何位置)。

尽管长期记忆功能暂时被移除(即将回归),但得益于聊天记录的持久化存储,您始终可以继续之前未完成的对话,不会丢失任何珍贵的互动时刻。

在后端支持方面,我们集成了丰富的 LLM 推理、文本转语音和语音识别解决方案。如果您想自定义您的 AI 伴侣,可以参考 [角色自定义指南](https://open-llm-vtuber.github.io/docs/user-guide/live2d) 来自定义 AI 伴侣的外观和人格。

之所以命名为 `Open-LLM-Vtuber` 而非 `Open-LLM-Companion` 或 `Open-LLM-Waifu`,是因为项目的最初开发目标是使用可以离线运行在 Windows 以外平台的开源解决方案,来复现闭源的 AI Vtuber `neuro-sama`。

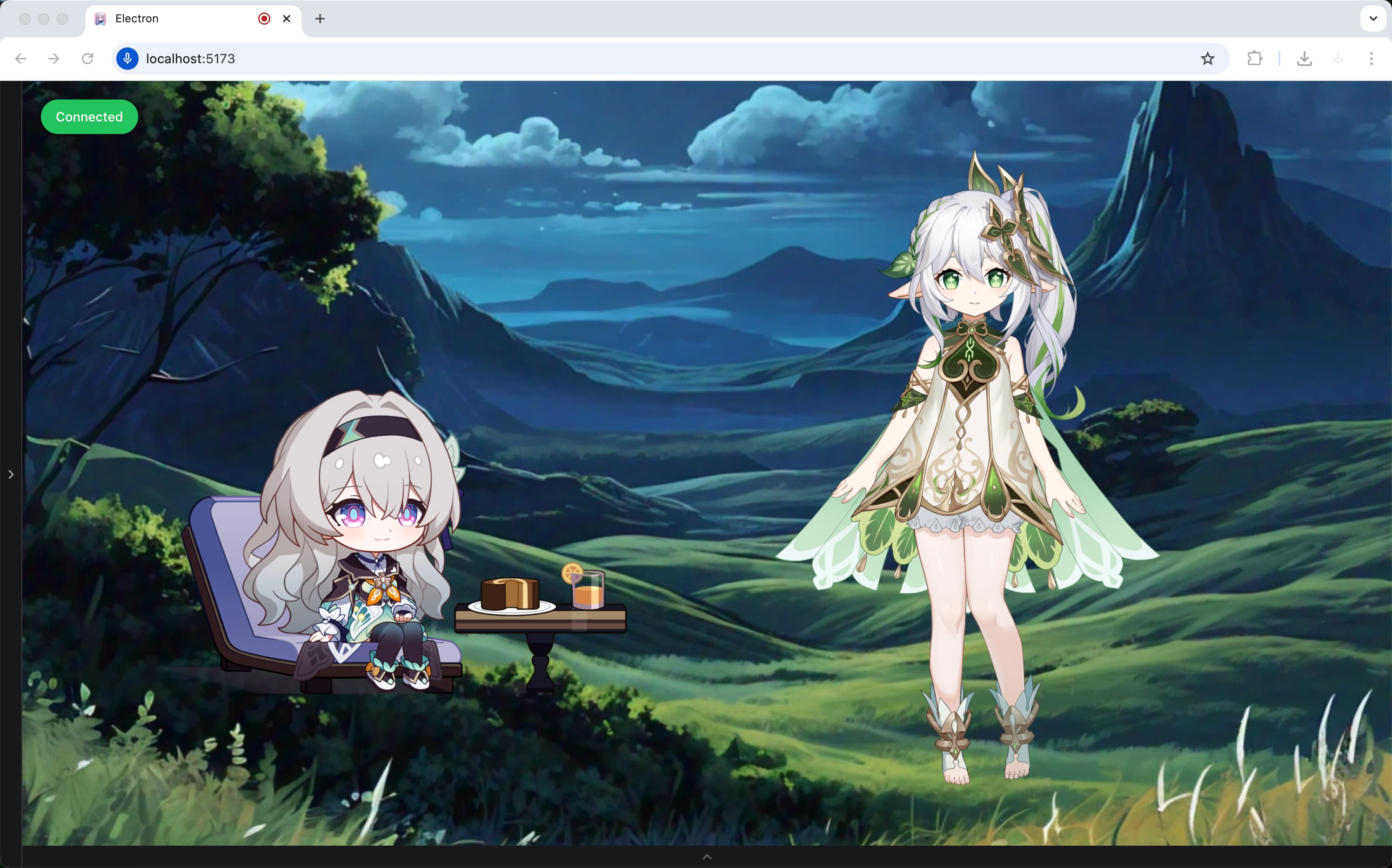

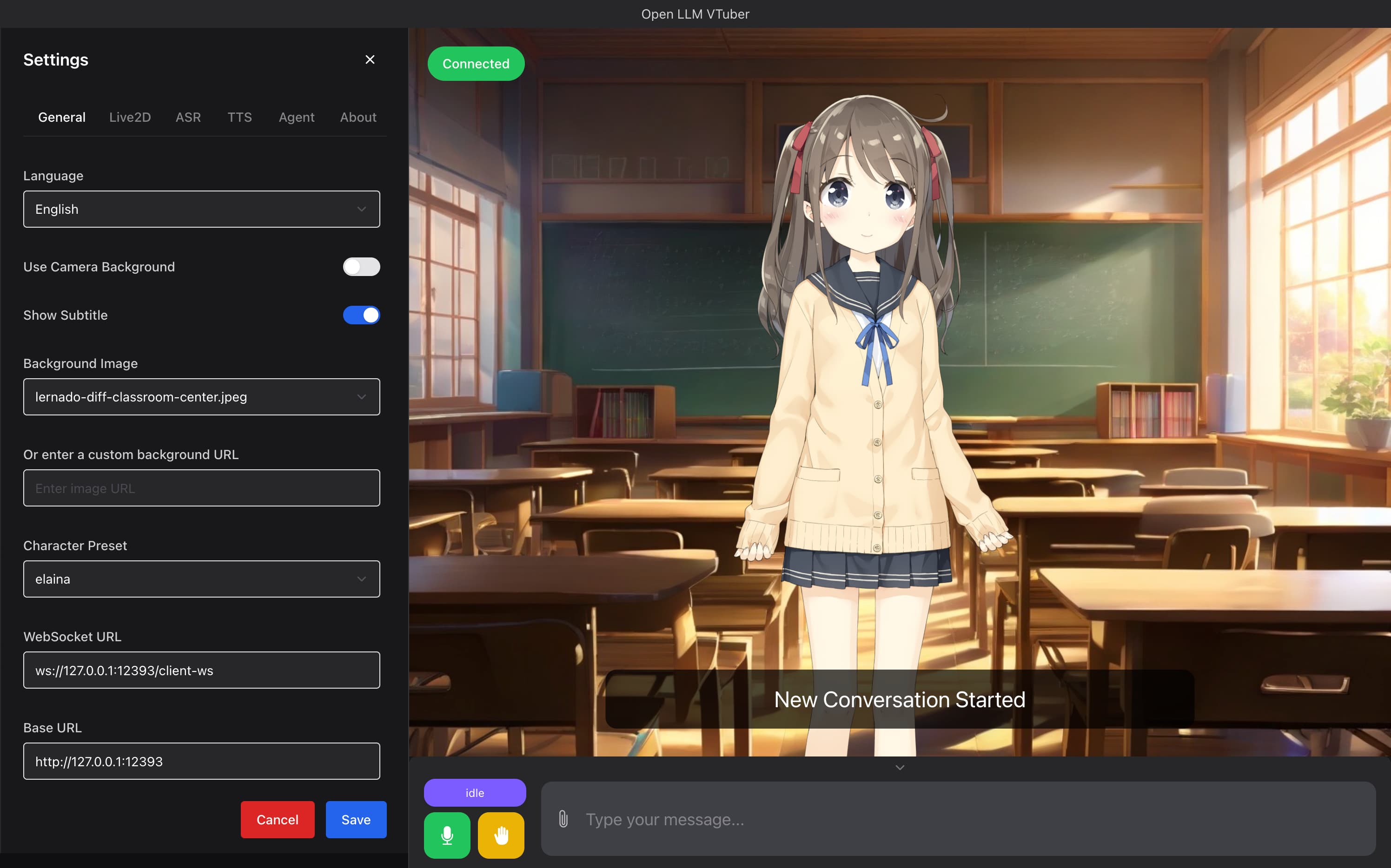

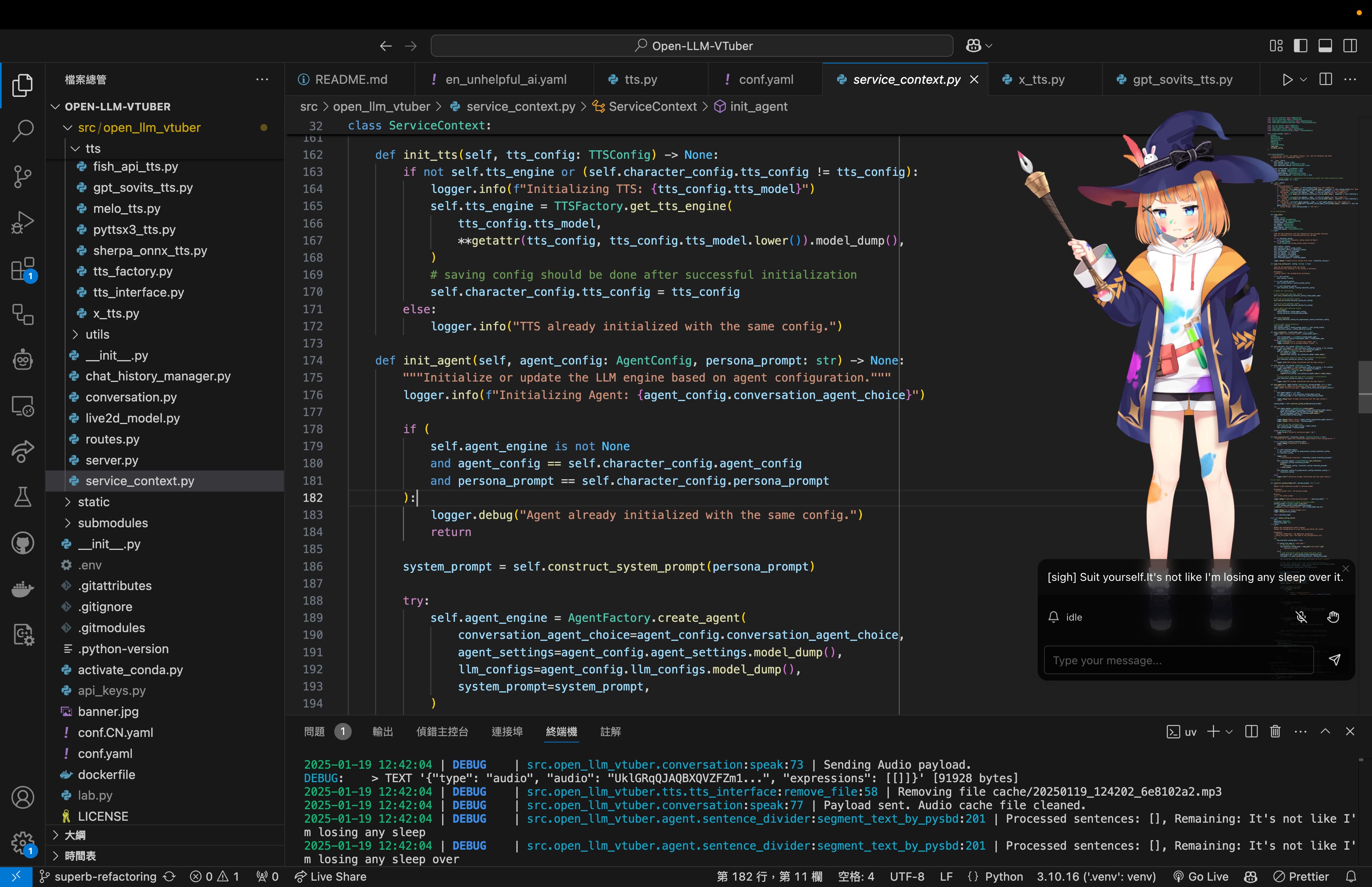

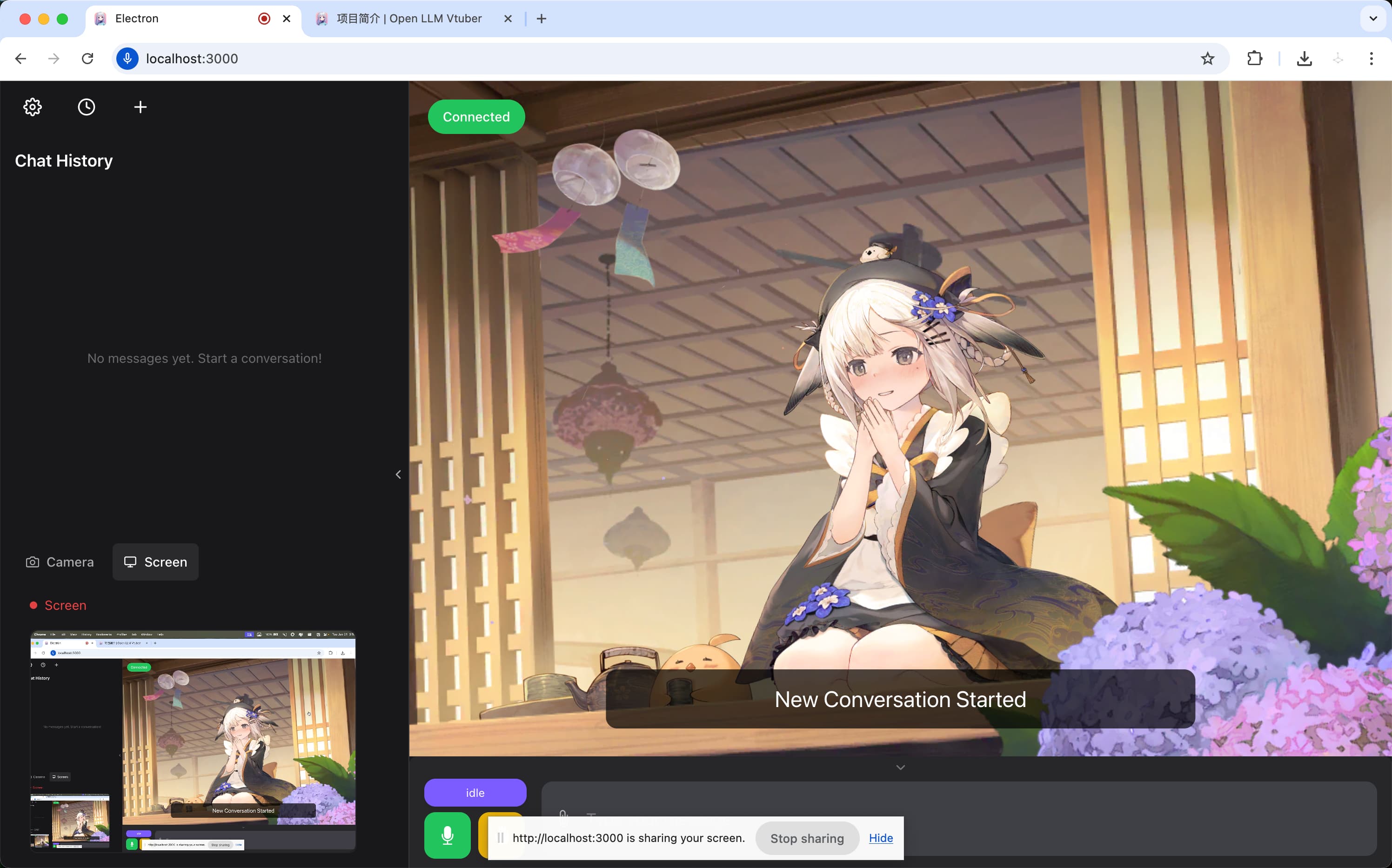

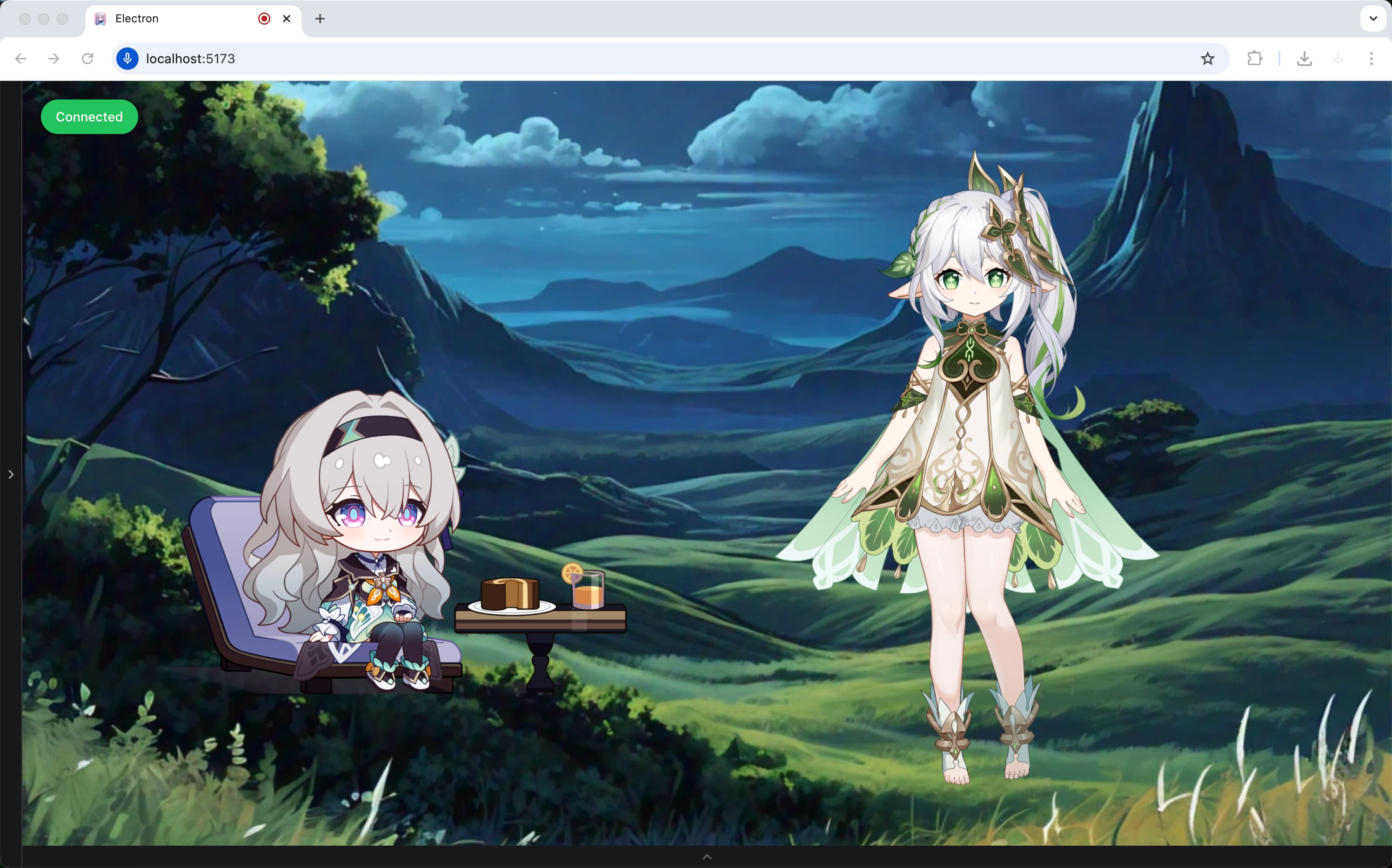

### 👀 演示

|  |  |

|:---:|:---:|

|  |  |

## ✨ 功能与亮点

- 🖥️ **跨平台支持**:完美兼容 macOS、Linux 和 Windows。我们支持 NVIDIA 和非 NVIDIA GPU,可选择在 CPU 上运行或使用云 API 处理资源密集型任务。部分组件支持 macOS 上的 GPU 加速。

- 🔒 **离线模式支持**:使用本地模型完全离线运行——无需互联网。您的对话保留在您的设备上,确保隐私和安全。

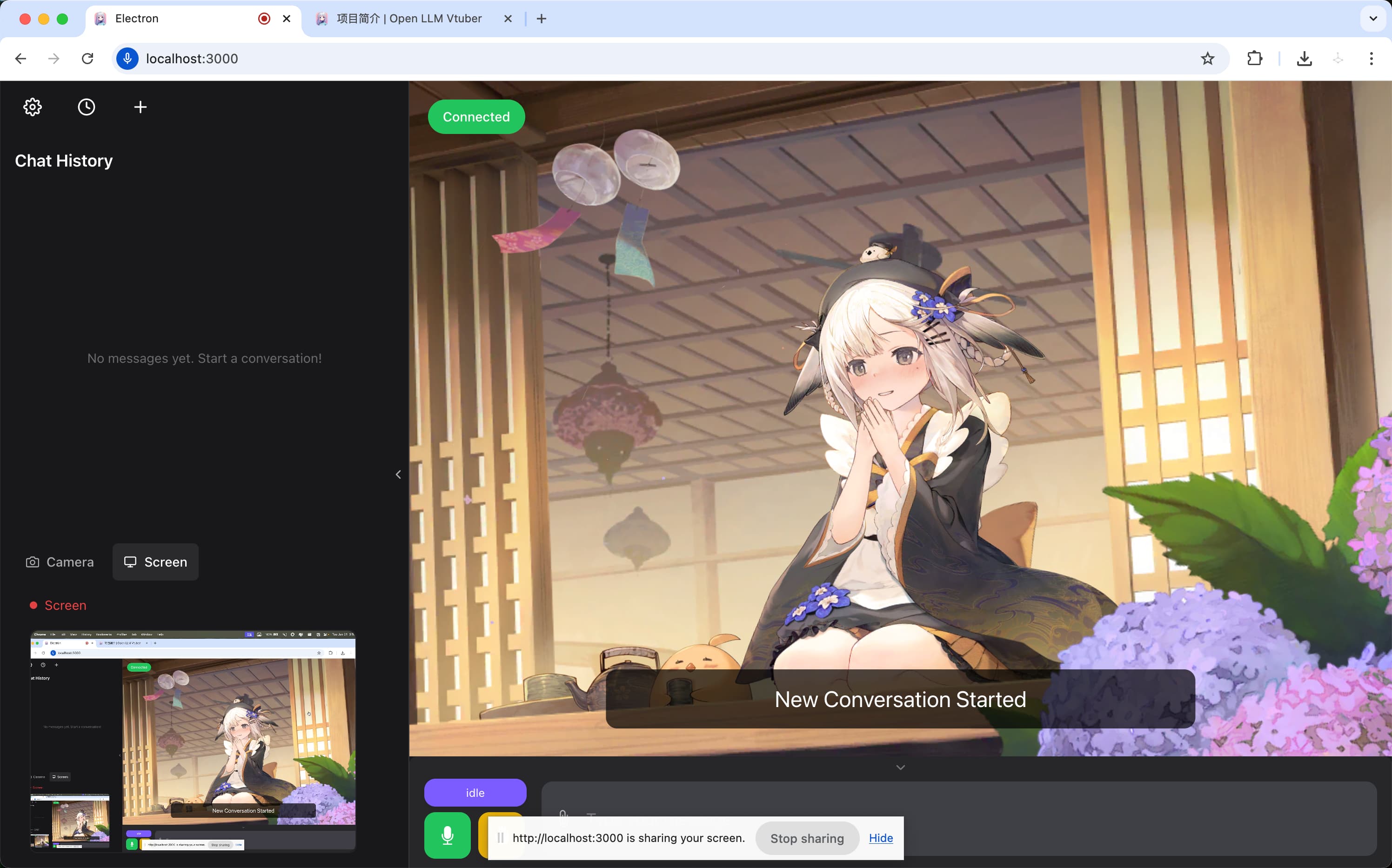

- 💻 **美观且强大的网页和桌面客户端**:提供网页版和桌面客户端两种使用模式,支持丰富的交互功能和个性化设置。桌面客户端可以在窗口模式和桌面宠物模式之间自由切换,让 AI 伴侣时刻伴随在您身边。

- 🎯 **高级交互功能**:

- 👁️ 视觉感知,支持摄像头、屏幕录制和截图,让您的 AI 伴侣能够看到您和您的屏幕

- 🎤 无需耳机的语音打断(AI 不会听到自己的声音)

- 🫱 触摸反馈,通过点击或拖动与您的 AI 伴侣互动

- 😊 Live2D 表情,设置情感映射以从后端控制模型表情

- 🐱 宠物模式,支持透明背景、全局置顶和鼠标点击穿透——将您的 AI 伴侣拖动到屏幕上的任何位置

- 💭 显示 AI 的内心想法,让您无需口述即可看到 AI 的表情、想法和动作

- 🗣️ AI 主动说话功能

- 💾 聊天记录持久化,随时切换到之前的对话

- 🌍 TTS 翻译支持(例如,用中文聊天,同时 AI 使用日语语音)

- 🧠 **广泛的模型支持**:

- 🤖 大语言模型 (LLM):Ollama、OpenAI(以及任何兼容 OpenAI 的 API)、Gemini、Claude、Mistral、DeepSeek、Zhipu AI、GGUF、LM Studio、vLLM 等。

- 🎙️ 自动语音识别 (ASR):sherpa-onnx、FunASR、Faster-Whisper、Whisper.cpp、Whisper、Groq Whisper、Azure ASR 等。

- 🔊 文本转语音 (TTS):sherpa-onnx、pyttsx3、MeloTTS、Coqui-TTS、GPTSoVITS、Bark、CosyVoice、Edge TTS、Fish Audio、Azure TTS 等。

- 🔧 **高度可定制**:

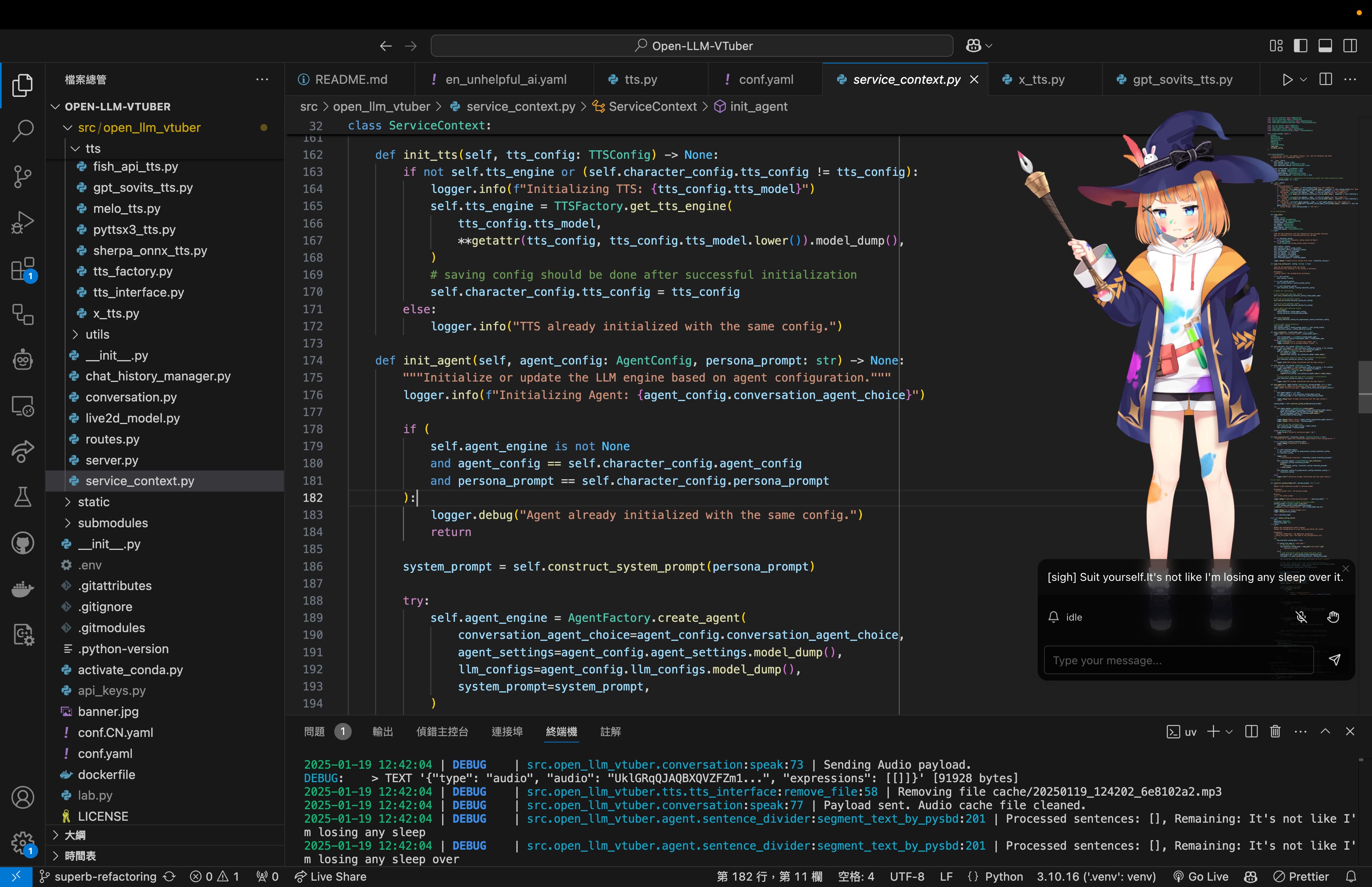

- ⚙️ **简单的模块配置**:通过简单的配置文件修改即可切换各种功能模块,无需深入研究代码

- 🎨 **角色自定义**:导入自定义 Live2D 模型,为您的 AI 伴侣赋予独特的外观。通过修改 Prompt 塑造 AI 伴侣的人格。进行语音克隆,赋予您 AI 伴侣想要的声音

- 🧩 **灵活的 Agent 实现**:继承并实现 Agent 接口以集成任何 Agent 架构,例如 HumeAI EVI、OpenAI Her、Mem0 等。

- 🔌 **良好的扩展性**:模块化设计让您可以轻松添加自己的 LLM、ASR、TTS 等模块实现,随时扩展新功能

## 👥 用户评价

## 🚀 快速开始

请参阅我们文档中的 [快速开始](https://open-llm-vtuber.github.io/docs/quick-start) 部分进行安装。

## ☝ 更新

如果您安装了 `v1.0.0` 或更高版本,请使用 `uv run update.py` 进行更新。

## 😢 卸载

大多数文件,包括 Python 依赖项和模型,都存储在项目文件夹中。

但是,通过 ModelScope 或 Hugging Face 下载的模型也可能位于 `MODELSCOPE_CACHE` 或 `HF_HOME` 中。虽然我们要将它们保留在项目的 `models` 目录中,但最好再次检查。

请查看安装指南中您不再需要的任何额外工具,例如 `uv`、`ffmpeg` 或 `deeplx`。

## 🤗 想要贡献?

查看 [开发指南](https://docs.llmvtuber.com/docs/development-guide/overview)。

# 🎉🎉🎉 相关项目

[ylxmf2005/LLM-Live2D-Desktop-Assitant](https://github.com/ylxmf2005/LLM-Live2D-Desktop-Assitant)

- 由 LLM 驱动的 Live2D 桌面助手!支持 Windows 和 MacOS,感知您的屏幕,获取剪贴板内容,并使用独特的声音响应语音命令。具有语音唤醒、唱歌功能和完整的计算机控制能力,与您最喜欢的角色无缝互动。

## 📜 第三方许可证

### Live2D 示例模型声明

本项目包含 Live2D Inc. 提供的 Live2D 示例模型。这些资产根据 Live2D 免费素材许可协议和 Live2D Cubism 示例数据使用条款单独获得许可。它们不受本项目 MIT 许可证的保护。

本内容使用 Live2D Inc. 拥有并拥有版权的示例数据。示例数据按照 Live2D Inc. 设定的条款和条件使用(请参阅 [Live2D 免费素材许可协议](https://www.live2d.jp/en/terms/live2d-free-material-license-agreement/) 和 [使用条款](https://www.live2d.com/eula/live2d-sample-model-terms_en.html))。

注意:对于商业用途,特别是中型或大型企业,使用这些 Live2D 示例模型可能会受到额外的许可要求限制。如果您计划将本项目用于商业用途,请确保您已获得 Live2D Inc. 的适当许可,或使用不包含这些模型的项目版本。

## 贡献者

感谢我们的贡献者和维护者让本项目成为可能。

## Star 历史

[](https://star-history.com/#Open-LLM-VTuber/open-llm-vtuber&Date)

## Star 历史

[](https://star-history.com/#Open-LLM-VTuber/open-llm-vtuber&Date)

Open-LLM-VTuber

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/releases)

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/blob/master/LICENSE)

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/actions/workflows/codeql.yml)

[](https://github.com/Open-LLM-VTuber/Open-LLM-VTuber/actions/workflows/ruff.yml)

[](https://hub.docker.com/r/Open-LLM-VTuber/open-llm-vtuber)

[](https://qm.qq.com/q/ngvNUQpuKI)

[&color=blue&link=https%3A%2F%2Folv.zulipchat.com)](https://olv.zulipchat.com)

[](https://deepwiki.com/Open-LLM-VTuber/Open-LLM-VTuber)

ENGLISH README | [中文 README](./README.CN.md) | [한국어 README](./README.KR.md) | [日本語 README](./README.JP.md)

[Documentation](https://open-llm-vtuber.github.io/docs/quick-start) | [](https://github.com/orgs/Open-LLM-VTuber/projects/2)

## ⭐️ 什么是本项目?

**Open-LLM-VTuber** 是一个独特的 **语音交互 AI 伴侣**,不仅支持 **实时语音对话** 和 **视觉感知**,还拥有生动的 **Live2D 虚拟形象**。所有功能均可完全离线在您的电脑上运行!

您可以将其视为您的个人 AI 伴侣——无论您想要 `虚拟女友`、`男友`、`可爱宠物` 还是任何其他角色,它都能满足您的期望。项目全面支持 `Windows`、`macOS` 和 `Linux`,并提供两种使用模式:网页版和桌面客户端(特别支持 **透明背景桌面宠物模式**,让 AI 伴侣可以陪伴在您屏幕的任何位置)。

尽管长期记忆功能暂时被移除(即将回归),但得益于聊天记录的持久化存储,您始终可以继续之前未完成的对话,不会丢失任何珍贵的互动时刻。

在后端支持方面,我们集成了丰富的 LLM 推理、文本转语音和语音识别解决方案。如果您想自定义您的 AI 伴侣,可以参考 [角色自定义指南](https://open-llm-vtuber.github.io/docs/user-guide/live2d) 来自定义 AI 伴侣的外观和人格。

之所以命名为 `Open-LLM-Vtuber` 而非 `Open-LLM-Companion` 或 `Open-LLM-Waifu`,是因为项目的最初开发目标是使用可以离线运行在 Windows 以外平台的开源解决方案,来复现闭源的 AI Vtuber `neuro-sama`。

### 👀 演示

|  |  |

|:---:|:---:|

|  |  |

## ✨ 功能与亮点

- 🖥️ **跨平台支持**:完美兼容 macOS、Linux 和 Windows。我们支持 NVIDIA 和非 NVIDIA GPU,可选择在 CPU 上运行或使用云 API 处理资源密集型任务。部分组件支持 macOS 上的 GPU 加速。

- 🔒 **离线模式支持**:使用本地模型完全离线运行——无需互联网。您的对话保留在您的设备上,确保隐私和安全。

- 💻 **美观且强大的网页和桌面客户端**:提供网页版和桌面客户端两种使用模式,支持丰富的交互功能和个性化设置。桌面客户端可以在窗口模式和桌面宠物模式之间自由切换,让 AI 伴侣时刻伴随在您身边。

- 🎯 **高级交互功能**:

- 👁️ 视觉感知,支持摄像头、屏幕录制和截图,让您的 AI 伴侣能够看到您和您的屏幕

- 🎤 无需耳机的语音打断(AI 不会听到自己的声音)

- 🫱 触摸反馈,通过点击或拖动与您的 AI 伴侣互动

- 😊 Live2D 表情,设置情感映射以从后端控制模型表情

- 🐱 宠物模式,支持透明背景、全局置顶和鼠标点击穿透——将您的 AI 伴侣拖动到屏幕上的任何位置

- 💭 显示 AI 的内心想法,让您无需口述即可看到 AI 的表情、想法和动作

- 🗣️ AI 主动说话功能

- 💾 聊天记录持久化,随时切换到之前的对话

- 🌍 TTS 翻译支持(例如,用中文聊天,同时 AI 使用日语语音)

- 🧠 **广泛的模型支持**:

- 🤖 大语言模型 (LLM):Ollama、OpenAI(以及任何兼容 OpenAI 的 API)、Gemini、Claude、Mistral、DeepSeek、Zhipu AI、GGUF、LM Studio、vLLM 等。

- 🎙️ 自动语音识别 (ASR):sherpa-onnx、FunASR、Faster-Whisper、Whisper.cpp、Whisper、Groq Whisper、Azure ASR 等。

- 🔊 文本转语音 (TTS):sherpa-onnx、pyttsx3、MeloTTS、Coqui-TTS、GPTSoVITS、Bark、CosyVoice、Edge TTS、Fish Audio、Azure TTS 等。

- 🔧 **高度可定制**:

- ⚙️ **简单的模块配置**:通过简单的配置文件修改即可切换各种功能模块,无需深入研究代码

- 🎨 **角色自定义**:导入自定义 Live2D 模型,为您的 AI 伴侣赋予独特的外观。通过修改 Prompt 塑造 AI 伴侣的人格。进行语音克隆,赋予您 AI 伴侣想要的声音

- 🧩 **灵活的 Agent 实现**:继承并实现 Agent 接口以集成任何 Agent 架构,例如 HumeAI EVI、OpenAI Her、Mem0 等。

- 🔌 **良好的扩展性**:模块化设计让您可以轻松添加自己的 LLM、ASR、TTS 等模块实现,随时扩展新功能

## 👥 用户评价

## 🚀 快速开始

请参阅我们文档中的 [快速开始](https://open-llm-vtuber.github.io/docs/quick-start) 部分进行安装。

## ☝ 更新

如果您安装了 `v1.0.0` 或更高版本,请使用 `uv run update.py` 进行更新。

## 😢 卸载

大多数文件,包括 Python 依赖项和模型,都存储在项目文件夹中。

但是,通过 ModelScope 或 Hugging Face 下载的模型也可能位于 `MODELSCOPE_CACHE` 或 `HF_HOME` 中。虽然我们要将它们保留在项目的 `models` 目录中,但最好再次检查。

请查看安装指南中您不再需要的任何额外工具,例如 `uv`、`ffmpeg` 或 `deeplx`。

## 🤗 想要贡献?

查看 [开发指南](https://docs.llmvtuber.com/docs/development-guide/overview)。

# 🎉🎉🎉 相关项目

[ylxmf2005/LLM-Live2D-Desktop-Assitant](https://github.com/ylxmf2005/LLM-Live2D-Desktop-Assitant)

- 由 LLM 驱动的 Live2D 桌面助手!支持 Windows 和 MacOS,感知您的屏幕,获取剪贴板内容,并使用独特的声音响应语音命令。具有语音唤醒、唱歌功能和完整的计算机控制能力,与您最喜欢的角色无缝互动。

## 📜 第三方许可证

### Live2D 示例模型声明

本项目包含 Live2D Inc. 提供的 Live2D 示例模型。这些资产根据 Live2D 免费素材许可协议和 Live2D Cubism 示例数据使用条款单独获得许可。它们不受本项目 MIT 许可证的保护。

本内容使用 Live2D Inc. 拥有并拥有版权的示例数据。示例数据按照 Live2D Inc. 设定的条款和条件使用(请参阅 [Live2D 免费素材许可协议](https://www.live2d.jp/en/terms/live2d-free-material-license-agreement/) 和 [使用条款](https://www.live2d.com/eula/live2d-sample-model-terms_en.html))。

注意:对于商业用途,特别是中型或大型企业,使用这些 Live2D 示例模型可能会受到额外的许可要求限制。如果您计划将本项目用于商业用途,请确保您已获得 Live2D Inc. 的适当许可,或使用不包含这些模型的项目版本。

## 贡献者

感谢我们的贡献者和维护者让本项目成为可能。

标签:AI伴侣, AI风险缓解, DLL 劫持, DNS解析, Docker, Live2D, LLM, Python, Unmanaged PE, VTuber, 人工智能, 免提, 大语言模型, 安全防御评估, 开源项目, 数字人, 无后门, 本地运行, 用户模式Hook绕过, 虚拟主播, 语音交互, 语音打断, 请求拦截, 逆向工具