ultralytics/ultralytics

GitHub: ultralytics/ultralytics

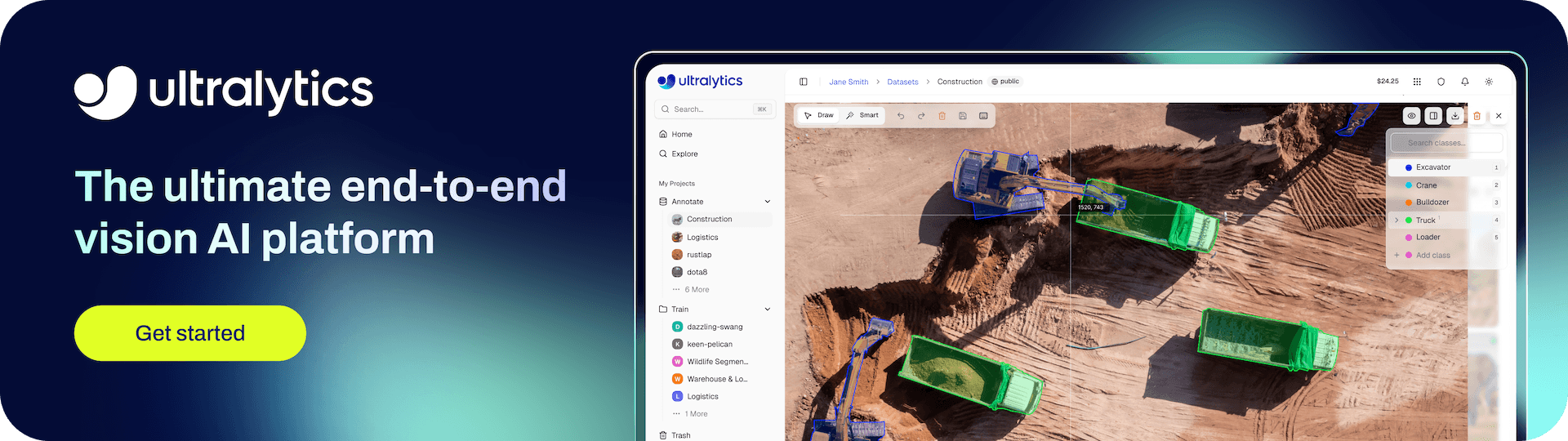

Ultralytics 提供高性能、易用的一站式目标检测与解析能力,解决从研究到生产的多场景视觉任务。

Stars: 55953 | Forks: 10764

[中文](https://docs.ultralytics.com/zh/) | [한국어](https://docs.ultralytics.com/ko/) | [日本語](https://docs.ultralytics.com/ja/) | [Русский](https://docs.ultralytics.com/ru/) | [Deutsch](https://docs.ultralytics.com/de/) | [Français](https://docs.ultralytics.com/fr/) | [Español](https://docs.ultralytics.com/es) | [Português](https://docs.ultralytics.com/pt/) | [Türkçe](https://docs.ultralytics.com/tr/) | [Tiếng Việt](https://docs.ultralytics.com/vi/) | [العربية](https://docs.ultralytics.com/ar/)

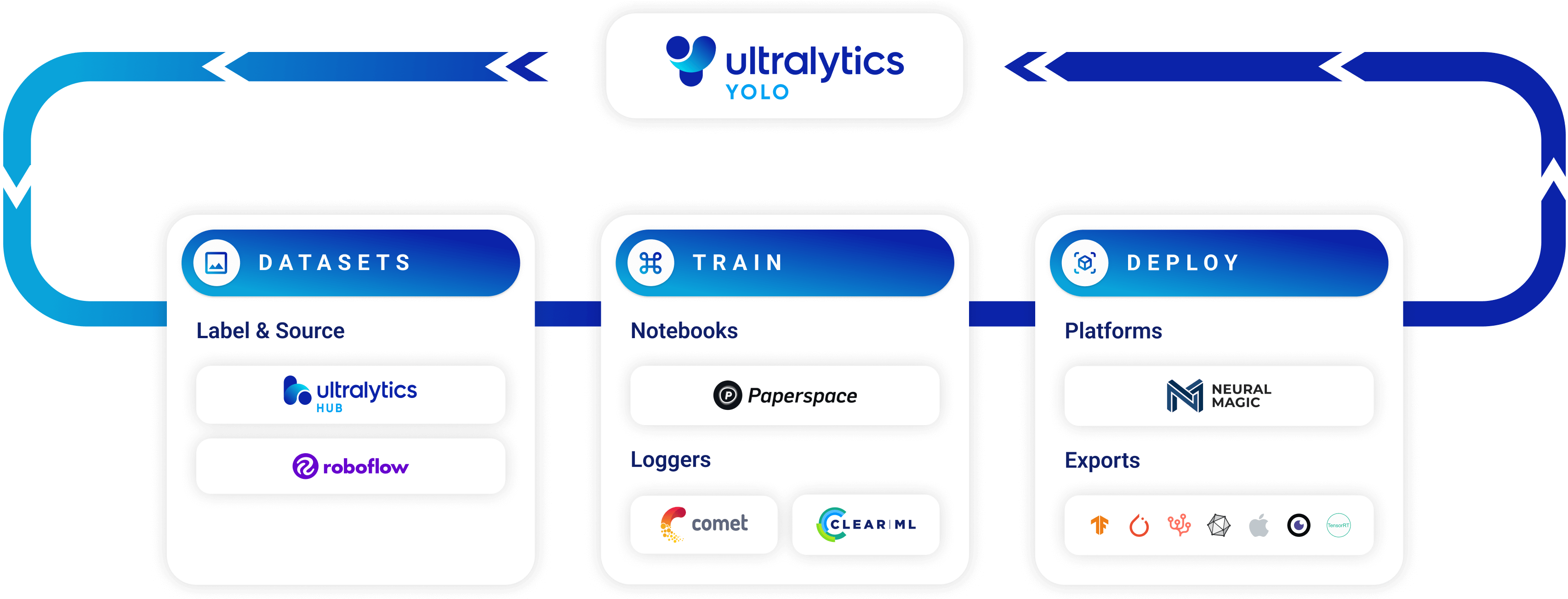

[Ultralytics](https://www.ultralytics.com/) 创建了尖端的、基于最新研究(state-of-the-art, SOTA)的 [YOLO 模型](https://www.ultralytics.com/yolo),这些模型建立在计算机视觉和人工智能多年的基础研究之上。持续更新以提升性能和灵活性,我们的模型 **快速**、**准确** 且 **易于使用**。它们在 [目标检测](https://docs.ultralytics.com/tasks/detect/)、[跟踪](https://docs.ultralytics.com/modes/track/)、[实例分割](https://docs.ultralytics.com/tasks/segment/)、[图像分类](https://docs.ultralytics.com/tasks/classify/) 和 [姿态估计](https://docs.ultralytics.com/tasks/pose/) 任务中表现出色。 在 [Ultralytics 文档](https://docs.ultralytics.com/) 中可以找到详细的文档。通过 [GitHub Issues](https://github.com/ultralytics/ultralytics/issues/new/choose) 获取支持。加入 [Discord](https://discord.com/invite/ultralytics)、[Reddit](https://www.reddit.com/r/ultralytics/) 和 [Ultralytics 社区论坛](https://community.ultralytics.com/) 进行讨论! 在 [Ultralytics 许可](https://www.ultralytics.com/license) 处申请商业使用的企业许可。

## 📄 文档

请参见以下快速入门安装和使用示例。如需关于训练、验证、预测和部署的全面指导,请参阅我们的完整 [Ultralytics 文档](https://docs.ultralytics.com/)。

## 📄 文档

请参见以下快速入门安装和使用示例。如需关于训练、验证、预测和部署的全面指导,请参阅我们的完整 [Ultralytics 文档](https://docs.ultralytics.com/)。

安装

在 [**Python>=3.8**](https://www.python.org/) 环境中安装 `ultralytics` 包,包括所有 [依赖项](https://github.com/ultralytics/ultralytics/blob/main/pyproject.toml),并使用 [**PyTorch>=1.8**](https://pytorch.org/get-started/locally/)。 [](https://pypi.org/project/ultralytics/) [](https://clickpy.clickhouse.com/dashboard/ultralytics) [](https://pypi.org/project/ultralytics/) ``` pip install ultralytics ``` 有关替代安装方法(包括 [Conda](https://anaconda.org/conda-forge/ultralytics)、[Docker](https://hub.docker.com/r/ultralytics/ultralytics) 和通过 Git 从源代码构建),请参阅 [快速入门指南](https://docs.ultralytics.com/quickstart/)。 [](https://anaconda.org/conda-forge/ultralytics) [](https://hub.docker.com/r/ultralytics/ultralytics) [](https://hub.docker.com/r/ultralytics/ultralytics)用法

### CLI 你可以直接使用 `yolo` 命令通过命令行界面(CLI)使用 Ultralytics YOLO: ``` # 使用预训练的 YOLO 模型(例如 YOLO26n)在图像上进行预测 yolo predict model=yolo26n.pt source='https://ultralytics.com/images/bus.jpg' ``` `yolo` 命令支持各种任务和模式,并接受额外的参数,例如 `imgsz=640`。探索更多 YOLO [CLI 文档](https://docs.ultralytics.com/usage/cli/)。 ### Python Ultralytics YOLO 也可以直接集成到你的 Python 项目中。它接受与 CLI 相同的 [配置参数](https://docs.ultralytics.com/usage/cfg/): ``` from ultralytics import YOLO # 加载预训练的 YOLO26n 模型 model = YOLO("yolo26n.pt") # 在 COCO8 数据集上训练模型 100 个周期 train_results = model.train( data="coco8.yaml", # Path to dataset configuration file epochs=100, # Number of training epochs imgsz=640, # Image size for training device="cpu", # Device to run on (e.g., 'cpu', 0, [0,1,2,3]) ) # 在验证集上评估模型性能 metrics = model.val() # 在图像上执行目标检测 results = model("path/to/image.jpg") # Predict on an image results[0].show() # Display results # 将模型导出为 ONNX 格式以进行部署 path = model.export(format="onnx") # Returns the path to the exported model ``` 在 YOLO [Python 文档](https://docs.ultralytics.com/usage/python/) 中查看更多示例。

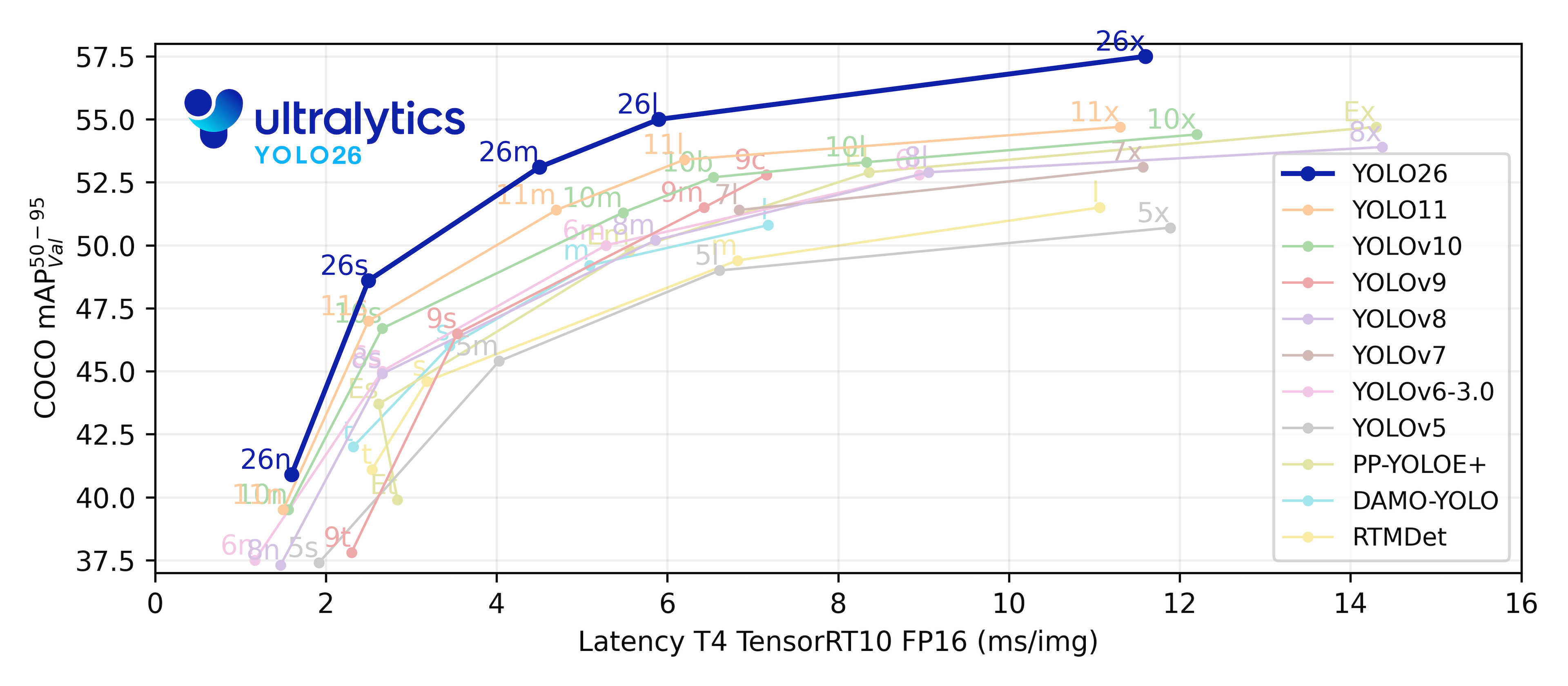

检测 (COCO)

浏览 [检测文档](https://docs.ultralytics.com/tasks/detect/) 获取使用示例。这些模型在 [COCO 数据集](https://cocodataset.org/) 上训练,包含 80 个物体类别。 | 模型 | size(像素) | mAPval

50-95 | mAPval

50-95(e2e) | Speed

CPU ONNX

(ms) | Speed

T4 TensorRT10

(ms) | params

(M) | FLOPs

(B) | | ------------------------------------------------------------------------------------ | --------------------------- | -------------------------- | ------------------------------- | ------------------------------------ | ----------------------------------------- | ------------------------ | ----------------------- | | [YOLO26n](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26n.pt) | 640 | 40.9 | 40.1 | 38.9 ± 0.7 | 1.7 ± 0.0 | 2.4 | 5.4 | | [YOLO26s](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26s.pt) | 640 | 48.6 | 47.8 | 87.2 ± 0.9 | 2.5 ± 0.0 | 9.5 | 20.7 | | [YOLO26m](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26m.pt) | 640 | 53.1 | 52.5 | 220.0 ± 1.4 | 4.7 ± 0.1 | 20.4 | 68.2 | | [YOLO26l](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26l.pt) | 640 | 55.0 | 54.4 | 286.2 ± 2.0 | 6.2 ± 0.2 | 24.8 | 86.4 | | [YOLO26x](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26x.pt) | 640 | 57.5 | 56.9 | 525.8 ± 4.0 | 11.8 ± 0.2 | 55.7 | 193.9 | - **mAPval** 值指单个模型、单尺度在 [COCO val2017](https://cocodataset.org/) 数据集上的性能。详见 [YOLO 性能指标](https://docs.ultralytics.com/guides/yolo-performance-metrics/)。使用命令 `yolo val detect data=coco.yaml device=0` 复现。 - **速度** 指标是在 [Amazon EC2 P4d](https://aws.amazon.com/ec2/instance-types/p4/) 实例上对 COCO val 图像求平均得到的。CPU 速度使用 [ONNX](https://onnx.ai/) 导出的结果测量。GPU 速度使用 [TensorRT](https://developer.nvidia.com/tensorrt)导出的结果测量。

使用命令 `yolo val detect data=coco.yaml batch=1 device=0|cpu` 复现。

分割 (COCO)

参考 [分割文档](https://docs.ultralytics.com/tasks/segment/) 获取使用示例。这些模型在 [COCO-Seg](https://docs.ultralytics.com/datasets/segment/coco/) 上训练,包含 80 个类别。 | 模型 | size(像素) | mAPbox

50-95(e2e) | mAPmask

50-95(e2e) | Speed

CPU ONNX

(ms) | Speed

T4 TensorRT10

(ms) | params

(M) | FLOPs

(B) | | -------------------------------------------------------------------------------------------- | --------------------------- | ------------------------------- | -------------------------------- | ------------------------------------ | ----------------------------------------- | ------------------------ | ----------------------- | | [YOLO26n-seg](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26n-seg.pt) | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 | | [YOLO26s-seg](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26s-seg.pt) | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 | | [YOLO26m-seg](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26m-seg.pt) | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 | | [YOLO26l-seg](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26l-seg.pt) | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 | | [YOLO26x-seg](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26x-seg.pt) | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 | - **mAPval** 值为单个模型、单尺度在 [COCO val2017](https://cocodataset.org/) 数据集上的性能。详见 [YOLO 性能指标](https://docs.ultralytics.com/guides/yolo-performance-metrics/)。使用命令 `yolo val segment data=coco.yaml device=0` 复现。 - **速度** 指标是在 [Amazon EC2 P4d](https://aws.amazon.com/ec2/instance-types/p4/) 实例上对 COCO val 图像求平均得到的。CPU 速度使用 [ONNX](https://onnx.ai/) 导出的结果测量。GPU 速度使用 [TensorRT](https://developer.nvidia.com/tensorrt) 导出的结果测量。

使用命令 `yolo val segment data=coco.yaml batch=1 device=0|cpu` 复现。

分类 (ImageNet)

参考 [分类文档](https://docs.ultralytics.com/tasks/classify/) 获取使用示例。这些模型在 [ImageNet](https://docs.ultralytics.com/datasets/classify/imagenet/) 数据集上训练,覆盖 1000 个类别。 | 模型 | size(像素) | acc

top1 | acc

top5 | Speed

CPU ONNX

(ms) | Speed

T4 TensorRT10

(ms) | params

(M) | FLOPs

(B) at 224 | | -------------------------------------------------------------------------------------------- | --------------------------- | ---------------------- | ---------------------- | ------------------------------------ | ----------------------------------------- | ------------------------ | ------------------------------ | | [YOLO26n-cls](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26n-cls.pt) | 224 | 71.4 | 90.1 | 5.0 ± 0.3 | 1.1 ± 0.0 | 2.8 | 0.5 | | [YOLO26s-cls](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26s-cls.pt) | 224 | 76.0 | 92.9 | 7.9 ± 0.2 | 1.3 ± 0.0 | 6.7 | 1.6 | | [YOLO26m-cls](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26m-cls.pt) | 224 | 78.1 | 94.2 | 17.2 ± 0.4 | 2.0 ± 0.0 | 11.6 | 4.9 | | [YOLO26l-cls](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26l-cls.pt) | 224 | 79.0 | 94.6 | 23.2 ± 0.3 | 2.8 ± 0.0 | 14.1 | 6.2 | | [YOLO26x-cls](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26x-cls.pt) | 224 | 79.9 | 95.0 | 41.4 ± 0.9 | 3.8 ± 0.0 | 29.6 | 13.6 | - **acc** 值代表模型在 [ImageNet](https://www.image-net.org/) 数据集验证集上的准确率。

使用命令 `yolo val classify data=path/to/ImageNet device=0` 复现。 - **速度** 指标是在 [Amazon EC2 P4d](https://aws.amazon.com/ec2/instance-types/p4/) 实例上对 ImageNet 验证图像求平均得到的。CPU 速度使用 [ONNX](https://onnx.ai/) 导出的结果测量。GPU 速度使用 [TensorRT](https://developer.nvidia.com/tensorrt) 导出的结果测量。

使用命令 `yolo val classify data=path/to/ImageNet batch=1 device=0|cpu` 复现。

姿态 (COCO)

参考 [姿态估计文档](https://docs.ultralytics.com/tasks/pose/) 获取使用示例。这些模型在 [COCO-Pose](https://docs.ultralytics.com/datasets/pose/coco/) 数据集上训练,专注于 'person' 类别。 | 模型 | size(像素) | mAPpose

50-95(e2e) | mAPpose

50(e2e) | Speed

CPU ONNX

(ms) | Speed

T4 TensorRT10

(ms) | params

(M) | FLOPs

(B) | | ---------------------------------------------------------------------------------------------- | --------------------------- | -------------------------------- | ----------------------------- | ------------------------------------ | ----------------------------------------- | ------------------------ | ----------------------- | | [YOLO26n-pose](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26n-pose.pt) | 640 | 57.2 | 83.3 | 40.3 ± 0.5 | 1.8 ± 0.0 | 2.9 | 7.5 | | [YOLO26s-pose](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26s-pose.pt) | 640 | 63.0 | 86.6 | 85.3 ± 0.9 | 2.7 ± 0.0 | 10.4 | 23.9 | | [YOLO26m-pose](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26m-pose.pt) | 640 | 68.8 | 89.6 | 218.0 ± 1.5 | 5.0 ± 0.1 | 21.5 | 73.1 | | [YOLO26l-pose](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26l-pose.pt) | 640 | 70.4 | 90.5 | 275.4 ± 2.4 | 6.5 ± 0.1 | 25.9 | 91.3 | | [YOLO26x-pose](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26x-pose.pt) | 640 | 71.6 | 91.6 | 565.4 ± 3.0 | 12.2 ± 0.2 | 57.6 | 201.7 | - **mAPval** 值为单个模型、单尺度在 [COCO Keypoints val2017](https://docs.ultralytics.com/datasets/pose/coco/) 数据集上的性能。详见 [YOLO 性能指标](https://docs.ultralytics.com/guides/yolo-performance-metrics/)。使用命令 `yolo val pose data=coco-pose.yaml device=0` 复现。 - **速度** 指标是在 [Amazon EC2 P4d](https://aws.amazon.com/ec2/instance-types/p4/) 实例上对 COCO val 图像求平均得到的。CPU 速度使用 [ONNX](https://onnx.ai/) 导出的结果测量。GPU 速度使用 [TensorRT](https://developer.nvidia.com/tensorrt) 导出的结果测量。

使用命令 `yolo val pose data=coco-pose.yaml batch=1 device=0|cpu` 复现。

定向边界框 (DOTAv1)

查看 [OBB 文档](https://docs.ultralytics.com/tasks/obb/) 获取使用示例。这些模型在 [DOTAv1](https://docs.ultralytics.com/datasets/obb/dota-v2/#dota-v10/) 数据集上训练,包含 15 个类别。 | 模型 | size(像素) | mAPtest

50-95(e2e) | mAPtest

50(e2e) | Speed

CPU ONNX

(ms) | Speed

T4 TensorRT10

(ms) | params

(M) | FLOPs

(B) | | -------------------------------------------------------------------------------------------- | --------------------------- | -------------------------------- | ----------------------------- | ------------------------------------ | ----------------------------------------- | ------------------------ | ----------------------- | | [YOLO26n-obb](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26n-obb.pt) | 1024 | 52.4 | 78.9 | 97.7 ± 0.9 | 2.8 ± 0.0 | 2.5 | 14.0 | | [YOLO26s-obb](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26s-obb.pt) | 1024 | 54.8 | 80.9 | 218.0 ± 1.4 | 4.9 ± 0.1 | 9.8 | 55.1 | | [YOLO26m-obb](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26m-obb.pt) | 1024 | 55.3 | 81.0 | 579.2 ± 3.8 | 10.2 ± 0.3 | 21.2 | 183.3 | | [YOLO26l-obb](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26l-obb.pt) | 1024 | 56.2 | 81.6 | 735.6 ± 3.1 | 13.0 ± 0.2 | 25.6 | 230.0 | | [YOLO26x-obb](https://github.com/ultralytics/assets/releases/download/v8.4.0/yolo26x-obb.pt) | 1024 | 56.7 | 81.7 | 1485.7 ± 11.5 | 30.5 ± 0.9 | 57.6 | 516.5 | - **mAPtest** 值为单个模型、多尺度在 [DOTAv1 测试集](https://captain-whu.github.io/DOTA/dataset.html) 上的性能。详见 [YOLO 性能指标](https://captain-whu.github.io/DOTA/evaluation.html)。通过 `yolo val obb data=DOTAv1.yaml device=0 split=test` 复现,并将合并结果提交至 [DOTA 评估服务器](https://captain-whu.github.io/DOTA/evaluation.html)。 - **速度** 指标是在 [DOTAv1 验证图像](https://docs.ultralytics.com/datasets/obb/dota-v2/#dota-v10) 上求平均得到的。CPU 速度使用 [ONNX](https://onnx.ai/) 导出的结果测量。GPU 速度使用 [TensorRT](https://developer.nvidia.com/tensorrt) 导出的结果测量。

使用命令 `yolo val obb data=DOTAv1.yaml batch=1 device=0|cpu` 复现。

| Ultralytics Platform 🌟 | Weights & Biases | Comet | Neural Magic | | :---------------------------------------------------------------------------------------------------------------------------------------------------------: | :---------------------------------------------------------------------------------------------------------------------------------: | :-------------------------------------------------------------------------------------------------------------------------------------------------------------: | :-------------------------------------------------------------------------------------------------------------------------: | | Streamline YOLO workflows: Label, train, and deploy effortlessly with [Ultralytics Platform](https://platform.ultralytics.com/ultralytics/yolo26). Try now! | Track experiments, hyperparameters, and results with [Weights & Biases](https://docs.ultralytics.com/integrations/weights-biases/). | Free forever, [Comet ML](https://docs.ultralytics.com/integrations/comet/) lets you save YOLO models, resume training, and interactively visualize predictions. | Run YOLO inference up to 6x faster with [Neural Magic DeepSparse](https://docs.ultralytics.com/integrations/neural-magic/). | ## 📜 许可 Ultralytics 提供两种许可选项,以满足不同需求: - **AGPL-3.0 许可**:此 [OSI 批准](https://opensource.org/license/agpl-v3) 的开源许可非常适合学生、研究人员和爱好者。它鼓励开放协作和知识共享。请参阅 [LICENSE](https://github.com/ultralytics/ultralytics/blob/main/LICENSE) 文件了解完整细节。 - **Ultralytics 企业许可**:专为商业使用设计,此许可允许将 Ultralytics 软件和 AI 模型无缝集成到商业产品和业务中,绕过 AGPL-3.0 的开源要求。如果您的使用场景涉及商业部署,请通过 [Ultralytics 许可](https://www.ultralytics.com/license) 与我们联系。 ## 📞 联系 如需报告 Ultralytics 软件相关的错误和功能请求,请访问 [GitHub Issues](https://github.com/ultralytics/ultralytics/issues)。如有问题、讨论或社区支持,请加入我们活跃的社区:[Discord](https://discord.com/invite/ultralytics)、[Reddit](https://www.reddit.com/r/ultralytics/) 和 [Ultralytics 社区论坛](https://community.ultralytics.com/)。我们随时准备帮助您解决所有与 Ultralytics 相关的问题!

标签:Apex, Benchmark, CNCF毕业项目, Community, Discord, Download, ONNX, Python, PyTorch, SEO, TensorRT, Ultralytics, YOLO, 凭据扫描, 多语言文档, 实时检测, 开源, 推理加速, 文档结构分析, 无后门, 机器学习, 模型部署, 深度学习, 目标检测, 计算机视觉, 请求拦截, 逆向工具