k2-fsa/sherpa-onnx

GitHub: k2-fsa/sherpa-onnx

基于下一代 Kaldi 和 ONNX Runtime 的离线语音处理工具包,支持语音识别、语音合成、说话人分离、VAD 等多种功能,可在嵌入式设备、移动端和服务器上本地运行。

Stars: 10544 | Forks: 1192

### 支持的功能

|语音识别| [语音合成][tts-url] | [音源分离][ss-url] |

|------------------|------------------|-------------------|

| ✔️ | ✔️ | ✔️ |

|说话人识别| [说话人分离][sd-url] | 声纹验证 |

|----------------------|-------------------- |------------------------|

| ✔️ | ✔️ | ✔️ |

| [口语语言识别][slid-url] | [音频标记][at-url] | [语音活动检测][vad-url] |

|--------------------------------|---------------|--------------------------|

| ✔️ | ✔️ | ✔️ |

| [关键词检测][kws-url] | [添加标点][punct-url] | [语音增强][se-url] |

|------------------|-----------------|--------------------|

| ✔️ | ✔️ | ✔️ |

### 支持的平台

|架构| Android | iOS | Windows | macOS | linux | HarmonyOS |

|------------|---------|---------|------------|-------|-------|-----------|

| x64 | ✔️ | | ✔️ | ✔️ | ✔️ | ✔️ |

| x86 | ✔️ | | ✔️ | | | |

| arm64 | ✔️ | ✔️ | ✔️ | ✔️ | ✔️ | ✔️ |

| arm32 | ✔️ | | | | ✔️ | ✔️ |

| riscv64 | | | | | ✔️ | |

### 支持的编程语言

| 1. C++ | 2. C | 3. Python | 4. JavaScript |

|--------|-------|-----------|---------------|

| ✔️ | ✔️ | ✔️ | ✔️ |

|5. Java | 6. C# | 7. Kotlin | 8. Swift |

|--------|-------|-----------|----------|

| ✔️ | ✔️ | ✔️ | ✔️ |

| 9. Go | 10. Dart | 11. Rust | 12. Pascal |

|-------|----------|----------|------------|

| ✔️ | ✔️ | ✔️ | ✔️ |

关于 Rust 支持,请参阅 [sherpa-rs][sherpa-rs]

它同时也支持 WebAssembly。

### 支持的 NPU

| [1. Rockchip NPU (RKNN)][rknpu-doc] | [2. Qualcomm NPU (QNN)][qnn-doc] | [3. Ascend NPU][ascend-doc] |

|-------------------------------------|-----------------------------------|-----------------------------|

| ✔️ | ✔️ | ✔️ |

| [4. Axera NPU][axera-npu] |

|---------------------------|

| ✔️ |

[加入我们的 Discord](https://discord.gg/fJdxzg2VbG)

## 简介

本仓库支持在**本地**运行以下功能

- 语音转文字 (即 ASR);同时支持流式和非流式

- 文字转语音 (即 TTS)

- 说话人分离

- 说话人识别

- 声纹验证

- 口语语言识别

- 音频标记

- VAD (例如 [silero-vad][silero-vad])

- 语音增强 (例如 [gtcrn][gtcrn])

- 关键词检测

- 音源分离 (例如 [spleeter][spleeter], [UVR][UVR])

支持以下平台和操作系统:

- x86, ``x86_64``, 32-bit ARM, 64-bit ARM (arm64, aarch64), RISC-V (riscv64), **RK NPU**, **Ascend NPU**

- Linux, macOS, Windows, openKylin

- Android, WearOS

- iOS

- HarmonyOS

- NodeJS

- WebAssembly

- [NVIDIA Jetson Orin NX][NVIDIA Jetson Orin NX] (支持在 CPU 和 GPU 上运行)

- [NVIDIA Jetson Nano B01][NVIDIA Jetson Nano B01] (支持在 CPU 和 GPU 上运行)

- [Raspberry Pi][Raspberry Pi]

- [RV1126][RV1126]

- [LicheePi4A][LicheePi4A]

- [VisionFive 2][VisionFive 2]

- [旭日X3派][旭日X3派]

- [爱芯派][爱芯派]

- [RK3588][RK3588]

- 等等

支持以下 API

- C++, C, Python, Go, ``C#``

- Java, Kotlin, JavaScript

- Swift, Rust

- Dart, Object Pascal

### Huggingface Spaces 链接

### 预编译 Android APK 链接

### 预编译 Flutter APP 链接

### [voiceapi](https://github.com/ruzhila/voiceapi)

### [腾讯会议摸鱼工具 TMSpeech](https://github.com/jxlpzqc/TMSpeech)

使用 C# 实现带图形用户界面的流式 ASR。

中文视频演示: [【开源】Windows实时字幕软件(网课/开会必备)](https://www.bilibili.com/video/BV1rX4y1p7Nx)

### [lol互动助手](https://github.com/l1veIn/lol-wom-electron)

它使用 sherpa-onnx 的 JavaScript API 以及 [Electron](https://electronjs.org/)

中文视频演示: [爆了!炫神教你开打字挂!真正影响胜率的英雄联盟工具!英雄联盟的最后一块拼图!和游戏中的每个人无障碍沟通!](https://www.bilibili.com/video/BV142tje9E74)

### [Sherpa-ONNX 语音识别服务器](https://github.com/hfyydd/sherpa-onnx-server)

一个基于 nodejs 的服务器,提供用于语音识别的 Restful API。

### [QSmartAssistant](https://github.com/xinhecuican/QSmartAssistant)

一个模块化,全过程可离线,低占用率的对话机器人/智能音箱

它使用 QT。同时使用了 [ASR](https://github.com/xinhecuican/QSmartAssistant/blob/master/doc/%E5%AE%89%E8%A3%85.md#asr)

和 [TTS](https://github.com/xinhecuican/QSmartAssistant/blob/master/doc/%E5%AE%89%E8%A3%85.md#tts)。

### [Flutter-EasySpeechRecognition](https://github.com/Jason-chen-coder/Flutter-EasySpeechRecognition)

它通过在应用内下载模型来扩展 [./flutter-examples/streaming_asr](./flutter-examples/streaming_asr),以减小应用体积。

注:[[Team B] Sherpa AI backend](https://github.com/umgc/spring2025/pull/82) 也在 Flutter APP 中使用了 sherpa-onnx。

### [sherpa-on-unity](https://github.com/xue-fei/sherpa-onnx-unity)

Unity 中的 sherpa-onnx。另见 [#1695](https://github.com/k2-fsa/sherpa-onnx/issues/1695),

[#1892](https://github.com/k2-fsa/sherpa-onnx/issues/1892), 和 [#1859](https://github.com/k2-fsa/sherpa-onnx/issues/1859)

### [xiaozhi-esp32-server](https://github.com/xinnan-tech/xiaozhi-esp32-server)

本项目为xiaozhi-esp32提供后端服务,帮助您快速搭建ESP32设备控制服务器

xiaozhi-esp32 的后端服务,帮助您快速构建 ESP32 设备控制服务器。

另见

- [ASR新增轻量级sherpa-onnx-asr](https://github.com/xinnan-tech/xiaozhi-esp32-server/issues/315)

- [feat: ASR增加sherpa-onnx模型](https://github.com/xinnan-tech/xiaozhi-esp32-server/pull/379)

### [KaithemAutomation](https://github.com/EternityForest/KaithemAutomation)

纯 Python,专注于 GUI 的家庭自动化/消费级 SCADA。

它使用 sherpa-onnx 的 TTS。另见 [✨ Speak command that uses the new globally configured TTS model.](https://github.com/EternityForest/KaithemAutomation/commit/8e64d2b138725e426532f7d66bb69dd0b4f53693)

### [Open-XiaoAI KWS](https://github.com/idootop/open-xiaoai-kws)

为小爱音箱启用自定义唤醒词。让小爱音箱支持自定义唤醒词。

中文视频演示: [小爱同学启动~˶╹ꇴ╹˶!](https://www.bilibili.com/video/BV1YfVUz5EMj)

### [C++ WebSocket ASR Server](https://github.com/mawwalker/stt-server)

它提供了一个基于 C++ 的 WebSocket 服务器,用于使用 sherpa-onnx 进行 ASR。

### [Go WebSocket Server](https://github.com/bbeyondllove/asr_server)

它提供了一个基于 Go 编程语言的 WebSocket 服务器,用于 sherpa-onnx。

### [制作机器人派蒙,第10集 “The AI Part 1”](https://www.youtube.com/watch?v=KxPKkwxGWZs)

这是一个 [YouTube 视频](https://www.youtube.com/watch?v=KxPKkwxGWZs),

展示了作者如何尝试使用 AI 以便与派蒙对话。

它使用 sherpa-onnx 进行语音转文字和文字转语音。

|1|

|---|

||

### [TtsReader - 桌面应用程序](https://github.com/ys-pro-duction/TtsReader)

一个使用 Kotlin Multiplatform 构建的桌面文字转语音应用程序。

### [MentraOS](https://github.com/Mentra-Community/MentraOS)

它在 iOS 和 Android 设备上使用 sherpa-onnx 进行实时语音识别。

另见

它在 iOS 上使用 Swift,在 Android 上使用 Java。

### [flet_sherpa_onnx](https://github.com/SamYuan1990/flet_sherpa_onnx)

基于 sherpa-onnx 的 Flet ASR/STT 组件。

示例 [一个聊天框代理](https://github.com/SamYuan1990/i18n-agent-action)

### [achatbot-go](https://github.com/ai-bot-pro/achatbot-go)

基于 go 的多模态聊天机器人,使用 sherpa-onnx 的语音库 API。

您可以访问以下 Huggingface spaces 来试用 sherpa-onnx,无需 安装任何软件。您只需要一个浏览器。

| 描述 | URL | 中国镜像 | |-------------------------------------------------------|-----------------------------------------|----------------------------------------| | 说话人分离 | [点击此处][hf-space-speaker-diarization]| [镜像][hf-space-speaker-diarization-cn]| | 语音识别 | [点击此处][hf-space-asr] | [镜像][hf-space-asr-cn] | | 使用 [Whisper][Whisper] 进行语音识别 | [点击此处][hf-space-asr-whisper] | [镜像][hf-space-asr-whisper-cn] | | 语音合成 | [点击此处][hf-space-tts] | [镜像][hf-space-tts-cn] | | 生成字幕 | [点击此处][hf-space-subtitle] | [镜像][hf-space-subtitle-cn] | | 音频标记 | [点击此处][hf-space-audio-tagging] | [镜像][hf-space-audio-tagging-cn] | | 音源分离 | [点击此处][hf-space-source-separation] | [镜像][hf-space-source-separation-cn] | | 使用 [Whisper][Whisper] 进行口语语言识别| [点击此处][hf-space-slid-whisper] | [镜像][hf-space-slid-whisper-cn] | 我们也有使用 WebAssembly 构建的空间。它们列在下面: | 描述 | Huggingface space| ModelScope space| |------------------------------------------------------------------------------------------|------------------|-----------------| |使用 [silero-vad][silero-vad] 进行语音活动检测 | [点击此处][wasm-hf-vad]|[地址][wasm-ms-vad]| |使用 Zipformer 进行实时语音识别 (中文 + 英文) | [点击此处][wasm-hf-streaming-asr-zh-en-zipformer]|[地址][wasm-hf-streaming-asr-zh-en-zipformer]| |使用 Paraformer 进行实时语音识别 (中文 + 英文) |[点击此处][wasm-hf-streaming-asr-zh-en-paraformer]| [地址][wasm-ms-streaming-asr-zh-en-paraformer]| |使用 [Paraformer-large][Paraformer-large] 进行实时语音识别 (中文 + 英文 + 粤语)|[点击此处][wasm-hf-streaming-asr-zh-en-yue-paraformer]| [地址][wasm-ms-streaming-asr-zh-en-yue-paraformer]| |实时语音识别 (英文) |[点击此处][wasm-hf-streaming-asr-en-zipformer] |[地址][wasm-ms-streaming-asr-en-zipformer]| |使用 [Zipformer CTC](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-ctc/icefall/zipformer.html#sherpa-onnx-zipformer-ctc-zh-int8-2025-07-03-chinese) 进行 VAD + 语音识别 (中文)|[点击此处][wasm-hf-vad-asr-zh-zipformer-ctc-07-03]| [地址][wasm-ms-vad-asr-zh-zipformer-ctc-07-03]| |使用 [SenseVoice][SenseVoice] 进行 VAD + 语音识别 (中文 + 英文 + 韩语 + 日语 + 粤语)|[点击此处][wasm-hf-vad-asr-zh-en-ko-ja-yue-sense-voice]| [地址][wasm-ms-vad-asr-zh-en-ko-ja-yue-sense-voice]| |使用 [Whisper][Whisper] tiny.en 进行 VAD + 语音识别 (英文)|[点击此处][wasm-hf-vad-asr-en-whisper-tiny-en]| [地址][wasm-ms-vad-asr-en-whisper-tiny-en]| |使用 [Moonshine tiny][Moonshine tiny] 进行 VAD + 语音识别 (英文)|[点击此处][wasm-hf-vad-asr-en-moonshine-tiny-en]| [地址][wasm-ms-vad-asr-en-moonshine-tiny-en]| |使用基于 [GigaSpeech][GigaSpeech] 训练的 Zipformer 进行 VAD + 语音识别 (英文) |[点击此处][wasm-hf-vad-asr-en-zipformer-gigaspeech]| [地址][wasm-ms-vad-asr-en-zipformer-gigaspeech]| |使用基于 [WenetSpeech][WenetSpeech] 训练的 Zipformer 进行 VAD + 语音识别 (中文) |[点击此处][wasm-hf-vad-asr-zh-zipformer-wenetspeech]| [地址][wasm-ms-vad-asr-zh-zipformer-wenetspeech]| |使用基于 [ReazonSpeech][ReazonSpeech] 训练的 Zipformer 进行 VAD + 语音识别 (日语)|[点击此处][wasm-hf-vad-asr-ja-zipformer-reazonspeech]| [地址][wasm-ms-vad-asr-ja-zipformer-reazonspeech]| |使用基于 [GigaSpeech2][GigaSpeech2] 训练的 Zipformer 进行 VAD + 语音识别 (泰语) |[点击此处][wasm-hf-vad-asr-th-zipformer-gigaspeech2]| [地址][wasm-ms-vad-asr-th-zipformer-gigaspeech2]| |使用 [TeleSpeech-ASR][TeleSpeech-ASR] CTC 模型进行 VAD + 语音识别 (中文 多种方言)|[点击此处][wasm-hf-vad-asr-zh-telespeech]| [地址][wasm-ms-vad-asr-zh-telespeech]| |使用 Paraformer-large 进行 VAD + 语音识别 (英文 + 中文, 及多种中文方言) |[点击此处][wasm-hf-vad-asr-zh-en-paraformer-large]| [地址][wasm-ms-vad-asr-zh-en-paraformer-large]| |使用 Paraformer-small 进行 VAD + 语音识别 (英文 + 中文, 及多种中文方言) |[点击此处][wasm-hf-vad-asr-zh-en-paraformer-small]| [地址][wasm-ms-vad-asr-zh-en-paraformer-small]| |使用 [Dolphin][Dolphin]-base 进行 VAD + 语音识别 (多语种及多种中文方言) |[点击此处][wasm-hf-vad-asr-multi-lang-dolphin-base]| [地址][wasm-ms-vad-asr-multi-lang-dolphin-base]| |语音合成 (Piper, 英文) |[点击此处][wasm-hf-tts-piper-en]| [地址][wasm-ms-tts-piper-en]| |语音合成 (Piper, 德语) |[点击此处][wasm-hf-tts-piper-de]| [地址][wasm-ms-tts-piper-de]| |语音合成 (Matcha, 中文) |[点击此处][wasm-hf-tts-matcha-zh]| [地址][wasm-ms-tts-matcha-zh]| |语音合成 (Matcha, 英文) |[点击此处][wasm-hf-tts-matcha-en]| [地址][wasm-ms-tts-matcha-en]| |语音合成 (Matcha, 中文+英文) |[点击此处][wasm-hf-tts-matcha-zh-en]| [地址][wasm-ms-tts-matcha-zh-en]| |说话人分离 |[点击此处][wasm-hf-speaker-diarization]|[地址][wasm-ms-speaker-diarization]|您可以在下表中找到本仓库的预编译 Android APK

| 描述 | URL | 中国用户 | |----------------------------------------|------------------------------------|-----------------------------------| | 说话人分离 | [Address][apk-speaker-diarization] | [点此][apk-speaker-diarization-cn]| | 流式语音识别 | [Address][apk-streaming-asr] | [点此][apk-streaming-asr-cn] | | 模拟流式语音识别 | [Address][apk-simula-streaming-asr]| [点此][apk-simula-streaming-asr-cn]| | 文字转语音 | [Address][apk-tts] | [点此apk-tts-cn] | | 语音活动检测 (VAD) | [Address][apk-vad] | [点此][apk-vad-cn] | | VAD + 非流式语音识别 | [Address][apk-vad-asr] | [点此][apk-vad-asr-cn] | | 两遍语音识别 | [Address][apk-2pass] | [点此][apk-2pass-cn] | | 音频标记 | [Address][apk-at] | [点此][apk-at-cn] | | 音频标记 (WearOS) | [Address][apk-at-wearos] | [点此][apk-at-wearos-cn] | | 说话人识别 | [Address][apk-sid] | [点此][apk-sid-cn] | | 口语语言识别 | [Address][apk-slid] | [点此][apk-slid-cn] | | 关键词检测 | [Address][apk-kws] | [点此][apk-kws-cn] |

#### 实时语音识别

| 描述 | URL | 中国用户 |

|--------------------------------|-------------------------------------|-------------------------------------|

| 流式语音识别 | [Address][apk-flutter-streaming-asr]| [点此][apk-flutter-streaming-asr-cn]|

#### 文字转语音

| 描述 | URL | 中国用户 |

|------------------------------------------|------------------------------------|------------------------------------|

| Android (arm64-v8a, armeabi-v7a, x86_64) | [Address][flutter-tts-android] | [点此][flutter-tts-android-cn] |

| Linux (x64) | [Address][flutter-tts-linux] | [点此][flutter-tts-linux-cn] |

| macOS (x64) | [Address][flutter-tts-macos-x64] | [点此][flutter-tts-macos-x64-cn] |

| macOS (arm64) | [Address][flutter-tts-macos-arm64] | [点此][flutter-tts-macos-arm64-cn] |

| Windows (x64) | [Address][flutter-tts-win-x64] | [点此][flutter-tts-win-x64-cn] |

### 预编译 Lazarus APP 链接

#### 生成字幕

| 描述 | URL | 中国用户 |

|--------------------------------|----------------------------|----------------------------|

| 生成字幕 (生成字幕) | [Address][lazarus-subtitle]| [点此][lazarus-subtitle-cn]|

### 预训练模型链接

| 描述 | URL |

|---------------------------------------------|---------------------------------------------------------------------------------------|

| 语音识别 (speech to text, ASR) | [Address][asr-models] |

| 文字转语音 (TTS) | [Address][tts-models] |

| VAD | [Address][vad-models] |

| 关键词检测 | [Address][kws-models] |

| 音频标记 | [Address][at-models] |

| 说话人识别 (Speaker ID) | [Address][sid-models] |

| 口语语言识别 (Language ID)| 参见 [语音识别][asr-models] 中的多语言 [Whisper][Whisper] ASR 模型|

| 标点 | [Address][punct-models] |

| 说话人分割 | [Address][speaker-segmentation-models] |

| 语音增强 | [Address][speech-enhancement-models] |

| 音源分离 | [Address][source-separation-models] |

#### 部分预训练 ASR 模型 (流式)

请参见

-

-

-

以获取更多模型。下表仅列出了其中的**一部分**。

|名称 | 支持语言| 描述|

|-----|-----|----|

|[sherpa-onnx-streaming-zipformer-bilingual-zh-en-2023-02-20][sherpa-onnx-streaming-zipformer-bilingual-zh-en-2023-02-20]| 中文, 英语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/online-transducer/zipformer-transducer-models.html#csukuangfj-sherpa-onnx-streaming-zipformer-bilingual-zh-en-2023-02-20-bilingual-chinese-english)|

|[sherpa-onnx-streaming-zipformer-small-bilingual-zh-en-2023-02-16][sherpa-onnx-streaming-zipformer-small-bilingual-zh-en-2023-02-16]| 中文, 英语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/online-transducer/zipformer-transducer-models.html#sherpa-onnx-streaming-zipformer-small-bilingual-zh-en-2023-02-16-bilingual-chinese-english)|

|[sherpa-onnx-streaming-zipformer-zh-14M-2023-02-23][sherpa-onnx-streaming-zipformer-zh-14M-2023-02-23]|中文| 适用于 Cortex A7 CPU。参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/online-transducer/zipformer-transducer-models.html#sherpa-onnx-streaming-zipformer-zh-14m-2023-02-23)|

|[sherpa-onnx-streaming-zipformer-en-20M-2023-02-17][sherpa-onnx-streaming-zipformer-en-20M-2023-02-17]|英语|适用于 Cortex A7 CPU。参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/online-transducer/zipformer-transducer-models.html#sherpa-onnx-streaming-zipformer-en-20m-2023-02-17)|

|[sherpa-onnx-streaming-zipformer-korean-2024-06-16][sherpa-onnx-streaming-zipformer-korean-2024-06-16]|韩语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/online-transducer/zipformer-transducer-models.html#sherpa-onnx-streaming-zipformer-korean-2024-06-16-korean)|

|[sherpa-onnx-streaming-zipformer-fr-2023-04-14][sherpa-onnx-streaming-zipformer-fr-2023-04-14]|法语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/online-transducer/zipformer-transducer-models.html#shaojieli-sherpa-onnx-streaming-zipformer-fr-2023-04-14-french)|

#### 部分预训练 ASR 模型 (非流式)

请参见

-

-

-

-

-

以获取更多模型。下表仅列出了其中的**一部分**。

|名称 | 支持语言| 描述|

|-----|-----|----|

|[sherpa-onnx-nemo-parakeet-tdt-0.6b-v2-int8](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-transducer/nemo-transducer-models.html#sherpa-onnx-nemo-parakeet-tdt-0-6b-v2-int8-english)| 英语 | 转换自 |

|[Whisper tiny.en](https://github.com/k2-fsa/sherpa-onnx/releases/download/asr-models/sherpa-onnx-whisper-tiny.en.tar.bz2)|英语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/whisper/tiny.en.html)|

|[Moonshine tiny][Moonshine tiny]|英语|参见 [此处](https://github.com/usefulsensors/moonshine)|

|[sherpa-onnx-zipformer-ctc-zh-int8-2025-07-03](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-ctc/icefall/zipformer.html#sherpa-onnx-zipformer-ctc-zh-int8-2025-07-03-chinese)|中文| 一个 Zipformer CTC 模型|

|[sherpa-onnx-sense-voice-zh-en-ja-ko-yue-2024-07-17][sherpa-onnx-sense-voice-zh-en-ja-ko-yue-2024-07-17]|中文, 粤语, 英语, 韩语, 日语| 支持多种中文方言。参见 [此处](https://k2-fsa.github.io/sherpa/onnx/sense-voice/index.html)|

|[sherpa-onnx-paraformer-zh-2024-03-09][sherpa-onnx-paraformer-zh-2024-03-09]|中文, 英语| 也支持多种中文方言。参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-paraformer/paraformer-models.html#csukuangfj-sherpa-onnx-paraformer-zh-2024-03-09-chinese-english)|

|[sherpa-onnx-zipformer-ja-reazonspeech-2024-08-01][sherpa-onnx-zipformer-ja-reazonspeech-2024-08-01]|日语|参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-transducer/zipformer-transducer-models.html#sherpa-onnx-zipformer-ja-reazonspeech-2024-08-01-japanese)|

|[sherpa-onnx-nemo-transducer-giga-am-russian-2024-10-24][sherpa-onnx-nemo-transducer-giga-am-russian-2024-10-24]|俄语|参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-transducer/nemo-transducer-models.html#sherpa-onnx-nemo-transducer-giga-am-russian-2024-10-24-russian)|

|[sherpa-onnx-nemo-ctc-giga-am-russian-2024-10-24][sherpa-onnx-nemo-ctc-giga-am-russian-2024-10-24]|俄语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-ctc/nemo/russian.html#sherpa-onnx-nemo-ctc-giga-am-russian-2024-10-24)|

|[sherpa-onnx-zipformer-ru-2024-09-18][sherpa-onnx-zipformer-ru-2024-09-18]|俄语|参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-transducer/zipformer-transducer-models.html#sherpa-onnx-zipformer-ru-2024-09-18-russian)|

|[sherpa-onnx-zipformer-korean-2024-06-24][sherpa-onnx-zipformer-korean-2024-06-24]|韩语|参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-transducer/zipformer-transducer-models.html#sherpa-onnx-zipformer-korean-2024-06-24-korean)|

|[sherpa-onnx-zipformer-thai-2024-06-20][sherpa-onnx-zipformer-thai-2024-06-20]|泰语| 参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/offline-transducer/zipformer-transducer-models.html#sherpa-onnx-zipformer-thai-2024-06-20-thai)|

|[sherpa-onnx-telespeech-ctc-int8-zh-2024-06-04][sherpa-onnx-telespeech-ctc-int8-zh-2024-06-04]|中文| 支持多种方言。参见 [此处](https://k2-fsa.github.io/sherpa/onnx/pretrained_models/telespeech/models.html#sherpa-onnx-telespeech-ctc-int8-zh-2024-06-04)|

### 实用链接

- 文档: https://k2-fsa.github.io/sherpa/onnx/

- Bilibili 演示视频: https://search.bilibili.com/all?keyword=%E6%96%B0%E4%B8%80%E4%BB%A3Kaldi

### 联系我们

请参见

https://k2-fsa.github.io/sherpa/social-groups.html

了解 新一代 Kaldi **微信交流群** 和 **QQ 交流群**。

## 使用 sherpa-onnx 的项目

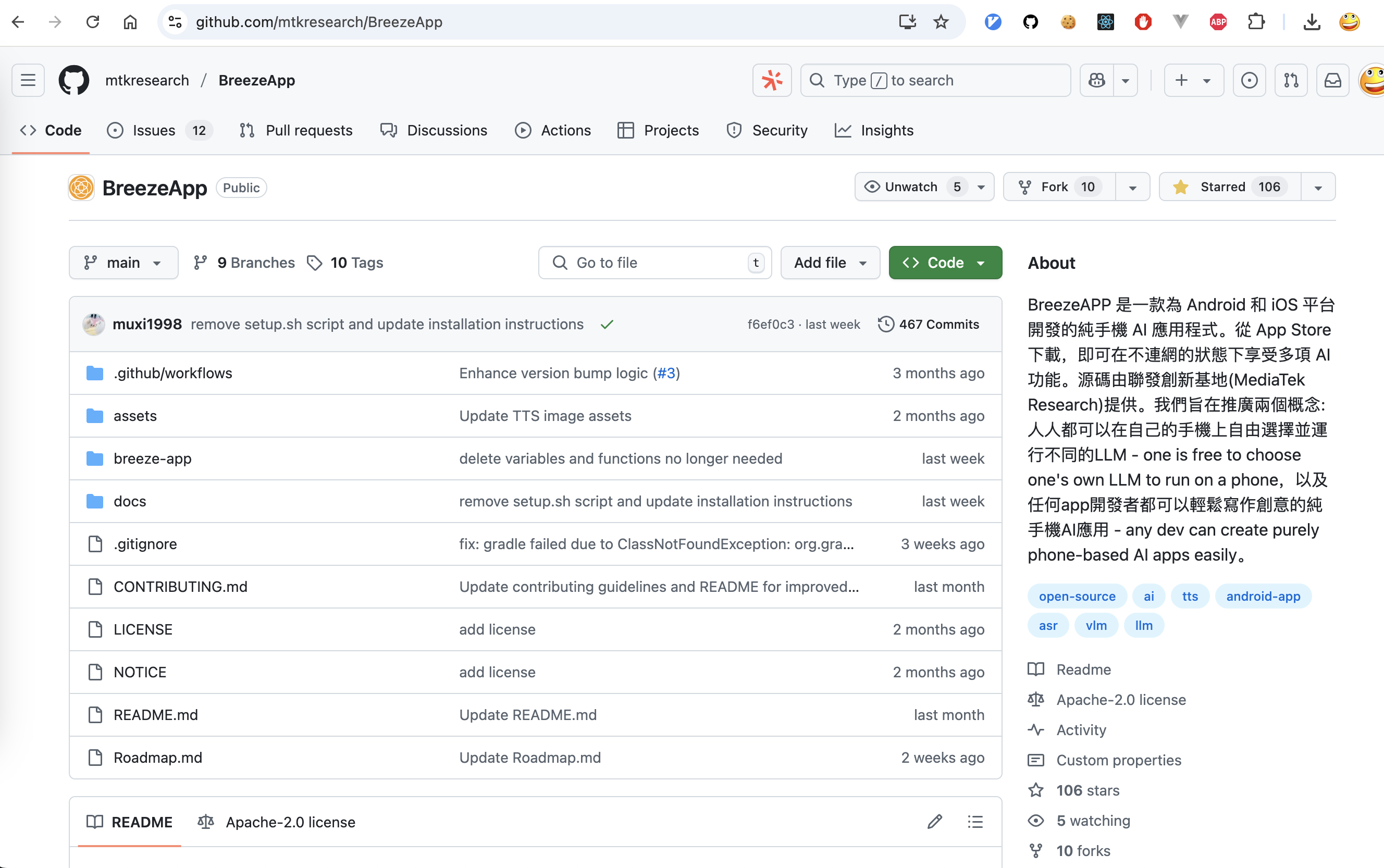

### 来自 [MediaTek Research](https://github.com/mtkresearch) 的 [BreezeApp](https://github.com/mtkresearch/BreezeApp)

- [下载 BreezeAPP APK](https://huggingface.co/MediaTek-Research/BreezeApp/resolve/main/BreezeApp.apk)

- [APK 中国镜像](https://hf-mirror.com/MediaTek-Research/BreezeApp/blob/main/BreezeApp.apk)

| 1 | 2 | 3 |

|---|---|---|

||||

### [Open-LLM-VTuber](https://github.com/t41372/Open-LLM-VTuber)

与任何 LLM 进行免提语音交互、语音打断以及跨平台本地运行的 Live2D 虚拟形象

另见 基于 FastAPI 的流式 ASR 和 TTS

它展示了如何在 FastAPI 中使用 ASR 和 TTS Python API。标签:AI工具, Android开发, C++, iOS开发, JS文件枚举, Next-gen Kaldi, NPU加速, ONNX Runtime, Python, RISC-V, Sherpa, WebSocket, 依赖分析, 关键词检测, 可视化界面, 声源分离, 声纹识别, 嵌入式系统, 数据擦除, 无后门, 日志审计, 物联网, 离线推理, 端侧AI, 自动标点, 自动语音识别, 语种识别, 语音合成, 语音增强, 语音活动检测, 说话人分离, 逆向工具, 音频打标, 鸿蒙系统