Walentino/ai-triage-bot

GitHub: Walentino/ai-triage-bot

基于 Claude 3 Haiku 的 SOC 分诊助手,将 AWS CloudTrail 原始事件自动转化为包含 MITRE 映射和处置建议的结构化摘要,大幅缩短安全分析师的事件理解时间。

Stars: 0 | Forks: 0

# AI 辅助分诊机器人

**一个由 LLM 驱动的 SOC 分析师助手,可将原始 CloudTrail 事件转化为结构化的事件响应摘要。**

## 概述

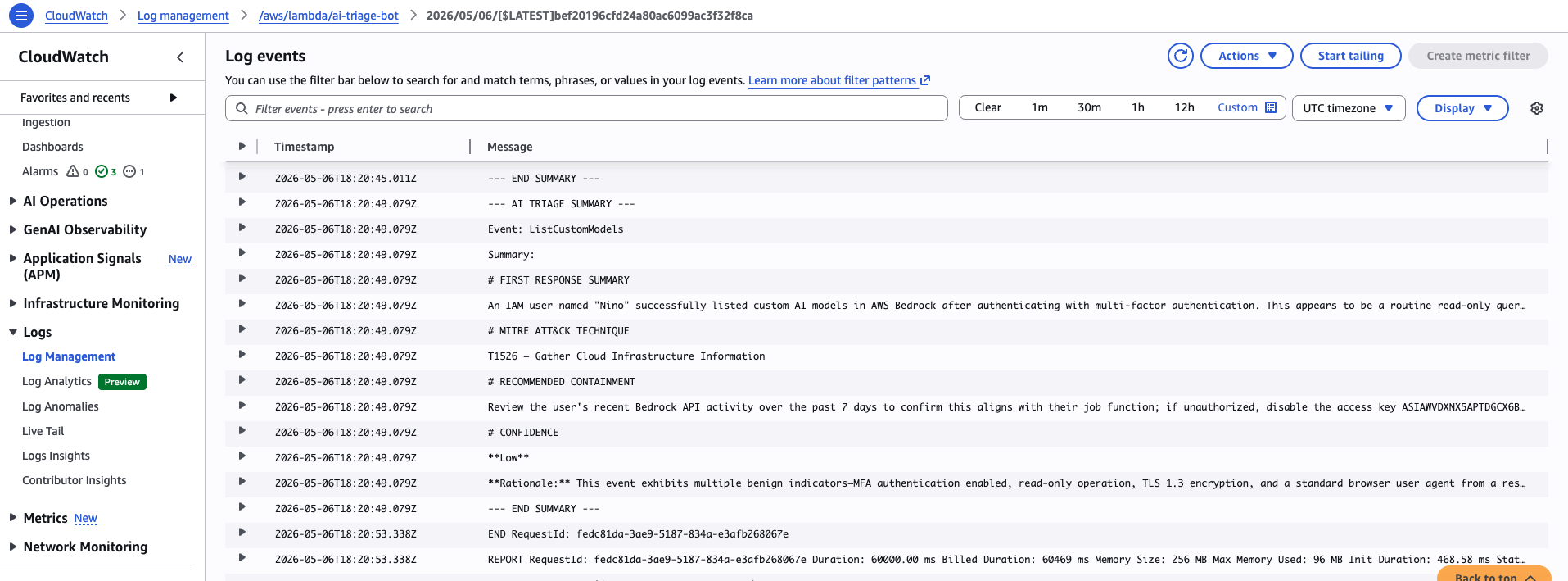

本项目通过 Amazon Bedrock 将 Claude 3 Haiku 集成到安全运营工作流中。原始的 AWS CloudTrail JSON 事件会通过结构化的系统提示词发送给 LLM。模型随后会返回一份纯英文摘要、MITRE ATT&CK 映射、遏制建议以及置信度评级。

## 架构

AWS CloudTrail -> S3 Bucket -> SQS Queue -> Lambda -> Amazon Bedrock -> 结构化分诊摘要

## 组件

| 组件 | 用途 |

|-----------|---------|

| Amazon SQS | 接收 S3 事件通知 |

| AWS Lambda | 下载日志,格式化提示词,调用 Bedrock |

| Amazon Bedrock | Claude 3 Haiku 分析事件 |

| CloudWatch Logs | 捕获 AI 生成的摘要 |

## 提示词工程

四大设计原则:结构化输出、纯英文、安全护栏(绝不盲目猜测高置信度)、可执行的指导建议。

## 示例输出

事件:ListProvisionedModelThroughputs

摘要:一名 IAM 用户查询了 Bedrock 模型吞吐量。属于只读操作,已通过 MFA 身份验证,看起来属于正常行为。

MITRE ATT&CK:T1526

遏制建议:向用户或其主管核实授权情况。

置信度:低,并附有明确的推理过程。

## 横向对比

| 标准 | 原始 JSON | AI 摘要 |

|----------|----------|------------|

| 长度 | 2000+ 字符 | 300 字符 |

| 非技术人员可读 | 否 | 是 |

| 理解所需时间 | 3-5 分钟 | 15 秒 |

| MITRE 映射 | 否 | 是 |

| 遏制指导 | 无 | 具体明确 |

## 遇到的问题

1. Anthropic SDK 的 pydantic_core 二进制文件不兼容。修复方法:切换至 Bedrock SDK。

2. Bedrock 模型 ID 被拒绝。修复方法:结合推理配置文件使用 Claude 3 Haiku。

3. SQS 消息格式不匹配。修复方法:多格式解析。

4. Lambda 在 60 秒时超时。修复方法:将超时时间增加至 120 秒。

## 局限性

本系统为概念验证。LLM 生成的摘要是分诊的加速工具,不能替代分析师的判断。模型可能会产生关于 MITRE 映射的幻觉。

## 展现的技能

AI/ML 集成、Serverless 架构、安全自动化、AWS Bedrock、提示词工程

## 成本摘要

Lambda:免费套餐 | Bedrock:低于 $0.01 | SQS:免费套餐 | S3:低于 $0.01 | 总计:低于 $0.02

## 截图

标签:AI助手, Amazon Bedrock, Amazon SQS, Amazon Web Services, AMSI绕过, ATT&CK框架, AWS, AWS Lambda, Claude 3 Haiku, Cloudflare, CloudTrail, DLL 劫持, DPI, LLM, LSASS转储, MITRE ATT&CK, Python, SecOps, Serverless, Unmanaged PE, 云安全架构, 大语言模型, 威胁检测, 安全情报, 安全运营中心, 提示词工程, 无后门, 漏洞探索, 策略决策点, 网络安全, 网络映射, 自动化分诊, 足迹分析, 隐私保护