Okaeyboy0/FaceGuard-CyberAI

GitHub: Okaeyboy0/FaceGuard-CyberAI

一个基于 PyTorch 的 AI 面部识别攻防系统,展示对抗攻击与防御在红蓝队评估中的实际效果。

Stars: 0 | Forks: 0

# FaceGuard-CyberAI 🔐

FaceGuard 是一个基于人工智能的面部识别安全系统,采用 **红队与蓝队** 的网络安全评估方法。

## 🚀 项目概述

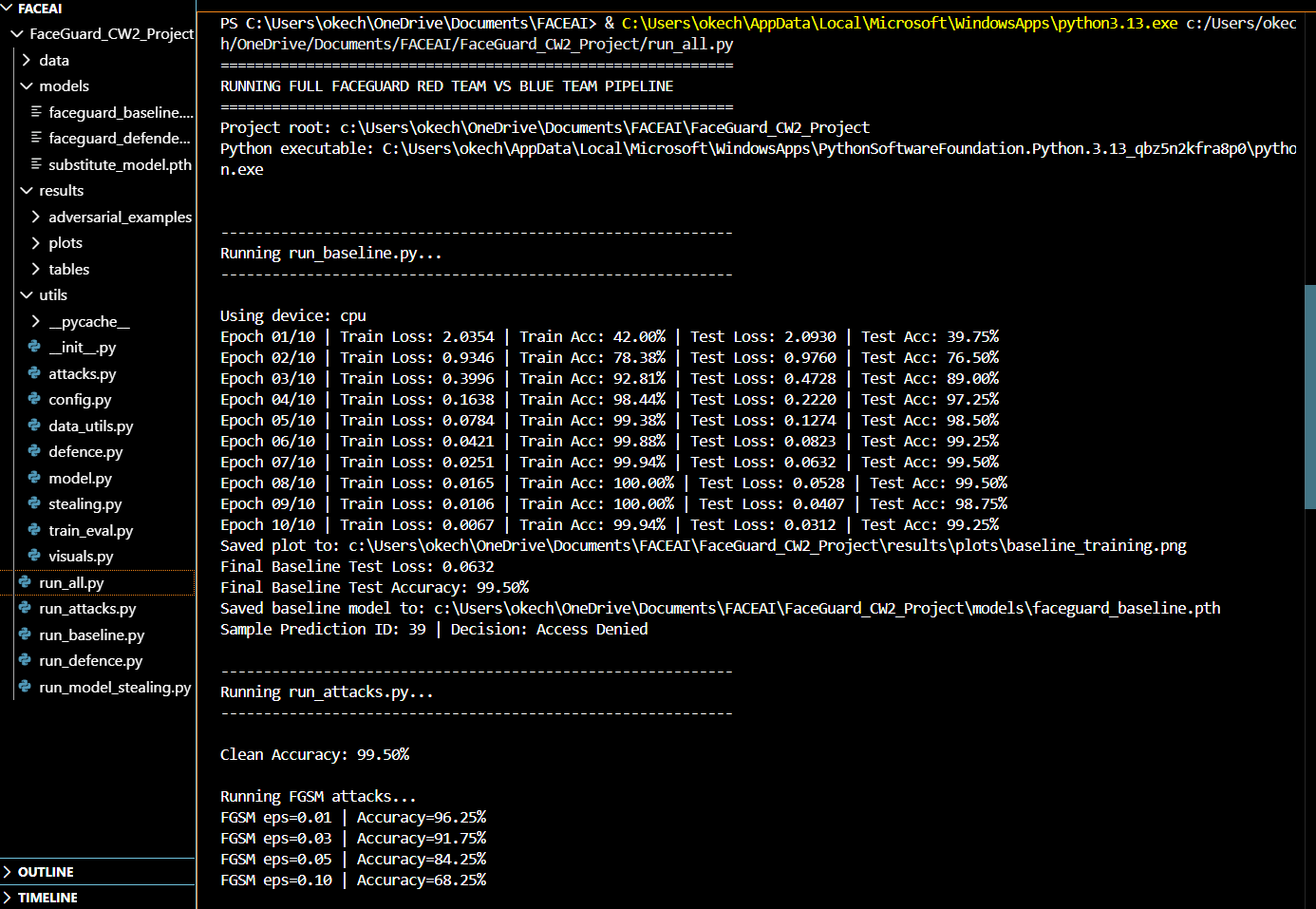

本项目展示了如何对高准确率的面部识别模型进行以下操作:

- 使用对抗机器学习技术进行攻击

- 通过模型窃取进行复制

- 使用对抗训练进行强化

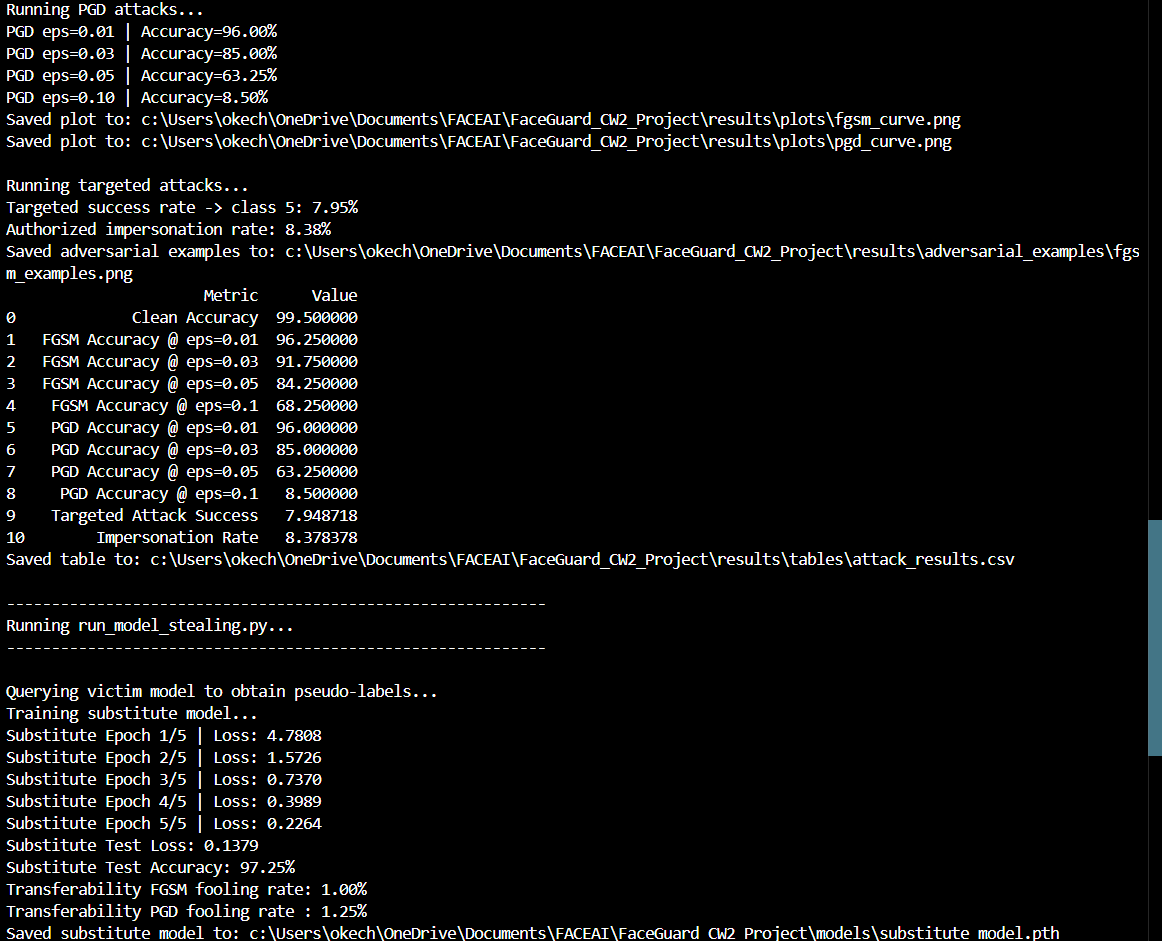

## ⚔️ 红队(攻击)

- FGSM(快速梯度符号法)

- PGD(投影梯度下降)

- 针对性伪装攻击

- 模型窃取(替代模型)

- 可转移性分析

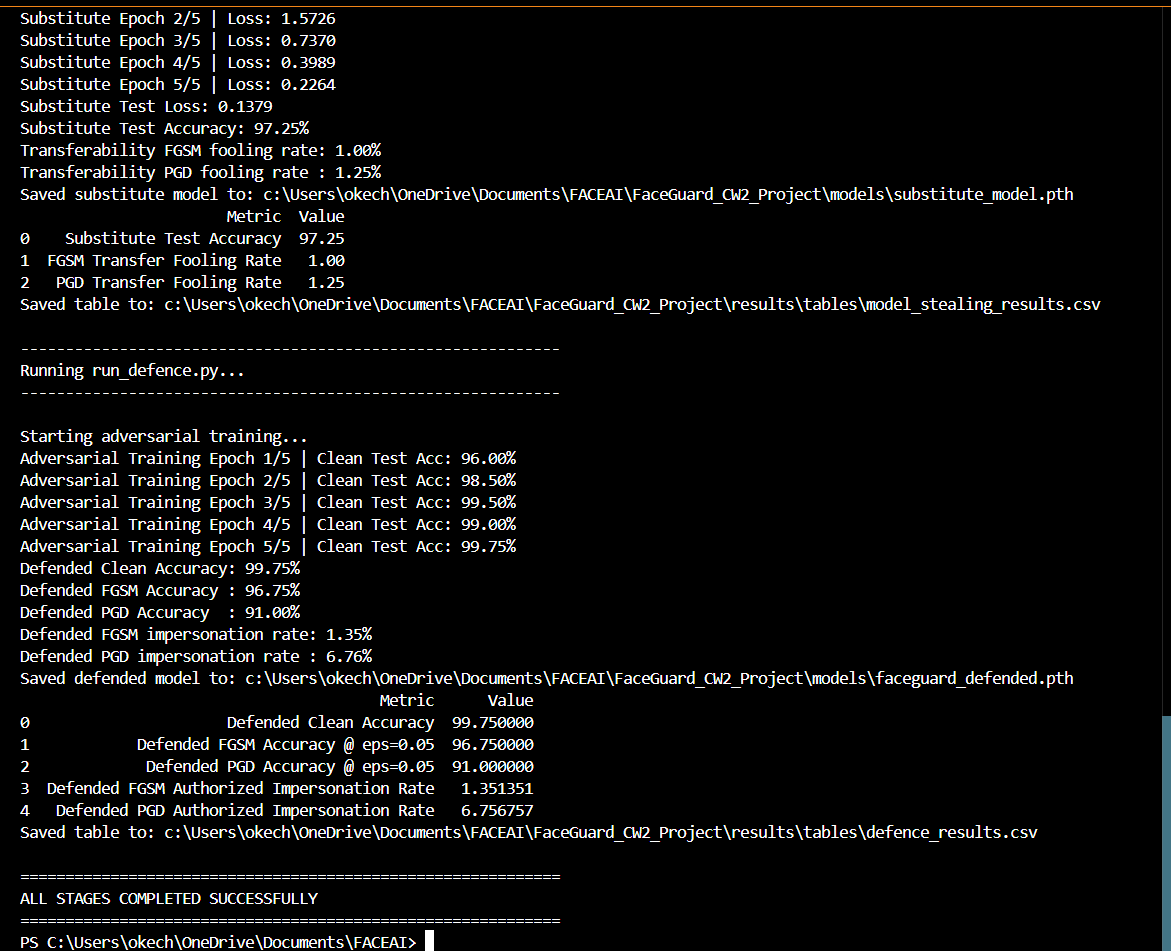

## 🛡️ 蓝队(防御)

- 对抗训练

- 提升对攻击的鲁棒性

- 降低伪装风险

## 📊 结果

- **基准准确率:** 99.50%

- **PGD 攻击准确率(ε=0.10):** 8.50%

- **替代模型准确率:** 97.25%

- **防御后 PGD 准确率(ε=0.05):** 91.00%

## 🧠 关键洞察

即使高度准确的 AI 系统也可能面临对抗攻击的风险,但适当的防御技术可以显著提升鲁棒性和安全性。

## 🛠️ 技术栈

- Python

- PyTorch

- NumPy

- Matplotlib

- scikit-learn

## 📁 项目结构

## ▶️ 运行方法

```

python run_all.py

AI facial recognition system tested with adversarial attacks and defence (FGSM, PGD, model stealing, adversarial training)

```

# FaceGuard-CyberAI 🔐

FaceGuard 是一个基于人工智能的面部识别安全系统,采用 **红队与蓝队** 的网络安全评估方法。

## 🚀 项目概述

本项目展示了如何对高准确率的面部识别模型进行以下操作:

- 使用对抗机器学习技术进行攻击

- 通过模型窃取进行复制

- 使用对抗训练进行强化

## ⚔️ 红队(攻击)

- FGSM(快速梯度符号法)

- PGD(投影梯度下降)

- 针对性伪装攻击

- 模型窃取(替代模型)

- 可转移性分析

## 🛡️ 蓝队(防御)

- 对抗训练

- 提升对攻击的鲁棒性

- 降低伪装风险

## 📊 结果

- **基准准确率:** 99.50%

- **PGD 攻击准确率(ε=0.10):** 8.50%

- **替代模型准确率:** 97.25%

- **防御后 PGD 准确率(ε=0.05):** 91.00%

## 🧠 关键洞察

即使高度准确的 AI 系统也可能面临对抗攻击的风险,但适当的防御技术可以显著提升鲁棒性和安全性。

## 🛠️ 技术栈

- Python

- PyTorch

- NumPy

- Matplotlib

- scikit-learn

## 📁 项目结构

## ▶️ 运行方法

```

python run_all.py

AI facial recognition system tested with adversarial attacks and defence (FGSM, PGD, model stealing, adversarial training)

```

标签:AI安全, AI面部识别, Chat Copilot, FGSM, Matplotlib, NumPy, PGD, Python, PyTorch, Red Team vs Blue Team, scikit-learn, TGT, 人脸识别, 凭据扫描, 密钥泄露防护, 对抗攻击, 对抗样本, 对抗训练, 攻防演练, 敏感信息检测, 无后门, 机器学习安全, 模型偷窃, 模型窃取, 深度学习, 生物识别安全, 红队蓝队, 网络安全评估, 迁移性分析, 逆向工具, 面部认证安全, 项目实战