nashsu/llm_wiki

GitHub: nashsu/llm_wiki

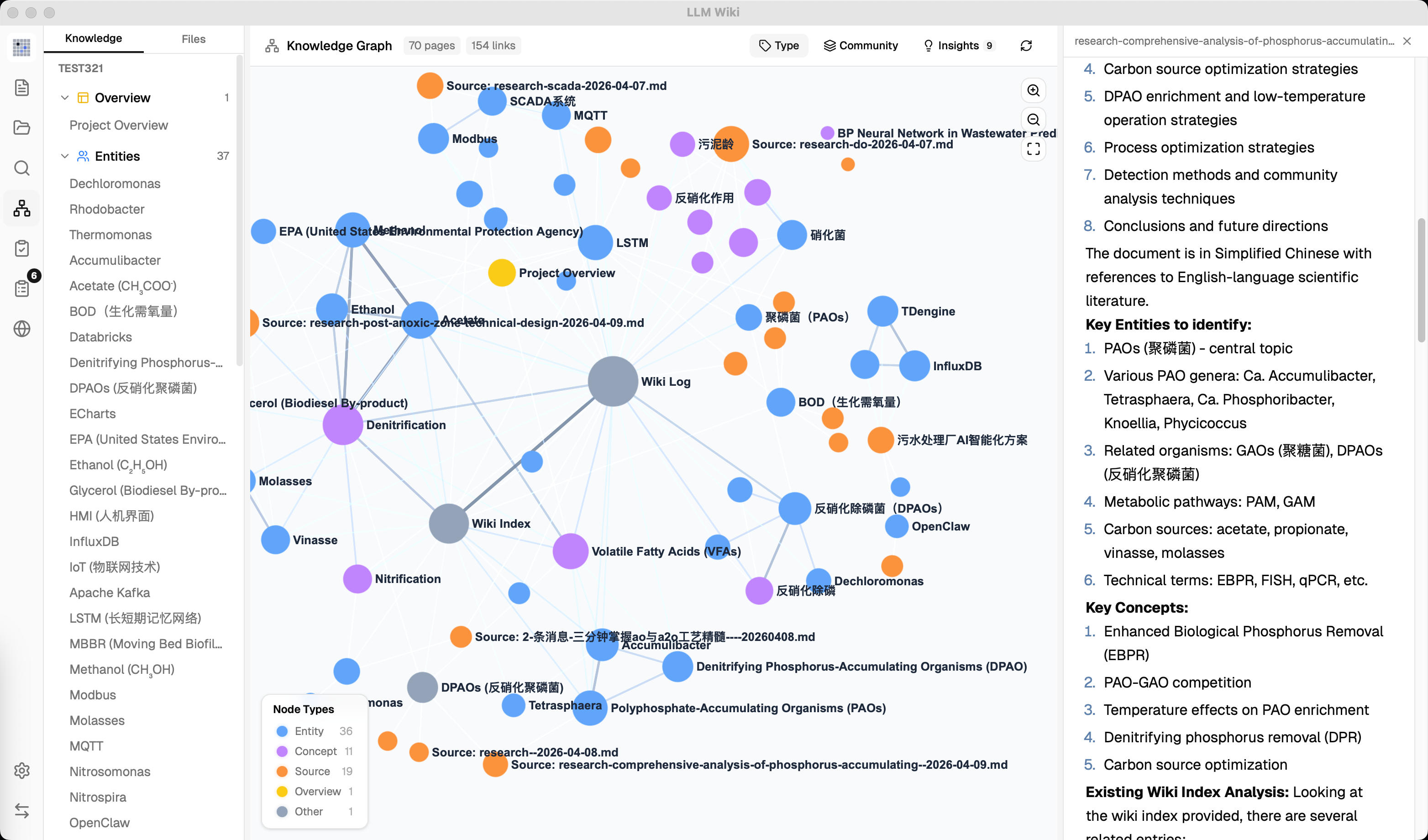

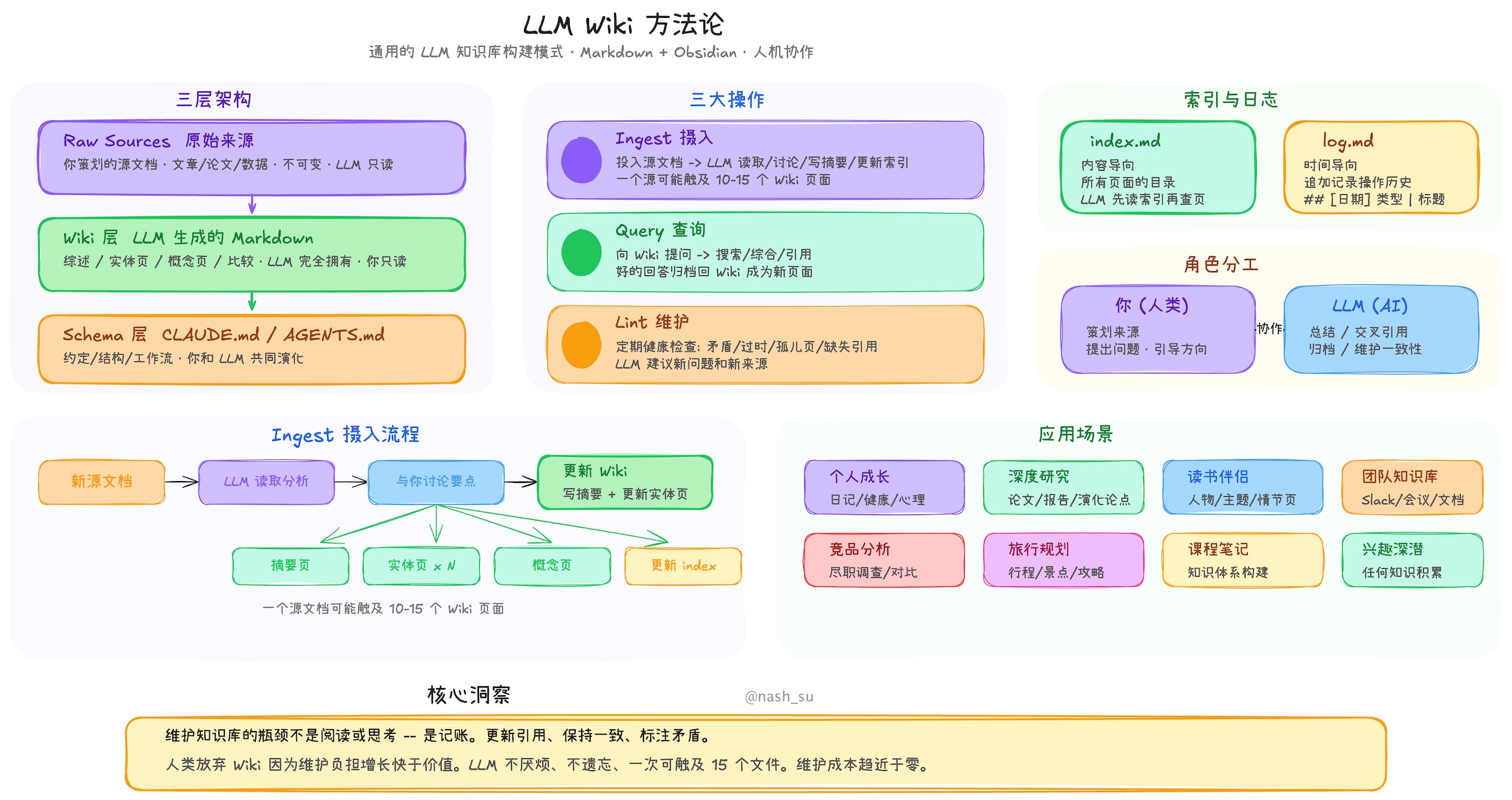

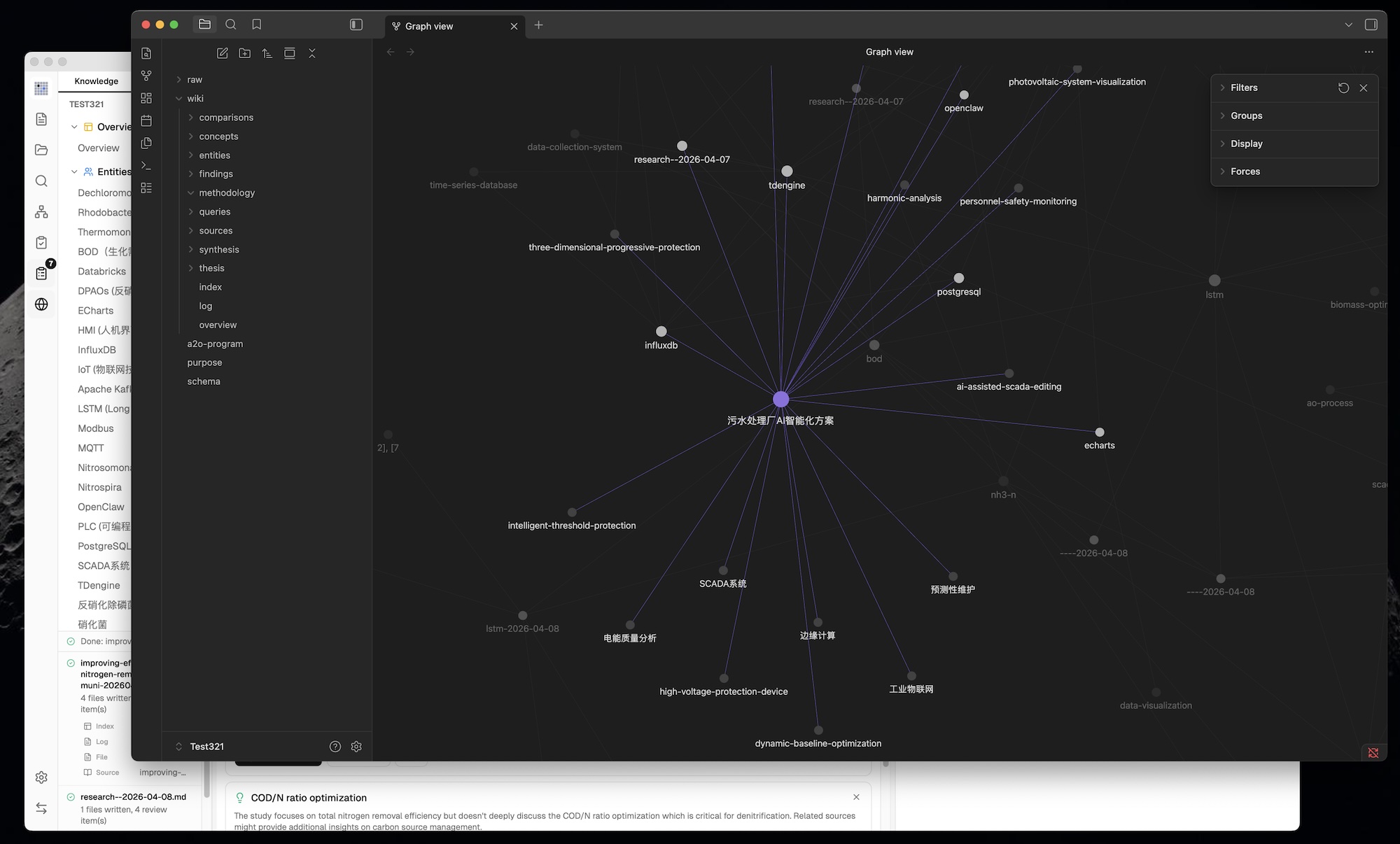

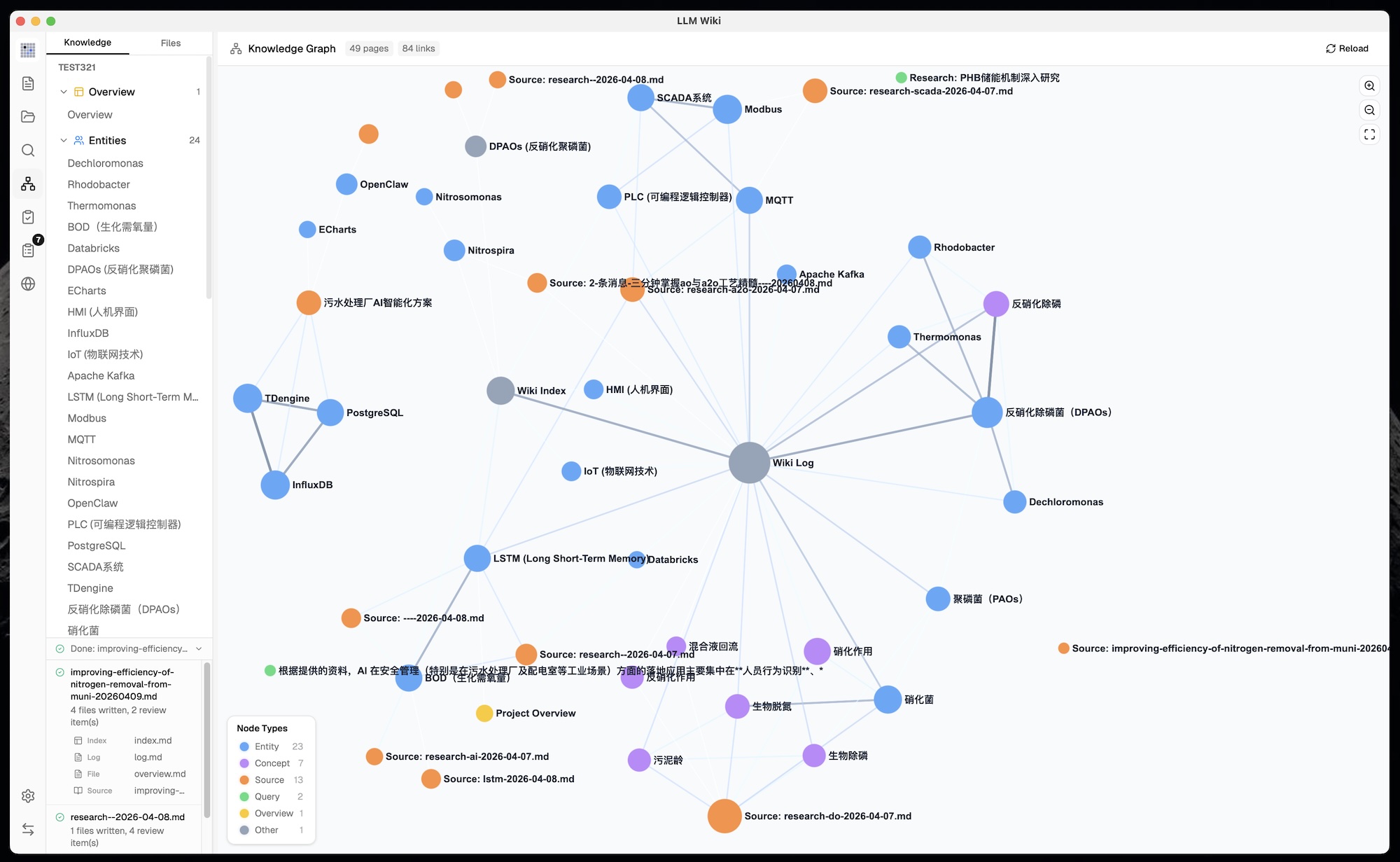

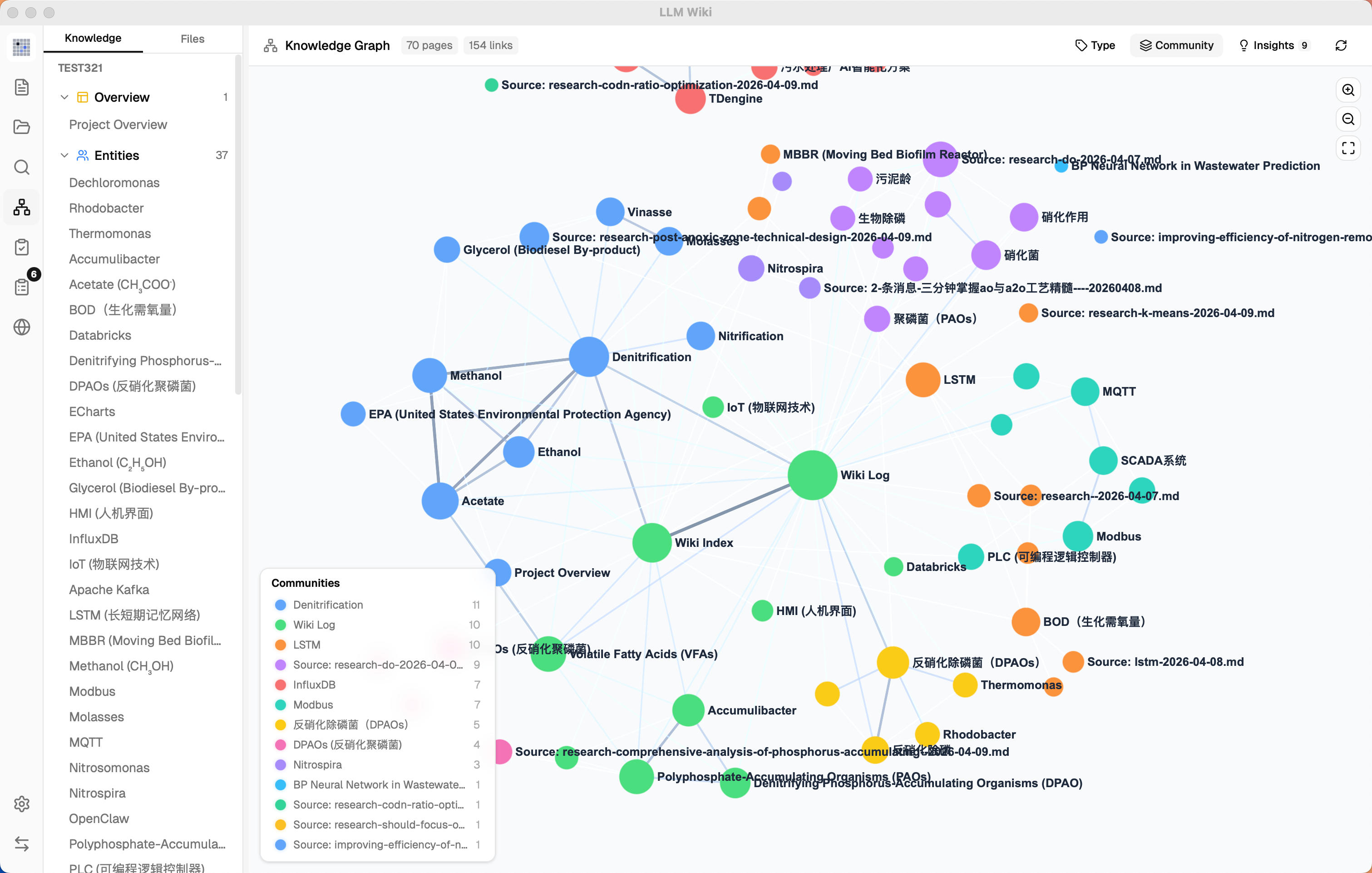

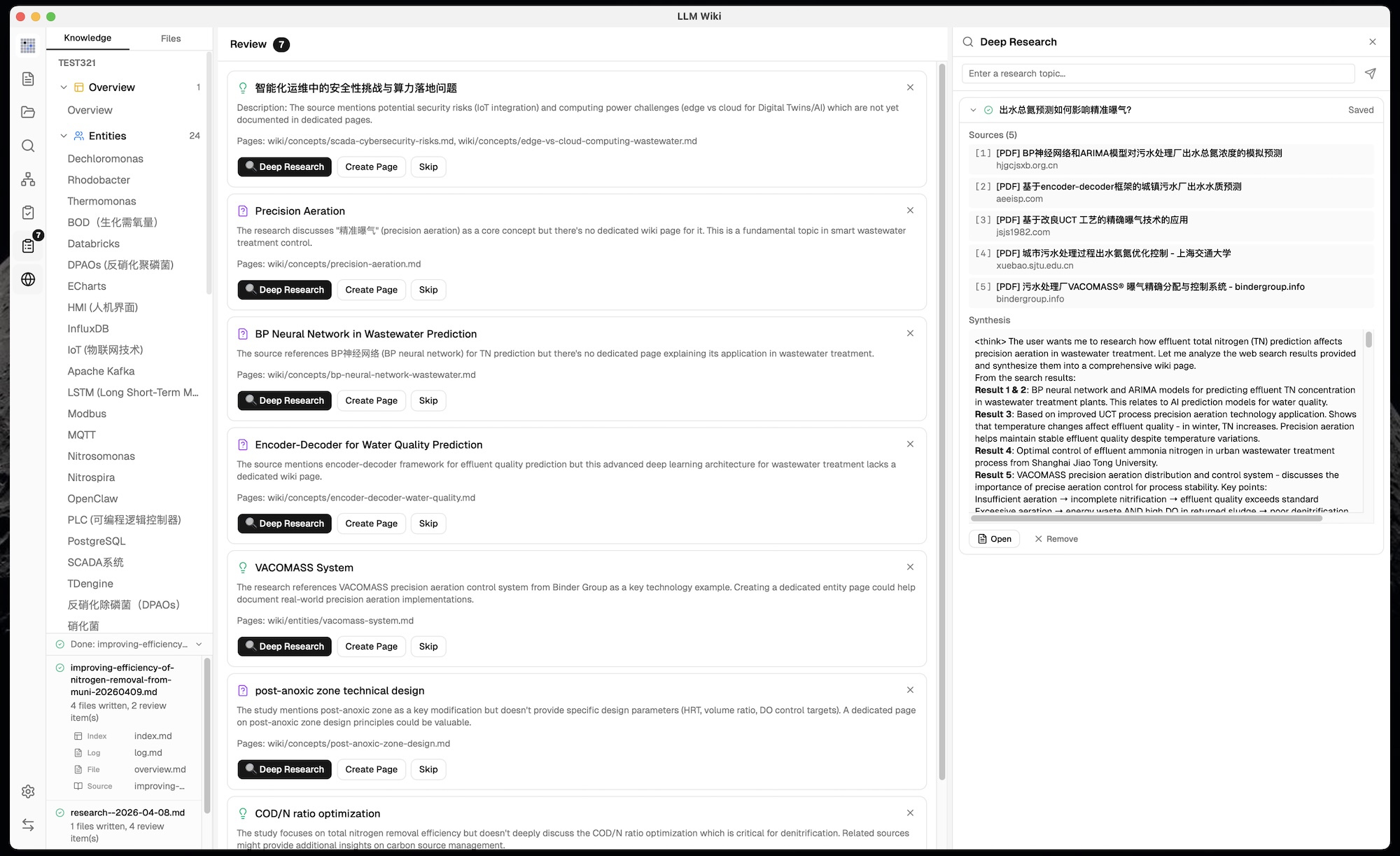

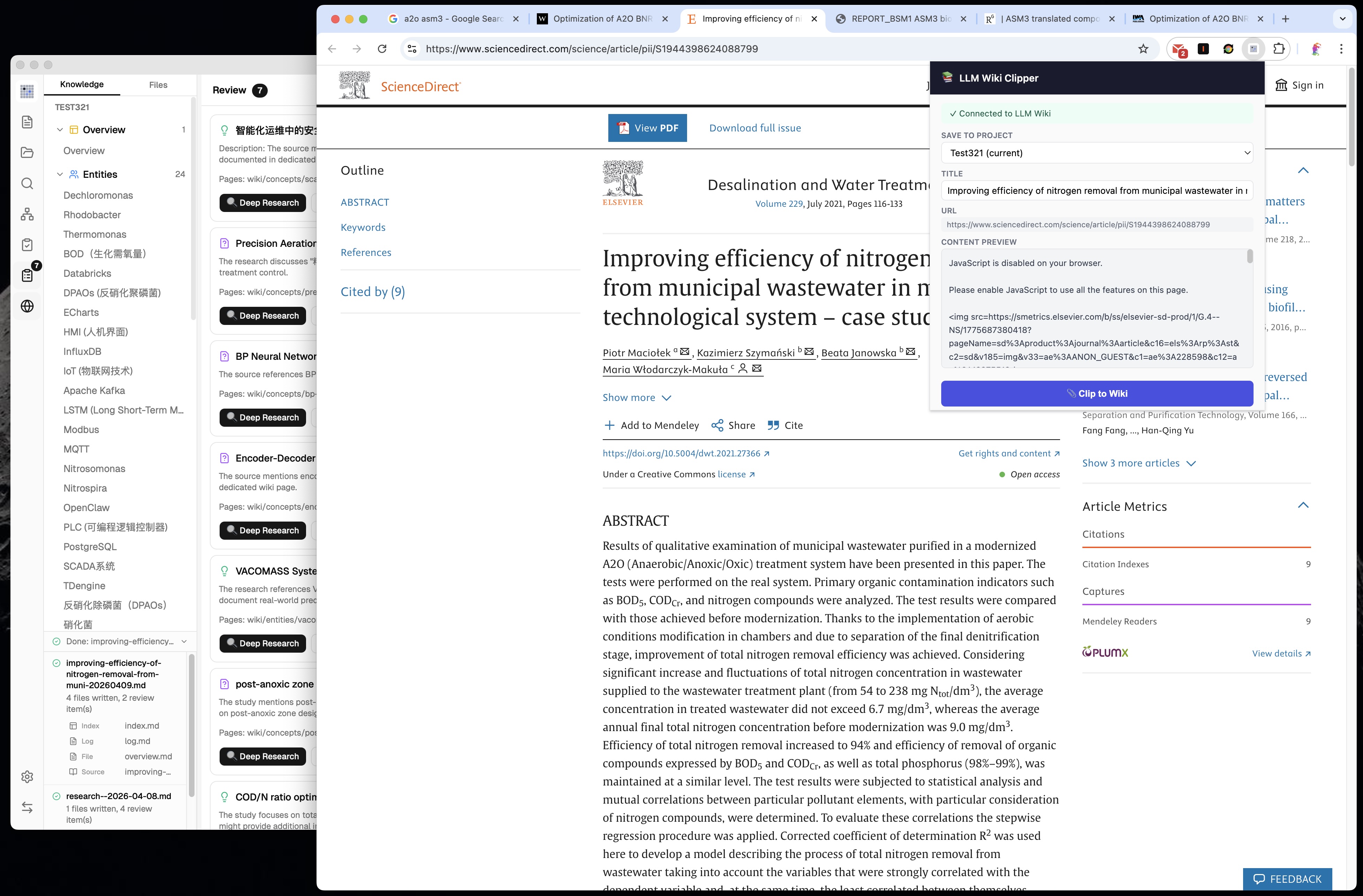

LLM Wiki 是一款基于 LLM 的跨平台桌面应用,能自动将文档转化为持久化、相互链接的知识库,并结合知识图谱和深度研究功能辅助信息整理。

Stars: 623 | Forks: 72

# LLM Wiki

## 许可证

本项目在 **GNU General Public License v3.0** 下获得许可 — 详见 [LICENSE](LICENSE)。

一个自我构建的个人知识库。

LLM 阅读您的文档,构建结构化的 Wiki,并保持其最新状态。

这是什么? • 功能 • 技术栈 • 安装 • 致谢 • 许可证

English | 中文

标签:Adamic-Adar, AI笔记, AI风险缓解, Chrome插件, CoT, DLL 劫持, LLM Wiki, Louvain算法, Petitpotam, RAG, 个人知识库, 可视化界面, 图检索, 增量构建, 大语言模型, 异构信号, 异步审核, 思维链, 文档自动化, 智能问答, 本地知识库, 查询扩展, 检索增强生成, 深度研究, 源码可追溯, 知识管理, 知识聚类, 社区发现, 网页剪藏, 自动化攻击, 跨平台桌面应用, 非结构化数据