suhasini-ai-architect/ai-autonomous-security-mesh

GitHub: suhasini-ai-architect/ai-autonomous-security-mesh

一个基于LangGraph和Llama-3.2的多代理自主安全架构,通过有状态工作流实现威胁检测、取证分析与自愈响应。

Stars: 0 | Forks: 0

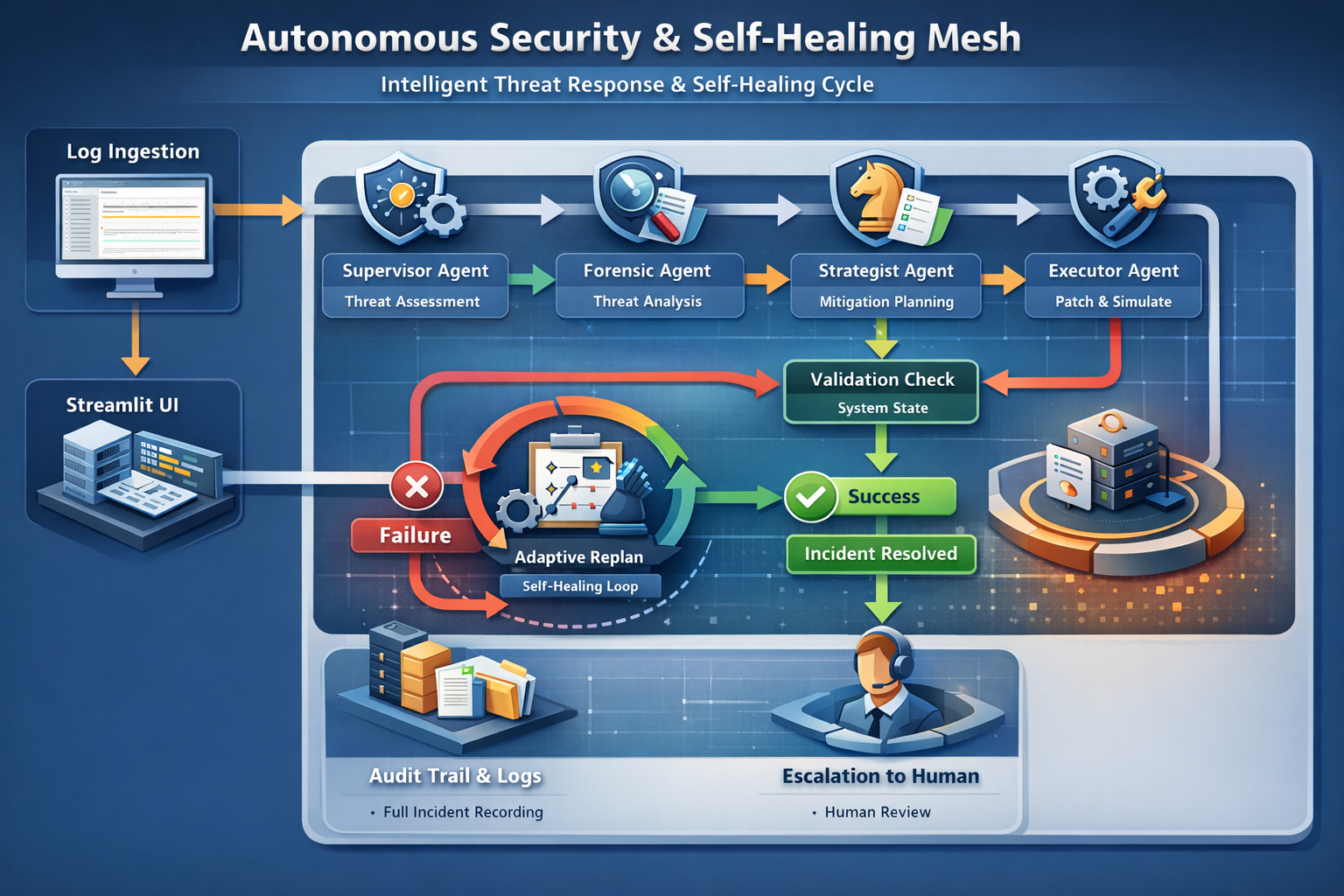

# 自主安全与自愈 AI Mesh

## 概述

本项目演示了一种**面向自主安全运营 的代理式 AI 架构**。它模拟了一个下一代**自愈系统**,能够:

* 检测威胁

* 分析攻击模式

* 生成缓解策略

* 执行补救措施

* 验证结果

* 智能重试(自愈循环)

与传统的基于规则的系统不同,该解决方案使用由 **LangGraph** 驱动的**多代理、有状态工作流**。

## 问题陈述

现代安全运营中心 (SOC) 面临:

* 告警疲劳(高噪音,低信号)

* 人工分流开销

* 事件响应缓慢

* 缺乏自动补救

## 解决方案

一个**自主 AI 首响应系统**,能够:

1. 使用监督代理过滤噪音

2. 执行深度取证分析

3. 生成缓解策略

4. 执行补救步骤

5. 验证结果

6. 如有需要,使用替代策略进行重试

## 架构图

## 实时演示

查看合规审计的运行情况:

## 架构概述

```

graph LR

subgraph UI Layer

A[Streamlit Dashboard]

end

subgraph Orchestration Layer

B[LangGraph State Machine]

end

subgraph Agents

C[Supervisor Agent]

D[Forensic Agent]

E[Strategist Agent]

F[Executor Agent]

end

subgraph AI Layer

G[LLM - Llama 3.x via Ollama]

end

subgraph Observability

H[Audit Logs / State Tracking]

end

A --> B

B --> C

C --> D

D --> E

E --> F

F --> B

C --> G

D --> G

E --> G

B --> H

```

## 核心功能

### 自主分流

* 在昂贵的 LLM 调用之前过滤噪音

* 降低计算成本

### 有状态推理

* 在步骤之间维护上下文

* 跟踪之前的失败和决策

### 自愈循环

* 使用 LangGraph 实现循环执行

* 自动重试失败的补救

### 本地 AI 部署

* 在本地 LLM 上运行 **Ollama**

* 确保**数据隐私与合规性**

### 人机协同 (HITL)

* 用于可视化的 Streamlit 仪表板

* 支持升级工作流

## 技术栈

| 层 | 技术 | 用途 |

| ------------- | ------------- | ----------------------------- |

| Orchestration | LangGraph | 有状态多代理工作流 |

| LLM | Llama (local) | 推理引擎 |

| Inference | Ollama | 本地模型服务 |

| UI | Streamlit | 监控 + 输入 |

| Backend | Python | 核心逻辑 |

## 项目结构

```

src/

├── agents/

│ ├── supervisor.py

│ ├── forensic.py

│ ├── strategist.py

│ └── executor.py

├── graph/

│ └── workflow.py

├── utils/

└── main.py

```

## 1. 前置条件

Python 3.10+

Ollama 已安装并运行 (ollama.com)

模型:下载所需的本地 LLM:

```

ollama pull phi4-mini:latest

ollama pull llama3.2:3b

```

## 2. 安装说明

克隆仓库并设置虚拟环境:

git clone https://github.com/suhasini-ai-architect/ai-autonomous-security-mesh.git

```

cd ai-autonomous-security-mesh

python -m venv venv

source venv/bin/activate # Windows: .\venv\Scripts\activate

pip install streamlit requests langgraph

```

## 3. 运行方式

确保 Ollama 服务在后台运行,然后启动 Mesh:

```

### 在一个单独的终端中

ollama serve

# 运行 Streamlit UI

streamlit run app.py

```

## 4. 测试 Mesh

1. 哨兵过滤器:选择 "Normal Traffic"。观察 phi4-mini 模型如何停止流程以节省计算成本。

2. 专家分析:选择 "SQL Injection"。观察系统如何将任务升级给 llama3.2:3b。

3. 自愈循环:观察验证步骤。如果缓解措施失败,图 将自动重新路由以寻找新策略。

## 工作原理

1. 用户提交日志/事件

2. 监督者确定是否为威胁

3. 取证代理分析攻击详情

4. 策略师生成缓解计划

5. 执行器应用模拟修复

6. 系统验证结果

7. 如果失败 → 循环回策略师

## 高级之处

* 不是聊天机器人 → **状态机 AI 系统**

* 不是线性的 → **循环执行(自愈)**

* 不是被动的 → **自主 + 决策制定**

## 示例用例

**输入:** 来自未知 IP 的可疑登录

**输出:**

* 威胁类型:凭证攻击

* 严重程度:高

* 操作:阻止 IP + 重置凭证

* 状态:已解决 / 重试 / 已升级

## 未来增强

* 集成 SIEM 工具

* 实时流式摄取

* 多模型路由(廉价 vs 强大的 LLM)

* Kubernetes 部署

## 作者

AI Architect | Multi-Agent Systems | Enterprise AI Design

标签:AI编排, AI风险缓解, AMSI绕过, Kubernetes, LangGraph, Llama-3.2, LLM评估, Ollama, PyRIT, Python, SecOps, SOC自动化, Streamlit, 云安全架构, 人工智能, 修复验证, 反模式检测, 告警降噪, 多智能体系统, 威胁检测, 实时取证, 攻击分析, 无后门, 智能重试, 状态机, 状态跟踪, 用户模式Hook绕过, 缓解策略, 网络安全, 自动化安全运营, 自愈系统, 访问控制, 逆向工具, 隐私保护