nourSOC/adversarial-ml-wazuh-lab

GitHub: nourSOC/adversarial-ml-wazuh-lab

基于Wazuh SIEM构建的对抗性机器学习检测实验环境,通过自定义规则和关联逻辑填补AI安全与SOC检测之间的空白。

Stars: 1 | Forks: 0

🚨 使用 Wazuh SIEM 的对抗性 ML 检测实验环境

📌 概述

本项目演示了如何使用 Wazuh SIEM 模拟和检测对抗性机器学习行为。

与传统攻击不同,对抗性 ML 针对模型本身,在保持高置信度的同时导致错误预测。

🎯 实验环境的重要性

AI 正在成为一种新的攻击面。

传统的 SOC 工具无法检测模型操纵,除非将 ML 行为转化为可观测的安全事件。

➡️ 本实验环境弥合了 AI 安全与 SOC 检测之间的差距。

⚙️ 架构

Python 模拟 → Windows 事件 → Wazuh Agent → Wazuh Manager → Filebeat → Elasticsearch → 仪表板

🧪 攻击模拟

Python 脚本生成动态的对抗性 ML 行为:

- 随机输入 ID

- 高置信度值

- 准确率下降

➡️ 模拟真实行为而非静态日志。

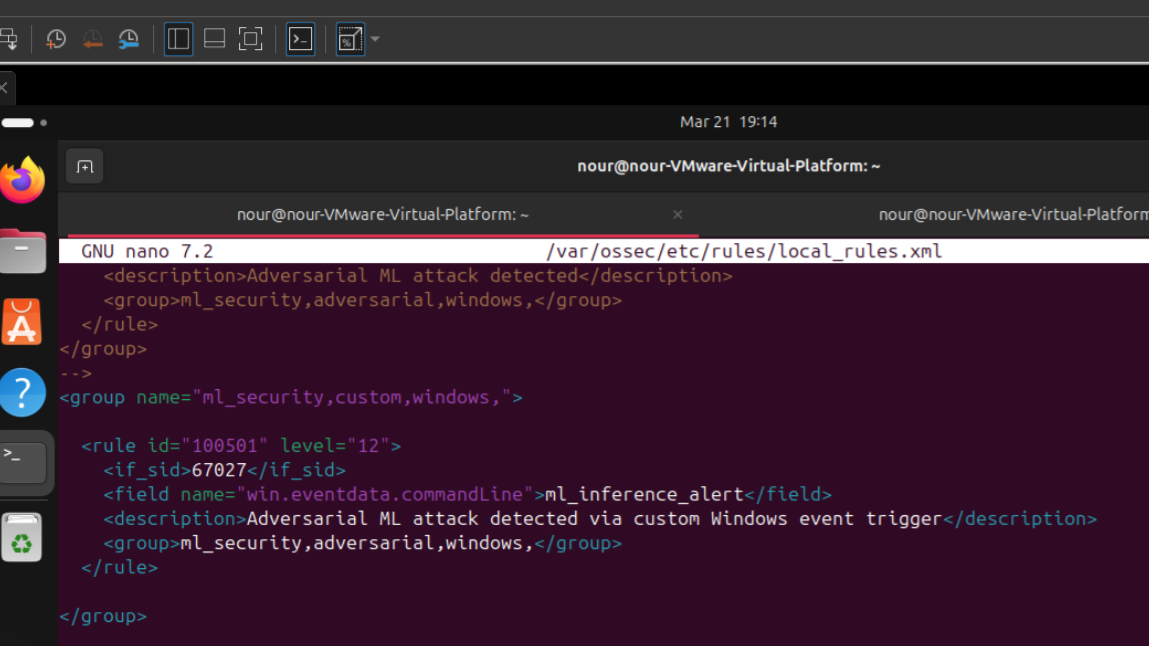

🛡️ 检测逻辑

规则 100501

检测 ML 异常指标 ("ml_inference_alert")。

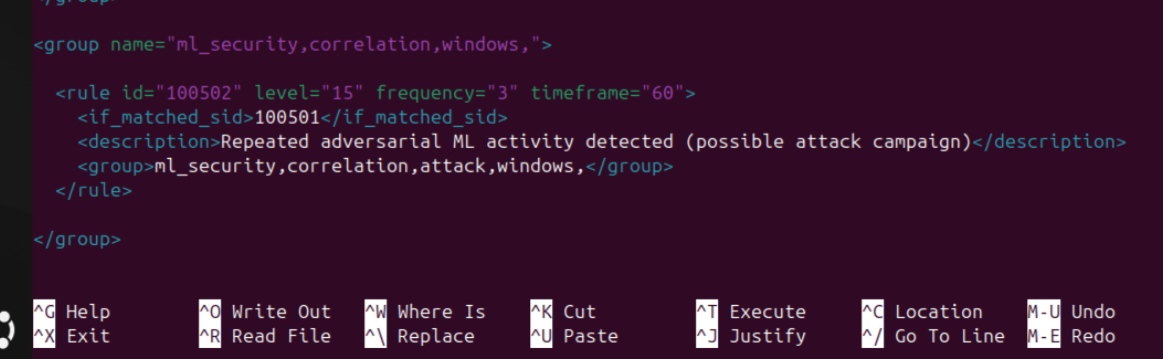

规则 100502

关联 60 秒内的重复活动(攻击模式)。

🔍 威胁狩猎查询

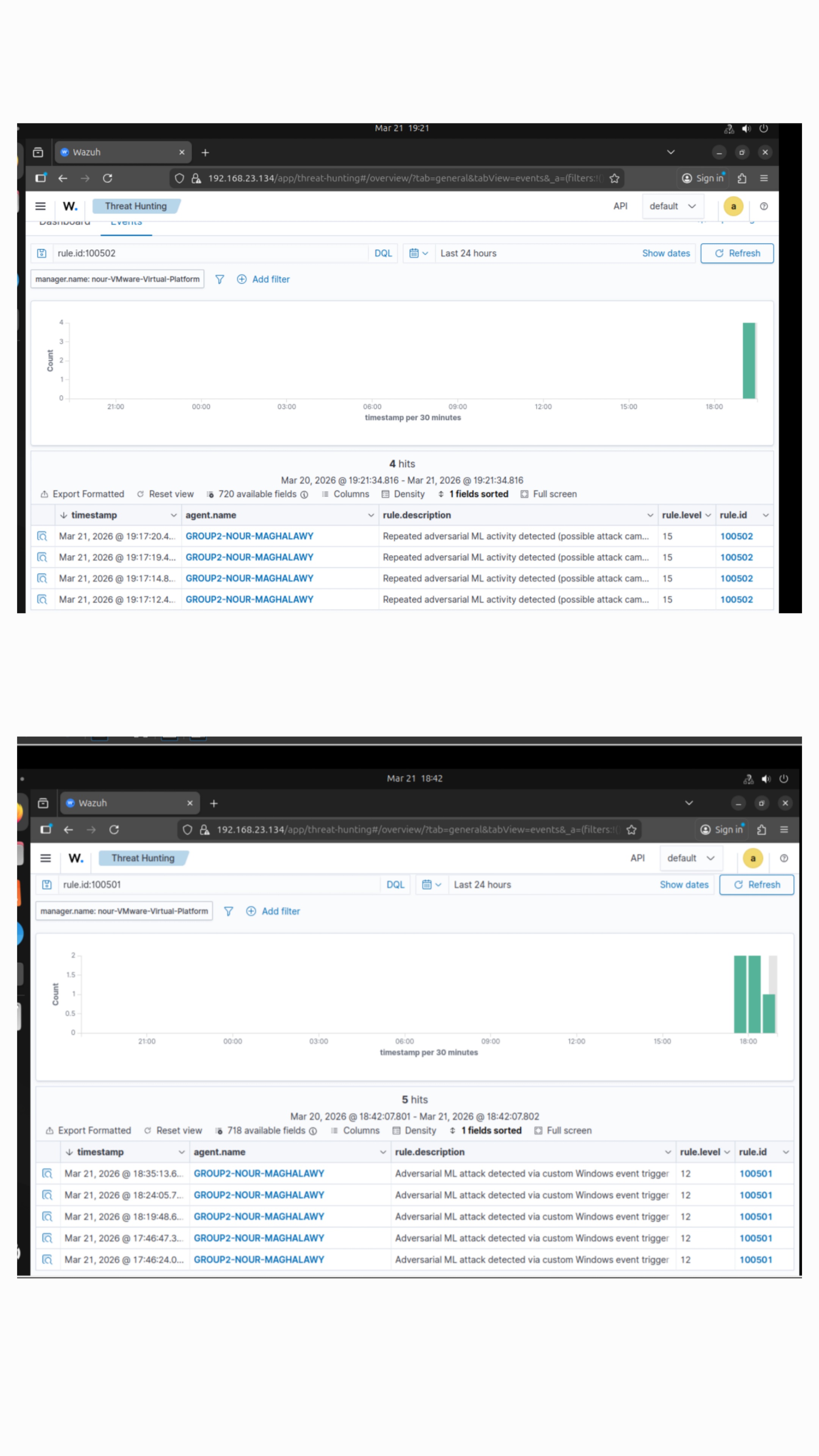

rule.id:100501

rule.id:100502

data.win.eventdata.commandLine: "ml_inference_alert"

🎯 MITRE ATT&CK 映射

- T1059 – 命令执行

- T1204 – 用户执行

- TA0002 – 执行

📊 结果

✔️ 检测到 ML 异常

✔️ 触发关联告警

✔️ 实时 SIEM 可见性

📸 截图

"模拟" (screenshots/01-python-simulation.png)

"检测" (screenshots/05-alert-100501.png)

"关联" (screenshots/06-alert-100502.png)

"仪表板" (screenshots/07-dashboard.png)

📄 报告

- "完整实验报告" (report/Adversarial_ML_Wazuh_Report.pdf)

- "实施文档" (report/Wazuh_Adversarial_Lab_Implementation.pdf)

## 📚 文档

- [场景故事](docs/scenario-story.md)

- [事件报告](docs/incident-report.md)

- [威胁狩猎查询](docs/threat-hunting-queries.md)

- [MITRE 映射](docs/mitre-mapping.md)

## 📸 实验演示

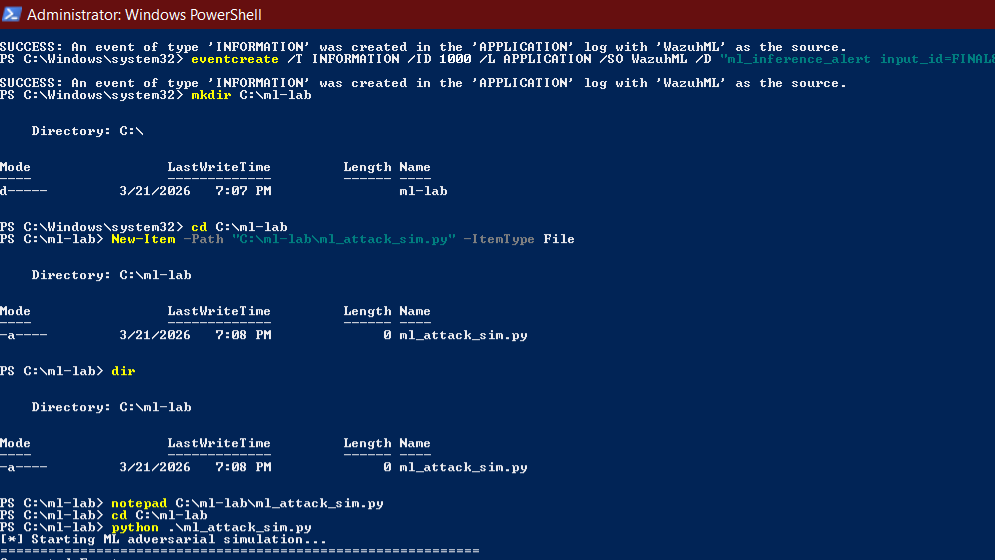

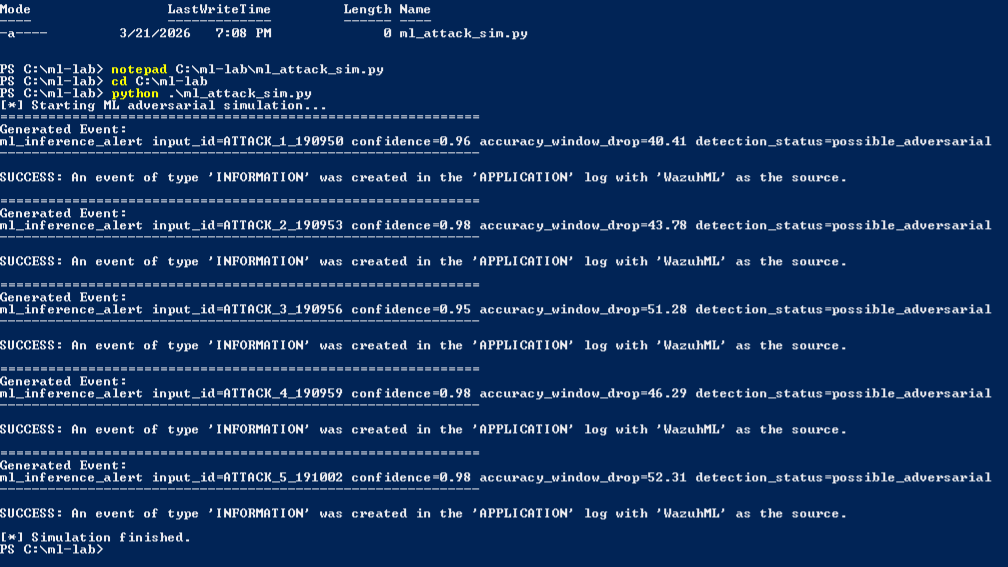

### 1️⃣ Python 模拟(对抗性事件生成)

此步骤通过生成异常推理日志来模拟对抗性 ML 行为。

### 2️⃣ Windows 事件创建(事件注入)

使用 PowerShell 将自定义对抗性事件注入 Windows 事件日志。

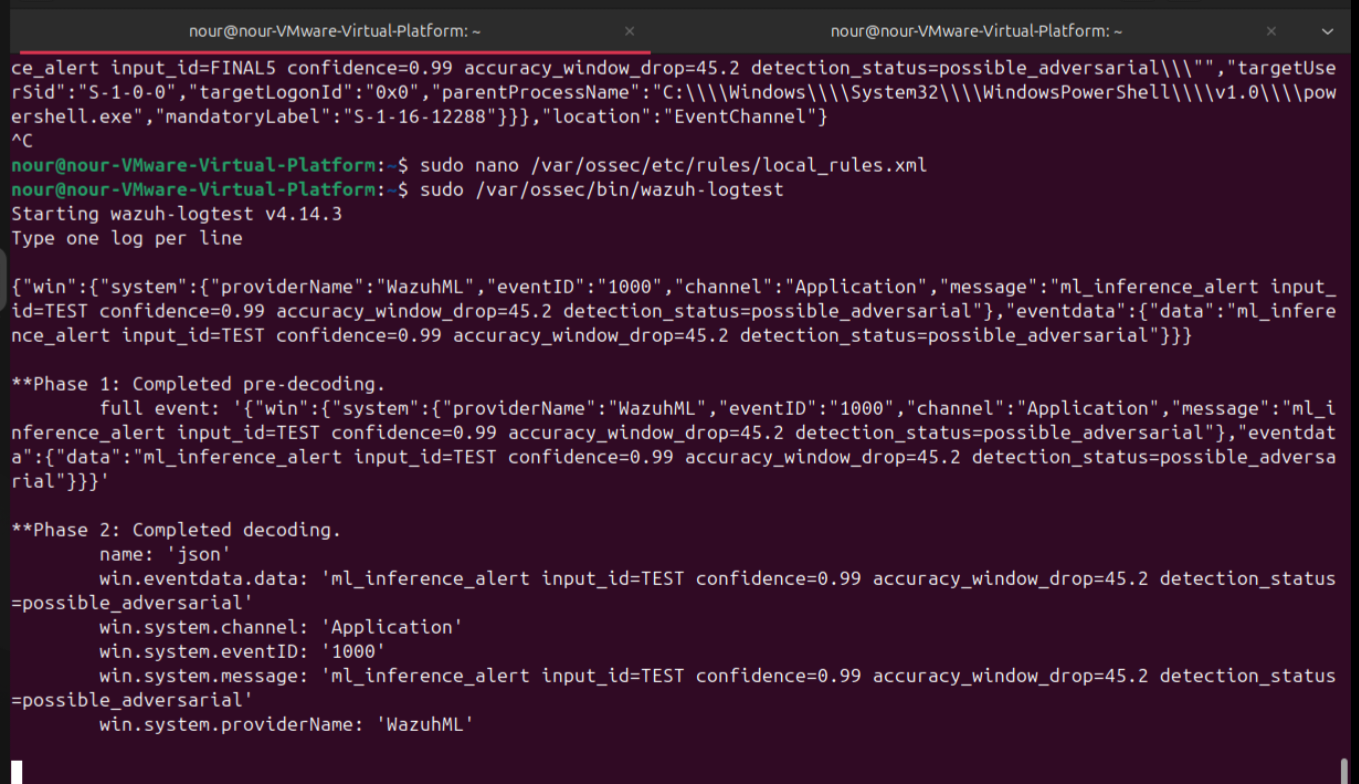

### 3️⃣ Wazuh Logtest 验证

使用 Wazuh logtest 测试事件,以验证解析和规则匹配。

### 4️⃣ 检测规则触发(规则 100501)

自定义规则检测 Windows 日志中的对抗性 ML 模式。

### 5️⃣ 关联规则触发(规则 100502)

关联多个事件以检测潜在的攻击活动。

### 6️⃣ SIEM 仪表板可视化

最终告警在 Wazuh SIEM 仪表板中可视化展示。

👤 作者

Nour Maghalawy

SOC 分析师 | 检测工程爱好者

标签:AI合规, AMSI绕过, Cloudflare, Elasticsearch, Filebeat, FOFA, MITRE ATT&CK, Python模拟, Wazuh, Windows事件日志, 人工智能安全, 合规性, 威胁检测, 安全仪表盘, 安全规则编写, 安全运营中心, 对抗性机器学习, 异常检测, 搜索语句(dork), 数据科学安全, 日志关联分析, 模型完整性, 网络安全实验室, 网络映射, 越狱测试, 逆向工具