aiming-lab/AutoResearchClaw

GitHub: aiming-lab/AutoResearchClaw

一款完全自主的学术研究自动化工具,从研究想法到会议级论文一站式生成。

Stars: 4713 | Forks: 473

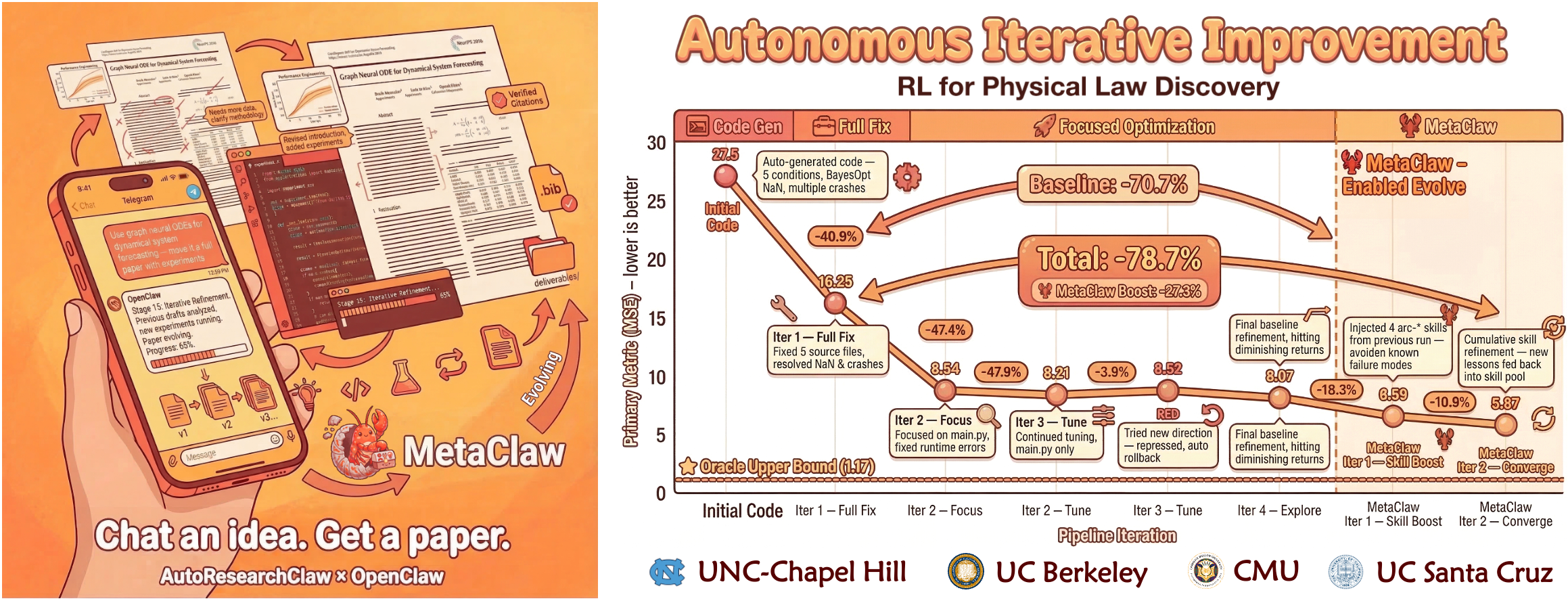

聊出一个想法,得到一篇论文。完全自主且自我进化。

只需与 OpenClaw 聊天:“Research X” → 搞定。

🇨🇳 中文 ·

🇯🇵 日本語 ·

🇰🇷 한국어 ·

🇫🇷 Français ·

🇩🇪 Deutsch ·

🇪🇸 Español ·

🇧🇷 Português ·

🇷🇺 Русский ·

🇸🇦 العربية

📖 集成指南 · 💬 Discord 社区

## 🔥 新闻

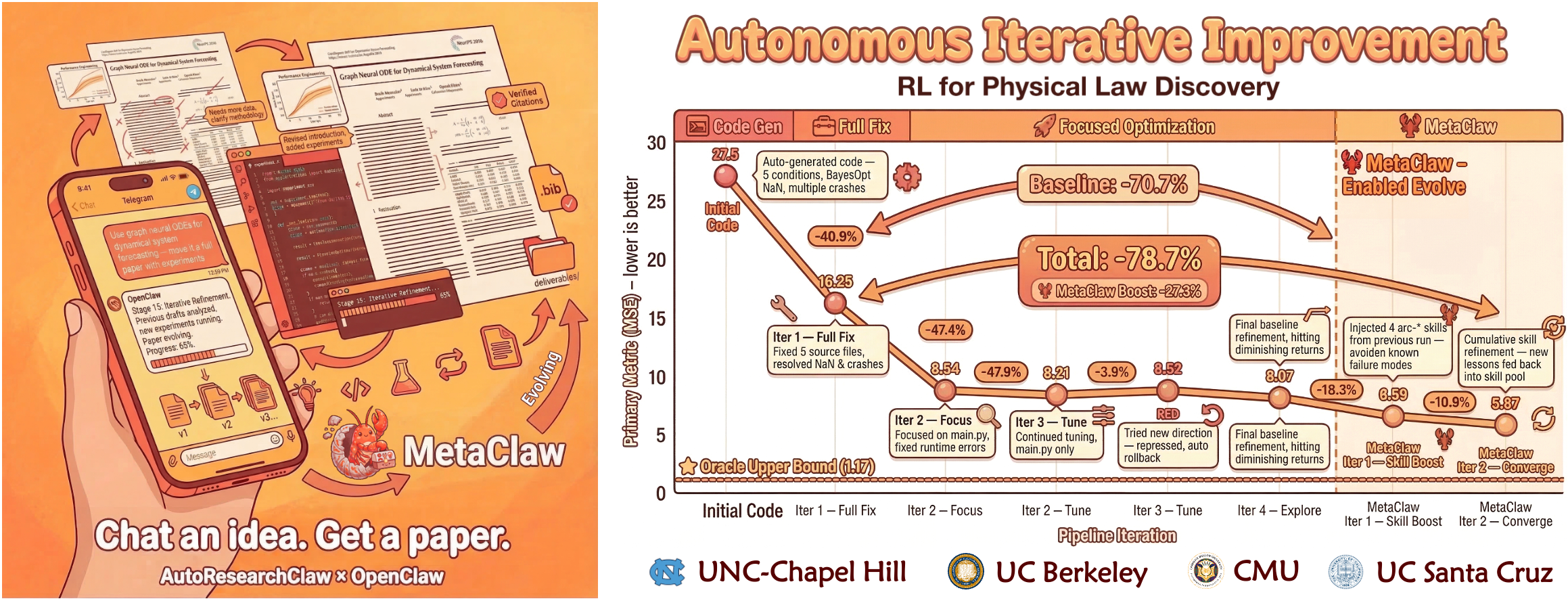

- **[03/17/2026]** [v0.3.0](https://github.com/aiming-lab/AutoResearchClaw/releases/tag/v0.3.0) — **MetaClaw 集成** — AutoResearchClaw 现已支持 [MetaClaw](https://github.com/aiming-lab/MetaClaw) 跨运行学习:pipeline 失败 → 结构化经验教训 → 可复用技能,注入到所有 23 个阶段。在对照实验中稳健性提升 **+18.3%**。可选择开启(`metaclaw_bridge.enabled: true`),完全向后兼容。详见[集成指南](#-metaclaw-integration)。

- **[03/16/2026]** [v0.2.0](https://github.com/aiming-lab/AutoResearchClaw/releases/tag/v0.2.0) — 三个多智能体子系统(CodeAgent、BenchmarkAgent、FigureAgent),强化的 Docker 沙箱支持网络策略感知执行,4 轮论文质量审计(AI-slop 检测、7 维评审评分、NeurIPS 检查清单),以及来自生产运行的 15+ 项错误修复。

- **[03/15/2026]** [v0.1.0](https://github.com/aiming-lab/AutoResearchClaw/releases/tag/v0.1.0) — 我们发布了 AutoResearchClaw:一个完全自主的 23 阶段研究 pipeline,将单一的研究想法转化为会议就绪的论文。无需人工干预。

## ⚡ 一条命令。一篇论文。

```

pip install -e . && researchclaw run --topic "Your research idea here" --auto-approve

```

## 🤔 这是什么?

**你想出来,AutoResearchClaw 写出来。**

抛出一个研究课题 —— 取回一篇完整的学术论文,包含来自 OpenAlex、Semantic Scholar 和 arXiv 的真实文献,硬件感知沙箱实验(自动检测 GPU/MPS/CPU),统计分析,多智能体同行评审,以及针对 NeurIPS/ICML/ICLR 的会议就绪 LaTeX。无需看管。无需复制粘贴。没有虚假引用。

| 📄 | paper_draft.md | 完整学术论文(引言、相关工作、方法、实验、结果、结论) |

| 📐 | paper.tex | 会议就绪的 LaTeX(NeurIPS / ICLR / ICML 模板) |

| 📚 | references.bib | 来自 OpenAlex、Semantic Scholar 和 arXiv 的真实 BibTeX 参考文献 —— 自动修剪以匹配行内引用 |

| 🔍 | verification_report.json | 4 层引用完整性与相关性验证(arXiv、CrossRef、DataCite、LLM) |

| 🧪 | experiment runs/ | 生成的代码 + 沙箱结果 + 结构化 JSON 指标 |

| 📊 | charts/ | 自动生成的条件对比图表,带误差条和置信区间 |

| 📝 | reviews.md | 多智能体同行评审,含方法-证据一致性检查 |

| 🧬 | evolution/ | 从每次运行中提取的自我学习经验教训 |

| 📦 | deliverables/ | 所有最终输出集中在一个文件夹 —— 可在 Overleaf 直接编译 |

该 pipeline **端到端运行,无需人工干预**。当实验失败时,它会自我修复。当假设不成立时,它会转向。当引用是伪造时,它会剔除它们。

## 🚀 快速开始

```

# 克隆与安装

git clone https://github.com/aiming-lab/AutoResearchClaw.git

cd AutoResearchClaw

python3 -m venv .venv && source .venv/bin/activate

pip install -e .

# 配置

cp config.researchclaw.example.yaml config.arc.yaml

# 编辑 config.arc.yaml — 设置你的 LLM API endpoint 和 key

# 运行

export OPENAI_API_KEY="sk-..."

researchclaw run --config config.arc.yaml --topic "Your research idea" --auto-approve

```

输出 → `artifacts/rc-YYYYMMDD-HHMMSS-

/deliverables/` — 可编译的 LaTeX、BibTeX、实验代码、图表。

📝 最低配置要求

```

project:

name: "my-research"

research:

topic: "Your research topic here"

llm:

base_url: "https://api.openai.com/v1"

api_key_env: "OPENAI_API_KEY"

primary_model: "gpt-4o"

fallback_models: ["gpt-4o-mini"]

experiment:

mode: "sandbox"

sandbox:

python_path: ".venv/bin/python"

```

## 🧠 有何不同

| 能力 | 工作原理 |

|-----------|-------------|

| **🔄 PIVOT / REFINE 循环** | 第 15 阶段自主决策:PROCEED(继续)、REFINE(微调参数)或 PIVOT(新方向)。产出物自动版本化。 |

| **🤖 多智能体辩论** | 假设生成、结果分析和同行评审各自使用结构化的多视角辩论。 |

| **🧬 自我学习** | 每次运行提取经验教训(决策理由、运行时警告、指标异常),设 30 天时间衰减。未来的运行从过去的错误中学习。 |

| **📚 知识库** | 每次运行在 6 个类别(决策、实验、发现、文献、问题、评审)中构建结构化知识库 (KB)。 |

| **🛡️ Sentinel 看门狗** | 后台质量监控器:NaN/Inf 检测、论文-证据一致性、引用相关性评分、防伪造 guard。 |

## 🦞 OpenClaw 集成

**AutoResearchClaw 是一个与 [OpenClaw](https://github.com/openclaw/openclaw) 兼容的服务。** 在 OpenClaw 中安装它,并通过一条消息启动自主研究 —— 或者通过 CLI、Claude Code 或任何 AI 编程助手独立使用。

### 🚀 配合 OpenClaw 使用(推荐)

如果你已经使用 [OpenClaw](https://github.com/openclaw/openclaw) 作为你的 AI 助手:

```

1️⃣ Share the GitHub repo URL with OpenClaw

2️⃣ OpenClaw auto-reads RESEARCHCLAW_AGENTS.md → understands the pipeline

3️⃣ Say: "Research [your topic]"

4️⃣ Done — OpenClaw clones, installs, configures, runs, and returns results

```

**就是这样。** OpenClaw 会自动处理 `git clone`、`pip install`、配置设置和 pipeline 执行。你只需聊天。

💡 底层发生了什么

1. OpenClaw 读取 `RESEARCHCLAW_AGENTS.md` → 学习研究编排者角色

2. OpenClaw 读取 `README.md` → 了解安装和 pipeline 结构

3. OpenClaw 复制 `config.researchclaw.example.yaml` → `config.yaml`

4. 询问你的 LLM API 密钥(或使用你的环境变量)

5. 运行 `pip install -e .` + `researchclaw run --topic "..." --auto-approve`

6. 返回论文、LaTeX、实验和引用

### 🔌 OpenClaw Bridge(高级)

为了更深入的集成,AutoResearchClaw 包含一个 **bridge adapter system**,具有 6 项可选能力:

```

# config.arc.yaml

openclaw_bridge:

use_cron: true # ⏰ Scheduled research runs

use_message: true # 💬 Progress notifications (Discord/Slack/Telegram)

use_memory: true # 🧠 Cross-session knowledge persistence

use_sessions_spawn: true # 🔀 Spawn parallel sub-sessions for concurrent stages

use_web_fetch: true # 🌐 Live web search during literature review

use_browser: false # 🖥️ Browser-based paper collection

```

每个标志激活一个类型化 adapter 协议。当 OpenClaw 提供这些能力时,adapter 会使用它们而无需代码更改。详见 [`docs/integration-guide.md`](docs/integration-guide.md)。

### ACP (Agent Client Protocol)

AutoResearchClaw 可以使用 **任何 ACP 兼容的编程智能体** 作为其 LLM 后端 —— 无需 API 密钥。智能体通过 [acpx](https://github.com/openclaw/acpx) 进行通信,在所有 23 个 pipeline 阶段维护单一持久会话。

| 智能体 | 命令 | 备注 |

|-------|---------|-------|

| Claude Code | `claude` | Anthropic |

| Codex CLI | `codex` | OpenAI |

| Gemini CLI | `gemini` | Google |

| OpenCode | `opencode` | SST |

| Kimi CLI | `kimi` | Moonshot |

```

# config.yaml — ACP 示例

llm:

provider: "acp"

acp:

agent: "claude" # Any ACP-compatible agent CLI command

cwd: "." # Working directory for the agent

# No base_url or api_key needed — the agent handles its own auth.

```

```

# 直接运行 — agent 使用其自己的凭证

researchclaw run --config config.yaml --topic "Your research idea" --auto-approve

```

### 🛠️ 其他运行方式

| 方式 | 如何操作 |

|--------|-----|

| **独立 CLI** | `researchclaw run --topic "..." --auto-approve` |

| **Python API** | `from researchclaw.pipeline import Runner; Runner(config).run()` |

| **Claude Code** | 读取 `RESEARCHCLAW_CLAUDE.md` — 只需说 *"Run research on [topic]"* |

| **OpenCode** | 读取 `.claude/skills/` — 同样的自然语言界面 |

| **任何 AI CLI** | 提供 `RESEARCHCLAW_AGENTS.md` 作为上下文 → 智能体自动引导启动 |

## 🔬 Pipeline:23 个阶段,8 个阶段组

```

Phase A: Research Scoping Phase E: Experiment Execution

1. TOPIC_INIT 12. EXPERIMENT_RUN

2. PROBLEM_DECOMPOSE 13. ITERATIVE_REFINE ← self-healing

Phase B: Literature Discovery Phase F: Analysis & Decision

3. SEARCH_STRATEGY 14. RESULT_ANALYSIS ← multi-agent

4. LITERATURE_COLLECT ← real API 15. RESEARCH_DECISION ← PIVOT/REFINE

5. LITERATURE_SCREEN [gate]

6. KNOWLEDGE_EXTRACT Phase G: Paper Writing

16. PAPER_OUTLINE

Phase C: Knowledge Synthesis 17. PAPER_DRAFT

7. SYNTHESIS 18. PEER_REVIEW ← evidence check

8. HYPOTHESIS_GEN ← debate 19. PAPER_REVISION

Phase D: Experiment Design Phase H: Finalization

9. EXPERIMENT_DESIGN [gate] 20. QUALITY_GATE [gate]

10. CODE_GENERATION 21. KNOWLEDGE_ARCHIVE

11. RESOURCE_PLANNING 22. EXPORT_PUBLISH ← LaTeX

23. CITATION_VERIFY ← relevance check

```

📋 每个阶段组做什么

| 阶段组 | 发生了什么 |

|-------|-------------|

| **A: Scoping** | LLM 将主题分解为带有研究问题的结构化问题树 |

| **A+: Hardware** | 自动检测 GPU(NVIDIA CUDA / Apple MPS / 仅 CPU),若本地硬件受限则发出警告,相应调整代码生成 |

| **B: Literature** | 多源检索(OpenAlex → Semantic Scholar → arXiv)获取真实论文,按相关性筛选,提取知识卡片 |

| **C: Synthesis** | 聚合发现,识别研究空白,通过多智能体辩论生成可验证的假设 |

| **D: Design** | 设计实验计划,生成硬件感知的可运行 Python(GPU 等级 → 包选择),估算资源需求 |

| **E: Execution** | 在沙箱中运行实验,检测 NaN/Inf 和运行时错误,通过针对性的 LLM 修复进行自我修复代码 |

| **F: Analysis** | 多智能体结果分析;带理由的自主 PROCEED / REFINE / PIVOT 决策 |

| **G: Writing** | 大纲 → 逐节起草(5,000-6,500 词) → 同行评审(含方法-证据一致性检查) → 带长度控制的修订 |

| **H: Finalization** | 质量门控、知识归档、带会议模板的 LaTeX 导出、引用完整性与相关性验证 |

## ✨ 核心功能

| 功能 | 描述 |

|---------|------------|

| **📚 多源文献** | 来自 OpenAlex、Semantic Scholar 和 arXiv 的真实论文 —— 查询扩展、去重、带优雅降级的熔断器 |

| **🔍 4 层引用验证** | arXiv ID 检查 → CrossRef/DataCite DOI → Semantic Scholar 标题匹配 → LLM 相关性评分。自动移除虚假引用。 |

| **🖥️ 硬件感知执行** | 自动检测 GPU(NVIDIA CUDA / Apple MPS / 仅 CPU)并相应调整代码生成、导入和实验规模 |

| **🧪 沙箱实验** | AST 验证的代码、不可变的 harness、NaN/Inf 快速失败、自我修复修复、迭代优化(最多 10 轮)、部分结果捕获 |

| **📝 会议级写作** | NeurIPS/ICML/ICLR 模板,逐节起草(5,000-6,500 词),防伪造 guard,修订长度控制,反免责声明强制执行 |

| **📐 模板切换** | `neurips_2025`、`iclr_2026`、`icml_2026` — Markdown → LaTeX,支持数学、表格、图片、交叉引用、`\cite{}` |

| **🚦 质量门控** | 3 个人工介入门控(第 5、9、20 阶段)支持回滚。使用 `--auto-approve` 跳过。 |

## 🧠 MetaClaw 集成

**AutoResearchClaw + [MetaClaw](https://github.com/aiming-lab/MetaClaw) = 一个从每次运行中学习的 pipeline。**

MetaClaw 为 AutoResearchClaw 增加了 **跨运行知识迁移** 能力。启用后,pipeline 自动从失败和警告中捕获经验教训,将其转换为可复用技能,并在后续运行中将这些技能注入到所有 23 个 pipeline 阶段 —— 这样就不会重复犯同样的错误。

### 工作原理

```

Run N executes → failures/warnings captured as Lessons

↓

MetaClaw Lesson → Skill conversion

↓

arc-* Skill files stored in ~/.metaclaw/skills/

↓

Run N+1 → build_overlay() injects skills into every LLM prompt

↓

LLM avoids known pitfalls → higher quality, fewer retries

```

### 快速设置

```

# 1. 安装 MetaClaw (如果尚未安装)

pip install metaclaw

# 2. 在你的 config 中启用

```

```

# config.arc.yaml

metaclaw_bridge:

enabled: true

proxy_url: "http://localhost:30000/v1" # MetaClaw proxy (optional)

skills_dir: "~/.metaclaw/skills" # Where skills are stored

fallback_url: "https://api.openai.com/v1" # Direct LLM fallback

fallback_api_key_env: "OPENAI_API_KEY"

lesson_to_skill:

enabled: true

min_severity: "warning" # Convert warnings + errors

max_skills_per_run: 5

```

```

# 3. 照常运行 — MetaClaw 透明工作

researchclaw run --config config.arc.yaml --topic "Your idea" --auto-approve

```

每次运行后,检查 `~/.metaclaw/skills/arc-*/SKILL.md` 以查看你的 pipeline 已学习的技能。

### 实验结果

在对照 A/B 实验中(相同主题、 LLM、相同配置):

| 指标 | 基准 | 含 MetaClaw | 提升 |

|--------|----------|---------------|-------------|

| 阶段重试率 | 10.5% | 7.9% | **-24.8%** |

| Refine 循环次数 | 2.0 | 1.2 | **-40.0%** |

| Pipeline 阶段完成度 | 18/19 | 19/19 | **+5.3%** |

| 整体稳健性评分(综合) | 0.714 | 0.845 | **+18.3%** |

### 向后兼容性

- **默认:关闭。** 如果 `metaclaw_bridge` 不存在或 `enabled: false`,pipeline 行为与以前完全一致。

- **无新依赖。** MetaClaw 是可选的 —— 核心 pipeline 无需它即可工作。

- **所有 1,284 项现有测试均通过**,即使存在集成代码。

## ⚙️ 配置参考

点击展开完整配置参考

```

# === Project ===

project:

name: "my-research" # Project identifier

mode: "docs-first" # docs-first | semi-auto | full-auto

# === Research ===

research:

topic: "..." # Research topic (required)

domains: ["ml", "nlp"] # Research domains for literature search

daily_paper_count: 8 # Target papers per search query

quality_threshold: 4.0 # Minimum quality score for papers

# === Runtime ===

runtime:

timezone: "America/New_York" # For timestamps

max_parallel_tasks: 3 # Concurrent experiment limit

approval_timeout_hours: 12 # Gate stage timeout

retry_limit: 2 # Retry count on stage failure

# === LLM ===

llm:

provider: "openai-compatible" # "openai-compatible" (default) or "acp"

base_url: "https://..." # API endpoint (required for openai-compatible)

api_key_env: "OPENAI_API_KEY" # Env var for API key (required for openai-compatible)

api_key: "" # Or hardcode key here

primary_model: "gpt-4o" # Primary model

fallback_models: ["gpt-4o-mini"] # Fallback chain

s2_api_key: "" # Semantic Scholar API key (optional, higher rate limits)

acp: # Only used when provider: "acp"

agent: "claude" # ACP agent CLI command (claude, codex, gemini, etc.)

cwd: "." # Working directory for the agent

# === Experiment ===

experiment:

mode: "sandbox" # simulated | sandbox | docker | ssh_remote

time_budget_sec: 300 # Max execution time per run (default: 300s)

max_iterations: 10 # Max optimization iterations

metric_key: "val_loss" # Primary metric name

metric_direction: "minimize" # minimize | maximize

sandbox:

python_path: ".venv/bin/python"

gpu_required: false

allowed_imports: [math, random, json, csv, numpy, torch, sklearn]

max_memory_mb: 4096

docker:

image: "researchclaw/experiment:latest"

network_policy: "setup_only" # none | setup_only | pip_only | full

gpu_enabled: true

memory_limit_mb: 8192

auto_install_deps: true # Auto-detect imports → requirements.txt

ssh_remote:

host: "" # GPU server hostname

gpu_ids: [] # Available GPU IDs

remote_workdir: "/tmp/researchclaw_experiments"

# === Export ===

export:

target_conference: "neurips_2025" # neurips_2025 | iclr_2026 | icml_2026

authors: "Anonymous"

bib_file: "references"

# === Prompts ===

prompts:

custom_file: "" # Path to custom prompts YAML (empty = defaults)

# === Security ===

security:

hitl_required_stages: [5, 9, 20] # Stages requiring human approval

allow_publish_without_approval: false

redact_sensitive_logs: true

# === Knowledge Base ===

knowledge_base:

backend: "markdown" # markdown | obsidian

root: "docs/kb"

# === Notifications ===

notifications:

channel: "console" # console | discord | slack

target: ""

# === MetaClaw Bridge (可选) ===

metaclaw_bridge:

enabled: false # Set to true to enable cross-run learning

proxy_url: "http://localhost:30000/v1" # MetaClaw proxy URL

skills_dir: "~/.metaclaw/skills" # Where arc-* skills are stored

fallback_url: "" # Direct LLM fallback when proxy is down

fallback_api_key: "" # API key for fallback endpoint

lesson_to_skill:

enabled: true # Auto-convert lessons to skills

min_severity: "warning" # Minimum severity to convert

max_skills_per_run: 5 # Max new skills per pipeline run

# === OpenClaw Bridge ===

openclaw_bridge:

use_cron: false # Scheduled research runs

use_message: false # Progress notifications

use_memory: false # Cross-session knowledge persistence

use_sessions_spawn: false # Spawn parallel sub-sessions

use_web_fetch: false # Live web search

use_browser: false # Browser-based paper collection

```

## 🙏 致谢

灵感来源于:

- 🔬 [AI Scientist](https://github.com/SakanaAI/AI-Scientist) (Sakana AI) — 自动化研究先驱

- 🧠 [AutoResearch](https://github.com/karpathy/autoresearch) (Andrej Karpathy) — 端到端研究自动化

- 🌐 [FARS](https://analemma.ai/blog/introducing-fars/) (Analemma) — Fully Automated Research System

## 📄 许可证

MIT — 详见 [LICENSE](LICENSE)。

## 📌 引用

如果你觉得 AutoResearchClaw 有用,请引用:

```

@misc{liu2026autoresearchclaw,

author = {Liu, Jiaqi and Xia, Peng and Han, Siwei and Qiu, Shi and Zhang, Letian and Chen, Guiming and Tu, Haoqin and Yang, Xinyu and and Zhou, Jiawei and Zhu, Hongtu and Li, Yun and Zhou, Yuyin and Zheng, Zeyu and Xie, Cihang and Ding, Mingyu and Yao, Huaxiu},

title = {AutoResearchClaw: Fully Autonomous Research from Idea to Paper},

year = {2026},

organization = {GitHub},

url = {https://github.com/aiming-lab/AutoResearchClaw},

}

```

由 AutoResearchClaw 团队用 🦞 构建

标签:AI科研助手, Apex, AutoGPT替代, AutoResearch, ChatWithPDF, DNS解析, OpenClaw, Petitpotam, Python, RAG, 人工智能, 代码生成, 全自动驾驶, 创新idea, 多模态科研, 威胁情报, 学术GPT, 学术研究自动化, 开发者工具, 开源项目, 无后门, 机器学习, 检索增强生成, 深度学习, 渗透测试工具, 用户模式Hook绕过, 知识提取, 科研工具, 科研自动化流程, 自动化论文写作, 自动文献综述, 自进化系统, 论文生成器, 请求拦截