Tooba19/presidio-llm-security-gateway

GitHub: Tooba19/presidio-llm-security-gateway

基于 Microsoft Presidio 的 LLM 安全网关,用于在请求到达模型前检测 prompt injection 并对 PII 敏感信息进行脱敏处理。

Stars: 0 | Forks: 0

# 基于 Presidio 的 LLM 安全微型网关

一个用于大型语言模型 (LLM) 应用的模块化安全网关,可在请求到达模型之前检测 prompt injection 尝试并缓解敏感信息泄露。

## 概述

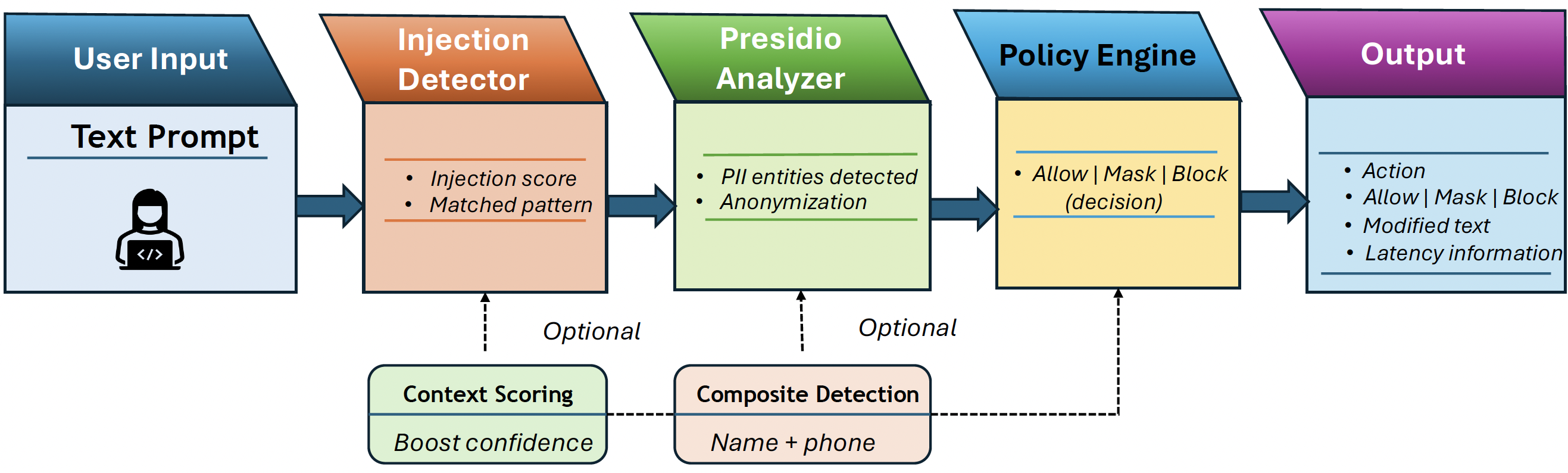

本项目为 LLM 系统实现了一个轻量级预处理层。它分析用户输入,检测对抗性 prompt injection 模式,使用 Microsoft Presidio 识别个人身份信息 (PII),并应用策略决策来:

- **ALLOW** (允许) 输入

- **MASK** (掩码) 敏感实体

- **BLOCK** (拦截) 恶意或高风险输入

该系统使用 FastAPI 实现,包含可配置的阈值、延迟测量和评估流水线。

## 系统架构

安全网关充当用户与 LLM 之间的预处理层。

用户输入

→ 注入检测

→ Presidio PII 分析器

→ 策略引擎

→ 输出决策 (ALLOW / MASK / BLOCK)

标签:AMSI绕过, API安全, AV绕过, DLL 劫持, FastAPI, JSON输出, LLM, Naabu, PII泄露, Presidio, Python, Unmanaged PE, WAF, 人工智能安全, 内容安全, 合规性, 大语言模型, 威胁检测, 安全网关, 对抗攻击, 敏感信息检测, 数据脱敏, 无后门, 网络测绘, 脱敏网关, 越狱检测, 逆向工具, 隐私合规