Soildworks/Agentic-CLIP-Benchmark

GitHub: Soildworks/Agentic-CLIP-Benchmark

一个面向CIFAR-10的CLIP模型零样本评估流水线,整合了安全加固与工程化的模型部署实践。

Stars: 0 | Forks: 0

# Agentic-CLIP-Benchmark:CIFAR-10 零样本评估

[](https://www.python.org/)

[](https://pytorch.org/)

[-green.svg)](https://www.trae.ai/)

本项目实现了一个鲁棒、自动化的 Pipeline,用于在完整的 **CIFAR-10** 测试集(10,000 张图像)上评估 OpenAI 的 **CLIP (ViT-B/32)** 模型。该项目采用 **AI Native 工作流 (Trae IDE)** 开发,实现了 **88.80%** 的高精度零样本准确率。

## 📊 性能摘要

- **Top-1 准确率**:`88.80%` (零样本)

- **模型**:`openai/clip-vit-base-patch32` (使用 Safetensors)

- **推理硬件**:NVIDIA RTX 2060

- **时间复杂度**:通过批量推理优化 (Batch Size: 32)

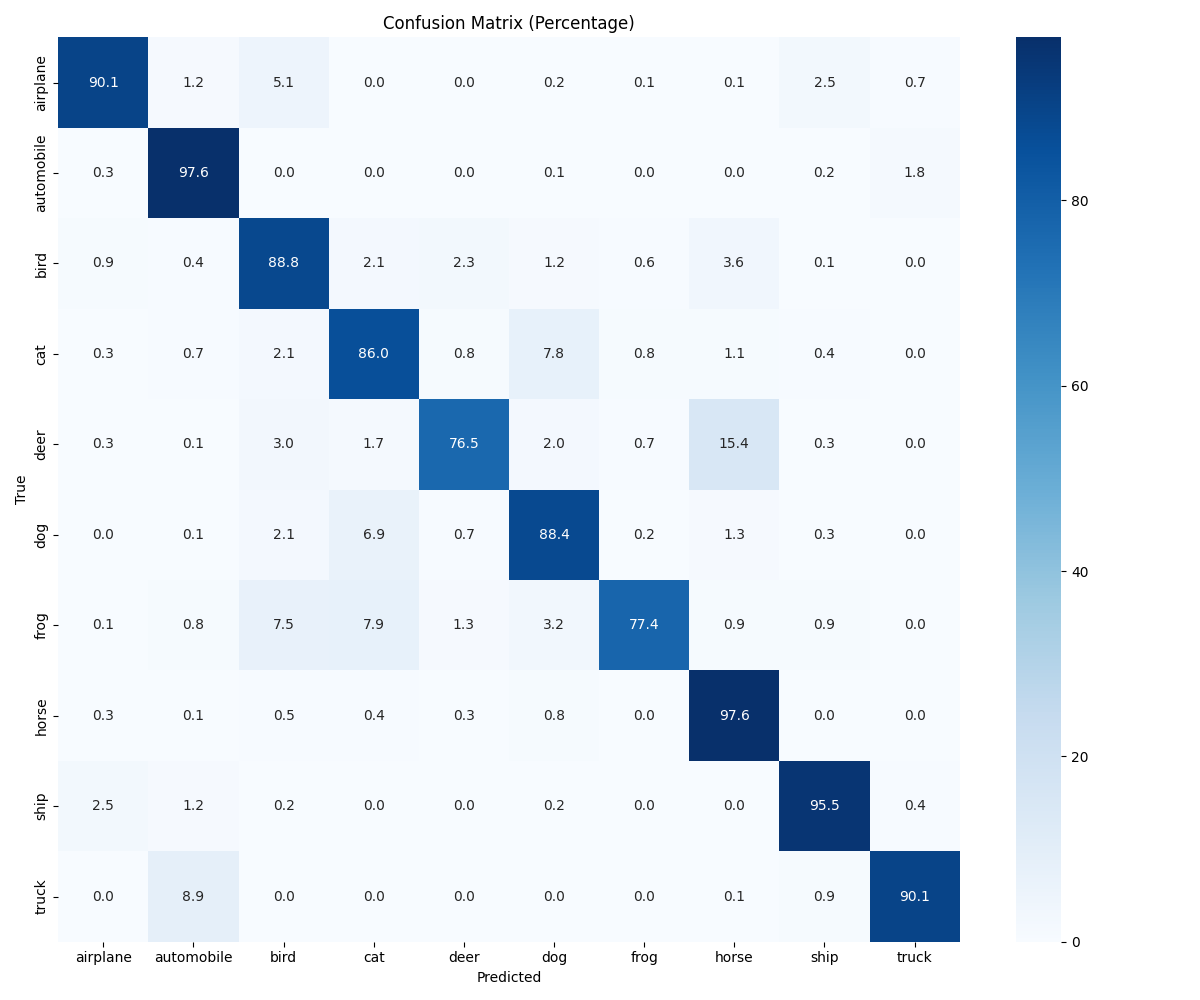

### 混淆矩阵 (统计洞察)

## 🛠️ 核心功能与方法论

- **自动化数据 Pipeline**:开发了自定义 `CIFAR10Dataset` 以处理原始二进制 pickle 数据,高效地将 1D 字节数组转换为 3D RGB 张量。

- **批量推理**:集成 `torch.utils.data.DataLoader` 与 `tqdm`,在 VRAM 不溢出的情况下管理 10,000 个样本。

- **Prompt 工程**:使用描述性模板 `"a photo of a {label}"` 优化文本和图像 Embedding 之间的语义对齐。

- **精度指标**:集成 `scikit-learn` 计算混淆矩阵,精细展示语义分类错误。

## 🛡️ 实战级工程 (问题解决)

本项目记录了开发过程中遇到的几个生产级挑战及其解决方案:

1. **安全性 (CVE-2025-32434)**:

- **问题**:PyTorch 2.6+ 安全协议阻止不安全的 `.bin` (Pickle) 文件。

- **解决方案**:通过 `use_safetensors=True` 强制执行 **Safetensors** 格式,实现零拷贝、安全的模型加载。

2. **环境鲁棒性 (WinError 14007)**:

- **问题**:Windows 非管理员账户缺乏 Hugging Face 缓存的 Symlink 权限。

- **解决方案**:实施 `HF_HUB_DISABLE_SYMLINKS=1` 并建立手动缓存清理协议,确保跨平台兼容性。

3. **预处理对齐**:

- **问题**:发现由于冗余的图像重缩放(uint8 与 float 归一化)导致了 **0.06 的精度失效**。

- **解决方案**:重构 `CLIPProcessor` Pipeline 以正确处理原始 `uint8` 输入,成功将准确率恢复至 88.8%。

4. **网络优化**:

- **问题**:本地网络限制下无法访问 Hugging Face Hub。

- **解决方案**:配置 `HF_ENDPOINT` 镜像和 `local_files_only=True`,实现高速、离线部署。

## 🚀 快速开始

### 1. 安装

```

pip install torch transformers pillow numpy tqdm scikit-learn seaborn matplotlib

```

### 2. 数据集设置

下载 CIFAR-10 Python 版本,并将 `cifar-10-batches-py` 文件夹放置在项目根目录下。

### 3. 运行评估

```

# 在 Windows 上,只需运行预配置的 batch file:

.\run.bat

# 或通过 Python 手动运行:

python full_cifar_clip_eval.py

```

## 📁 项目结构

```

clip_eval_project/

├── full_cifar_clip_eval.py # Core evaluation script

├── run.bat # One-click run entry

├── confusion_matrix.png # Confusion matrix result

├── cifar-10-batches-py/ # CIFAR-10 raw data

│ └── test_batch # Test set data

└── README.md # Project documentation

```

## 📄 许可证

本项目基于 MIT 许可证授权。详情请参阅 [LICENSE](LICENSE) 文件。

## 🙏 致谢

- OpenAI 开发 CLIP 模型

- CIFAR-10 数据集创建者

- Hugging Face 提供 Transformers 库

- PyTorch 团队提供深度学习框架

标签:AI原生开发, CIFAR-10, CLIP模型, CVE-2025-32434, Linux系统监控, NVIDIA RTX 2060, Python, PyTorch, Safetensors, Trae, ViT, 人工智能, 凭据扫描, 图像分类, 多模态, 提示词工程, 无后门, 模型安全, 深度学习, 用户模式Hook绕过, 策略决策点, 系统调用监控, 自动评估流水线, 计算机视觉, 逆向工具, 零样本学习, 高性能计算