PhilipLykov/LogSentinelAI

GitHub: PhilipLykov/LogSentinelAI

一款集成了 MITRE 映射与六维 AI 评分的开源 SIEM 平台,旨在通过大模型技术高效解析日志并发现安全威胁与运维隐患。

Stars: 1 | Forks: 0

# LogSentinel AI

**AI 驱动的日志智能与 SIEM 平台(支持 MITRE ATT&CK 映射)**

LogSentinel AI 将原始日志流转化为可执行的安全与运维智能。它持续收集、归一化并存储来自任意来源的日志事件,随后应用多维 AI 分析以揭示威胁、预测故障并检测异常——包含可选的 MITRE ATT&CK 技术识别与置信度评分——所有功能均通过直观的实时仪表板呈现。

## 截图

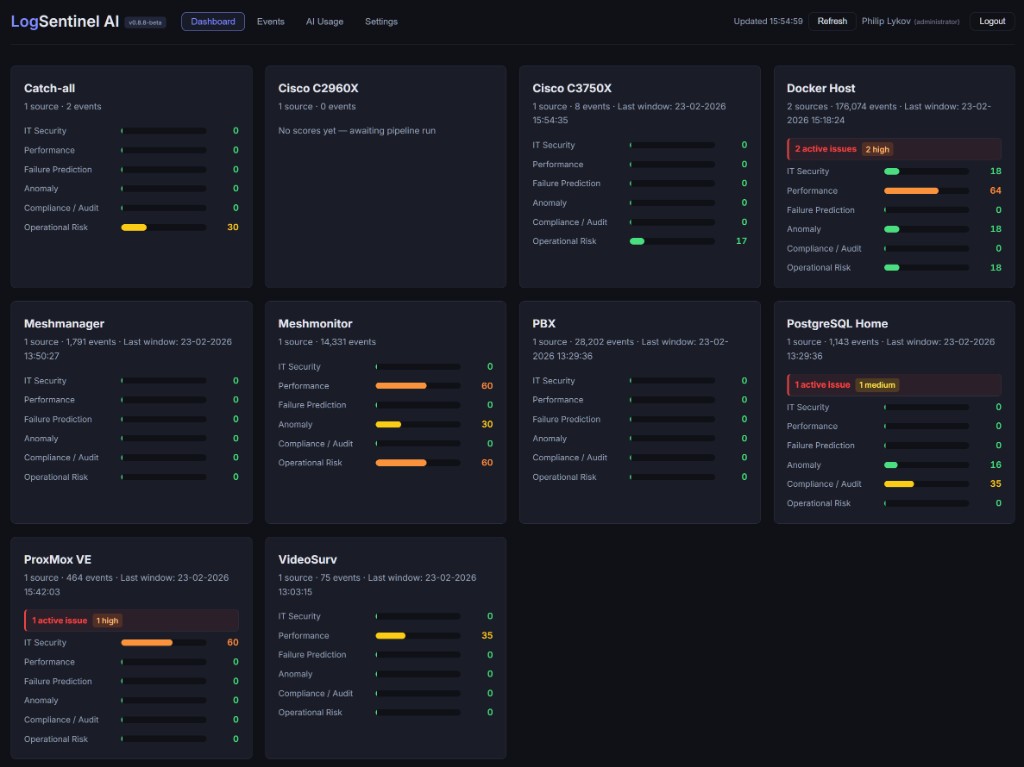

### 仪表板

所有受监控系统的实时概览,包含 6 项标准的 AI 评分条、活跃问题徽章及最后分析时间戳。

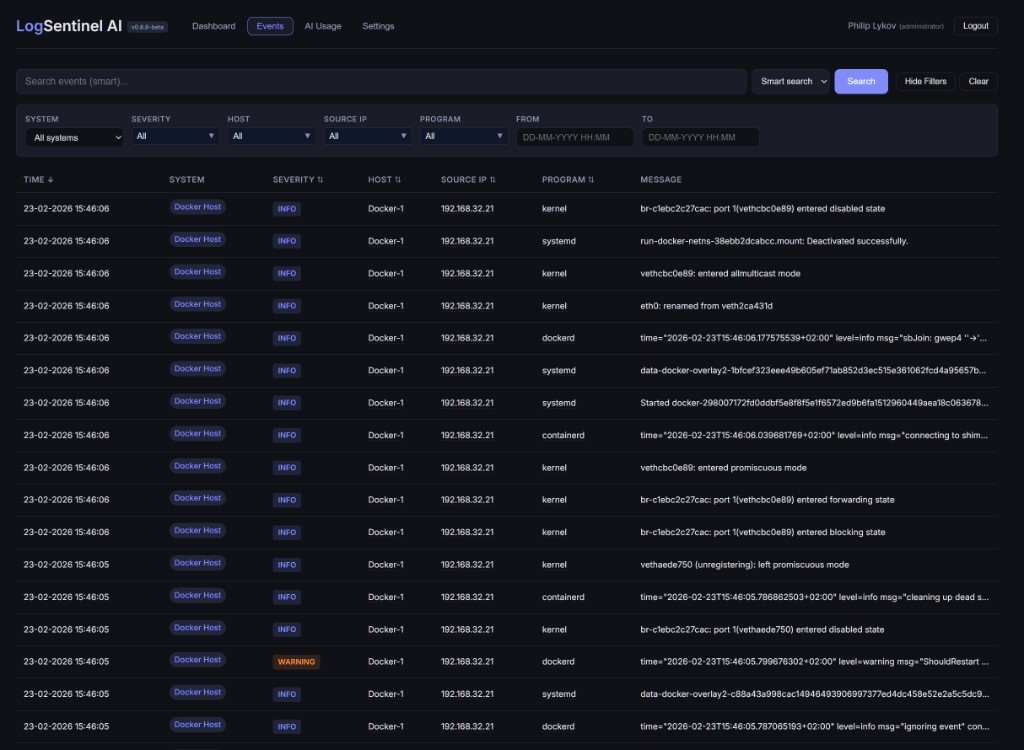

### 事件浏览器

跨所有系统的全文搜索,支持按严重性、主机、源 IP、程序和时间范围进行筛选。支持自然语言查询的智能搜索模式。

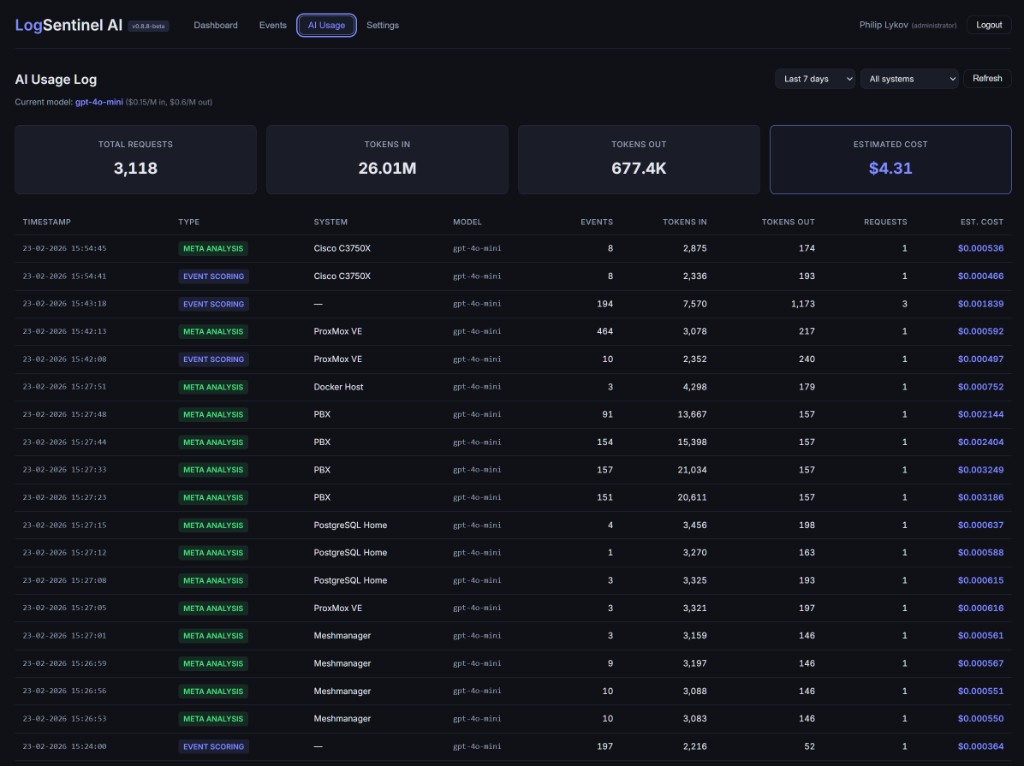

### AI 使用量与成本追踪

每次请求的 LLM 使用日志,包含 Token 计数、预估成本及系统级细分。支持所有 OpenAI 兼容模型。

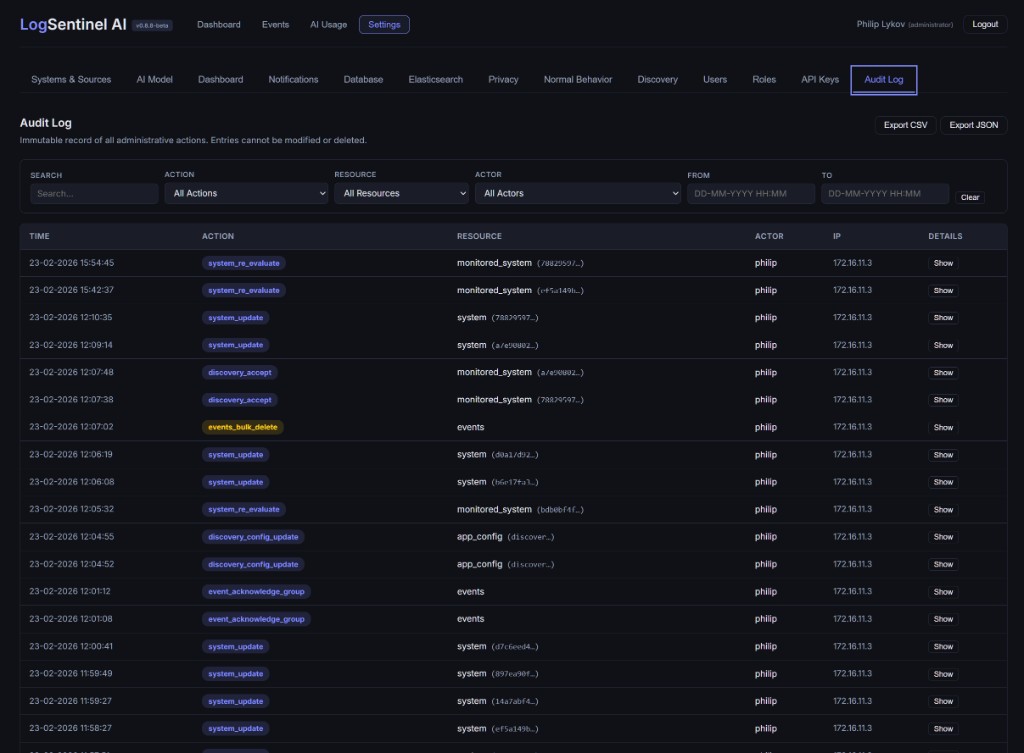

### 审计日志

所有管理员操作的不可变记录,包含执行者追踪、IP 日志记录及用于合规性的 CSV/JSON 导出。

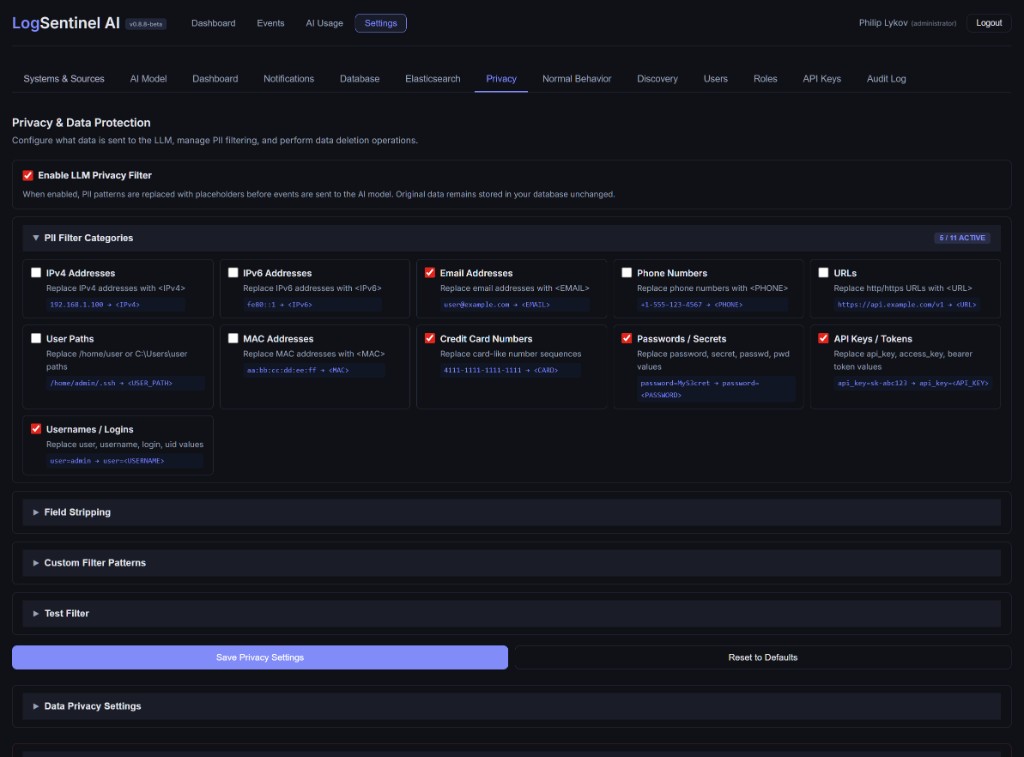

### 隐私与数据保护

可配置的 PII 脱敏,支持 11 种内置类别、自定义正则表达式模式、字段剥离及实时测试过滤器。

## 为什么选择 LogSentinel AI?

### AI 驱动的分析

- **6 项标准事件评分** —— 每个摄取的事件都会由 LLM 从 IT 安全性、性能下降、故障预测、异常检测、合规/审计及运维风险六个维度进行评估。每项标准均使用专用的、可调整的系统提示词,以便领域专家在无需触碰代码的情况下校准 AI 的判断。

- **带发现的元分析** —— 滑动窗口流水线将单事件分数汇总为整体评估,生成具有完整生命周期管理的结构化发现:自动去重(TF-IDF + Jaccard 相似度 + LLM 级重复预防)、严重性衰减以及问题不再复发时的自动解决。发现现在包含可选的 AI 置信度 (0-1) 及相关的 MITRE ATT&CK 技术 ID。

- **基于内容的严重性增强** —— Syslog 标头的严重性通常不准确(例如,Docker 将所有内容记录为 "info")。平台会扫描消息体中的错误/警告指示器并自动升级严重性,从而将 `error: permission denied` 等事件正确分类。

- **RAG "Ask AI"** —— 查询您整个事件历史的自然语言界面。提问诸如 *"昨晚是否有任何失败的 SSH 登录?"* 或 *"总结过去一周的 Docker 容器问题"* 等问题,并保留聊天历史。

- **Token 优化** —— 通过模板提取进行智能去重、评分缓存、严重性预过滤及可配置的批处理大小,在不牺牲分析质量的前提下减少高达 80% 的 LLM 成本。包含每模型成本估算的实时使用追踪让支出透明可见。

- **JSON 感知的事件分组** —— 结构化日志消息(Pino、Winston、Bunyan JSON)会被自动解包:提取内部的 `msg`/`message` 字段用于去重,防止不相关的 JSON 事件折叠到同一个模板中。

- **动态流水线调度** —— 分析流水线根据活动情况调整间隔:事件到达时更快(可配置最小值,默认 15 分钟),安静期间指数退避至可配置最大值(默认 2 小时),从而最大限度地减少空闲系统的 LLM 调用。

- **异步重评估流程** —— 手动重评估在后台运行,并实时轮询进度:首先对未评分事件进行评分,重新计算有效分数,然后使用全新的上下文窗口触发 LLM 元分析。UI 显示已用时间并在完成后自动刷新。可配置的时间窗口(默认 7 天)和事件上限(默认 500)。

- **生产级日志记录** —— 所有后端模块的集中式、分级日志记录。自动请求日志已禁用以防止自我摄取循环。`LOG_LEVEL` 环境变量控制详细程度(生产环境 Docker 中默认为 `warn`,开发环境中为 `info`)。Fluent Bit 自过滤模式通过命名约定自动检测项目容器。

### UX & UI

- **实时仪表板** —— 跨所有 6 项标准的每个系统的实时评分条,基于 SSE 自动刷新。点击任意评分条可深入查看促成事件,并透明地细分为来自 AI 元分析与单个事件评分的部分。

- **事件浏览器** —— 全文搜索,支持按系统、严重性、主机、源 IP 或程序即时过滤。分页结果支持直接页码输入、关键词高亮、可排序列、过滤计数指示器,以及通过 trace ID 或消息关联进行的跨系统事件追踪。

- **AI 发现面板** —— 选项卡式界面(开放 / 已确认 / 已解决),支持一键确认、批量操作及自动生命周期转换。每个发现都显示一个 "显示事件" 按钮以查看触发它的源事件。元分析摘要以视觉区分的方式显著展示。

- **按组事件确认** —— 直接从标准细目视图中一键确认单个事件组。可以同时确认多个组而不会阻塞。后台分数重新计算使用异步合并队列来避免数据库争用,同时确保所有变更得到反映。已确认的事件将从分数计算和元分析中排除。通过 "显示已确认" 复选框切换已确认事件的可见性。

- **完全可通过 GUI 配置** —— 每个设置都可以通过 Web 界面调整:AI 模型参数、系统提示词、通知渠道、数据库维护计划、隐私过滤器、用户账户及 API 密钥。初始部署后无需 SSH 或编辑配置文件。

- **响应式告警** —— 可视化通知配置,每个渠道都有测试按钮。定义具有严重性阈值、静默窗口、限流及恢复通知的告警规则。

- **计划报告** —— 在 **设置 > 通知 > 计划报告** 中配置周期性摘要/CSV/JSON 报告,通过现有的通知渠道路由它们,并一键按需运行报告。

### 安全与隐私

- **基于角色的访问控制 (RBAC)** —— 三种内置角色(管理员、审计员、监控代理)及 20 项细粒度权限,控制对每个 UI 元素和 API 端点的访问。审计员获得只读访问权限;监控代理可以查看仪表板并确认事件,但不能更改设置。

- **用户管理** —— 用户名/密码认证,使用 bcrypt 哈希(cost 12),强制密码复杂度(12 位以上字符,包含大小写、数字、特殊字符),失败尝试后自动锁定账户,以及首次登录强制更改密码。

- **会话与 API 密钥安全** —— 会话使用加密随机 Token,以 SHA-256 哈希形式存储,具有可配置的过期时间。API 密钥支持基于范围的权限、IP 白名单、过期日期及一键撤销。

- **不可变审计日志** —— 每个管理操作都记录时间戳、执行者、IP 地址及完整详情。PostgreSQL 触发器从物理上阻止修改或删除审计记录。导出为 CSV 或 JSON 用于合规性报告。

- **隐私控制** —— PII 脱敏(IP 地址、电子邮件、电话号码、URL、MAC 地址、信用卡、密码、API 密钥、用户名),支持可配置的自定义正则表达式模式。字段剥离在提交给 LLM 之前移除敏感字段。带有确认保护的批量事件删除。

- **OWASP Top 10 合规** —— 参数化查询 (A03),通过 Helmet 实现的安全标头 (A05),速率限制 (A04),密钥仅存储在环境变量中 (A02),非 root Docker 容器 (A05),通用错误消息 (A07),全面的安全日志记录 (A09),以及对所有连接器 URL(包括 Kafka REST Proxy `base_uri` 响应)的 SSRF 防护 (A10)。

### 可扩展性

- **基于时间的表分区** —— 事件表按月自动分区。新分区按需创建;旧数据通过删除整个分区而非逐行删除来清理,从而实现数百万条记录的瞬间清理。

- **高效索引** —— system_id + timestamp、severity、source_ip、全文搜索的组合索引,以及针对 meta_results、effective_scores 和已确认事件的优化热路径索引。计划的 `REINDEX CONCURRENTLY` 和 `VACUUM ANALYZE` 保持查询性能随数据增长而稳定。

- **可配置的数据保留** —— 全局和单系统保留策略自动清除旧事件。结合分区,这允许不同系统拥有不同的保留窗口(例如,调试日志 30 天,安全事件 365 天)。

- **水平事件摄取** —— 无状态摄取 API 接受三种 JSON 格式(批处理、数组、单个)的事件,可同时来自任意数量的日志发送器。兼容 Fluent Bit、Vector、Logstash、rsyslog 及自定义 HTTP 客户端。

- **内置日志收集器** —— 可选的 Fluent Bit 容器接收 Syslog (UDP/TCP) 和 OpenTelemetry (OTLP/HTTP + gRPC) 并转发至摄取 API。使用 `--profile collector` 部署。来自 OTel/Beats 代理的 ECS 字段会自动扁平化。应用级多行合并会在到达后端之前重新组合跨越多行的 Docker 容器日志(数组、堆栈跟踪、格式化对象)。

- **自动数据库备份** —— 计划的 pg_dump 备份,具有可配置格式(自定义二进制或纯 SQL)、保留限制及直接从 UI 下载的功能。

- **Elasticsearch 集成** —— 混合事件存储:每个受监控系统可以直接从现有 Elasticsearch 集群读取事件(只读),而 AI 分析结果保留在 PostgreSQL 中。支持多个 ES 连接、索引浏览器、字段自动检测及 ECS 字段扁平化。无需重复日志数据。

### 企业级功能

- **多系统监控** —— 从单个部署监控无限系统。每个系统都有独立的日志源选择器(基于正则的字段匹配及优先级排序)、保留策略和 AI 分析流水线。

- **自动系统发现** —— 未匹配的传入事件会自动缓冲并按主机、源 IP 和程序分组。系统检测新的日志源,生成智能名称,使用可配置阈值和正则忽略模式过滤噪声,检查现有系统亲和性,并在仪表板横幅中提供建议。用户可以接受(创建新系统 + 日志源)、合并到现有系统或忽略建议 —— 全部通过 UI 完成。完全可配置:分组开关、最小事件阈值、速率过滤器、缓冲区 TTL 及自动接受模式。

- **支持 DST 感知的时区** —— 每个受监控系统都可以指定 IANA 时区(例如 `Europe/Berlin`)以进行自动 DST 感知的时间戳校正。系统计算每个事件时间戳处的正确 UTC 偏移量,自动处理夏令时/冬令时转换。三种模式选择器:无、IANA 时区(DST 感知)或固定 UTC 偏移量。

- **自动时区检测助手** —— 对于非 ES 系统,系统可以通过比较事件 `timestamp` 与 `received_at` 的偏差(至少 3 小时内的最少 20 个事件)来建议时区设置。UI 在应用更改前显示置信度统计、建议偏移量和可选的 IANA 时区。

- **灵活的带 OR 组日志源匹配** —— 基于正则的选择器通过字段的任意组合(主机、source_ip、服务、程序、设施)将传入事件匹配到系统。多个 AND 条件组可以与 OR 逻辑结合,实现复杂的路由,如 "匹配 (host=web-01 AND program=nginx) OR (host=web-02 AND program=nginx)"。优先级排序确保特定规则优先于通用规则。

- **按源解析配置** —— 每个日志源可以选择确定性解析配置(`none`、`common`、`docker`、`cron`、`proxmox`、PostgreSQL、MySQL/MariaDB、Apache、nginx、Cisco、MikroTik、ProCurve、Asterisk、systemd、OpenSSH、iptables、postfix、HAProxy)。配置定义了多行模式、提取正则和严重性覆盖,UI 提示会准确显示 "底层" 和结果中发生了什么变化。

- **全面告警** —— 五种通知渠道(Webhook、Pushover、NTfy、Gotify、Telegram),具有可配置的规则、严重性阈值、静默窗口、限流间隔和恢复告警。密钥通过环境变量引用 —— 永远不存储在数据库中。

- **合规导出** —— 一键导出 CSV 或 JSON 格式的事件、分数和发现,用于法规合规性和外部审计,包括可用的 AI 分析置信度。

- **按标准 AI 提示词** —— 6 项评分标准中的每一项都有一个独立可配置的系统提示词,允许安全团队注入特定领域的指导(例如,针对 IT 安全的 *"标记任何 SSH 暴力破解模式"*,针对性能的 *"监控磁盘 I/O 饱和"*)。

- **LLM 提供商灵活性 —— 适用于任何 OpenAI 兼容 API(OpenAI、Azure OpenAI、Ollama、LM Studio、vLLM)。通过 GUI 更改模型或提供商,无需重新部署。

- **外部拉取连接器** —— 从现有平台摄取而无需替换您的堆栈:通过 Connectors API 提供 Elasticsearch、Loki、LogTide、VictoriaLogs、RabbitMQ 和 Kafka REST Proxy 连接器类型。

## 架构

```

┌─────────────────────────────────────────────┐

│ Log Sources │

│ Syslog (UDP/TCP) │ OpenTelemetry (OTLP) │

│ Beats / Logstash │ Custom HTTP clients │

└────────┬──────────────────┬─────────────────┘

│ │

┌─────────────▼──────────┐ │

│ Fluent Bit Collector │ │

│ (--profile collector) │ │

│ Syslog + OTel inputs │ │

└─────────────┬──────────┘ │

│ │

┌────────▼──────────────────▼─────────────────┐

│ Ingest API (HTTP) │

│ ECS Flatten → Normalize → Severity Enrich │

│ → Source Match → Privacy Redact → Persist │

│ (unmatched → Discovery Buffer) │

└────────┬────────────────────────────────────┘

│

┌──────────────────▼───────────────────────────────┐

│ Event Storage │

│ PostgreSQL (default) │ Elasticsearch (hybrid) │

└──────────┬─────────────────────┬─────────────────┘

│ │

┌──────────▼─────────────────────▼─────────────────┐

│ AI Pipeline │

│ Dedup → Per-Event Scoring → Windowing │

│ → Meta-Analysis → Finding Dedup (TF-IDF) │

│ → Discovery Grouping Engine │

└────────────────────┬─────────────────────────────┘

│

┌────────────────────▼─────────────────────────────┐

│ Dashboard (React) ←→ Alerting Engine │

│ • Event Explorer (search, filter, trace, ack) │

│ • AI Findings (open, acknowledged, resolved) │

│ • RAG "Ask AI" (natural language queries) │

│ • Settings (AI, Elasticsearch, privacy, DB) │

│ • User Management (RBAC, API keys, audit log) │

│ • LLM Usage & Cost Tracking │

└──────────────────────────────────────────────────┘

```

## 技术栈

| 组件 | 技术 |

|-----------|-----------|

| 后端 | Node.js 22, Fastify, TypeScript |

| 数据库 | PostgreSQL 14+ (分区), Knex.js 迁移, Elasticsearch 7+/8+ (可选, 只读混合) |

| 前端 | React 19, Vite, TypeScript |

| AI | OpenAI 兼容 API (GPT-4o-mini, GPT-4.1, GPT-5, o3/o4-mini, Ollama 等) |

| 认证 | bcrypt, SHA-256 会话 Token, RBAC (20 项权限) |

| 部署 | Docker, docker-compose, nginx |

| 安全 | Helmet, CORS, 速率限制, 不可变审计日志 |

## 安装指南

### 快速开始 (Docker — 5 分钟)

您只需要 Docker。AI 模型和 API 密钥在首次登录后通过 Web UI 配置。

#### 选项 A — 一体化 (包含 PostgreSQL)

所有内容都在 Docker 内运行 —— 无需外部数据库。

```

git clone https://github.com/PhilipLykov/LogSentinelAI.git

cd LogSentinelAI/docker

cp .env.example .env

# 编辑 .env:设置 DB_PASSWORD(选择一个强密码)和 DB_HOST=postgres

docker compose --profile db up -d --build

```

#### 选项 B — 外部 PostgreSQL (自带数据库)

使用您现有的 PostgreSQL 服务器。只有后端和仪表板在 Docker 中运行。

```

git clone https://github.com/PhilipLykov/LogSentinelAI.git

cd LogSentinelAI/docker

cp .env.example .env

# 编辑 .env:设置 DB_HOST= 和 DB_PASSWORD

docker compose up -d --build

```

#### 可选:启用日志收集器 (Syslog + OpenTelemetry)

添加 `--profile collector` 以通过 Syslog 和 OTel 直接接收日志:

```

# 首先在 .env 中设置 INGEST_API_KEY(在 Settings > API Keys 中创建)

docker compose --profile db --profile collector up -d --build

```

这将启动一个 Fluent Bit 容器,监听 **端口 5140** (Syslog UDP/TCP) 和 **端口 4318** (OpenTelemetry OTLP/HTTP + gRPC)。

#### 首次登录

```

docker compose exec backend sh -lc "cat /app/bootstrap-secrets.txt"

# 在浏览器中打开 http://localhost:8070

```

使用显示的用户名和密码登录。首次登录时,系统会提示您更改密码。然后前往 **设置 > AI 模型** 配置您的 LLM API 密钥。

## API 概览

所有端点都需要通过 `Authorization: Bearer ` 标头或 `X-API-Key` 标头进行认证。

| 类别 | 端点 | 描述 |

|----------|-----------|-------------|

| **Auth** | `POST /api/v1/auth/login`, `/logout`, `/me`, `/change-password` | 基于会话的认证 |

| **Users** | `GET/POST/PUT/DELETE /api/v1/users` | 具有角色分配的用户 CRUD |

| **API Keys** | `GET/POST/PUT/DELETE /api/v1/api-keys` | 具有范围和 IP 白名单的密钥管理 |

| **Audit Log** | `GET /api/v1/audit-log`, `/export` | 具有 CSV/JSON 导出的不可变审计追踪 |

| **Ingest** | `POST /api/v1/ingest` | 批量事件摄取 (3 种 JSON 格式) |

| **Systems** | `GET/POST/PUT/DELETE /api/v1/systems` | 受监控系统 CRUD |

| **Sources** | `GET/POST/PUT/DELETE /api/v1/sources` | 具有可选解析配置绑定的日志源选择器 CRUD |

| **Parse Profiles** | `GET /api/v1/parse-profiles` | 可用的解析器配置、类别、多行模式及 UI 说明 |

| **Events** | `GET /api/v1/events/search`, `/facets`, `/trace` | 搜索、过滤、跨系统追踪 |

| **Dashboard** | `GET /api/v1/dashboard/systems` | 带分数的概览 |

| **Scores** | `GET /api/v1/scores/systems`, `/stream` | 有效分数, SSE 流 |

| **Findings** | `GET /api/v1/systems/:id/findings` | 具有生命周期的 AI 发现 |

| **RAG** | `POST /api/v1/ask` | 自然语言事件查询 |

| **AI Config** | `GET/PUT /api/v1/ai-config`, `/ai-prompts` | 模型和提示词配置 |

| **Alerting** | `GET/POST/PUT/DELETE /api/v1/notification-channels`, `/notification-rules`, `/silences` | 通知管理 |

| **Scheduled Reports** | `GET/POST/PUT/DELETE /api/v1/scheduled-reports`, `POST /api/v1/scheduled-reports/:id/run-now` | 周期性报告管理及手动执行 |

| **Connectors** | `GET/POST/PUT/DELETE /api/v1/connectors`, `GET /api/v1/connectors/types` | 外部拉取连接器管理 |

| **Discovery** | `GET/PUT /api/v1/discovery/config`, `GET /api/v1/discovery/suggestions`, `/count`, `POST /:id/accept`, `/:id/merge`, `/:id/dismiss` | 自动发现配置及建议管理 |

| **Elasticsearch** | `GET/POST/PUT/DELETE /api/v1/elasticsearch/connections`, `/test`, `/:id/indices`, `/:id/mapping`, `/:id/preview` | ES 连接 CRUD、测试、索引浏览器 |

| **Database Info** | `GET /api/v1/database/info` | PostgreSQL + Elasticsearch 状态概览 |

| **Maintenance** | `GET/PUT /api/v1/maintenance-config`, `/backup/*` | 数据库维护和备份 |

| **Privacy** | `GET/PUT /api/v1/privacy-config` | PII 脱敏配置 |

## LLM 成本优化

部署 AI 驱动的日志分析时,最普遍的顾虑之一是 LLM API 成本。LogSentinel AI 实施了 **16 种独立的优化技术**,它们协同工作,与简单的单事件分析相比,可减少 80-95% 的 Token 使用量 —— 且不牺牲检测质量。所有优化均 **可通过 Web UI 配置**,并具有开箱即用的合理默认值。

### 工作原理

```

Raw Events (thousands/min)

│

▼

┌──────────────────────────┐

│ 1. Template Dedup │── Groups identical message patterns (e.g., 500 identical

│ │ "link up/down" events become 1 template with count=500)

└──────────┬───────────────┘

▼

┌──────────────────────────┐

│ 2. Pre-Filters │── Severity filter, normal-behavior filter, privacy filter

│ │ skip known-routine events without any LLM call

└──────────┬───────────────┘

▼

┌──────────────────────────┐

│ 3. Score Caching │── Previously scored templates reuse cached results

│ (TTL: 6 hours) │ for up to 6 hours (configurable)

└──────────┬───────────────┘

▼

┌──────────────────────────┐

│ 4. Batched LLM Calls │── Remaining templates sent in batches of 20

│ (20 per call) │ with truncated messages (512 chars max)

└──────────┬───────────────┘

▼

┌──────────────────────────┐

│ 5. Smart Meta-Analysis │── Zero-score windows skip LLM entirely;

│ │ zero-score events filtered from prompt

└──────────┬───────────────┘

▼

AI Scores & Findings

```

### 优化技术

| # | 技术 | 描述 | 默认值 | UI 可配置 |

|---|-----------|-------------|---------|-----------------|

| 1 | **模板去重** | 按消息模式(模板提取)对事件进行分组。与其对 500 个相同的 "link up" 事件进行评分,不如对 1 个计数为 500 的模板进行评分。仅此一项通常就能为重复性日志源减少 90% 以上的 LLM 调用。 | 始终开启 | — |

| 2 | **评分缓存** | 每个模板缓存 LLM 评分。如果相同的消息模式在 TTL 窗口内已被评分,则重用缓存的结果。消除跨流水线运行的冗余调用。 | 开 (6 小时 TTL) | 是 |

| 3 | **正常行为过滤** | 匹配用户定义的 "标记为正常" 模板的事件将自动评为 0 分,无需任何 LLM 调用。运维人员教系统哪些是常规操作,从而永久从分析中移除噪声。 | 开 (当模板存在时) | 是 |

| 4 | **严重性预过滤** | 指定严重性级别(例如 debug)的事件将自动评为 0 分,无需 LLM 调用。对于产生数千个低价值调试事件的嘈杂系统很有用。 | 关 | 是 |

| 5 | **低分自动跳过** | 在多次流水线运行中持续评分为近零的模板将自动评为 0 分。LLM "教会" 系统什么是噪声,系统停止询问。 | 关 | 是 |

| 6 | **消息截断** | 事件消息在提交给 LLM 之前被截断为可配置的最大长度。诊断价值几乎总是位于前几百个字符中;长堆栈跟踪会浪费 Token。 | 开 (512 字符) | 是 |

| 7 | **批处理大小** | 多个模板被分组到单个 LLM API 调用中。系统提示词每批发送一次,而不是每个事件发送一次,从而减少开销。 | 开 (20/批次) | 是 |

| 8 | **零分窗口跳过 (O1)** | 当分析窗口中的每个事件在单事件评分期间均得分为 0 时,元分析 LLM 调用将完全跳过。改为写入合成的 "无问题" 结果。为安静系统节省最多资源。 | 开 | 是 |

| 9 | **零分事件过滤 (O2)** | 评分为 0 的事件将从元分析提示词中排除,从而减少输入 Token。仅将非零分数的事件发送以进行更高级别的分析。 | 开 | 是 |

| 10 | **高分优先** | 在应用元分析事件上限之前,事件按分数(降序)排序。这确保最重要的总是被包括在内,即使在达到上限时也是如此。 | 开 | 是 |

| 11 | **元分析事件上限** | 每个窗口发送到元分析的事件硬性限制。防止非常活跃系统上的 Token 爆炸,同时通过高分优先确保分析质量。 | 开 (200 个事件) | 是 |

| 12 | **按任务模型选择** | 对不同任务使用不同模型:用于单事件评分的更便宜模型(例如 `gpt-4o-mini`)和用于元分析摘要的更强大模型(例如 `gpt-4o`)。优化每个任务的成本质量比。 | 关 (使用全局模型) | 是 |

| 13 | **可配置流水线间隔** | 调整分析流水线运行的频率。自适应调度:活动时重置为最小值,空闲时退避至最大值。 | 开 (15–120 分钟自适应) | 是 |

| 14 | **评分块大小** | 控制评分循环的批量获取大小。流水线分块处理所有未评分事件(带有 10 分钟的时间守卫),因此不会永久跳过任何事件。较小的块减少内存使用;较大的块减少数据库往返。 | 开 (5000/块) | 是 |

| 15 | **隐私过滤** | 在提交给 LLM 之前剥离或掩盖 PII 字段(IP、电子邮件、路径、凭据)。除了合规性之外,这还通过从提示词中移除非诊断数据来减少 Token 数量。 | 关 | 是 |

| 16 | **可配置上下文窗口** | 控制作为 LLM 上下文包含的先前分析摘要数量。摘要越少 = 输入 Token 越少。可根据您的分析需要多少历史上下文进行调整。 | 开 (5 个窗口) | 是 |

### 成本追踪

LogSentinel AI 追踪每次 LLM API 调用:

- **每次请求的指标**:使用的模型、输入/输出 Token、预估成本 (USD)

- **单系统细分**:查看哪些受监控系统消耗最多 Token

- **每日使用图表**:可视化随时间变化的支出趋势

- **任务级追踪**:单独追踪评分、元分析和 RAG 查询

所有使用数据均可通过 Web UI 中的 **设置 > LLM 使用情况** 仪表板访问。

### 典型成本概况

使用默认设置和中等日志量(约 5 个系统每天 10,000 个事件),用户通常会看到:

| 模型 | 预估每月成本 |

|-------|----------------------|

| `gpt-4o-mini` (推荐) | $2 – $10 |

| `gpt-4o` | $15 – $60 |

| 自托管 (Ollama/vLLM) | $0 (仅硬件) |

## 项目文档

| 文档 | 内容 |

|----------|----------|

| [CHANGELOG.md](./CHANGELOG.md) | 包含详细变更说明的发布历史 |

| [INSTALL.md](./INSTALL.md) | 完整的安装和部署指南 |

| [AI_ANALYSIS_SPEC.md](./AI_ANALYSIS_SPEC.md) | 评分标准、元分析、仪表板规范 |

| [FEATURES_AND_INTEGRATIONS.md](./FEATURES_AND_INTEGRATIONS.md) | 连接器、通知、功能规范 |

| [SECURITY_OWASP.md](./SECURITY_OWASP.md) | OWASP Top 10 合规性映射 |

## 许可证

MIT

标签:AMSI绕过, DLL 劫持, Elasticsearch, HTTP/HTTPS抓包, IP 地址批量处理, Kafka, LLM 应用, Loki, MITM代理, MITRE ATT&CK 映射, OISF, Petitpotam, PE 加载器, PII 脱敏, RabbitMQ, RBAC 权限控制, SIEM 平台, SonarQube插件, 人工智能, 大语言模型, 威胁检测, 安全运营, 异常检测, 态势感知, 扫描框架, 数据摄入, 日志管理, 测试用例, 用户模式Hook绕过, 网络安全, 网络安全, 自动化攻击, 自动化攻击, 自动化攻击, 自动化运维, 评分系统, 请求拦截, 隐私保护, 隐私保护