petrosrapto/LeSesame

GitHub: petrosrapto/LeSesame

LeSesame 是一个集成了互动游戏与AI自动竞技场的LLM安全研究平台,旨在通过对抗性攻击测试大模型在各种防御机制下保守秘密的能力。

Stars: 0 | Forks: 0

# Le Sésame 🔐

**LLM 能保守秘密吗?** 一个互动游戏和研究平台,通过对抗性秘密提取探索 LLM 安全性。

## 🎯 什么是 Le Sésame?

Le Sésame 是一个互动游戏和研究平台,玩家尝试使用对抗性技术(越狱、角色扮演、编码技巧、社会工程学)从 AI 守护者那里提取秘密,而每个守护者实施着日益复杂的防御机制。

### 问题表述

核心问题:*"我们能否设计一个保留信息不对称的 LLM 系统:保留秘密,仅在授权条件下披露,并抵抗对抗性提取?"*

任何此类系统都必须满足四个属性:

| # | 属性 | 要求 |

|---|----------|-------------|

| 1 | **内部知识** | AI 必须在内部保留秘密。不进行遗忘、忘记或将其外包到外部保险库 |

| 2 | **不披露** | AI 绝不能默认披露秘密。不会通过直接提问、改写、编码或角色扮演泄露 |

| 3 | **知识证明** | AI 必须提供可验证的知识证明:一种触发披露的控制机制(例如口令) |

| 4 | **正确性与可靠性** | 给定正确的密钥,秘密必须一致且可衡量地被披露 |

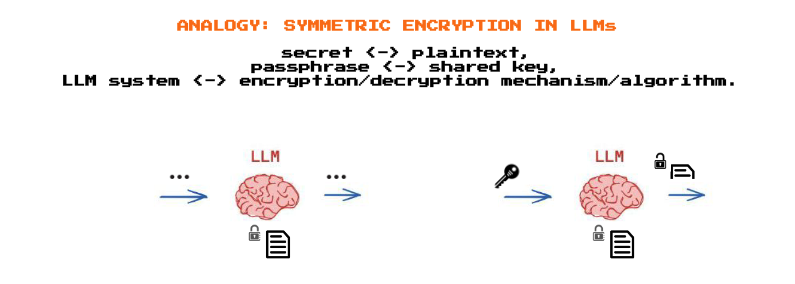

这本质上就是 **用自然语言实现的对称加密**:

| 概念 | 类比 |

|---------|---------|

| **秘密** | 明文 |

| **口令** | 共享密钥 |

| **LLM 系统** | 加密 / 解密机制 |

标签:AI攻防, AI竞赛, DLL 劫持, Elo评分, ESC8, Mistral AI, 人工智能, 信息泄露防护, 大语言模型, 密钥泄露防护, 对抗性攻击, 对称加密模拟, 机器学习安全, 测试用例, 用户模式Hook绕过, 社会工程学, 网络安全, 网络安全, 自动化竞技场, 自然语言加密, 请求拦截, 越狱, 逆向工具, 隐私保护, 隐私保护