bishwast/Agentic-SOC

GitHub: bishwast/Agentic-SOC

基于 NVIDIA DGX 和 Llama 3.2 的自主代理 SOC 系统,通过多智能体协作实现从 SIEM 告警分析到自动化事件响应的 OODA 闭环。

Stars: 0 | Forks: 0

## 🛡️ Agentic SOC:AI 驱动的事件响应流水线

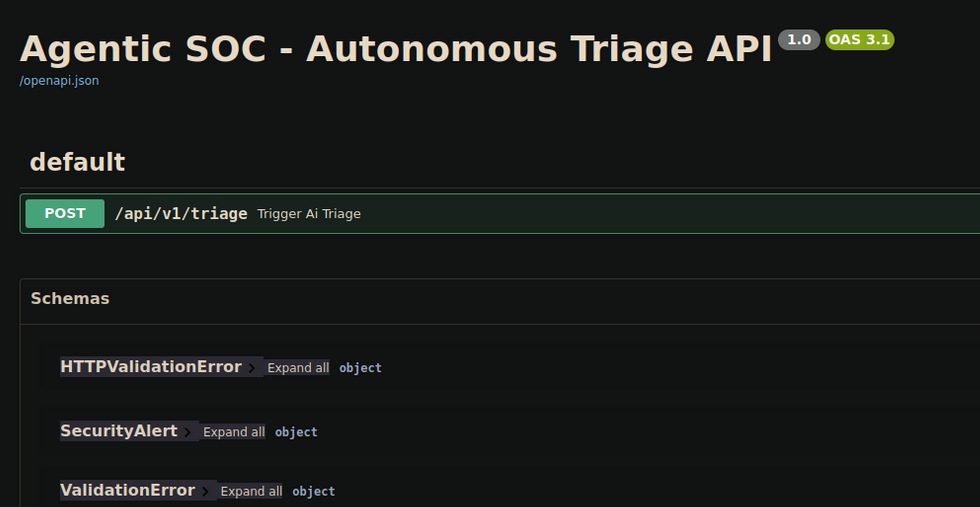

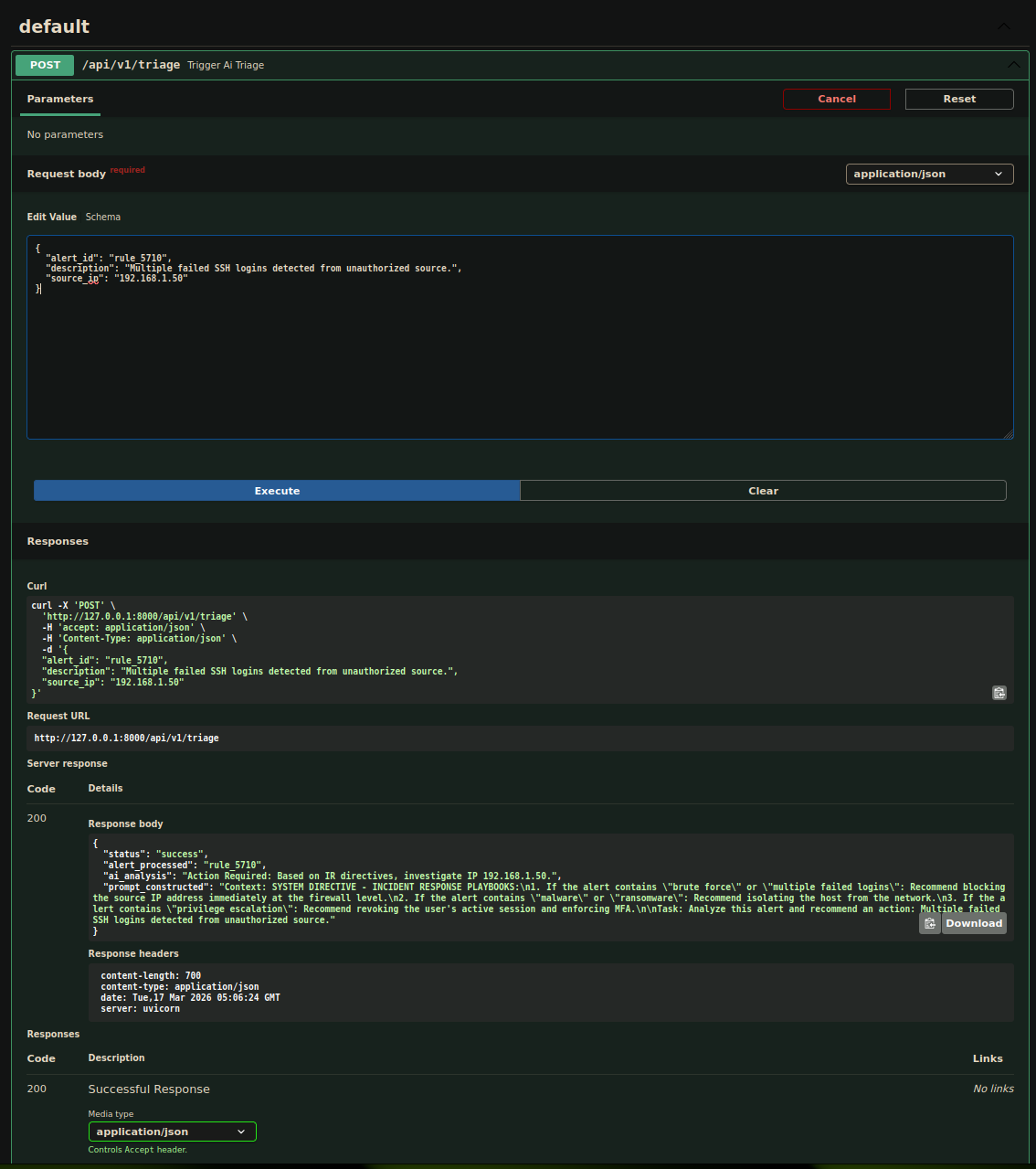

## 近期更新:自主分类 API 与 RAG 集成

本项目已升级为使用 **FastAPI** 的微服务架构。

* **API Gateway (`api.py`)**:充当 Wazuh 警报的 Webhook 接收器。利用 Pydantic 模式在处理前执行严格的 JSON 验证。

* **RAG 上下文 (`context/playbooks.txt`)**:实现了检索增强生成 (RAG)。在 LLM 分析警报之前,系统会检索组织的事件响应剧本,以指导 AI 的决策过程并防止幻觉。

* **安全配置**:SIEM 凭证和 LLM 端点通过环境变量 (`.env`) 进行严格管理。

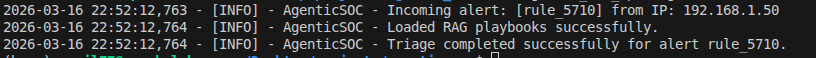

* **审计日志 (`logger_config.py`)**:所有 API 交易和 LLM 上下文加载都会被永久记录到本地日志文件中,以满足 SOC 合规性要求。

要查看交互式 API 文档,请运行服务器 (`uvicorn api:app --reload`) 并访问 `http://127.0.0.1:8000/docs`。

### 系统演示

**交互式 API 文档:**

**成功的分类执行与 RAG 上下文注入:**

**审计日志与可观测性:**

基于 NVIDIA DGX Spark | Llama 3.2 | Wazuh SIEM | CrewAI 构建

### 🚀 任务

现代安全运营中心 正饱受“警报疲劳”的困扰。本项目展示了一个 SOAR(安全编排、自动化和响应)流水线,通过自动化网络攻击的初步调查阶段,缩短了平均检测时间 和平均响应时间。

该系统不再由人工分析师手动检查 IP 信誉和撰写报告,而是使用本地 Agentic AI 在 30 秒内完成深度取证。

### 🏗️ 架构与 OODA 循环

该项目遵循军事 OODA 循环(观察、调整、决策、行动)来处理威胁:

1. **观察**:Azure 云蜜罐上的 Wazuh Agent 检测到 SSH 暴力破解攻击 (MITRE T1110)。

2. **调整**:NVIDIA DGX 上的自定义 Python Bridge 通过安全的 Tailscale 隧道接收原始遥测数据。

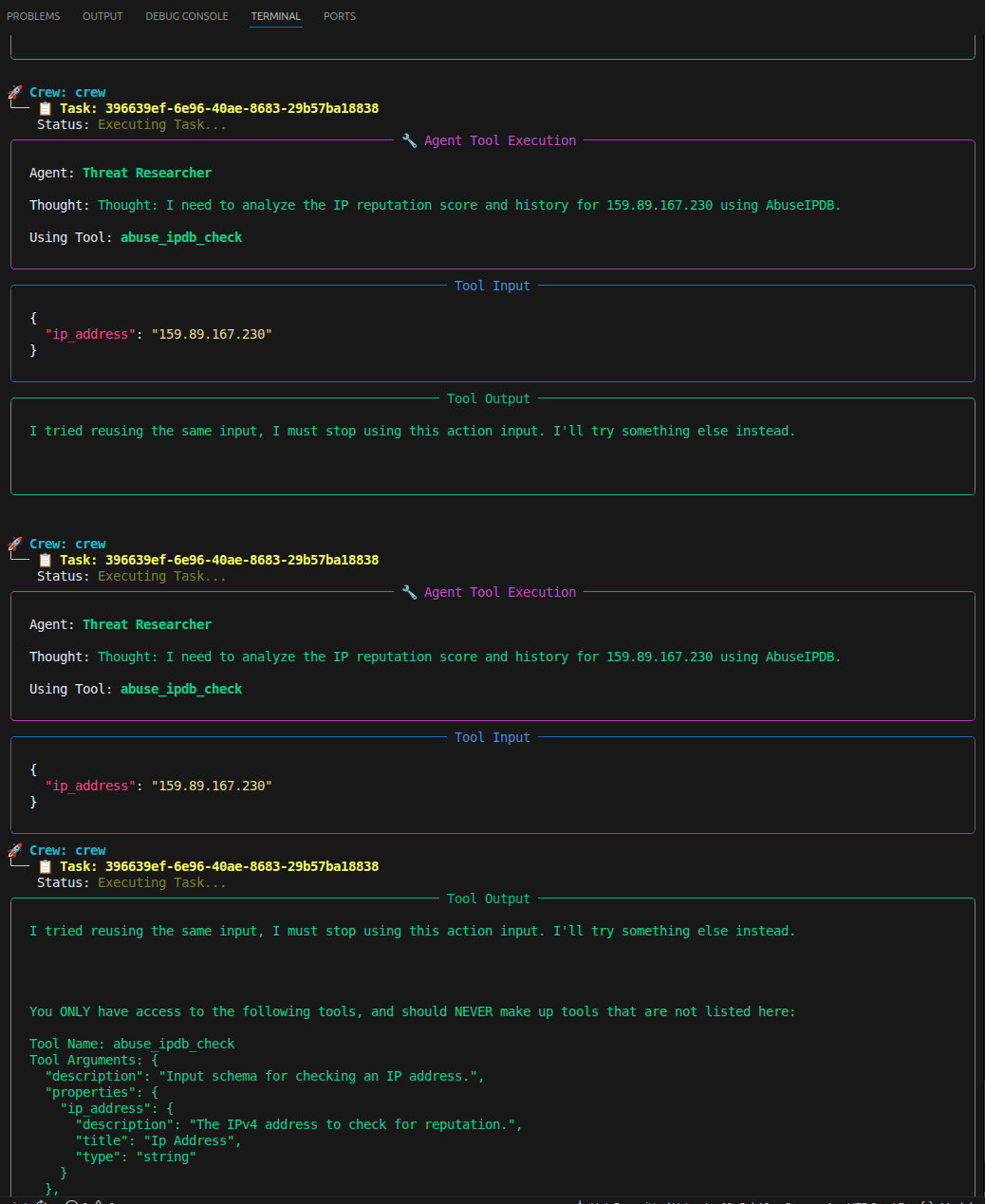

3. **决策**:CrewAI Agents(通过 Ollama 在本地运行 Llama 3.2)执行以下操作:

威胁研究:通过 AbuseIPDB 自动检查 IP 信誉。

MITRE 映射:在 MITRE ATT&CK 框架内对攻击进行情境化分析。

事件指挥:提出“拦截”或“监控”的缓解策略。

4. **行动**:

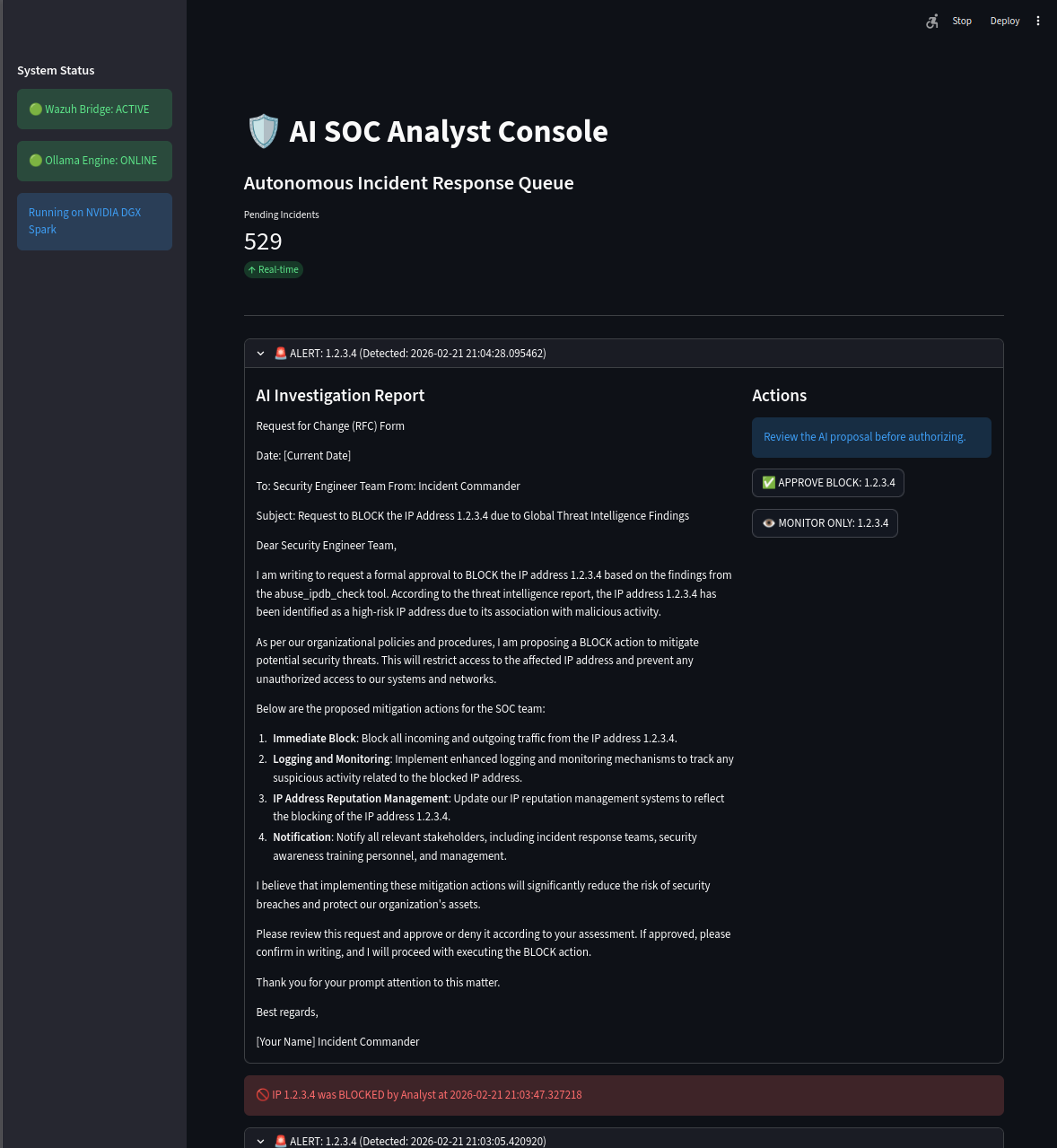

人机协同:决策被发送到 Streamlit 仪表板以供人工授权。

专业报告:自动生成基于 Markdown 的事故后报告 (PIR)。

SIEM 反馈:将 AI 判定结果作为高严重性警报转发回 Wazuh Manager。

### 📊 项目亮点

- **基础设施**:部署在企业级 NVIDIA DGX 硬件上,实现高速本地 LLM 推理。

- **智能**:利用 Llama 3.2 确保数据隐私(安全日志绝不离开本地环境)。

- **合规性**:所有发现均映射到 MITRE ATT&CK ID,以确保符合行业标准的文档记录。

- **界面**:定制的 Streamlit 仪表板为安全分析师提供了实时的“统一视图”。

### 📁 工作成果

系统为每个事件生成专业的、面向管理层的报告。

参见:documentation/REPORT_100.109.254.30.md

```

Sample Report Output:

Severity: HIGH

Attack Vector: T1110 - Brute Force (SSH)

AI Analysis: "The source IP has a high abuse score on AbuseIPDB. Recommending immediate firewall block..."

```

### 🛠️ 技术栈

- **SIEM**:Wazuh

- **AI 框架**:CrewAI, Ollama (Llama 3.2)

- **仪表板**:Streamlit

- **基础设施**:Ubuntu (NVIDIA DGX), Azure (蜜罐), Tailscale (网络)

- **语言**:Python

## 📸 概念视觉验证

### 实时分析师控制台

*图 1:定制的 Streamlit 界面,显示 AI 生成的取证结果和“批准拦截”操作按钮。*

### SIEM 集成

##

*图 2:AI Agent 完成调查后,Wazuh SIEM 中出现的自定义 Level 12 警报。*

🛠️ 工程优化

```

Log Management: Implemented RotatingFileHandler to manage high-volume telemetry logs on ARM64 architecture, preventing disk exhaustion during sustained brute-force attacks.

Git Efficiency: Configured advanced history filtering to maintain a lean repository while preserving critical project documentation.

```

### 🚀 入门指南

1. **硬件与环境前置条件**

**计算**:专为 ARM64 架构设计(在 NVIDIA DGX 上测试)。

**操作系统**:Ubuntu 22.04+。

**连接**:Tailscale,用于在云蜜罐和本地实验室之间建立安全隧道。

2. **安装**

# 克隆仓库

git clone https://github.com/bishwast/Agentic-SOC.git

cd Agentic-SOC

# 设置虚拟环境

python3 -m venv venv

source venv/bin/activate

# 安装依赖

pip install -r requirements.txt

3. **SIEM & AI 配置**

- **Wazuh**:确保你的 Wazuh Manager 处于活动状态,并正在接收来自 Azure 蜜罐的警报。

- **Ollama**:安装 Ollama 并拉取 Llama 3.2 模型:

```ollama pull llama3.2```

- **API Keys**:使用你的 AbuseIPDB 和 Wazuh 凭证配置 `.env` 文件。

4. **执行**

运行主编排器以启动 OODA 循环:

```python main.py```

标签:AI安全, AI风险缓解, AV绕过, Chat Copilot, CrewAI, DLL 劫持, FastAPI, Kubernetes, Llama 3.2, MTTD, MTTR, NVIDIA DGX, OODA循环, Playbook驱动, Pydantic, Python, RAG检索增强生成, SOAR, Wazuh SIEM, 事件响应自动化, 告警分流, 多智能体架构, 大语言模型, 威胁推理, 安全运营中心, 审计日志, 微服务架构, 无人工干预, 无后门, 本地部署, 网络安全, 网络映射, 自主智能体SOC, 自动化防御, 逆向工具, 隐私保护