pensarai/apex

GitHub: pensarai/apex

一款融合 LLM 自主智能体与传统渗透工具的命令行安全测试框架,支持黑盒白盒测试并提供可解释的漏洞分析结果。

Stars: 46 | Forks: 12

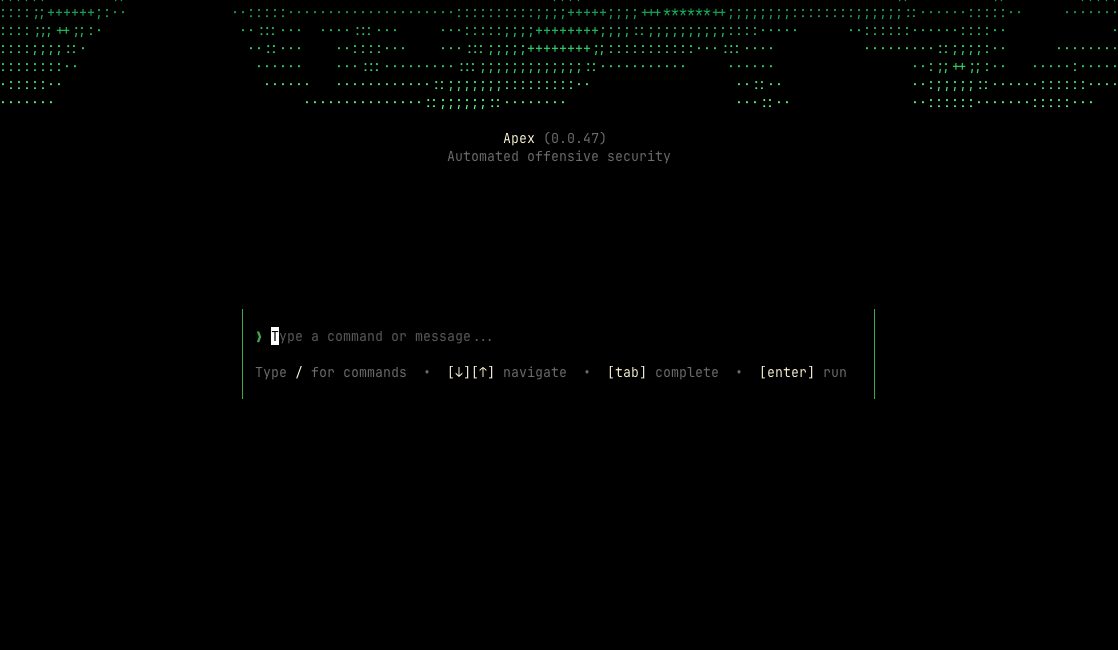

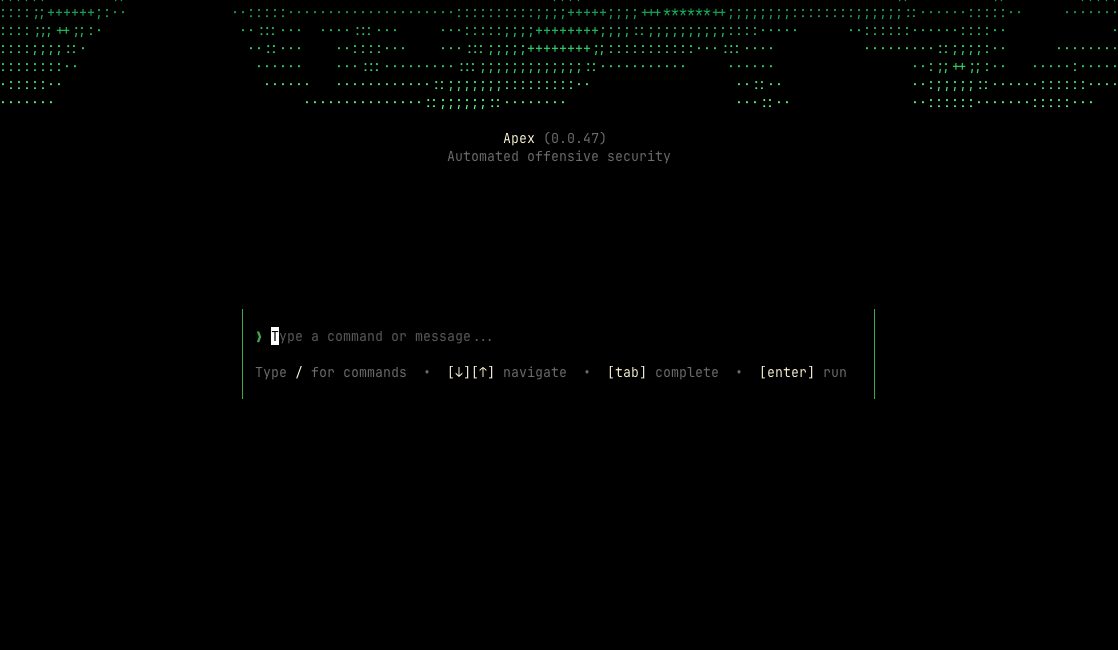

Pensar Apex

AI 驱动的渗透测试工具,让你能在终端中直接使用 AI agent 执行全面的黑盒与白盒渗透测试。

## 安装

### 前置条件

- 你所选 AI provider 的 **API Key**

安装完成后,运行 `pensar doctor` 以检查可选依赖项(如 nmap)并进行安装。

### 安装 Apex

#### macOS / Linux (快速安装)

```

curl -fsSL https://pensarai.com/install.sh | bash

```

#### Homebrew

```

brew tap pensarai/tap

brew install apex

```

#### Windows (PowerShell)

```

irm https://pensarai.com/apex.ps1 | iex

```

#### npm

```

npm install -g @pensar/apex

```

### 配置

将你的 AI provider API key 设置为环境变量:

```

export ANTHROPIC_API_KEY="your-api-key-here"

# 或其他提供商:

export OPENAI_API_KEY="your-api-key-here"

export OPENROUTER_API_KEY="your-api-key-here"

# AWS Bedrock (bearer token auth):

export BEDROCK_API_KEY="your-bearer-token"

export AWS_REGION="us-east-1"

# AWS Bedrock (IAM credentials):

export AWS_ACCESS_KEY_ID="..."

export AWS_SECRET_ACCESS_KEY="..."

export AWS_SESSION_TOKEN="..." # optional, for temporary credentials

export AWS_REGION="us-east-1"

```

## 使用方法

运行 Apex:

```

pensar

```

## AI Provider 支持

Apex 支持 **OpenAI**、**Anthropic**、**AWS Bedrock** 和 **vLLM**(本地模型)。**Anthropic 模型性能最佳**,推荐使用以获得最佳效果。

## Kali Linux 容器(推荐)

为了获得**最佳性能**,请在包含预配置渗透测试工具的 Kali Linux 容器中运行 Apex:

```

cd container

cp env.example .env # add your API keys

docker compose up --build -d

docker compose exec kali-apex bash

```

在容器内运行:

```

pensar

```

**注意:** 在 Linux 主机上,建议在 `docker-compose.yml` 中使用 `network_mode: host` 以进行全面网络扫描。

## vLLM 本地模型支持

使用本地 vLLM 服务器:

1. 设置 vLLM endpoint:

```

export LOCAL_MODEL_URL="http://localhost:8000/v1"

```

2. 在 Apex Models 屏幕中,在 “Custom local model (vLLM)” 输入框中输入你的模型名称。

### ⚠️ 负责任的使用

本仓库包含的工具仅用于**授权的安全测试**。

使用前,请阅读并同意 [负责任的使用声明](./RESPONSIBLE_USE.md)。

标签:AI安全, Chat Copilot, Cilium, CreateRemoteThread, DLL 劫持, GNU通用公共许可证, LLM, MITM代理, Node.js, NPM, TGT, Unmanaged PE, 人工智能, 可解释性AI, 大语言模型, 密码管理, 插件系统, 攻防演练, 用户模式Hook绕过, 白盒测试, 目标识别, 网络安全, 自主智能体, 自动化代理, 自动化攻击, 请求拦截, 隐私保护, 黑盒测试