MemoriLabs/Memori

GitHub: MemoriLabs/Memori

为AI智能体提供持久化记忆的基础设施,能将对话和执行过程转化为结构化状态,彻底解决智能体会话遗忘问题。

Stars: 13812 | Forks: 1778

[](https://memorilabs.ai/)

### 快速入门

在 [app.memorilabs.ai](https://app.memorilabs.ai) 注册,获取 Memori API 密钥,然后开始构建。完整文档:[memorilabs.ai/docs/memori-cloud/](https://memorilabs.ai/docs/memori-cloud/)。

设置 `MEMORI_API_KEY` 和您的 LLM API 密钥(例如 `OPENAI_API_KEY`),然后:

## 探索记忆

使用[仪表盘](https://app.memorilabs.ai) — 记忆、分析、演练场和 API 密钥。

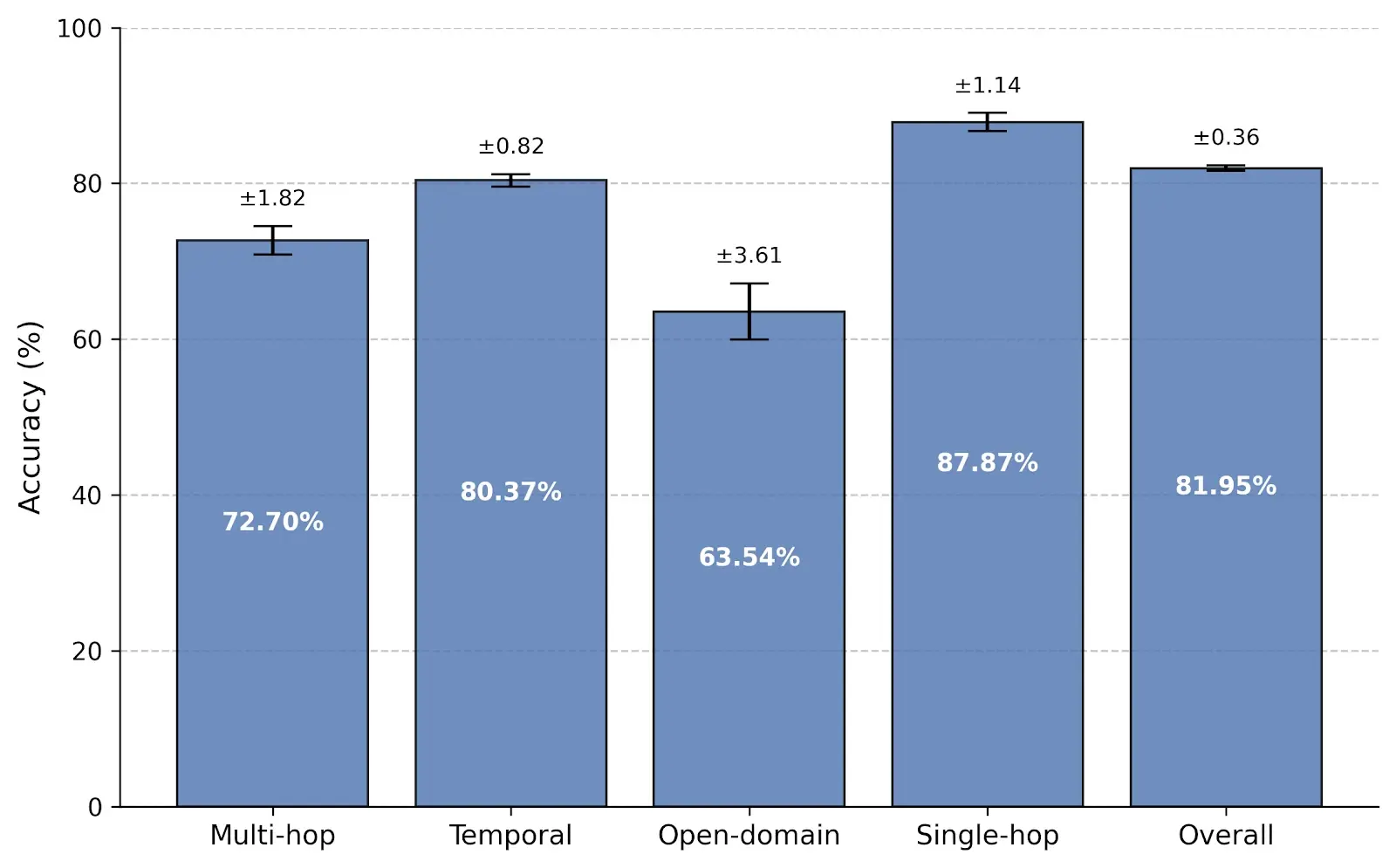

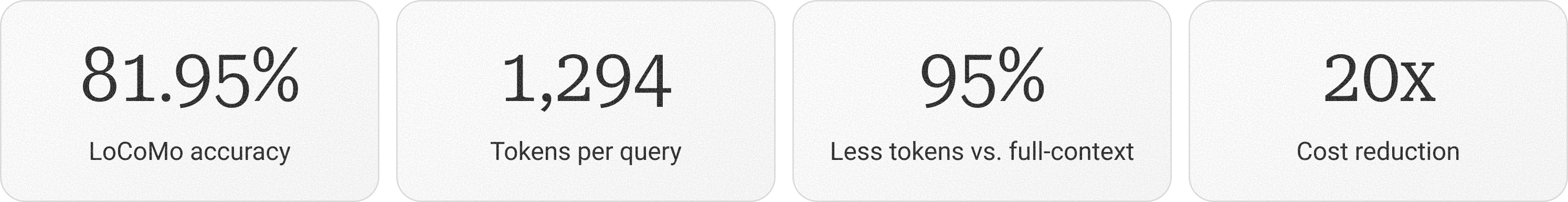

## LoCoMo 基准测试

Memori 在用于长对话记忆的 LoCoMo 基准测试上进行了评估,并实现了 **81.95% 的整体准确率**,同时每次查询平均仅使用 **1,294 个 token**。这仅仅是 **完整上下文占用空间的 4.97%**,表明结构化记忆可以在无需向每个请求中强制注入大型提示的情况下保持推理质量。

与其他基于检索的记忆系统相比,Memori 的表现优于 Zep、LangMem 和 Mem0,同时将提示大小减少了约 **67%(对比 Zep)**,并将上下文成本降低了 **20 倍以上(对比完整上下文提示)**。

阅读[基准测试概述](docs/memori-cloud/benchmark/overview.mdx),查看[结果](docs/memori-cloud/benchmark/results.mdx),或下载[论文](https://arxiv.org/abs/2603.19935)。

## OpenClaw(为您的网关提供持久记忆)

默认情况下,OpenClaw 智能体会在会话之间遗忘所有内容。Memori 插件解决了这个问题。它会在每次对话后捕获持久的事实和偏好,然后自动将最相关的上下文注入到未来的提示中。

您无需更改智能体代码或提示。该插件会挂载到 OpenClaw 的生命周期中,因此您只需通过一个即插即用的插件即可获得结构化记忆、智能召回和高级增强。

```

openclaw plugins install @memorilabs/openclaw-memori

openclaw plugins enable openclaw-memori

openclaw config set plugins.entries.openclaw-memori.config.apiKey "YOUR_MEMORI_API_KEY"

openclaw config set plugins.entries.openclaw-memori.config.entityId "your-app-user-id"

openclaw gateway restart

```

有关设置和配置,请参阅 [OpenClaw 快速入门](docs/memori-cloud/openclaw/quickstart.mdx)。有关架构和生命周期详细信息,请参阅 [OpenClaw 概述](docs/memori-cloud/openclaw/overview.mdx)。

## MCP(通过一条命令连接您的智能体)

您的智能体在会话之间会遗忘所有内容。Memori 解决了这个问题。它会记住您的技术栈、您的约定以及您的工作偏好,让您免于不断重复。

适用于个人开发者和团队。您的智能体会随着时间推移学习编码模式、审查偏好和项目约定。对于团队而言,这意味着新工程师在第一天就能掌握共享的上下文,而不是花费数月时间来消化隐性知识。

如果您使用 Claude Code、Cursor、Codex、Warp 或 Antigravity,您无需进行 SDK 集成即可连接 Memori:

```

claude mcp add --transport http memori https://api.memorilabs.ai/mcp/ \

--header "X-Memori-API-Key: ${MEMORI_API_KEY}" \

--header "X-Memori-Entity-Id: your_username" \

--header "X-Memori-Process-Id: claude-code"

```

对于 Cursor、Codex、Warp 和其他客户端,请参阅 [MCP 客户端设置指南](docs/memori-cloud/mcp/client-setup.mdx)。

## 归因

为了充分利用 Memori,您需要将您的 LLM 交互归因于一个实体(可以是人、地点或事物;例如用户)和一个过程(例如您的智能体、LLM 交互或程序)。

如果您不提供任何归因,Memori 将无法为您生成记忆。

## 会话管理

Memori 使用会话将您的 LLM 交互分组在一起。例如,如果您有一个执行多个步骤的智能体,您肯定希望将这些步骤记录在同一个会话中。

默认情况下,Memori 会为您处理会话设置,但您可以通过执行以下操作来启动新会话或覆盖当前会话:

## 支持的 LLM

- Anthropic

- Bedrock

- DeepSeek

- Gemini

- Grok (xAI)

- OpenAI(Chat Completions 和 Responses API)

_(非流式、流式、同步和异步)_

## 支持的框架

- Agno

- LangChain

- Pydantic AI

## 支持的平台

- DeepSeek

- Nebius AI Studio

## 示例

获取更多示例和演示,请查阅 [Memori Cookbook](https://github.com/MemoriLabs/memori-cookbook)。

## Memori 高级增强

记忆在以下几个不同层级进行追踪:

- **实体 (entity)**:可以是人、地点或事物;例如用户

- **过程 (process)**:例如您的智能体、LLM 交互或程序

- **会话 (session)**:实体、过程和 LLM 之间的当前交互

[Memori 高级增强](docs/memori-cloud/concepts/advanced-augmentation.mdx) 通过以下方式增强各个层级的记忆:

- 属性

- 事件

- 事实

- 人物

- 偏好

- 关系

- 规则

- 技能

Memori 了解您的用户是谁,知道您的智能体处理什么任务,并在两者之间创建无与伦比的上下文联系。增强过程在后台进行,不会产生任何延迟。

默认情况下,无需账户即可使用 Memori 高级增强,但有频率限制。当您需要提升限制时,请[注册 Memori 高级增强](https://app.memorilabs.ai/signup)或使用 Memori CLI:

```

# 通过 pip 安装 CLI 以管理你的账户

python -m memori sign-up

```

Memori 高级增强对开发者永久免费!

获取 API 密钥后,请设置以下环境变量(Python 和 TypeScript SDK 均使用):

```

export MEMORI_API_KEY=[api_key]

```

## 管理您的配额

您可以随时使用 Memori CLI(适用于两个 SDK)检查您的配额:

```

python -m memori quota

```

或者通过 [https://app.memorilabs.ai/](https://app.memorilabs.ai/) 检查您的账户。如果您已达到 IP 地址的配额限制,请注册并获取 API 密钥以获得更高的限制。

如果您的 API 密钥超出了配额限制,我们会通过电子邮件通知您。

## 命令行界面 (CLI)

Memori CLI 是一个统一的工具,用于管理您在所有 SDK 中的账户、密钥和配额。要使用它,请从命令行执行以下操作:

```

# 需要已安装 Python

python -m memori

```

这将显示一个包含可用选项的菜单。有关 Memori CLI 可以执行的操作的更多信息,请参阅 [命令行界面](docs/memori-byodb/concepts/cli-quickstart.mdx)。

## 支持

- [**Memori Cloud 文档**](https://memorilabs.ai/docs/memori-cloud)

- [**Memori BYODB 文档**](https://memorilabs.ai/docs/memori-byodb)

- [**Discord**](https://discord.gg/FpytKAxnFb)

- [**问题**](https://github.com/MemoriLabs/Memori/issues)

## 许可证

Apache 2.0 - 详见 [LICENSE](https://github.com/MemoriLabs/Memori/blob/main/LICENSE)

记忆源于智能体的行为,而不仅仅是它们的话语。

Memori 可接入您已经在使用的软件和基础设施。它与 LLM、数据存储和框架无关,并能无缝集成到您现有的架构中。

→ Memori Cloud — Zero config. Get an API key and start building in minutes.

选择高性能的记忆

[](https://memorilabs.ai/benchmark) ## 开始使用 ### 安装TypeScript SDK

``` npm install @memorilabs/memori ```Python SDK

``` pip install memori ```TypeScript SDK

``` import { OpenAI } from 'openai'; import { Memori } from '@memorilabs/memori'; // Requires MEMORI_API_KEY and OPENAI_API_KEY in your environment const client = new OpenAI(); const mem = new Memori().llm .register(client) .attribution('user_123', 'support_agent'); async function main() { await client.chat.completions.create({ model: 'gpt-4o-mini', messages: [{ role: 'user', content: 'My favorite color is blue.' }], }); // Conversations are persisted and recalled automatically in the background. const response = await client.chat.completions.create({ model: 'gpt-4o-mini', messages: [{ role: 'user', content: "What's my favorite color?" }], }); // Memori recalls that your favorite color is blue. } ```Python SDK

``` from memori import Memori from openai import OpenAI # 在你的环境中需要 MEMORI_API_KEY 和 OPENAI_API_KEY client = OpenAI() mem = Memori().llm.register(client) mem.attribution(entity_id="user_123", process_id="support_agent") response = client.chat.completions.create( model="gpt-4o-mini", messages=[{"role": "user", "content": "My favorite color is blue."}] ) # 对话会被自动持久化和召回。 response = client.chat.completions.create( model="gpt-4o-mini", messages=[{"role": "user", "content": "What's my favorite color?"}] ) # Memori 回想起你最喜欢的颜色是蓝色。 ```TypeScript SDK

``` mem.attribution("12345", "my-ai-bot"); ```Python SDK

``` mem.attribution(entity_id="12345", process_id="my-ai-bot") ```TypeScript SDK

``` mem.resetSession(); // or mem.setSession(sessionId); ```Python SDK

``` mem.new_session() # 或 mem.set_session(session_id) ```标签:API, Cilium, DLL 劫持, GNU通用公共许可证, LLM, Memori, Node.js, NPM, Petitpotam, PyPI, Python, SOC Prime, Unmanaged PE, 上下文管理, 中间件, 云服务, 人工智能, 分布式搜索, 基础设施, 大语言模型, 对话历史, 对话系统, 开发工具, 开源, 持久化存储, 数据结构化, 无后门, 框架无关, 状态管理, 生产环境, 用户模式Hook绕过, 记忆系统, 逆向工具, 集成