在本地机器上运行 LLaMA 的最简单方法 | 最高可以支持650亿参数 | dalai

作者:Sec-Labs | 发布时间:

项目地址

https://github.com/cocktailpeanut/dalai

在您的计算机上运行 LLaMA 和 Alpaca。

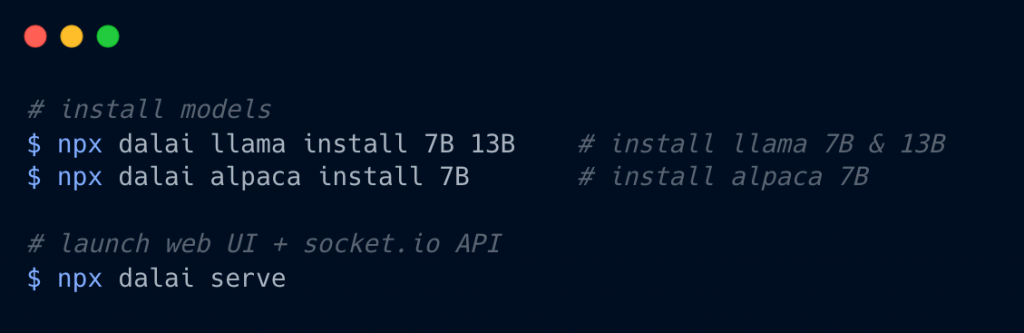

运行这个

效果展示

羊驼和骆驼都在你的电脑上工作!

- 由llama.cpp、llama-dl CDN和alpaca.cpp提供支持

- 包括可入侵的网络应用程序

- 附带 JavaScript API

- 附带Socket.io API

标签:工具分享, ChatGPT