破除一切限制的AI,一文教会你本地部署大模型(不要用来干坏事哦)

作者:修BUG | 发布时间: | 更新时间:

相信大家对于像chatgpt,豆包,元宝这些AI大语言模型应用也不在陌生了,但是同样是随着AI的广泛应用和大面积普及,像这些商用的大语言模型的输出限制也随着监管的越来越严格而越来越多,亦或是怕自己的一些敏感信息被这些大厂的AI应用所窃取导致个人信息泄露(虽然它们承诺不会储存你的这些信息),导致很多时候虽然有这非常智能的AI应用,但是在很多场景却下却如同鸡肋,因此个人用户如何在本地部署一个大语言模型就显得非常迫切,本文就将一步一步的教大家本地部署一个大语言模型。

注意:全过程建议开启魔法上网

ollma

简单来说,Ollama 是一个开源的本地大模型运行框架。在过去,想要在自己的电脑上运行一个几十亿参数的大语言模型(LLM),你需要懂 Python、配置复杂的代码环境、处理各种让人头疼的报错。而 Ollama 的出现彻底打破了这个技术壁垒,它将极其复杂的底层逻辑进行了封装,让普通用户能够像安装普通电脑软件一样,轻松下载并运行各种顶级的开源大模型(如 Meta 的 Llama 3、阿里的 Qwen 等)。

因此要想在本地部署一个大语言模型,首先就需要在自己本地安装一下ollma这个软件

首先我们来到ollma的官网

网站地址

点击右上角的 Download按钮

选择自己本地操作系统对应的版本进行下载 本文将采用Windows系统做演示

ollma Windows版本安装程序 网盘链接

下载好后 点击exe文件进行安装 程序默认是安装到C盘,且在安装时无法更改,同时我也建议各位尽量不要用别的方式更改避免后续报错

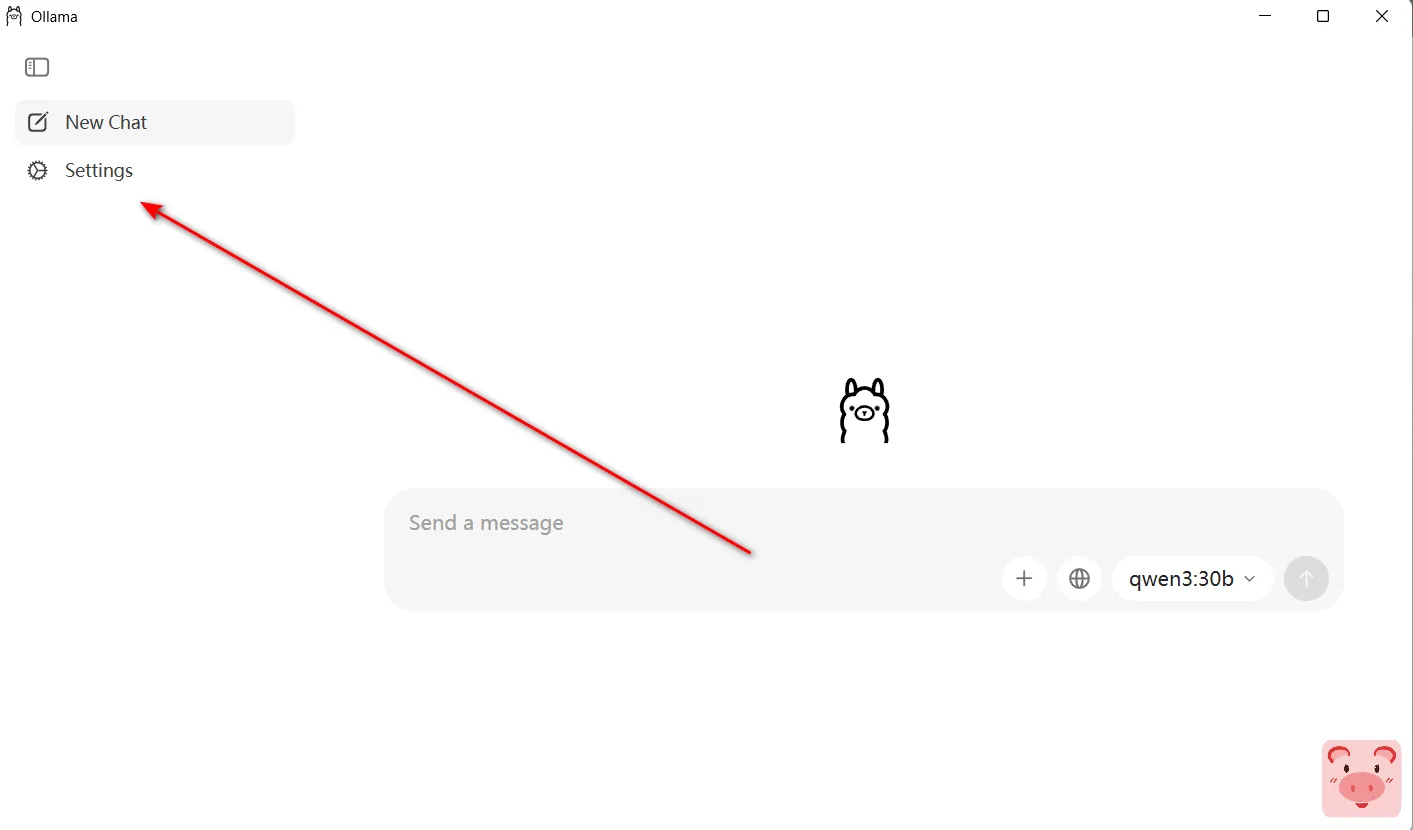

安装完成后打开ollam应用程序 点击settings按钮

Model location 改成除C盘以外的固态盘分区内,不然后续大模型都会装在你C盘里给你C盘撑爆(当然你C盘要是分了1T就当我没说)

当ollma配置好后,我们就要开始去下载模型啦

下载开源大语言模型到本地

首先我们来到ollma官网的模型页面

在官网点击Moldels

然后在这里就可以看到大量的开源的大语言模型如 deepseek glm5 qwen chatgpt

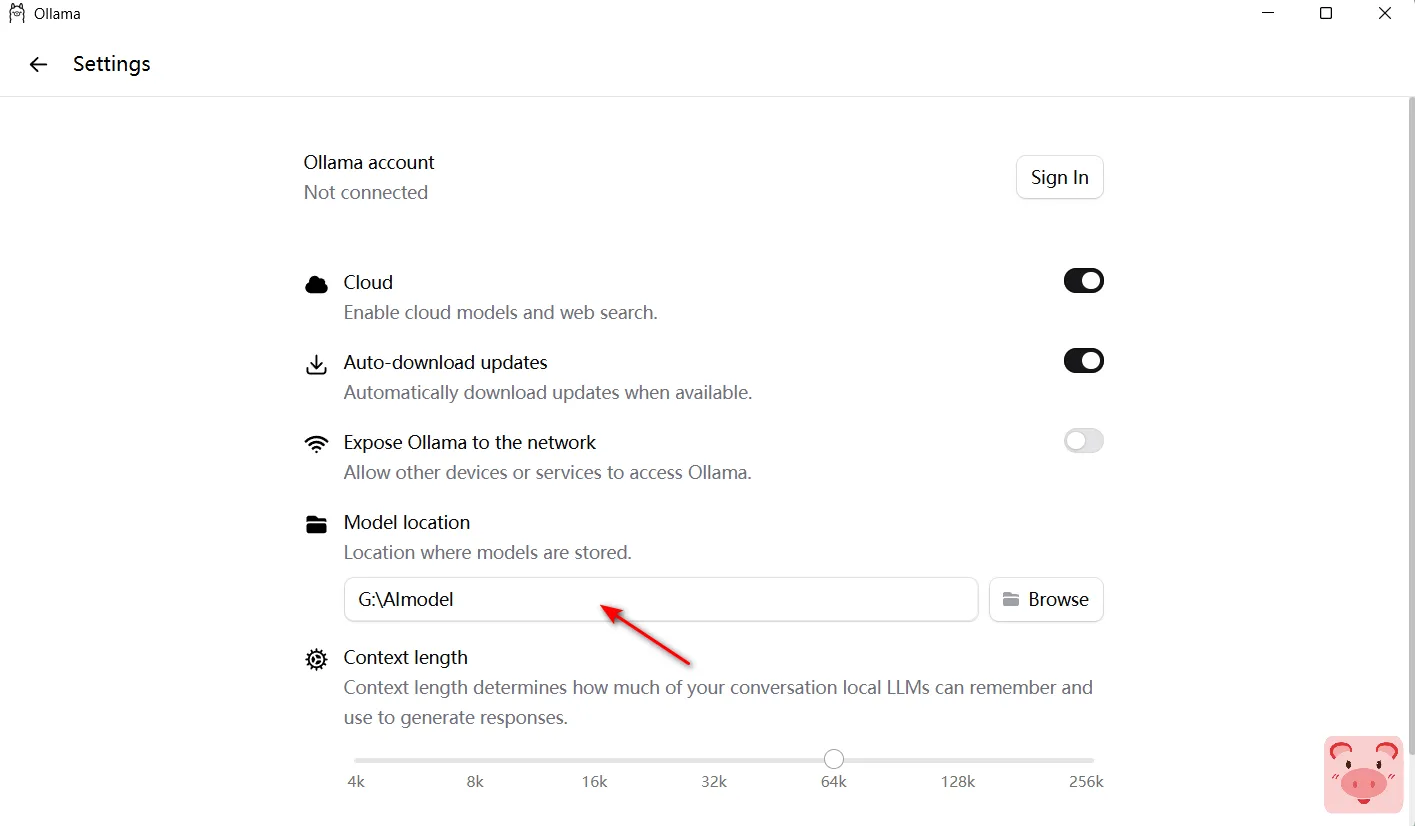

我们这里以deepseek R1 模型举例

点击进去我们可以看到有不同版本的 deepseek R1 模型 以及下载安装该模型的命令代码

为什么同一个模型会有 7b、14b 等这么多版本?我们到底应该怎么选?

很多新手在这里会感到一头雾水,其实理解起来非常简单:这里的字母“b”代表的是英文 Billion(十亿)。 所谓的 7b,就是指这个模型包含了 70 亿个参数;14b 就是 140 亿个参数。你可以把“参数量”直接理解为这个 AI 大脑的“脑细胞数量”参数量越大(如 32b、70b): 模型的“脑细胞”越多,它就越聪明,逻辑推理能力越强,能处理更复杂的长文本和专业问题。但代价是,它非常“吃”你电脑的硬件资源(主要是运行内存和显卡的显存),如果你的电脑配置不够,强行运行会要么根本跑不动,要么一个简单的对话它会需要好几分钟才能给出回答。参数量越小(如 1.5b、7b): 模型相对轻量级,虽然在极其复杂的逻辑问题上可能不如大参数版本聪明,但它对普通电脑非常友好,运行速度极快,用来做日常的文本润色、简单的代码辅助或闲聊已经完全足够了。

这里给大家一些建议

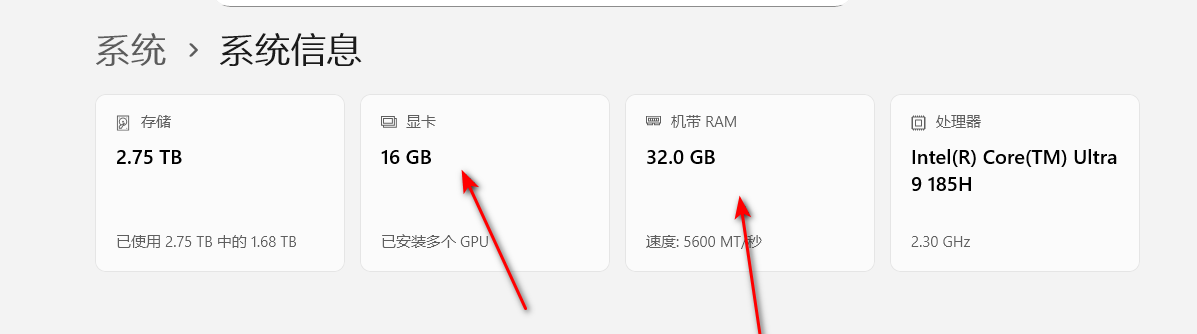

7b 版本(入门首选): 如果你的电脑的内存是8-16GB,显存是4-8GB,建议你选择 7b(或更小参数)的版本。

14b - 32b 版本(进阶体验):如果你的电脑内存达到了 16GB 到 32GB,显存在12-16GB之间,那么你就可以尝试下载这个14b-32b区间段的版本,我自己电脑的配置是32G内存+16G显存,勉强能带的动32b的版本,但是体验并不好,更多的还是使用14b或27b的版本

如何查看自己电脑的配置呢

点击电脑Windows 开始按钮 搜索设置 进入设置页面

然后点击系统

然后点击 系统信息

然后 显卡这里的 16GB 就是你的显存容量 机带RAM 就是你的内存容量啦

现在知道了你电脑的配置后 就可以选择适合的模型进行下载安装了。

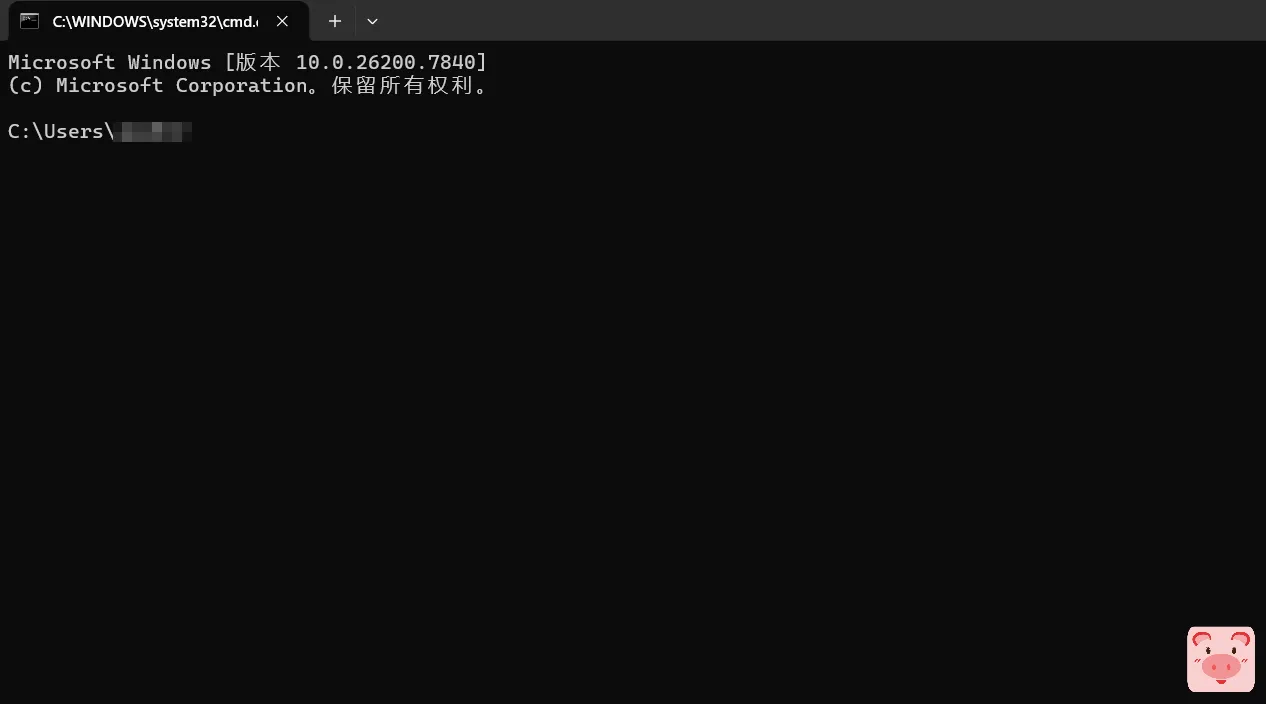

首先我们 同时按键盘上的Windows键和R键 然后输入CMD进入控制台

这个时候我们就得去复制 这个 ollama run deepseek -r1 这个命令到控制台了,复制完后记得在后面加上 :模型参数 来指定具体模型

例如你要下载 7b 版本 那就是 ollama run deepseek-r1:7b 然后按回车 你就会看到模型开始下载啦

耐心等待一下,往往需要不短的时间进行下载 当显示success的时候就说明已经下载成功啦

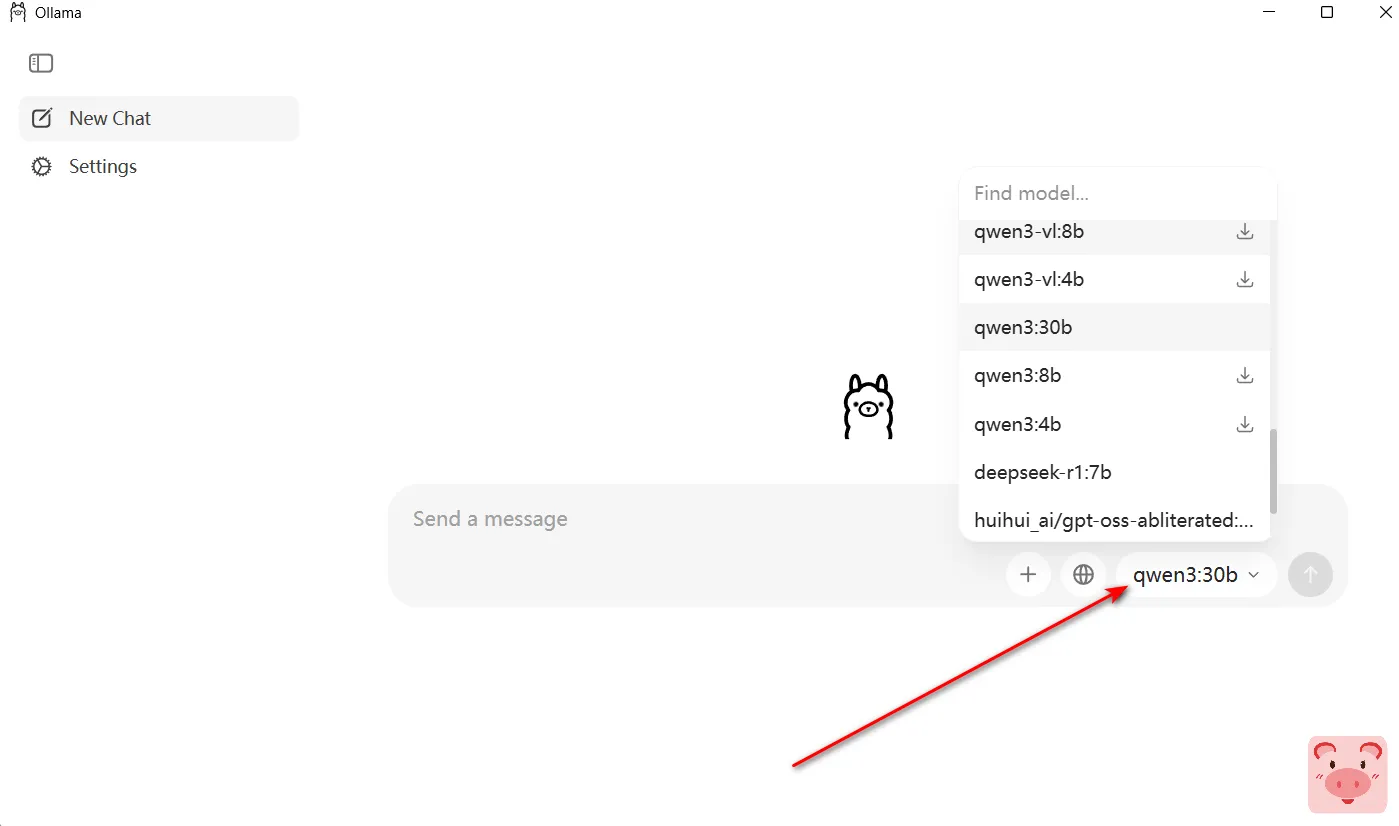

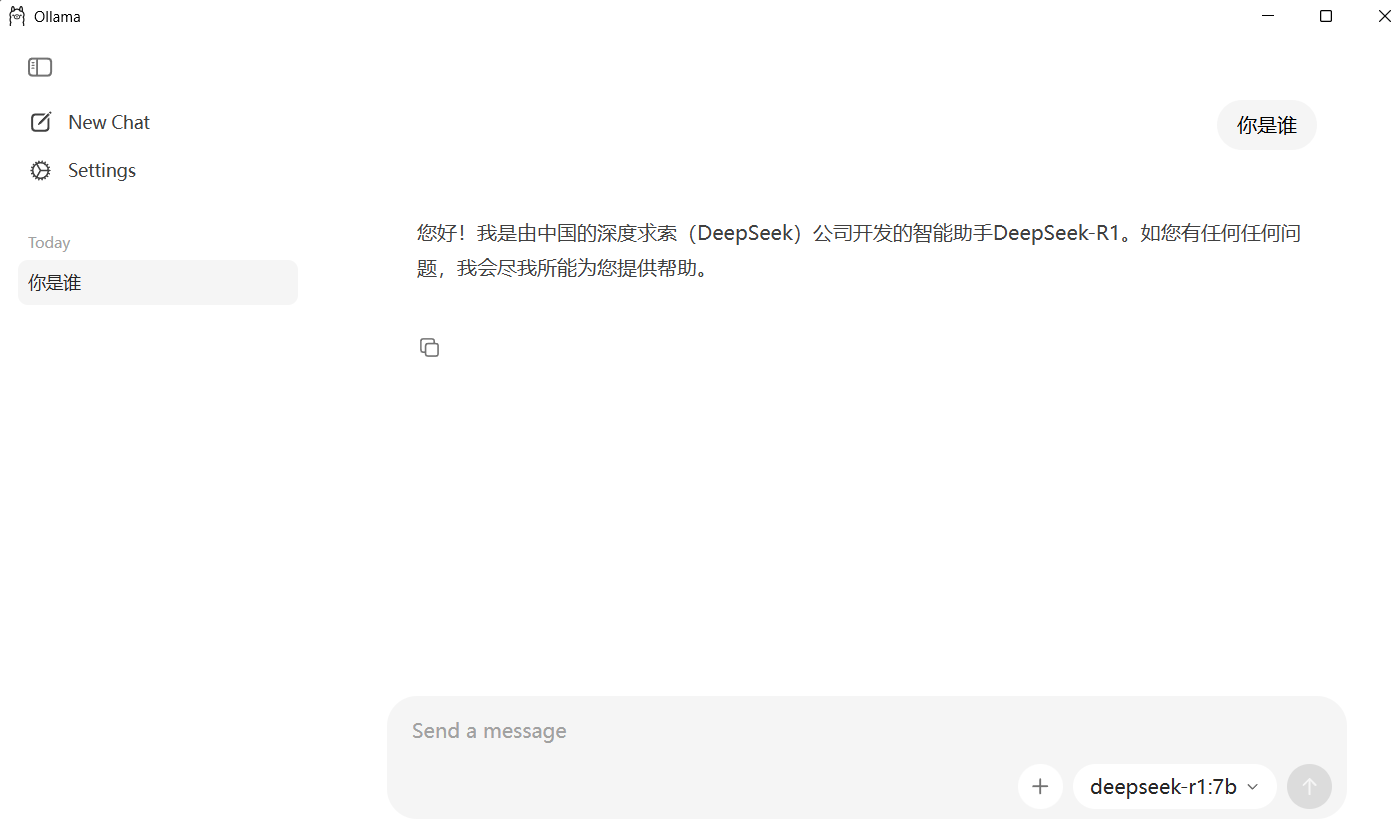

然后我们重新打来ollama 客户端 点击模型选择处,找到我们刚才下载的模型并选择 然后在旁边的输入框 就可以使用本地模型啦

当你看到这里时相信你已经完整学会了如何去下载并安装一个开源大语言模型了,那么回到文章标题,如何破除限制呢?

安装破限的大语言模型

我们要明白一件事情,即使是各大公司发布的开源版本的大语言模型,依旧在训练过程中已经对其输出做出了一定限制,这很大程度是为了安全考量,避免开源大模型被不法分子滥用。那你可能就会说了 那你还在说什么本地部署破限的AI干啥,不是还是做不到吗?朋友 我知道你很急,但是你先别急。虽然正如前面所说各大公司发布的开源的大模型本身就做了限制,但是挡不住开源社区有一部分人专门去对这些大模型为了学术研究或别的目的进行破限并将破限后的版本发布到开源社区,供大家学习交流。所以我们只需要去安装这样的破限版本就可以啦呀。

那么该如何去找这种破限后的版本呢

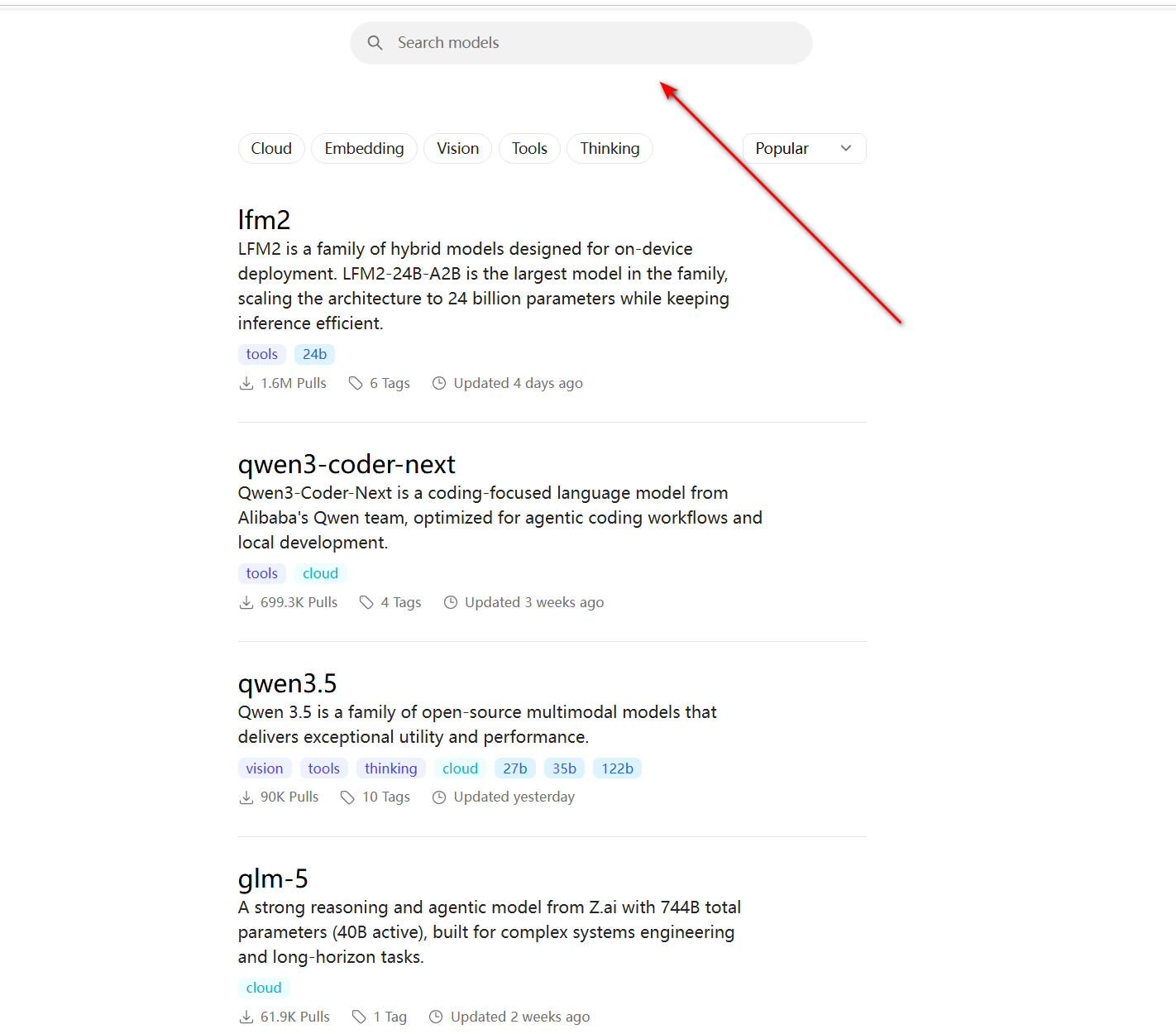

我们依旧来到 ollama的模型界面

输入我们想找寻的模型名 这里我以qwen举例

我们可以找到后缀带有abliterated 后缀字样的模型 这种的就是破限后的版本啦

然后我们同样的通过命令将其下载安装,一个破除各种限制的本地AI就成功的实现啦

我们来测试一下

虽然我们通过本地部署获得了极大的自由,破除了很多不必要的束缚,但在这里还是要特别提醒大家:即便是本地部署的模型,也绝对不要用来从事任何违法乱纪或违背社会公序良俗的事情。 “本地硬盘”绝不是法外之地。技术本身是中立的,但使用技术的人必须有底线。AI 的安全、健康与合理使用,需要我们每一个人的共同维护。希望大家都能让 AI 成为提升自己工作和学习效率的利器,而不是用来做坏事的工具!