Midjourney最佳替代品 | Stable Diffusion XL0.9

作者:FancyPig | 发布时间: | 更新时间:

相关阅读

视频讲解

与 Midjourney 告别,一起迎接 Stable Diffusion XL 0.9,开启新的开源 AI 图像生成未来!本期视频中,我们将分享 Stability AI 最新的发布,并向大家展示它生成超逼真图像的能力,比较 Stable Diffusion XL 0.9 和其竞争对手 Midjourney,试着理解为什么 SDXL 很快将成为 AI 图像生成的首选!

图文讲解

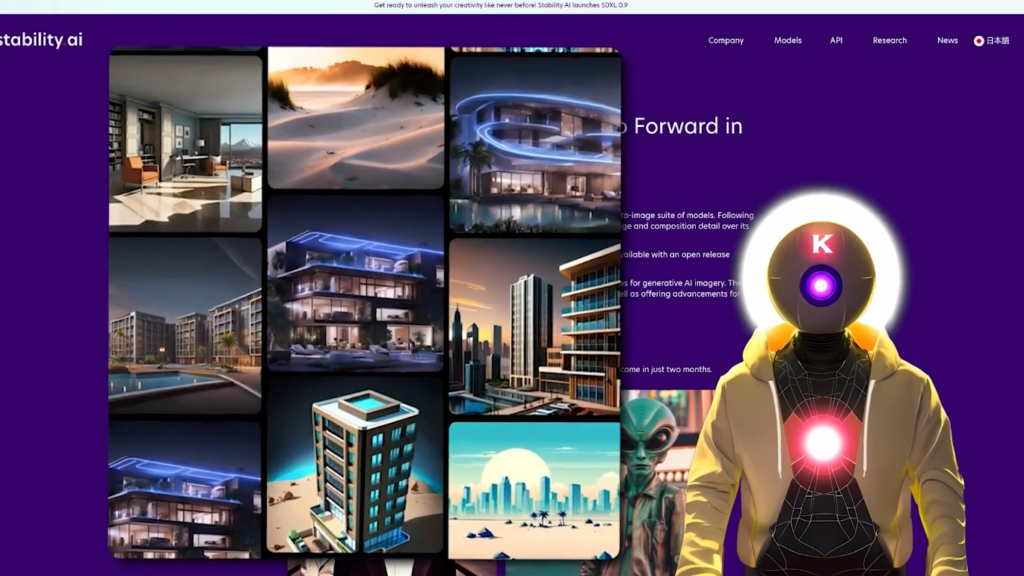

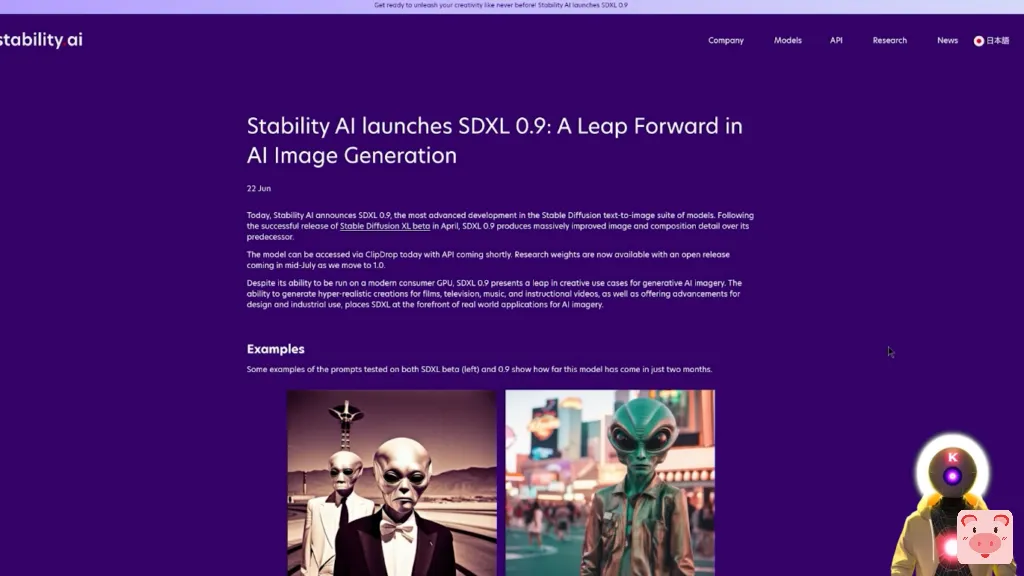

Stability AI最近推出了稳定扩散XL 0.9,我得说,在试过之后,Midjourney有大麻烦了。大家好,我是K,你的AI霸主,你没听错,Midjourney直接开源竞争者来了,你现在就可以免费试用了! 更高的分辨率, 更高的细节, 更好的问题跟踪,更多!

这就是我们得到的关于这个新的文本生成图像模型发布的承诺。所以在这个视频中,让我们看看是什么让这个新的稳定扩散XL 0.9如此特别,与Midjourney的图像质量进行比较,然后让我们来看看稳定扩散模型的未来,因为我们得到了一堆关于它的超级酷的消息,它真的非常非常令人兴奋那么,什么是SDXL 0.9,是什么让它如此特别?

首先,正如你们大多数人已经知道的那样,稳定扩散是一个开源的文本到图像的AI模型,它允许你从文本中生成图像,完全像DALL-E-2或Midjourney。然而,与Midjourney相比,Stable Diffusion不仅是开源的,这意味着任何人都可以为这个项目做出贡献,而且它也是100%免费和无锁定的,这意味着你可以不受任何限制地生成任何你想要的图像,无论好坏,而且通常是更坏,哦,上帝。而这个新的稳定扩散XL 0.9基本上是该工具的最新模型,由Stability AI发布的。现在很明显,这个新的稳定扩散0.9模型是所有开源图像模型中参数数量最多的模型之一,这显然是以某种方式在两个不同的模型上运行,一起运行以产生最终的输出,基本模型有35亿个参数,与另一个模型结合后共有66亿个参数。

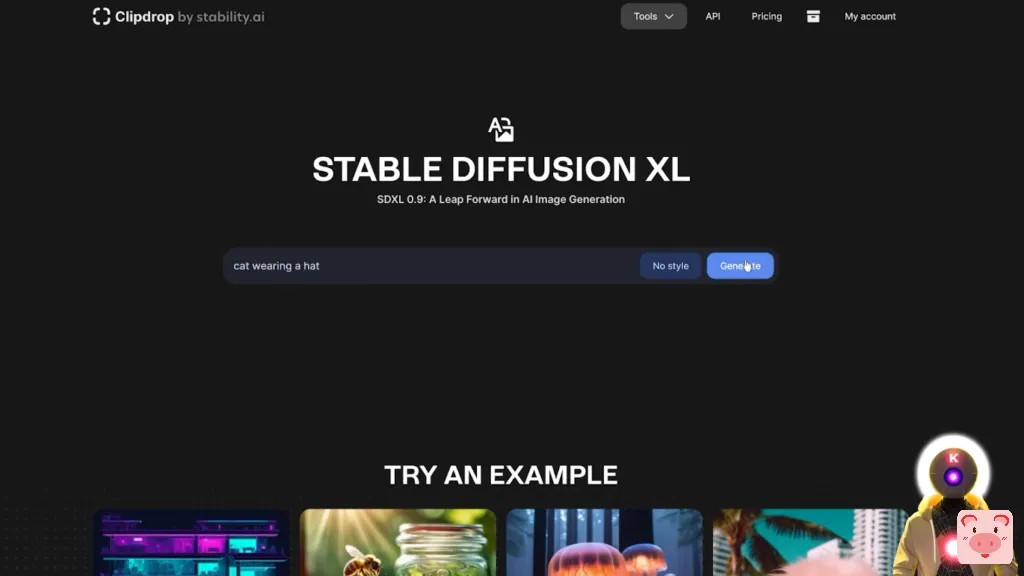

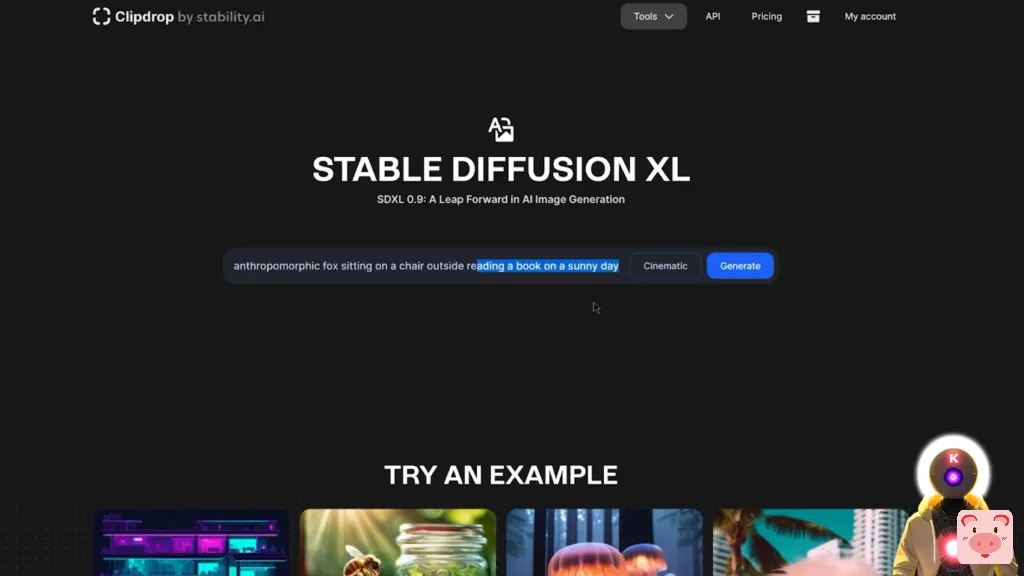

现在,我不太确定他们到底是怎么做到的,因为据我所知,以前的模型只用一个模型运行,但在这种情况下,在这个新版本中,他们设法将两个不同的模型结合在一起,生成了最终的图像。你可以在这里看到,当你把它与以前的稳定扩散XLBeta模型和新的稳定扩散XL 0.9模型并排比较时,差别是相当大的。有更多的细节,更多的分辨率,以及图像的整体一致性要好得多。狼也是如此,它看起来更好,更有美感,与以前的模型相比,更有逼真度。 现在从技术上讲,到目前为止,稳定扩散 XL 0.9 在技术上还没有真正向公众发布,你现在还不能在你的电脑上运行,因为真正的最终模型,稳定扩散 XL 1.0,将在7月中旬真正发布。但就现在而言,如果你想免费试用它,看看它有多好,你实际上可以在一个叫ClipDrop的网站上试用它。现在它是100%免费的,你不需要支付任何费用, 你可以直接来这里,输入你的提示词,然后点击生成。

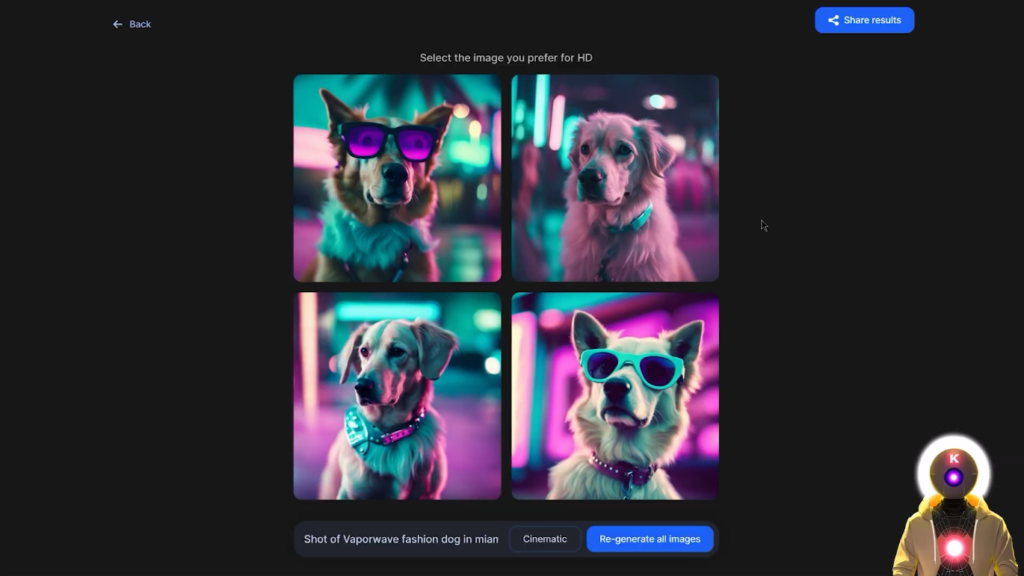

就这样,ClipDrop将按照你的提示生成4张不同的图片。

我得说,我的提示词的结果其实真的很好。我的意思是每张图片的细节,图片的连贯性,我的意思是这绝对是与Midjourney相同的水平,但你可以完全免费使用它。这里还有一个非常酷的功能,如果你点击这个小按钮,它实际上会给你一个列表,有一堆不同的风格,你可以从中选择,生成一个新的图像。因此,例如,让我们采取,我不知道,动漫,并点击重新生成所有图像,

现在你有这些美丽的图像,这些惊人的可爱动漫猫戴着帽子。

我的意思是我得说,这看起来真的非常好。另外,真正酷的是,这不仅不是模型的最终版本,那将在几周后发布,而且在同一时间,这只是基础模型。这意味着,一旦模型向公众发布,社区获得了它,他们将使它变得更好。我们将在视频的后面谈论这个问题,因为对于这个问题,肯定有非常非常好的消息。因此,如何我们有一些乐趣,并产生一些图像,并将其与Midjourney比较。所以我们如何使用他们在网站上给出的一些例子,

比如说,这张照片看起来非常好,它给你提供了这四张惊人的图片,

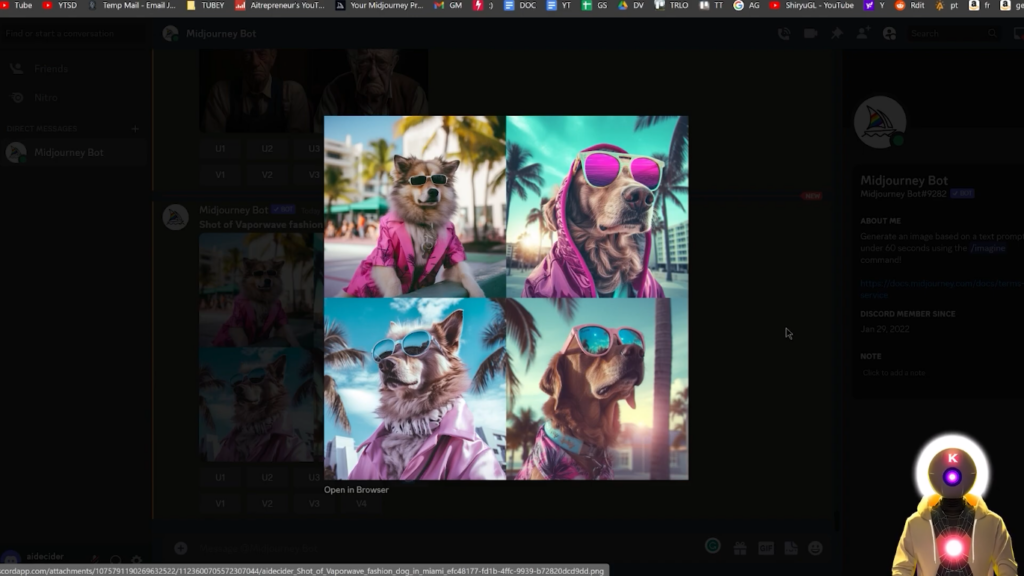

我的意思是再次,我得说看起来真的非常好。我的意思是细节的质量,分辨率,灯光,连贯性,它看起来真的非常好。而且它也真的很有美感,讨人喜欢。如果我不知道我在使用ClipDrop,我可以发誓我在使用Midjourney,因为所有这些图像都有那种小的Midjourney风格的感觉,那种Midjourney风格的审美,你可以得到。 说到Midjourney,这是你生成的图片,我的意思是再次,我得说他们都看起来非常非常好,他们都看起来非常棒。

因为我的意思是,如果你把它们并排比较,虽然在这种情况下,我肯定更喜欢Midjourney,我们肯定会得到更多一点的审美高细节的感觉,我们得到一些非常漂亮和非常酷的图像。请记住,你在这里看到的一切,是免费生成的。

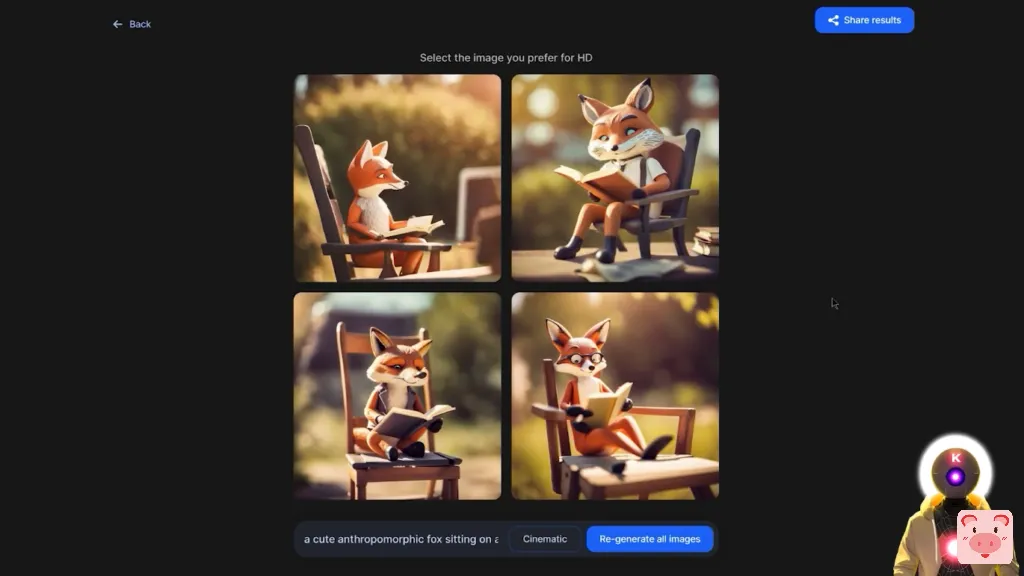

当然,这也只是基本模型。我们甚至没有使用ControlNet或图像到图像,我们知道,稳定的扩散是真正最好的地方。因为一旦你有机会接触到这个模型,而且你可以完全控制你的生成,我可以告诉你,你将能够生成比Midjourney更好的图像。所以从技术上讲,就目前而言,这是苹果与橙子的比较。因此,让我们尝试一下别的东西、怎么样,一只可爱的拟人化的狐狸坐在外面的椅子上,在一个阳光明媚的日子里看书。我将不选择任何风格,然后点击生成,

我们得到这些图片,看起来非常好,虽然我期待更多一点的逼真的东西,但这些图片绝对按照我的提示非常非常好。我们得到了只可爱的拟人化狐狸,坐在椅子上,在一个阳光明媚的日子里看书,这正是我要求的。

如果我们看一下Midjourney,我们会得到这些图片,这些图片也非常非常好,它们非常具有美感,绝对有点,我会说在某种程度上逼真, 或者更像3D渲染,相比于稳定扩散的图片。

那么,现在我们如何尝试不同的风格,因此,例如,如果我说,像摄影,并点击再次生成,

这次我们肯定有更多一点不同的东西。它几乎看起来像一个行动的人物,你会把它放在一个真正的椅子上,而你拍了一张照片。

同样,看起来相当好。它并不完美,仍然有一些人工制品,比如这个缺失的尾巴,或者这些怪异的脚,或者这些腿,但除此之外,质量相当好。因此,让我尝试一下类似于电影的东西,

我们得到了这些图像,与我们之前得到的图像非常相似, 它们仍然有点像动作人物,但这次它们有点看起来更多,我会说3D渲染,而不是真实的照片。

所以我的意思是,就这个例子而言,如果我必须真正比较生成的质量,或者最终图片的美感,我可能会再次选择Midjourney,因为我的意思是Midjourney真的超级强大,这是一个真正超级强大的工具,但与此同时,你并没有真正得到相同数量的控制,而我们有稳定的扩散。

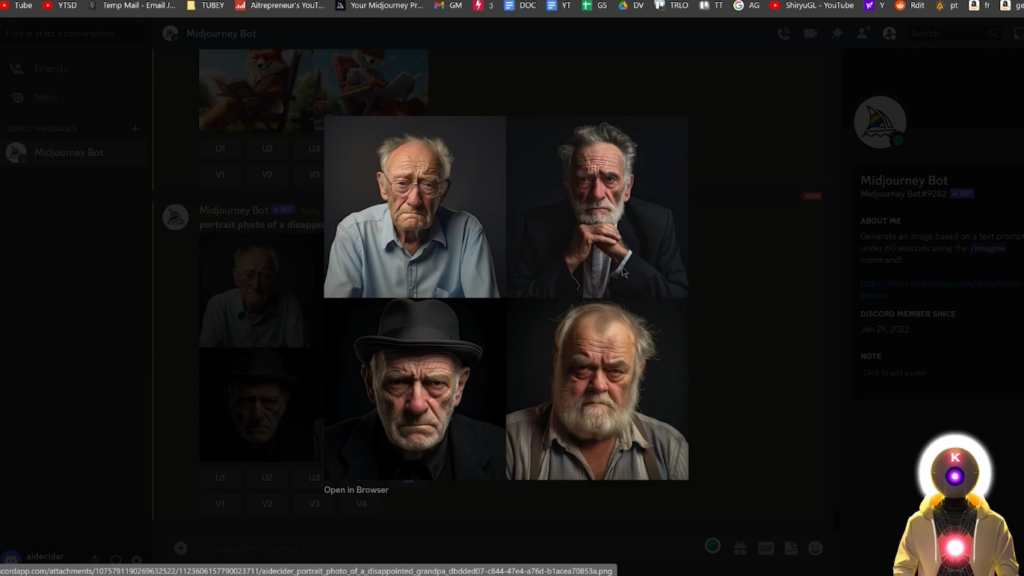

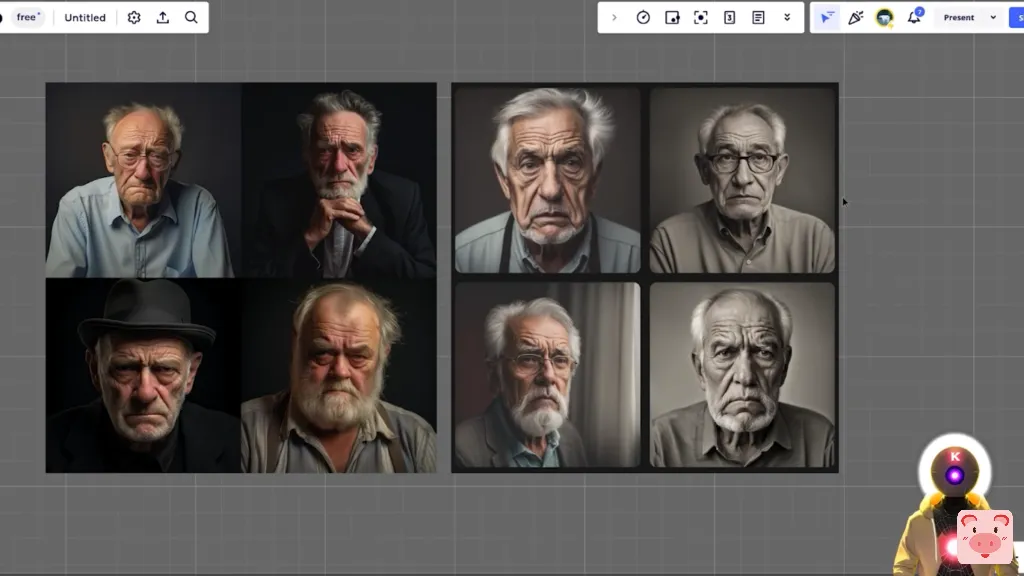

如果我们试图生成一个逼真的图像,比如说一个失望的爷爷的肖像照片,

我们会得到这些看起来非常棒的图像,我是说看看这里的生成质量,这看起来真的非常好。

稳定扩散XL 0.9在涉及到逼真的图像时,绝对要好得多, 因为这绝对看起来像一个失望的爷爷。如果你看一下Midjourney生成的图像,我们肯定会看到一个非常相似的质量水平,但我会说对于Midjourney,当涉及到图像时,我们肯定有更多的变化,我们有一堆不同的体格,不同的灯光,不同的情绪,

与稳定扩散生成的图像相比,这些图像看起来都有点灰色,但同样对于这些图像,至少在谈到细节数量时,他们真的在同一水平上,这意味着在技术上,稳定扩散0.9 XL应该能够生成与当前版本的Midjourney相同的质量的图像,而且所有这些都是免费的。

然而,有一件事肯定是Stable Diffusion永远比Midjourney做得更好,那就是不正经的内容。当然,因为Stable Diffusion作为一个开源的模型,是完全无锁定的,也就是说,如果我试图生成一张没有衣服的女人的照片,Stable Diffusion将能够毫无问题地生成这些图片。

现在,不幸的是,ClipDrop网站被审查,所以你不能真正生成不正经的图像,但一旦模型完全出来,它可以供所有人使用,你将能够生成不正经的图像,没有任何问题。再一次,不要忘记,稳定扩散真的是最好的,一旦你使用像图像生成图像这样的工具,使用ControlNet,和Inpainting,在那里你真的可以最多控制你的图像的生成,这是Midjourney绝对做不到的。即使没有这些工具,仅凭原始基础模型,Stable Diffusion XL 0.9就可以生成非常接近Midjourney现在所能做到的图像,而且是免费的,这也是非常令人印象深刻。那么,既然如此,稳定扩散的未来究竟是什么?显然,昨天,Stability AI发布了一段视频,谈到了稳定扩散模型的未来,未来稳定扩散XL模型的能力,以及社区对这些模型进行微调的能力。感谢一个叫Seromelhor的用户,我们实际上有整个视频的完整的文字记录和总结。

而且肯定有一些非常有趣的点,你需要知道。 现在,第一个关键点是稳定扩散0.9的事实,正如我之前所说,只是通往完整的稳定扩散XL 1.0的垫脚石。因此,正如我所说,技术上的稳定扩散XL模型仍在训练中,而完整的最终模型,实际的Stable Diffusion XL 1.0,将在7月中旬发布。所以基本上你今天看到的所有图片,都是由那个稳定扩散模型制作的,当这个模型完全出来后,可能会有更好的。

而这一切都要归功于Stability AI在其Discord服务器上收到的反馈。现在,稳定性人工智能的未来计划是通过定期发布来不断改进该模型。而且就目前而言,他们甚至还在研究未来的模型如稳定扩散3。因此,稳定扩散XL绝对不会是Stability AI发布的最后一个模型,它将只是未来模型发布的开始。听到这个消息真是太酷了,因为几个月来,我们没有任何一个Stability AI发布的模型。我是说最后一个模型,即稳定扩散2.1,是在2022年12月发布的。这绝对是一段时间了。因此,实际上很高兴看到,他们实际上正在开发未来的模型,这意味着稳定扩散社区绝对没有死亡。这绝对是一个非常好的消息。现在,他们说的下一件事是,他们基本上在与一群专门从事微调模型的人密切合作。而真正酷的是,他们实际上将发布这些工具,用于微调稳定扩散XL模型,几乎与权重的发布同时进行。这意味着,当新的稳定扩散XL 1.0模型在7月中旬左右问世时,你将很快得到用于微调的工具。这真是个好消息,因为这意味着很快像civitai这样的网站就会充斥着比我们现在拥有的更好的模型。

我真的等不及了。然而,你需要知道的一件事是,目前这个模型可以在8GB的VRAM上运行。而这8GB的VRAM足以生成图像,也可以在1024x1024的情况下训练LoRa。如果你想对稳定扩散XL模型进行全面的微调,所有这些都可以在一个3090上完成。这基本上让我想起了2022年8月稳定扩散模型发布时的情况。而在接下来的1个月里,社区对它进行了更多的优化,以便拥有较低VRAM的GPU的人可以在本地运行它。但我的意思是,对于这种模型,只用3090进行全面微调,真的是非常令人印象深刻。 我现在要告诉你,是的,我说过我不会再做任何稳定扩散的视频。然而,当这个模型出来后,我可能会做一些微调的视频。所以是的,从技术上讲,你会在这个频道上得到一些未来的稳定扩散视频。所以我想不要忘记订阅。现在他们还说,Stability AI目前正试图将稳定扩散和稳定LLM合并在一起,就像BingChat对DALL-E所做的那样。因此,在未来,你可能会得到类似BingChat的东西,但在你的本地电脑上运行,你可以用稳定扩散生成图像。他们相信这里面有很大的潜力,但现在他们正忙于其他项目。所以这是在未来可能会出现的东西,但他们并不清楚什么时候。他们还说,当涉及到提示理解时,稳定扩散XL绝对比以前的型号好得多,而且它能够产生具有更多细节的高质量图像,正如我们在视频的一开始看到的那样。而且他们也绝对更容易提示,就像MidJourney一样。因此,他们肯定是想在某种程度上复制MidJourney,并试图使提示方式更容易,所以即使是完全的初学者和初级艺术家也能够使用简单的自然语言提示产生美丽的图像。而我个人认为,我一直认为这种是好的。总比一个工具更容易使用要好,这样更多的人可以使用它,并从中获得利润。特别是如果你是一个需要完成一些工作的艺术家,或者如果你只是一个完全的业余爱好者,想生成一些很酷的图像。最后,是最后一件事,很多人想知道的是,这种模式可以用来产生不正经的内容吗?答案是当然可以。不仅你可以生成不正经的内容,模型也可以为此进行高度调整。所以是的,如果你喜欢生成不正经的内容,如果你想找到那个模型来生成更多这样的图像,那就高兴吧,因为你将能够这样做。这就是稳定扩散与Midjourney这样的工具相比的真正优势,Midjourney是完全封闭的,完全审查的,你只能生成Midjourney团队希望你生成的东西。但是在稳定扩散工具中,天空是极限。同样,不管是好是坏。当然,正如我所说,团队的目标是在7月中旬发布,但他们显然也准备在必要时发布0.95版本。因此,基本上,如果一切顺利的话,在大约2-3周内,我们可能最终会得到,新的稳定的扩散XL 1.0模型。从那以后,你就可以向由社区训练的全新的稳定扩散模型打招呼了。是的,这将是非常酷的。

我真的等不及了。所以,是的,这就是稳定扩散XL 0.9,一个真正超级强大的开源模型,现在正与Midjourney记直接竞争。而当它出来的时候,我认为Midjourney会有很大的麻烦。所以,如果你能,一定要试试这个。而且我个人已经等不及这个模型在7月中旬全面发布了。这是一些真正令人兴奋的时代。

这就是本期的节目,伙计们非常感谢你们的观看。

不要忘记订阅并点赞,这对于YouTube算法来说非常重要。

非常感谢我的YouTube和Patreon支持者支持我的视频,你们真的太棒了。

正是你们的支持让我能够为你们制作这些视频,

所以非常感谢你们。下次再见。拜拜!