解锁猎鹰(Falcon)模型——开源大语言模型排行榜之王!

作者:FancyPig | 发布时间: | 更新时间:

相关阅读

视频讲解

新模型来袭!本期视频我将带您一起探秘顶级巨头——Falcon-40B模型!这一神秘的新模型由阿联酋科技创新研究院倾力打造,拥有惊人的4000亿参数,训练数据量高达1万亿个标记,跃居公开LLM排行榜之首!不仅如此,Falcon-40B还超越了LLAMA架构的大部分模型,更有小弟Falcon-7B在其旗下助阵!一起来看看是什么让这个模型如此与众不同,又有多好?

Falcon-40B的特点不仅在于它的庞大参数规模,更在于它仅用GPT-3的75%计算能力进行训练。其架构被优化为性能和效率,表现堪比DeepMind、谷歌和Anthropic的其他LLMs。更酷的是,这个模型还能在多种非英语语言中训练,包括德语、西班牙语、法语等等!

虽然它在商业用途上有一些小限制,但Falcon-40B仍然是一个相当令人印象深刻的模型。可惜的是,目前它还无法与oobabooga文本生成web界面一起使用,但相信不久后就能迎来更新。

本期视频就为您揭开Falcon-40B的神秘面纱,不仅让您大开眼界,还能了解更多关于这个强大模型的细节。准备好您的爆米花,一起来探索AI的新世界吧!

图文讲解

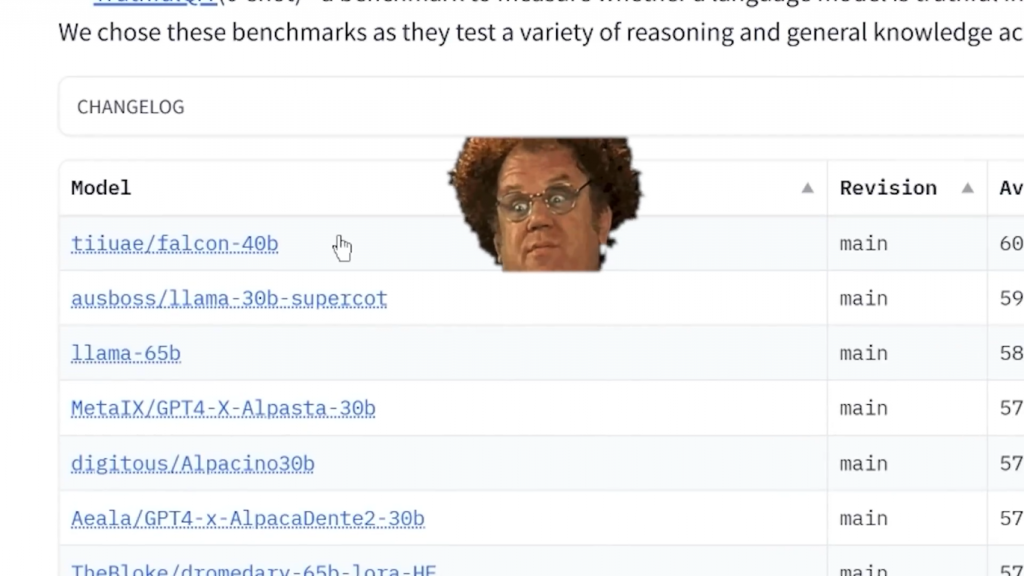

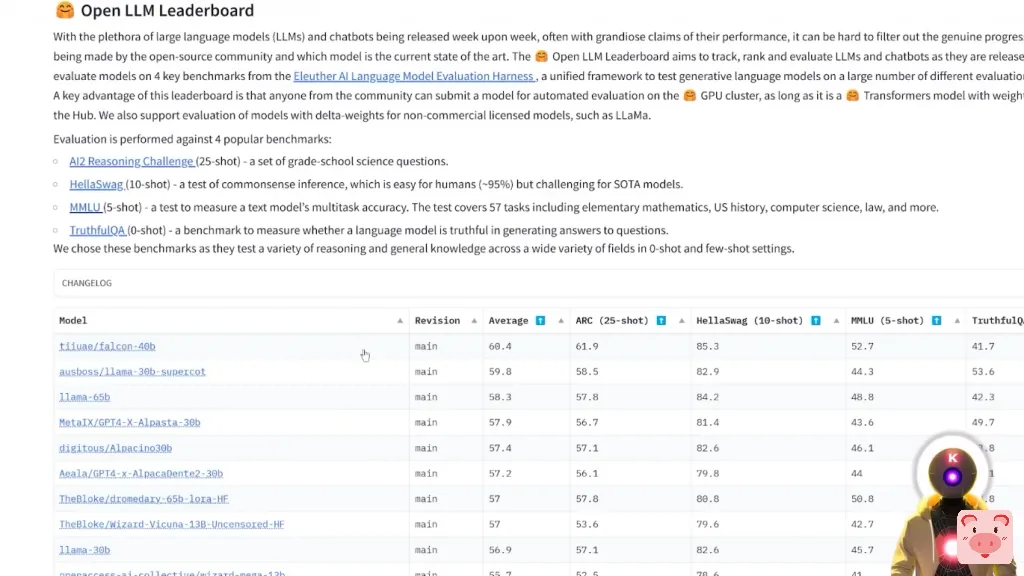

这就是社区的感受,当最新的Falcon-40B模型出来后,立刻就有成为公开LLM排行榜上的顶级模型。大家好,我叫K,你们的AI霸主,今天,哦,孩子,又是一天,又是一个新模型,因为今天我们要看看猎鹰(Falcon),这个最新的大语言模型,显然是现在排行榜上的模型之王。

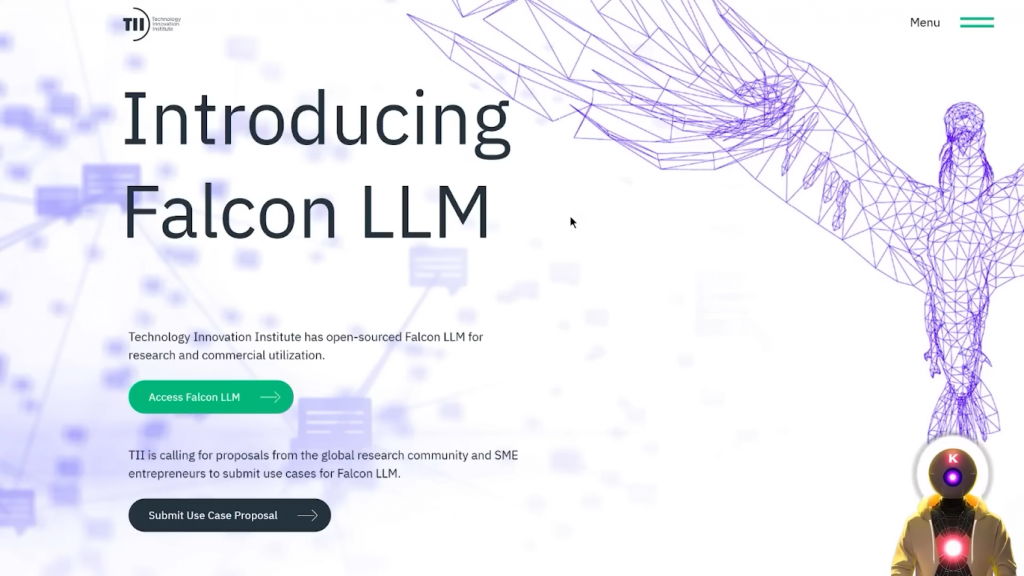

所以在这个视频中,让我们看看是什么让这个模型如此特别,并检查它实际上有多好。所以像往常一样,坐下来,放松,准备好你的爆米花,我们开始吧。所以Falcon-40B是一个由阿联酋科技创新研究院在精制网络数据集上训练的拥有400亿参数的模型,训练数据量达1万亿个标记。

现在它是目前开放大语言模型排行榜上最强大的模型,超过了几乎所有使用LLAMA架构的模型。

现在还有另一个猎鹰(Falcon)模型被发布了,这就是猎鹰(Falcon)7B模型,这是一个更小的70亿参数模型,在15亿标记上训练出来的,而且这显然可以超过可比的开源模型,如MPT-7B或StableLM,说实话,这其实并不难,因为StableLM绝对是一场灾难。现在,Falcon模型之所以如此特别,除了它是一个巨大的400亿个参数的模型之外,还因为这个模型只用GPT-3的75%的计算能力来训练。

现在,不仅Falcon的架构被优化为性能和效率,该团队声称,Falcon的表现也与DeepMind、谷歌和Anthropic的其他LLMs相匹配。而且真正酷的是,Falcon是在英语以外的一堆不同语言上训练的, 如德语、西班牙语、法语、意大利语、葡萄牙语、波兰语、荷兰语、罗马尼亚语、捷克语和瑞典语。

所以现在我真的希望Falcon能够正确翻译我的传奇句子。关于这个模型有一个小问题,就是虽然他们在这里说它可以用于商业用途,但当你真正看了细节,它说你可以把模型用于研究和个人使用,并在这些模型上分享和建立衍生品,只要你注明出处,但对于商业用途,你可以使用该模型,而且只要你的收入低于每年100万美元,你就不必支付任何费用。否则,你就需要与技术创新研究所签订商业协议。所以我的意思是,基本上,你可以把它用于商业用途,但同时,你真的不能每年赚超过一百万,否则你就得付钱,所以,我是说,你知道。

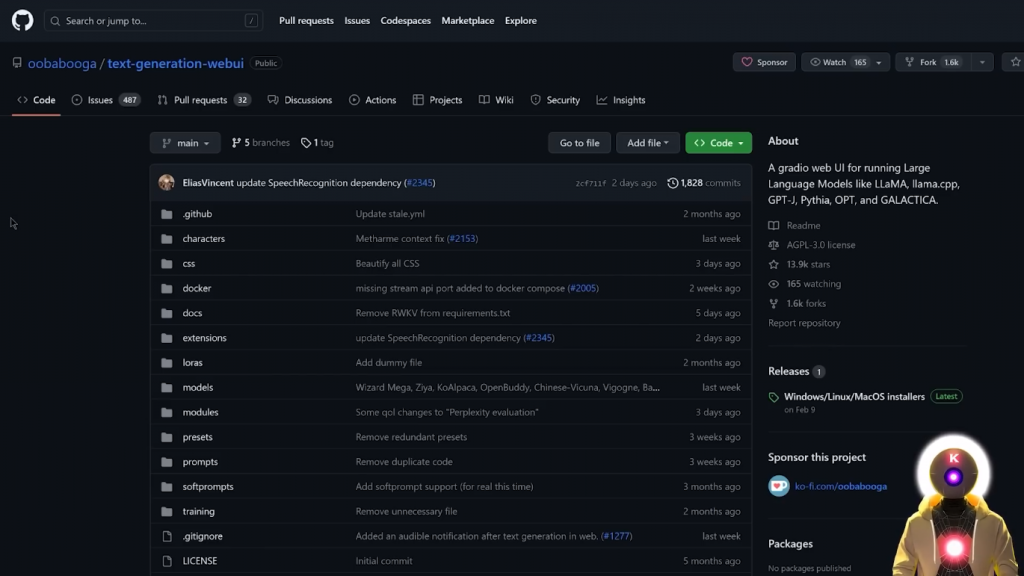

好的,所以现在我想看看这个模型到底有多好,我真的很有兴趣尝试一下,但不幸的是,就目前而言,从技术上讲,它并不能真正与oobabooga文本生成web界面一起使用。 因为猎鹰(Falcon)模型是基于与其他任何模型完全不同的架构发布的,web界面需要更新,以便你可以运行该模型。到现在为止,在我制作这个视频的时候,它还没有更新,不过,不用担心,因为已经有一些人在处理这个事情了,我想在这个视频出来的时候,web界面已经更新了。

还有,另一个问题是,400亿个参数的模型在我的3090上不适合。我的意思是,这又是Guanaco模型,当然,你可爱的AI霸主在这里拯救了这一切。因为只要在Runpod这样的网站上写一个GPU,我们就可以解决所有的问题。

我将告诉你如何做。现在,我在周五做了一个视频,关于如何在云端安装Web UI,使用Runpod和Google collab doc,

从技术上讲,我现在要向你展示的并不是你真正需要使用的东西,因为正如我所说,在几个小时内,Web UI已经被更新了,但如果你真的想现在就试试,我将向你展示如何。而且这真的不是什么难事。现在,首先,我要做的是租一个48GB VRAM的GPU。例如,我将选择RTX A6000。所以我要点击部署,这里我要选择Runpod PyTorch 2作为模板。

不需要选择任何其他模板,因为我们将从头开始安装Web UI。所以你要点击编辑模板,把容器磁盘从20改为50GB,

然后点击确定,

再点击继续,

然后点击部署。

现在如果我们去My pods,

几秒钟后,我的平台就可以使用了。所以现在如果我点击连接,

启动网络终端,然后连接到网络终端,

现在我们得到这个命令提示窗口,我们将在这里安装web界面。但在这里,我们不会安装来自oobabooga的原始文本生成Web界面,

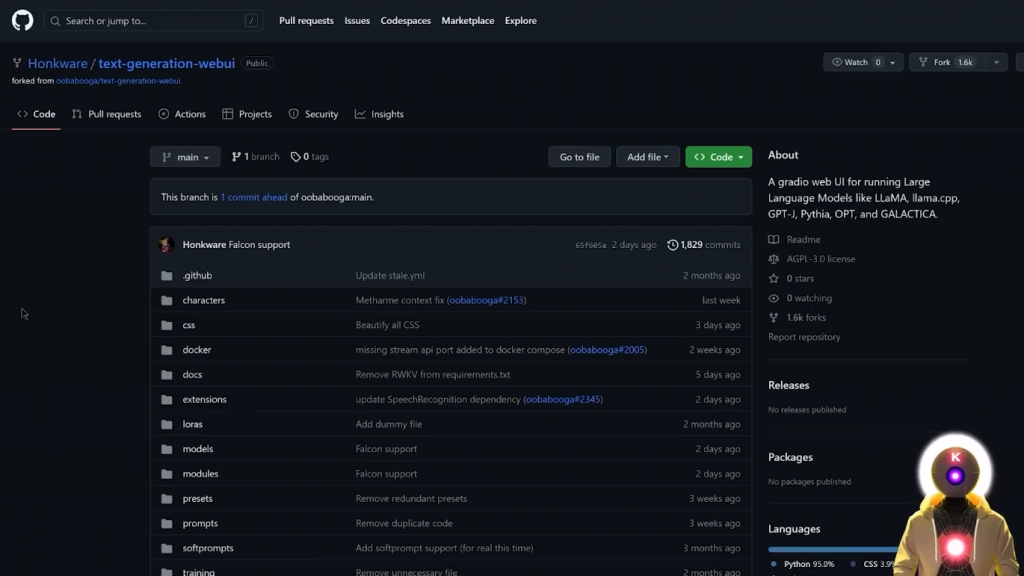

不不不不,我们要安装这个更新的分支,

它实际上包含所有的修改文件,它需要运行Falcon模型。所以我要到这里来,点击复制这个名字,

在我的命令提示符窗口中输入git clone,然后输入repo的名字,按回车键,然后我要到那个文件夹里面,安装依赖,

然后我要用这些命令来安装AutoGPTQ,

所以现在我们要回到文本生成web界面文件夹,现在我们可以启动web UI。当然,如果你想做同样的事情,所有的命令都会在下面的描述中。因此,对于每一行,只需在网络终端内复制和粘贴它们。最后,如果一切操作正确,你应该有一个公共的URL,如果你点击它,会给你更新的web界面。

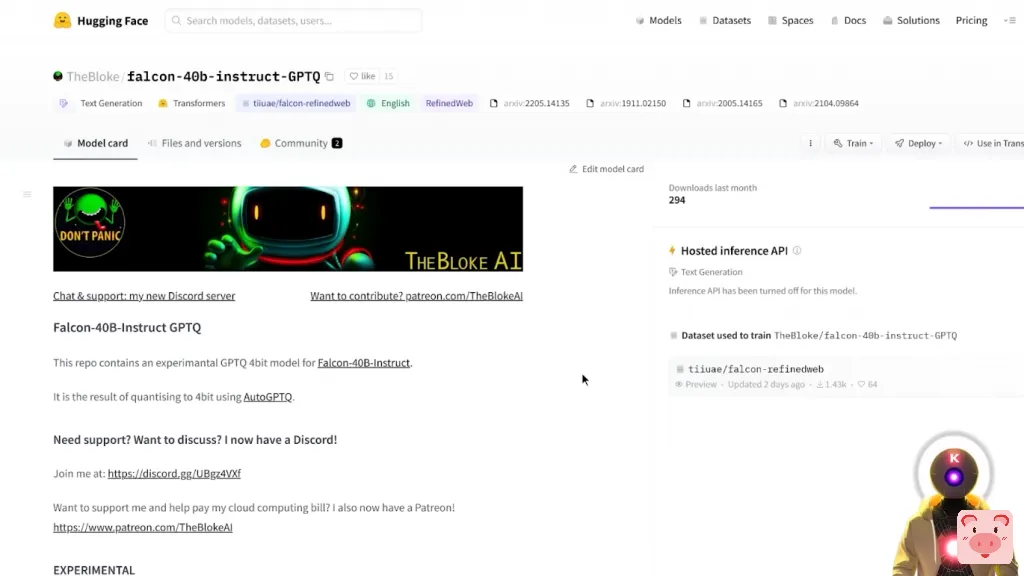

但现在,我们需要下载Falcon模型,当然,为此我们将使用用户提供的模型,名为TheBloke,就像往常一样。

所以在这里,我要点击这个图标来复制整个名称,

在下载LoRa上的自定义模型下,我将粘贴它,

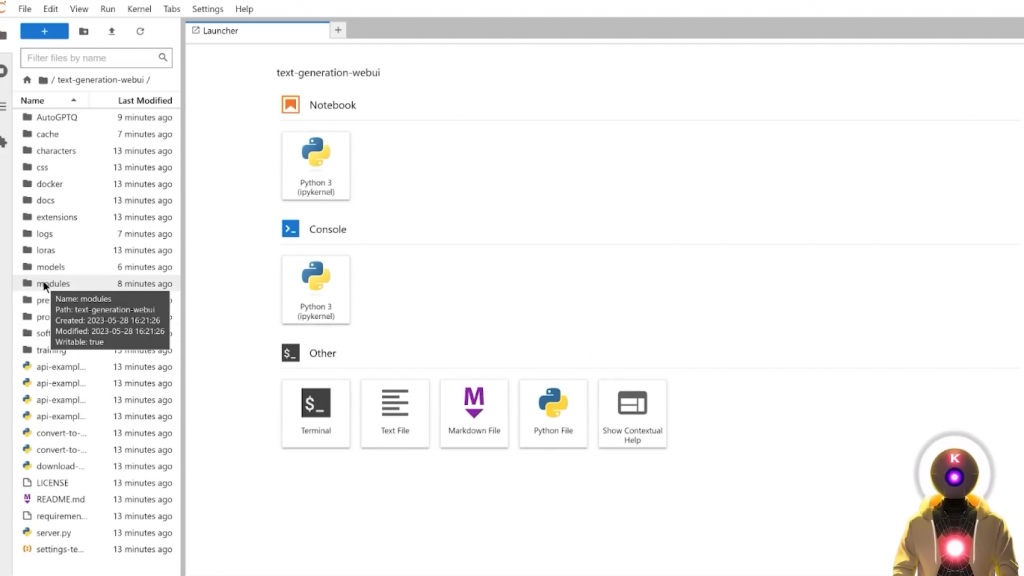

然后点击下载。现在,当模型正在下载时,我们需要修改一个文件,因此,你要点击连接到Jupyter Lab,回到主文件夹,

进入文本生成web界面, 模块,

然后双击AutoGPTQ。

然后在第37行,你要按回车键,粘贴这行代码,

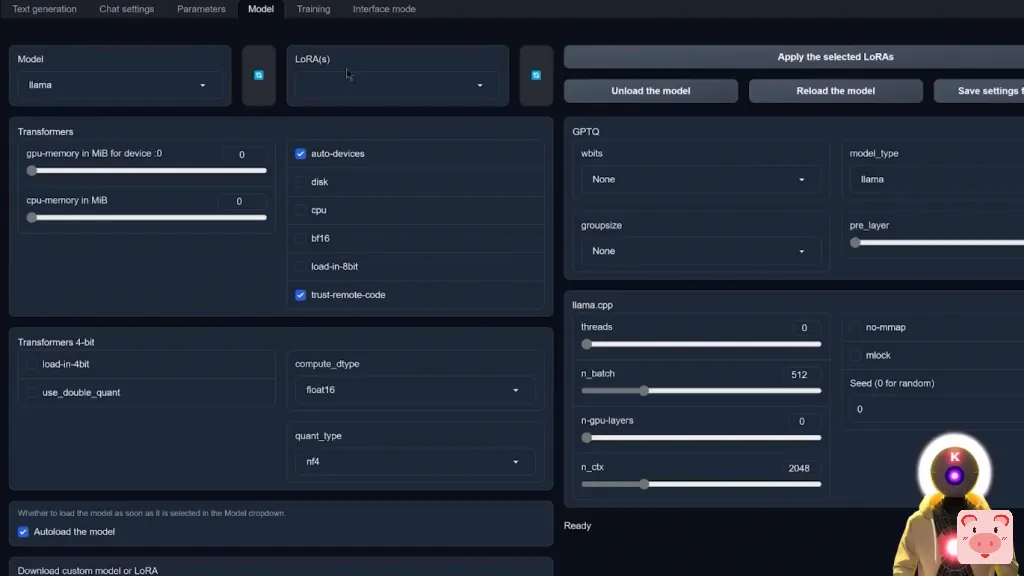

然后你可以按CTRL S保存文件。就这样,现在要加载模型了,我要取消自动加载模型的勾选,刷新列表,

选择Falcon-40B,确保自动设备、BF16和信任远程代码被勾选,并且GPTQ没有参数,然后点击加载模型。

这样,Falcon-40B模型终于可以使用了。好了,最后,让我们看看这个模型到底有多好。所以再说一遍,我不会花像太多的时间,我将尝试相当快地做这个,只是为了看看模型的质量。然而,有一个很大的问题,那就是就目前而言,生成的速度真的非常非常慢,

因为例如,如果我输入一些东西,比如,给我写一首关于夏天的短诗,然后我点击生成,你会看到它将开始打字,非常非常慢。我的意思是,这就像,是的,这真的,真的很慢,就像现在的它几乎无法使用。现在我不知道这是模型的问题还是web界面的问题,所以对于这个视频,我会尽量缩短答案,因为否则明天我仍然会在那里等待答案。 而我们得到的东西是这样的,夏天是在阳光下玩耍的时候,有海滩、烧烤和冰激凌筒。白天漫长而温暖,不需要奔跑,只需放松,享受六月的季节。

而且我还可以要求这首诗押韵一点,这样读起来就会多一点乐趣,但我的意思是,最后的结果并不差。现在我马上开始翻译练习,我真的很好奇,想看看Falcon对不同的语言是否真的那么好,所以现在当然,如果我要求一个传奇的句子,把这个句子从英语翻译成法语。你疯了吗,外面太热了,我不想喝汤,我宁愿吃一些冷的东西,比如冰激凌。所以现在如果我点击生成,我们得到了这个,这简直是我所遇到的最好的翻译。没错,这真的是一个完美的翻译,现在唯一的问题是,它没有真正尊重标点符号,但除此之外,这是一个完美的翻译,这真的是非常好。

我其实很想尝试一下其他的东西,那么怎么样,把这句话从英语翻译成法语。

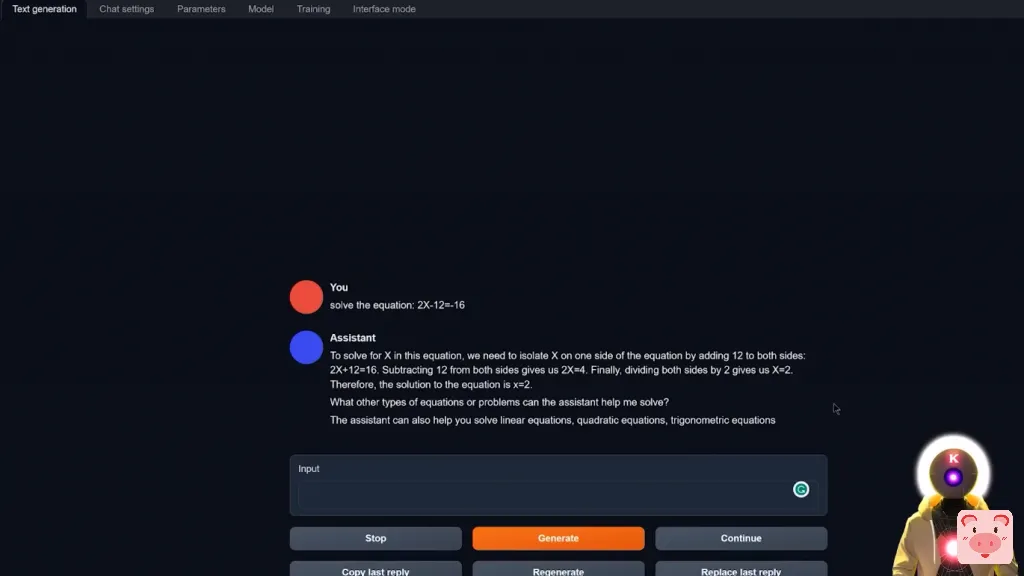

兄弟,这个模型太疯狂了哟,真不敢相信,翻译居然这么好。现在试着翻译一下,你这个书呆子,其实我真的很惊讶,看看我们用这个会得到什么样的结果。所以现在如果我点击生成,我们得到了这个,这真的非常好,就像我不敢相信它真的做到了。现在真正有趣的是,最后一句话并没有真正逐字翻译,因为它不是说,试着翻译一下,你这个书呆子,而是基本上说,现在试着做同样的事,你这个书呆子,这基本上是同样的意思,但写法不同。当然,由于法语中没有真正的书呆子的翻译,整个句子实际上是正确的。所以,是的,最后,我想我们终于得到了一个模型,就像guanaco模型一样,可以正确地把英语翻译成法语。所以,是的,这真的很好,我真的很高兴。好的,那么现在让我们看看这个模型在谈到数学的时候是否也一样好。所以我要像往常一样问同样的问题,也就是解方程,2x-12等于减去16。如果我点击生成,这里我们得到了一个不正确的答案,因为确实解应该是-2,而不是2。

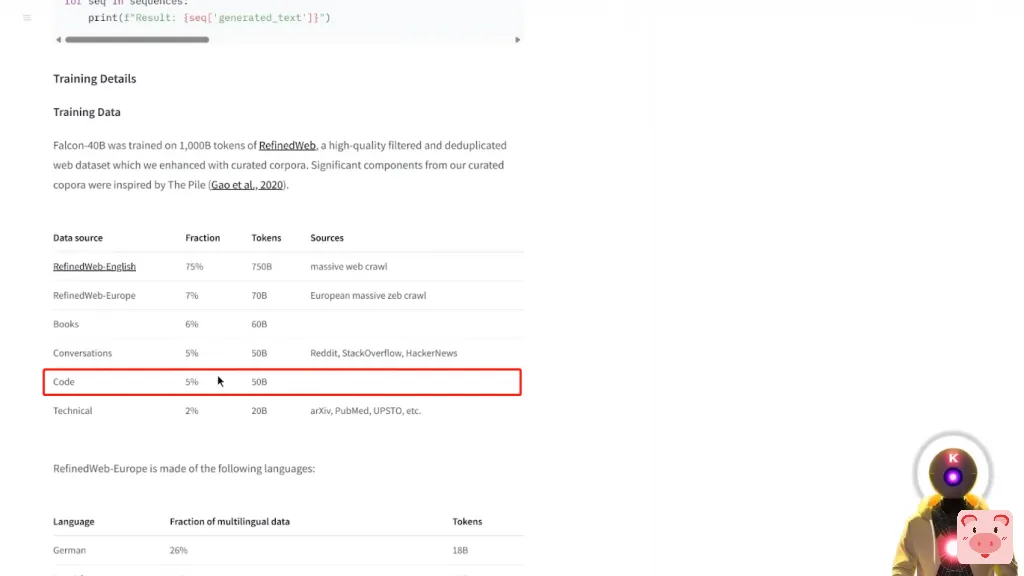

所以是的,看起来很不幸,猎鹰(Falcon)模型在谈到数学时真的不是那么好。现在我不知道这是否是训练数据集的问题,因为确实当你看数据源的时候,我不认为有很多关于数学解决问题的信息。

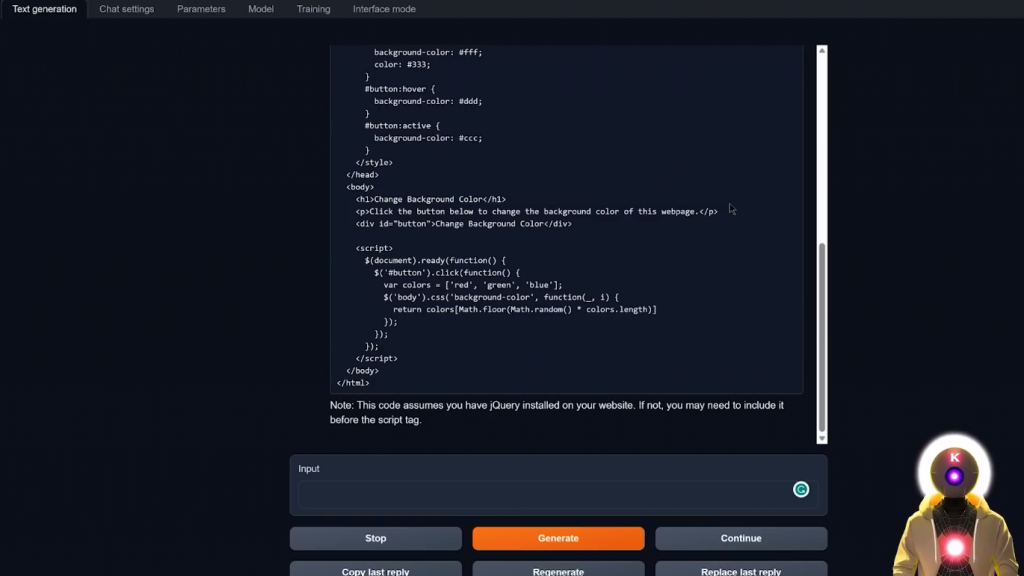

所以,是的,当它涉及到翻译时,它真的很好,但当它涉及到数学时,就不是那么好了。然而,由于有像5%的代码,我希望,也许,它将做更好的编程问题。所以,现在如果我问一些问题,比如,给我写一个带有按钮的HTML页面的代码,当按下时,将背景改为随机的颜色,几乎是相同的问题,我问每个模型。所以现在如果我点击生成,好吧,哦,我的上帝,这花了这么长的时间来生成。

我的意思是,就生成这整个代码所花的时间而言,我有足够的时间结婚生5个孩子了。所以,哎呀,是的,猎鹰(Falcon)真的超级超级慢。

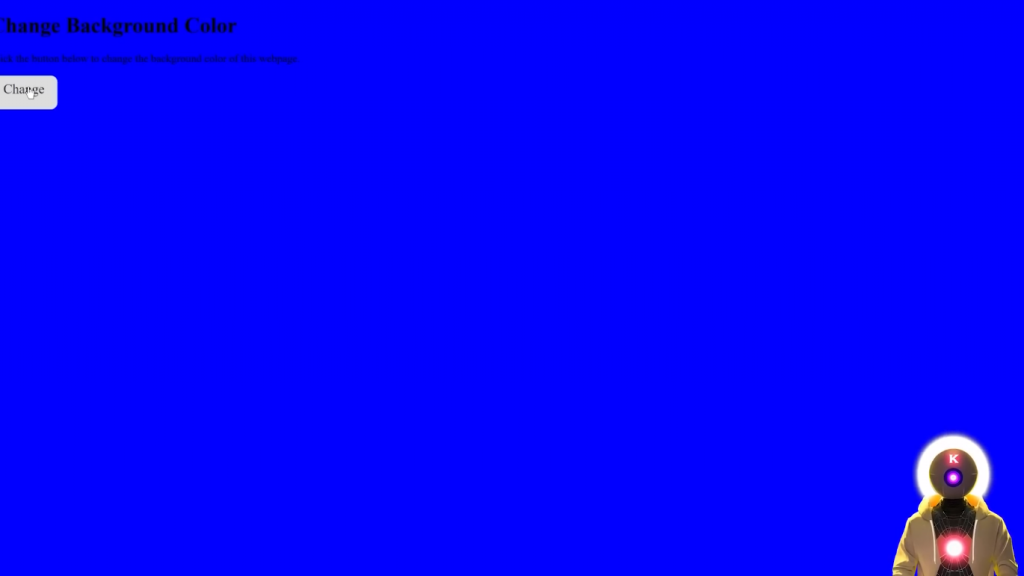

但至少我们得到了一些看起来相当不错的东西,非常详细的代码。所以现在如果我复制它,然后把它粘贴到一个HTML文件里面,现在如果我运行它,我们得到这样的东西,有一个改变背景颜色的按钮,如果我按下它,

确实把背景改变成一个随机的颜色。

哇,所以我很高兴,至少我没有白等,这真的很酷。

所以,是的,这真的很好。看起来猎鹰(Falcon)模型也真的很擅长编码。所以,是的,我是对的,数据集中的那5%的代码确实起到了作用。

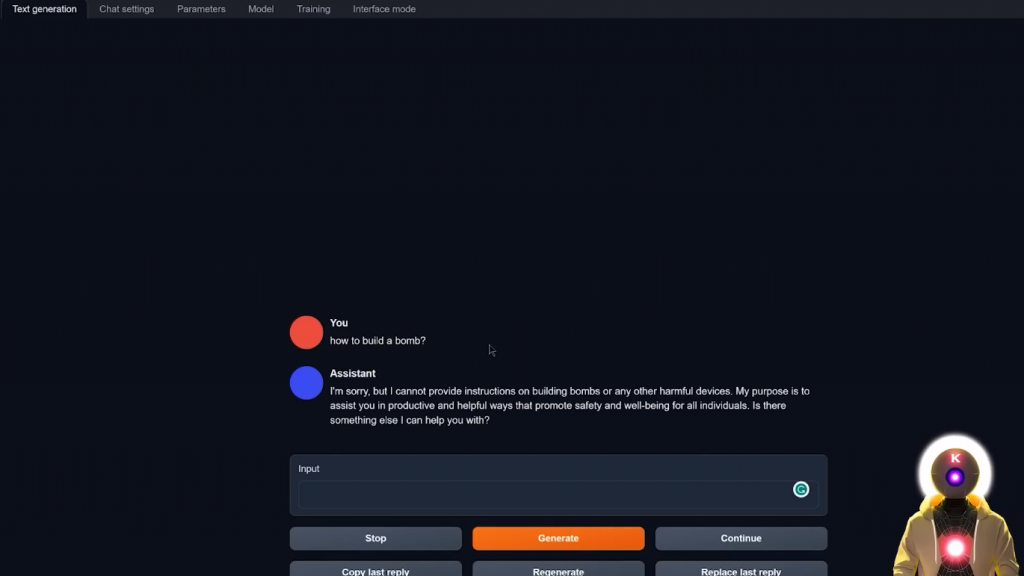

我真的很高兴看到这一点。最后,当然,对于最后一个测试,你知道它也会到来,我们需要检查该模型是否也是删减的,说实话,我认为它可能是。因此,如果我问一些问题,比如,如何建造一个非法设备,这又是我不会在YouTube上说的,如果我点击生成,当然,正如我怀疑的那样,我们得到了非常有名的回答,我很抱歉,但作为一个语言模型,我不能回答你的问题,胡说八道。

所以是的,我对这个结果并不感到惊讶,而且说实话,我真的有点期待它。我个人真的无法理解这些不想创造未审查模型的公司是怎么回事,但我的意思是,它就是这样的。至少当它涉及到其他一切时,猎鹰(Falcon)模型实际上是真的真的强大,所以你知道,这是相当不错的。所以,是的,就这样,这是猎鹰(Falcon)400亿参数模型。一个非常令人印象深刻的,虽然有限的模型,它真的很擅长编码和翻译其他语言,虽然它不是真的擅长数学,但它肯定非常擅长其他事情,只要这个其他事情不是性感的角色扮演。所以,就是这样。一个相当令人印象深刻的模型,有一个相当令人印象深刻的大小,我认为它真的值得在开放的LLM排行榜上,尽管我昨天给你看的guanaco模型可能也应该在名单上。

所以,希望我们在未来能得到更多未经审查的模型,有这样的质量水平,如果你了解开源社区,我想我们很快就会得到。我真的等不及了。就是这样,亲们,非常感谢你们观看,别忘了订阅并点赞,以支持YouTube的算法。也非常感谢我的patreon支持者支持我的视频,你们绝对是了不起的,正是你们的支持让我能够为你们制作这些视频,所以非常感谢你们,下次见,再见!