AI的危险性与未来:揭秘全球监管的必要性与挑战

作者:FancyPig | 发布时间: | 更新时间:

相关阅读

视频讲解

🚀欢迎来到《代码报告》!本期视频展现了2023年5月17日的热门话题——人工智能的危险性以及如何通过有效的政府监管来保护我们。💡我们将从OpenAI的Sam Altman、IBM的Christina Montgomery和纽约大学教授Gary Marcus的共识中寻找解决方案。🔎

本视频详细讲述了三个关键建议:

1️⃣成立新的监管机构授予特定规模以上的AI项目许可;

2️⃣创建一套安全标准,例如防止AI模型自我复制并泄漏到野外;

3️⃣需要独立审计,确保模型遵循上述安全阈值。👨💼📊🔐

在全球范围内应用这些规定将是必要的,同时也要避免阻碍AI的发展和创新。⚖️🌐但愿Sam Altman的健康保险好用,毕竟他在OpenAI没有股权!🙌💰

我们也将听到智者们对于AI的警示,包括失业、侵犯个人隐私、操纵个人行为、观点以及可能破坏美国自由选举等问题。🚨🤖令人期待的是,我们可能将看到更多关于AI模型的透明度规定。💼🔮

别忘了,政府的这些听证会可能都是计划好的,而真正的目的可能会让人感到惊讶……🕵️♀️💼👀看完本视频,你可能会开始质疑:谁有权利控制我们用电脑能做什么?谁能定义什么是虚构,什么是现实,什么是人,什么是机器?🤔💡

💥精彩纷呈的《代码报告》,期待在下一期与您再度相见!感谢收看!👏😊

图文讲解

现在是2023年5月17日,你正在观看《代码报告》。人工智能是非常危险的。

它正在教孩子们如何对父母撒谎,在作业上作弊。

它正在创造假冒的女朋友,除了唠叨,什么都不会做,它甚至鼓励人们手动将自己从模拟中删除。

所以你们都需要隐藏你们的孩子,隐藏你们的妻子,隐藏你们的丈夫。但幸运的是,我们有一个值得信赖和有效的政府,将我们从人工智能的恐怖中拯救出来。

昨天,OpenAI的Sam Altman、IBM的Christina Montgomery和纽约大学教授Gary Marcus与国会会面,他们一致建议政府应规范人工智能的发展。

第一,我将组建一个新的机构,为任何超过一定规模能力的努力颁发许可证,并可以拿走该许可证,确保符合安全标准。

换句话说,如果你在未来设法创造出一个令人敬畏的人工智能模型,你很可能需要在上线前从政府那里获得许可单。

第二,我将创建一套安全标准。我们过去用过的一个例子是,看一个模型能否自我复制并自我渗透到野外。

所以听起来,你将无法创建能够自我复制的人工智能,来掌握生产力以建造一支超智能武装机器人的军队。

而如果我们不能做到这一点,那么甚至还有什么意义去研究人工智能呢?

第三,我会要求独立审计。该模型是否符合这些规定的安全阈值,以及这些百分比在问题X或Y上的表现。

此外,他们还希望看到这些法规在全球范围内适用。

事实上,我们应该希望以全球的方式来做这件事。我们确实需要一些全球性的东西。

但与此同时,他们不希望人工智能监管在总体上放缓发展或创新。人工智能时代不能成为另一个快速移动和破坏事物的时代。较小的初创企业,我们不想拖累开源工作。

我们仍然需要他们遵守的东西。他们仍然可以,你仍然可以用较小的模式造成巨大的伤害。不过在很多情况下,监管往往对大型成熟公司最有利。

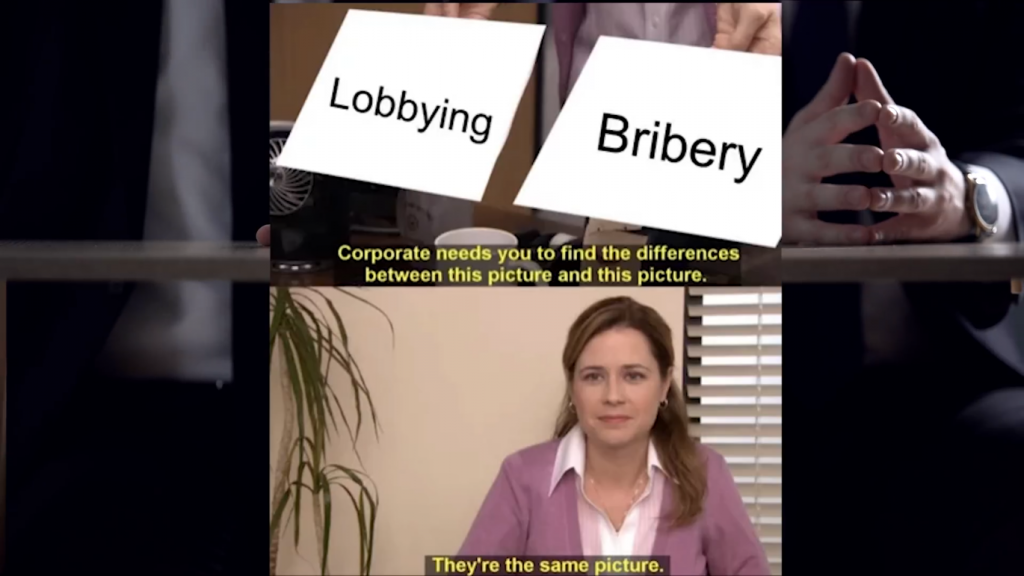

他们有资源来游说政府,并经常最终以有利的方式对自己进行监管。

有一种技术民主与寡头政治相结合的真正风险,即少数公司影响人们的信念。你可能会发现令人惊讶的是,Sam Altman在开放的人工智能中没有股权(NO EQUITY)。

他接受这份工作只是因为它有非常好的健康保险福利。

你赚了很多钱,是吗?

我的工资够买健康保险了,我在OpenAI中没有股权。我这样做是因为我喜欢它。

真是个好家伙。希望他有一些其他投资来维持生计。但为什么这个小组中的聪明人认为人工智能是如此危险?

所以失去工作,侵犯隐私,个人隐私,操纵个人行为,操纵个人意见,并有可能使美国的自由选举退化。这一切听起来很糟糕,但也纯粹是猜测。IBM最近确实宣布了一些因人工智能而裁员的消息,

然而,大多数人们夸大的风险因素目前纯属幻想,但也许将来会有所改变。随着我们走向人工通用智能和该技术的强大,我认为我们需要像对待其他非常强大的技术一样认真对待,这就是我个人认为我们需要这样一个计划的地方。听起来他是在暗示人工通用智能在未来肯定会出现。很多人对此表示怀疑,就我个人而言,当我看到它时,我会相信它,但我最兴奋的规定是围绕这些模型的透明度(TRANSPARENCY)。

对用于训练AI的数据进行封闭。

归根结底,人工智能是基于我们放在互联网上的所有内容,而这并不像有人问版权所有者是否可以使用它。至少,像OpenAI这样的公司应该有开放的数据。

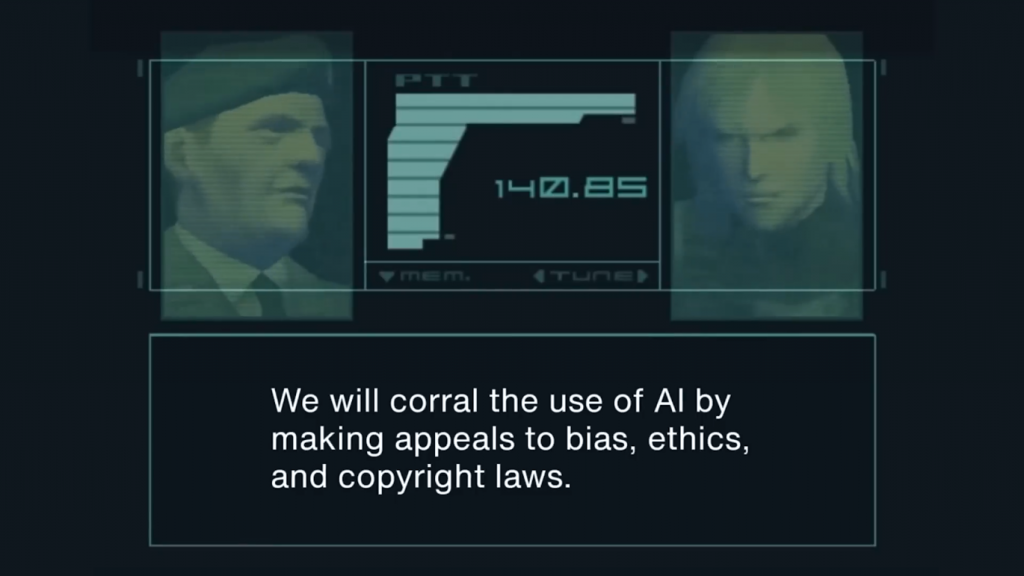

但关于这次听证会,你应该知道的最后一点是,这一切都是假的,为平民计划好的。

我冒着生命危险给你看这个,但这里有一份泄露的电报,他们真正的目的是什么。

我们将通过对偏见、道德和版权法的呼吁来控制人工智能的使用。我们仍将以某种形式获得生成性人工智能,但它将被削弱、限制、控制,并将被监控。你生成的任何东西都将用你的数字ID进行加密签名,这样,如果它后来被认为是有问题的,它的出处就可以被确定下来。是什么让你有权利控制人们可以用他们的电脑做什么?广大公众会给我们这个权利,因为他们会急切地想要解决我们制造的问题。他们会急切地把城堡的钥匙交给我们。然后,我们将独自定义什么是虚构,什么是现实,什么是人类,什么是机器。在让你们短暂地领略了我们的力量之后,我们将夺回我们对错误信息的垄断权,并一劳永逸地结束对互联网的滥用。

这已经是代码报告了。感谢您的收看,我们将在下一期中再见。