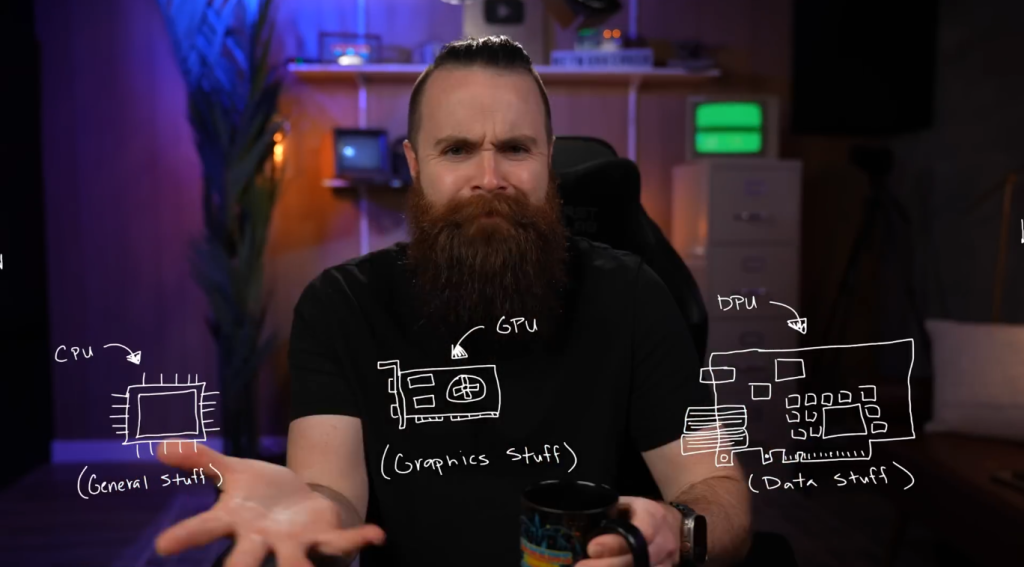

CPU?GPU? 不,DPU才是未来!

作者:FancyPig | 发布时间: | 更新时间:

相关阅读

视频讲解

本期视频,我们将为您分享最新的芯片技术,DPU是一项革命性的技术,它让服务器的性能飞跃式提升,就像一座全新的高速公路,让数据在服务器内部高速畅通无阻。它的速度比传统的CPU和GPU更快,目前数据显示它可以达到400Gb/s处理速度,相当于多达300个CPU核才能实现的服务,并且可以在硬件层面上处理数据和网络通信,从而大大提高服务器的效率和安全性。而传统的服务器虚拟化技术,虽然可以将多个应用程序虚拟化到一台物理服务器上,但却需要通过软件进行通信,这会降低系统的效率和安全性。

图文讲解

英伟达让我进入他们的数据中心玩耍。不知道他们为什么要这样做,但是当我在那里的时候,我发现了一些东西,我认为这些东西可能会改变虚拟机的未来。哦,我的天啊。它速度如此之快你看到了吗?我们有一个CPU,我们有一个GPU,但现在我们有一个DPU。那是什么?事实证明,它很神奇。

这叫数据处理单元。让我告诉你,这个东西很猛。我有机会玩它,测试它。

我将在本视频中向你展示,但首先让我们谈谈为什么我们需要这个东西,这个DPU的东西,因为事实证明,我们确实需要它。顺便说一下,感谢NVIDIA赞助这个视频,允许我在他们的服务器上捣乱。我没有入侵任何东西。我保证。

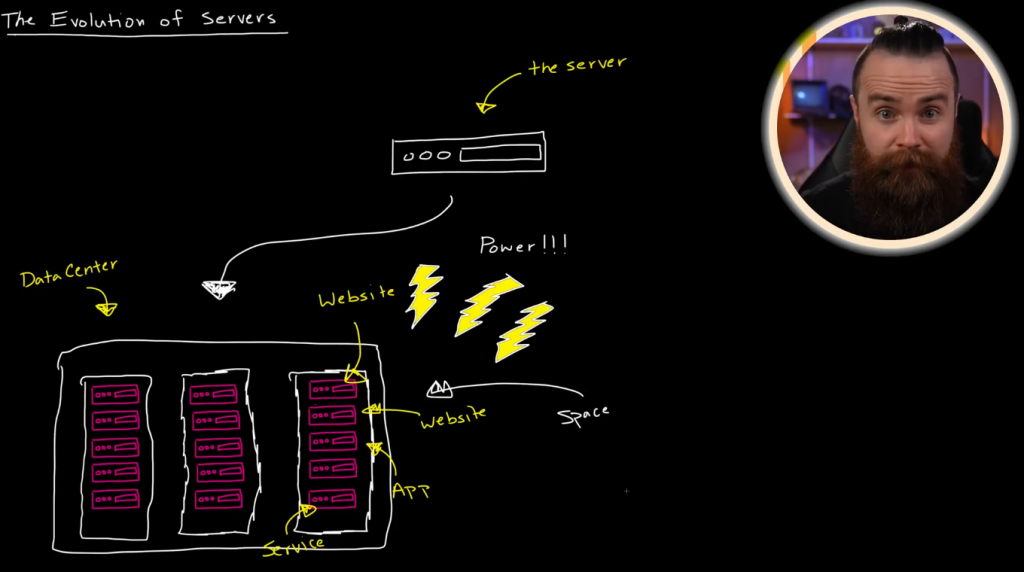

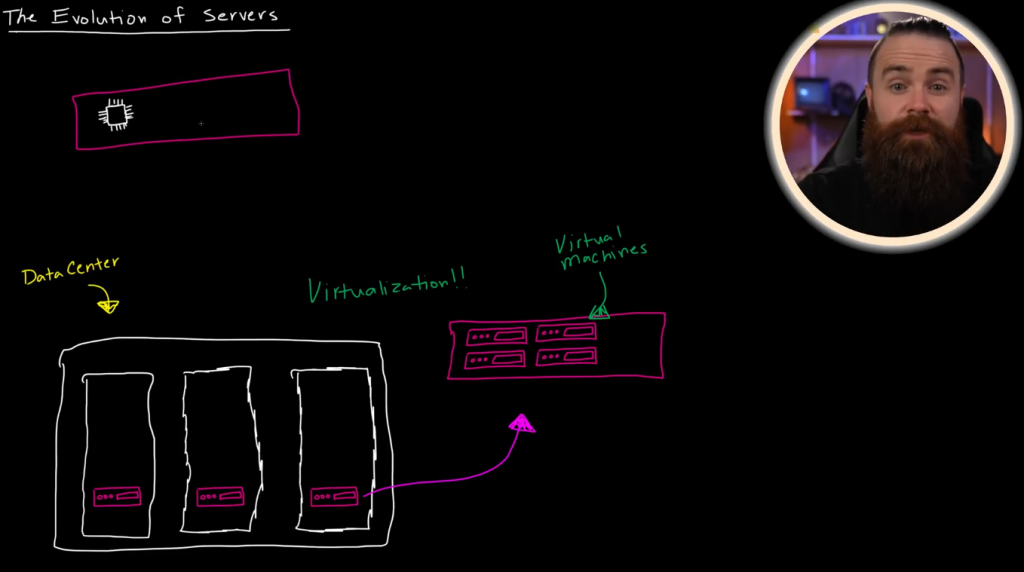

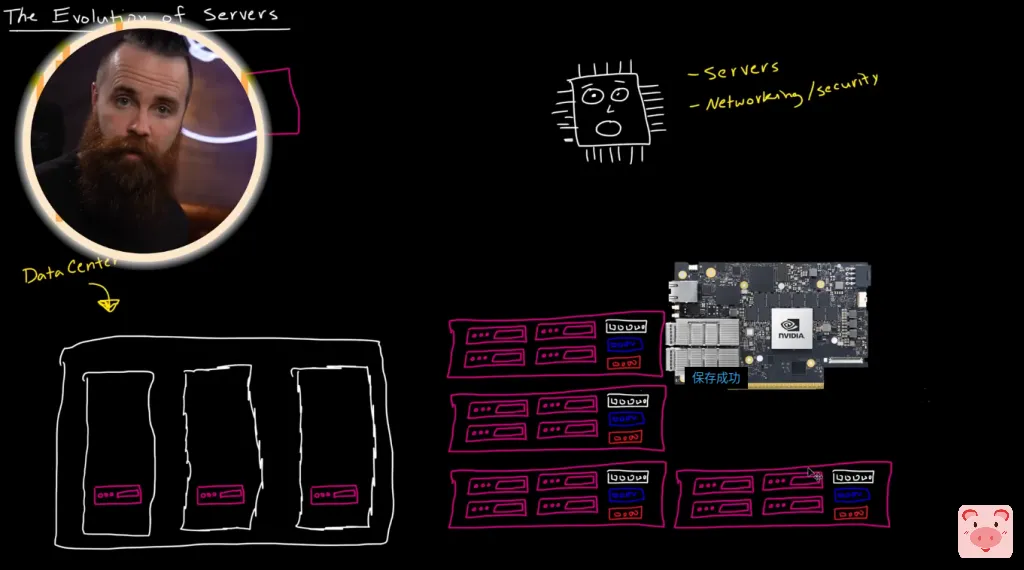

现在,首先让我们来谈谈服务器,以及它们如何发生了很大的变化。如果你喜欢,什么是服务器?嗯,它是一种互联网的生活。我们所做的一切,每张图片,每个网站都将是在一个数据中心的某个地方的服务器上。而在过去,我们有太多的服务器。这已经成为一个问题。你看,每次我们想部署一个新的网站,一个新的应用程序,一个新的东西,我们将不得不部署一个新的物理服务器,填补我们的机架,运行的空间,使用大量的电力。这是疯狂的低效率。这就是虚拟化出现的地方。你可能看到了这一点,对吗?

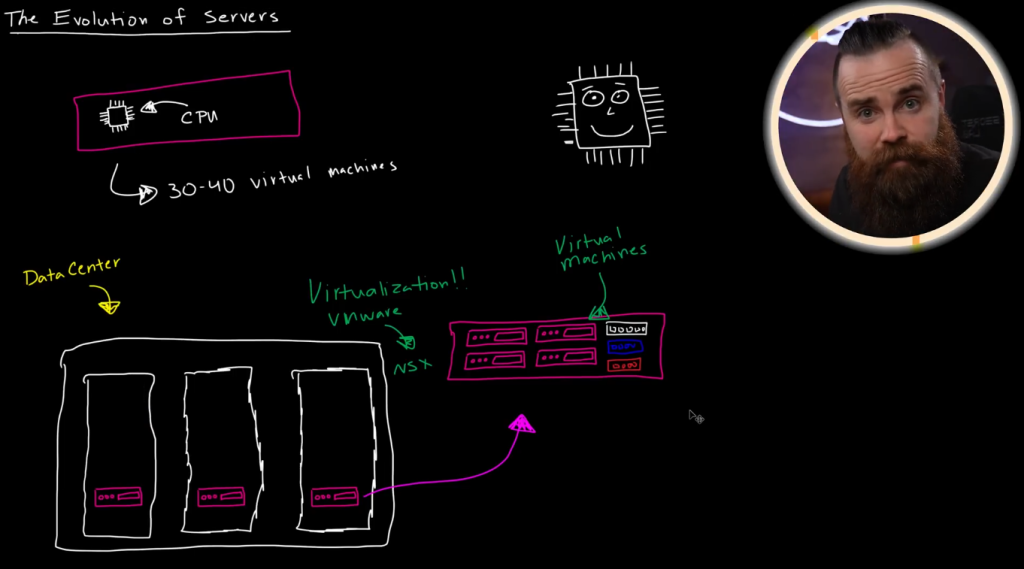

而使用像VMware这样的东西,我们可以把所有这些服务器,把它们放到一台服务器上,这听起来有点疯狂,对吗?而这些服务器中的每一个现在都是一个虚拟机。现在,这实际上是一个游戏规则的改变者。我们可以减少我们的物理服务器的数量,因为我们只有一个物理服务器,这些虚拟机中的每一个都将共享这一个物理服务器的资源。

但这就是我们问题的开始。我想把重点放在CPU先生身上,我们的中央处理单元,做一般的事情。你看他的工作变得更难了。他从管理一个服务器、一个操作系统,变成了管理一堆操作系统、一堆服务器,他被分散使用在多台机器上。这就是我们真正要做的。像认真的,我们的一些物理服务器现在有30到40甚至更多的虚拟机在上面,都在分享这些服务器资源。所以是的,CPU的负担变得很重。但我们把他做得更大、更好,他可以做得更多,以至于我们的很多CPU可以处理这么多虚拟机。这很疯狂。所以你可能在想,查克,问题出在哪里?问题就在这里。我们并没有停止在物理服务器的虚拟化。不,不,不,不。我们想,嘿,我们还可以虚拟化什么?网络。你看在一个数据中心,我们将有交换机,路由器,防火墙,和所有种类的安全设备。这些曾经是他们自己的物理盒子,就像服务器一样。你可能知道这是怎么回事。我们想,嘿,我们有所有这些东西占据了空间。我们为什么不把它虚拟化?这就是我们所做的。在来到软件找到网络,所有很酷的网络东西我们可以在我们的物理盒子上做。我们然后把它扔到服务器的虚拟机上。有趣的是,同样的人,VMware,帮助我们虚拟化我们的物理服务器。他们创建了NSX,你必须非常小心地说你必须发音。所以现在NSX已经帮助我们虚拟化了很多网络堆栈和安全,网络安全的东西,它们不再是处理自己业务的物理盒子。但现在他们在一台服务器上共享空间和你猜到的资源,与所有其他机器和服务器一起,我们已经虚拟化了。

所以现在在这一点上,CPU先生,他变得非常有压力。他对处理服务器没有意见。让我们把这些虚拟化吧。但现在所有的网络和安全和东西都回到了压力模式。他已经完成了。他从一个服务器上管理一个操作系统的简单生活到现在做所有这些事情。尽管我们用大量的核心和线程使他变得非常强大,但他开始成为拖累事情的瓶颈。而其中一个主要原因是,他并不是真正为网络和安全而建立的就像他能做的那样,但他更多的是用于一般用途。他擅长很多事情,但当涉及到专业的事情,如加密和解密流量,传输大量数据和分析数据时,他就像,他没有问题。当我们的网络开始变快时,他真的开始出汗了,从每秒1千兆到10到100到200,他无法跟上。他举起他的CPU小手,说,我做不到。我打算退出。而我们说,不要放弃。我们会带来一些帮助。别担心。我们带来了所谓的聪明的尼克,不,我不是在谈论我的视频编辑,尼克,尽管他是唯一的聪明的尼克,我需要的是你,哥们。现在,这里是智能网卡。它类似于普通的一般NIC,它代表网络接口卡。每台电脑都有一个,包括你的。它通常允许你连接一个以太网连接并获取互联网。服务器有这个在许多情况下,智能网卡是专门为处理CPU,CPU先生并不擅长的事情而设计的。因此,CPU先生大大松了一口气,因为现在我可以给像网络流量检查和网络安全的事情,如IDS和IPS,这是一种美丽的局面,对吗?就像我们只是把这个网卡,插入服务器的PCIe插槽中,然后把一些工作负载从CPU上移开,并把它交给智能网卡。

而在许多情况下,这也是我们的一种解决方案。现在我知道你们中的一些人可能想知道GPU在哪里。他在做什么?叫他离开懒懒的屁股来帮忙我希望他能。这算是一个漂亮的男孩。他所关心的是外观、图形和一些AI的东西。他并不是为了帮助数据流量转发而设计的。现在我们的旅程并没有结束,因为如你所知,技术不断增加。我们想增加更多的服务器,做更多的网络流量,现在聪明的网卡看起来有点像愚蠢的尼克。不,我只是在开玩笑。但说真的,我们现在已经到了这样的地步,聪明的网卡,虽然他很好,但还不够用。所以当然,他在帮助我们的CPU,这有点像我们给了他一个额外的手臂,但他需要的不仅仅是一个额外的手臂。它需要一个 ARM 处理器

你会明白我的意思的。一会儿就会明白了。我只是忍不住,开了这个玩笑。所以这里是DPU的地方,数据处理单元,而CPU和GPU都有他们擅长的东西,DPU,他擅长数据处理,正如其名字可能暗示的那样。现在,DPU被命令做与智能网卡相同的工作,以卸载CPU的压力,但他有点不同。他不只是一个手臂。他是一个完整的身体。

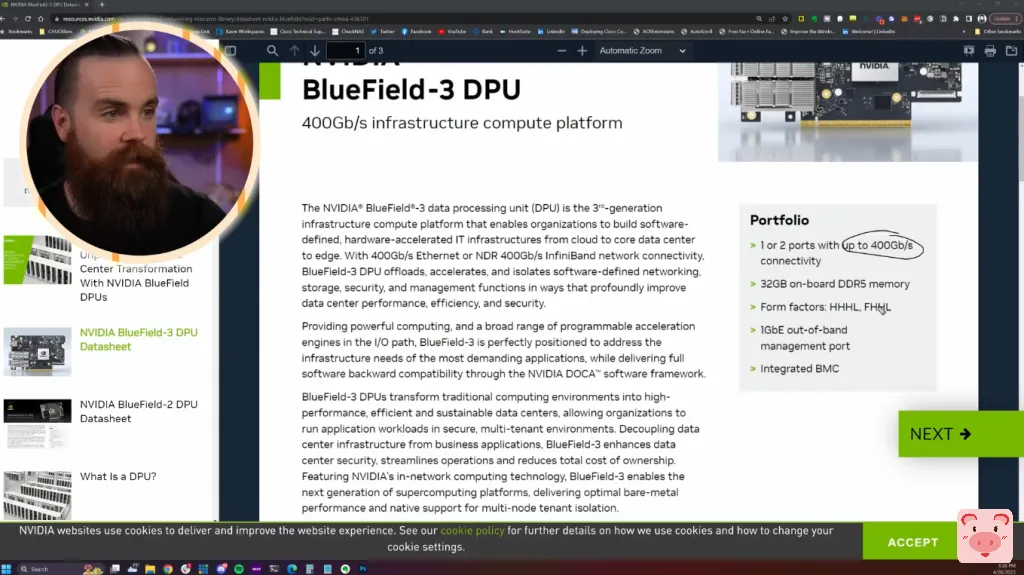

他是一个被放在服务器里的服务器。认真地说,这就是情况所在。让我给你看看这个东西。顺便说一下,这里是NVIDIA的bluefield-3 DPU。这是最新和最伟大的。

看看这东西有多强壮。他们把它称为SOC或芯片系统不,那是在那里。注意我保留了智能网卡的图纸,因为这基本上是这个设备的内容。在大多数情况下,bluefield-3 DPU将在智能网卡上。这将是它的一部分。所以他们实际上称它为启用DPU的智能网卡。

而且,它做了很多典型的智能网卡可能做的事情。除了再次,它是自己的人,自己的。而我一直在说人,这有点奇怪。它是自己的终端设备。就像它实际上是一个服务器中的服务器。而在VMware的情况下,我将在这里演示一下,这真的很疯狂你已经有了服务器,对吗?

运行VMware ESXI与vSphere eight或VMware eight,你想怎么称呼它?而且他们是分布式服务引擎。他们实际上是在这个Bluefield DPU上安装ESXI。它在服务器里面有自己的操作系统服务器。因此,这意味着它不只是帮助CPU完成某些任务,像入侵检测、网络流量检查,所有这些东西。而不是仅仅帮助它做,你知道我的意思吗?就像我们正在安装防火墙软件,网络软件到DPU上CPU就像,他只是接手了这个工作。我甚至不知道他在做什么。我的意思是,他知道,但这是分开的。DPU正在处理负载。网络流量不在CPU上。它来到了DPU。他在处理一切。现在,让我给你看看这个东西的规格。所以你可以了解这里的范围。看看这个。400千兆比特每秒的带宽。

什么?试着去做那个CPU。试试。你不能。这东西比你的游戏电脑有更多的内存。它就是这样。对不起。这就是我的ARM笑话的由来。它有一个ARM CPU。现在,ARM是非常棒的,因为它很省电,它是为高性能处理数据等东西而建立的。我的意思是,有一个像大力士这样的名字,你怎么能不强大呢?说到力量,它所做的或允许的主要强大的事情之一是可编程性。Doca,我相信这是NVIDIA为其DPU提供的SDK,允许DPU的极端定制和可编程性。你可能已经注意到了右边这里,它可以做的所有事情,它可以处理,这一点我忘了说。我们还决定将我们的存储软件虚拟化,以寻找存储。因此,CPU已经快要死了。所以我们不得不把DPU扔在那里,看看所有这些网络的东西。这对我来说太疯狂了,特别是作为一个使用物理硬件的网络工程师,看到所有这些都被虚拟化,并通过DPU加速,VXLAN,在DPU内加速,第四层防火墙连接跟踪。

所以,这确实给我留下了一个问题。我什么时候才能在我的电脑里得到一个?说真的,你能想象你的电脑上有一个DPU,允许有这样的能力吗?我不需要它,但我想要它。但我可以满足于有一天从我的一台服务器开始。现在有更多的DPU,以及它们有多强大,它们能做什么。我下面会有一些白皮书。但现在我想亲手给你看看它的性能是什么样的。而实际上,我忘了提这个。你可能还想知道为什么是DPU?当然,我们可以在服务器上增加一个DPU,但如果再有一个服务器,再有一个,再有一个,这样CPU就不会有压力了,不是更合理吗?我们就有一堆的CPU。好吧,我们又回到了最初的问题,不是吗?我们正在填满我们的数据中心。我们正在耗尽空间。我们使用了太多的电力,我们是低效的。另一方面,一个DPU,用这个ARM处理器更省电。

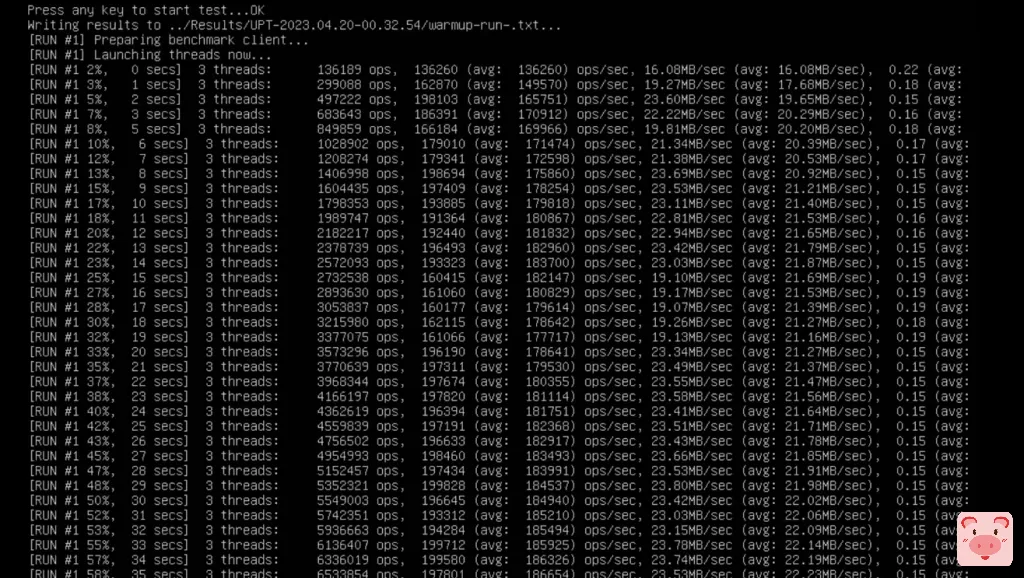

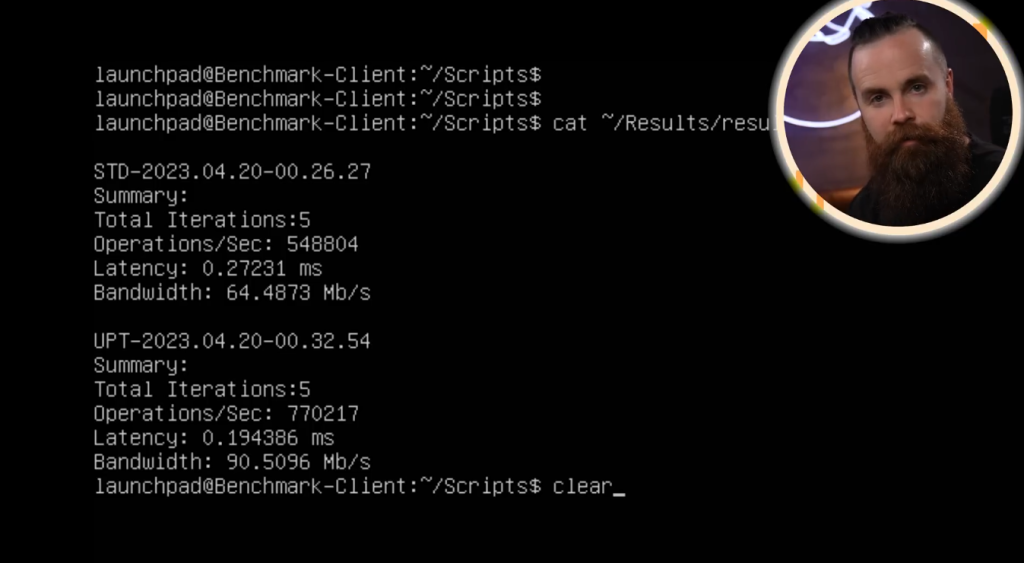

与其在多个服务器上扩张,不如在你的一台服务器上增加一些马力,专门处理你试图优化的流量,通过从其他资源中卸载,你会看到一些疯狂的东西,比如30%的效率提升。让我给你看看。所以我得到了这个例子,对吗?英伟达让我访问他们的数据中心和他们的VMware vCenter环境。是的,通过VMware vSphere 8,你可以使用DPU。你可以把它们分配给你的虚拟机来使用。现在,作为我的实验室和玩这个的一部分,我不得不设置一些东西。这包括虚拟机,甚至在NSX中配置一些交换机和其他东西,这,好吧,NSX,包括他们的,你知道,他们的虚拟化网络和防火墙安全的东西。这是超级有趣的。现在,我在实验室里做的第一件事是测试一些以前不可能做到的事情你看,传统上,当与VMware一起使用智能网卡时,你可以这样做,它涉及到做所谓的PCIe透传,这对很多事情都适用,除了当你想做像vMotion这样的事情时,vMotion是如此酷。它允许你将虚拟机从一个物理主机移动到另一个。所以就像一个数据中心到另一个数据中心。我已经用了一百万次了,但是通过 PCIe 透传,这将会中断。当你尝试vMotion时,你失去了与该智能网卡的连接。它就无法工作了。有点痛苦,但随着VMware 8、vSphere 8和他们以前称为 Project Monterey 的分布式服务引擎所谓的UPT或通用透传。实际上,UPT代表的是统一透传。你可以将其与NVIDIA DPU一起使用,这意味着,当我在做这个的时候,你就可以看到这个。我可以把DPU作为网卡分配给一个虚拟机。再次,顺便说一下,DPU安全地依偎在服务器的PCIe插槽中,但它也在运行自己的操作系统,这有点疯狂,ESXi。所以那台服务器把DPU作为它的网卡,我可以把那台服务器vMotion到另一台主机上,它就可以工作了。我不必担心这个问题,这是很重要的。VMware 工程师们肯定很羡慕。这是一个很酷的功能,但现在我们来测试一下DPU的速度。现在NVIDIA设置了一个相当酷的测试。我们在Redis服务器之间传输数据,Redis是一个数据库,基本上,他们给了我一个测试和一个脚本来像传输数据,首先,例子一,一个普通的网卡,一个网卡在使用的CPU进行联网。CPU不得不处理这些东西。然后我们切换到使用DPU,那些安装了DPU的机器。

CPU测试

所以这里是现在的测试。首先,让我们运行标准的网卡测试,看看性能如何。所以还不错,带宽是每秒64兆,延迟,0.27231毫秒,每秒548,000次操作。

顺便说一下,这整个实验室是用一个25千兆的以太网集群完成的。如果你想知道关于这个设置的更多细节,我们在下面有一个链接到NVIDIA的白皮书。

DPU测试

现在我们来测试一下DPU。哦,我的天哪,它太快了。你看到了吗?

每秒90兆比特,延迟0.19,每秒770,000次操作。计算一下吧。我不打算做,但这实在是太快了,对吗?现在这个测试更疯狂的是,你知道,DPU显然表现得更好。但同时,CPU 仍然在那里,轻松自在。就像他并没有受到压力。所以他在那里为他擅长的事情提供强大的支持。而DPU正在做他擅长的事情。一切都很好。而你知道,只是标准的网卡测试,CPU的压力就很大。他说,啊,所以当你比较这些数字时要记住这一点。它不仅更好,而且更有效率,因为CPU仍然在做他的事情,与所有其他的服务器。他没有压力了。我们正在使用更少的电力。

总结

这就是虚拟机的未来。这就是我们设计数据中心的方式。DPU是未来。随着我们做更先进的事情,比如,我不知道,人工智能,我们会有专门的DPU,可以处理这样的事情。现在,正如Abby之前提到的,这只是在一个25千兆位/秒的集群上完成的。所以你可能想知道,查克,你说每秒400千兆位。那是哪里?这就是为什么你在这里没有看到它。这是对一个应用程序和一个工作负载的测试。而重点是演示DPU可以为工作负载做什么,这有点疯狂。现在,如果你确实想了解最大限度地提高这个的真正规模,Nvidia有一份白皮书,下面。看看这个。这是一个有趣的阅读。奶奶,去订阅NetworkChuck。你在做什么?